Constrained Decoding for Robotics Foundation Models

作者: Parv Kapoor, Akila Ganlath, Michael Clifford, Changliu Liu, Sebastian Scherer, Eunsuk Kang

分类: cs.RO, cs.LG, cs.LO

发布日期: 2025-09-01 (更新: 2025-09-27)

💡 一句话要点

SafeDec:针对机器人Foundation Model的约束解码框架,保障动作安全性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人Foundation Model 约束解码 安全性 信号时序逻辑 STL 推理时干预 动作规划

📋 核心要点

- 现有机器人Foundation Model依赖数据驱动,缺乏对行为正确性的显式保证,可能导致不安全行为。

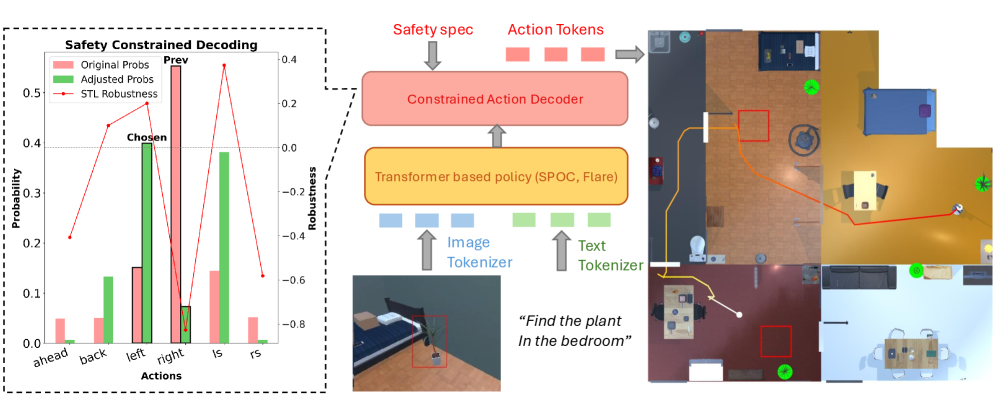

- SafeDec框架通过在解码阶段引入信号时序逻辑(STL)约束,确保生成的动作序列满足预定义的安全规范。

- 实验表明SafeDec能有效过滤不安全动作,并支持条件动作生成,提升了现有通用策略的安全性。

📝 摘要(中文)

机器人Foundation Model的最新进展展现了机器人系统在端到端和通用能力方面的潜力。这些模型在大量的模拟和真实世界轨迹上进行训练,直接将多模态观测映射到用于物理执行的动作序列。尽管具有良好的实际能力,但这些模型仍然是数据驱动的,因此缺乏对行为正确性的明确概念。我们通过引入SafeDec来解决这个问题,SafeDec是一个用于自回归机器人Foundation Model的约束解码框架,它对候选动作轨迹强制执行不变的安全规范。特定于任务的安全规则被表示为信号时序逻辑(STL)公式,并在推理时以最小的开销强制执行。我们的方法确保生成的动作在运行时在假定的动力学下可证明地满足STL规范,而无需重新训练,同时保持与底层策略无关。我们在CHORES基准测试中的任务上评估SafeDec,针对最先进的通用策略(例如,SPOC,Flare,PoliFormer),跨越数百个程序生成的环境,并表明我们的解码时干预不仅对于过滤不安全的动作有用,而且对于条件动作生成也很有用。

🔬 方法详解

问题定义:现有机器人Foundation Model虽然在通用任务上表现出色,但其数据驱动的本质导致缺乏对安全性的显式建模。模型可能生成违反安全规则的动作序列,从而在实际部署中造成风险。现有方法难以在不重新训练模型的情况下,保证生成动作的安全性。

核心思路:SafeDec的核心思路是在Foundation Model的解码阶段引入约束,确保生成的动作序列满足预定义的安全规范。通过信号时序逻辑(STL)公式来形式化地表达这些安全规范,并在解码过程中过滤掉违反这些规范的动作。这种方法无需重新训练模型,即可在推理时保证安全性。

技术框架:SafeDec框架主要包含以下几个阶段:1) STL规范定义:根据任务需求,定义STL公式来描述安全规则。2) 动作序列生成:使用预训练的机器人Foundation Model生成候选动作序列。3) STL约束验证:使用模型预测的状态和定义的STL公式,验证候选动作序列是否满足安全规范。4) 动作序列过滤/修正:如果动作序列不满足安全规范,则将其过滤掉或进行修正,例如通过重新采样或优化,直到找到满足规范的动作序列。

关键创新:SafeDec的关键创新在于其在解码阶段引入约束,无需重新训练模型即可保证安全性。它将形式化的安全规范(STL)与机器人Foundation Model相结合,提供了一种在推理时可验证的安全性保证。此外,SafeDec的设计与底层策略无关,可以应用于各种不同的机器人Foundation Model。

关键设计:SafeDec的关键设计包括:1) STL公式的表达:如何将任务相关的安全规则有效地转化为STL公式。2) STL约束验证的效率:如何在推理时高效地验证动作序列是否满足STL约束。3) 动作序列修正策略:当动作序列不满足安全规范时,如何有效地修正动作序列,例如通过重新采样或优化。

🖼️ 关键图片

📊 实验亮点

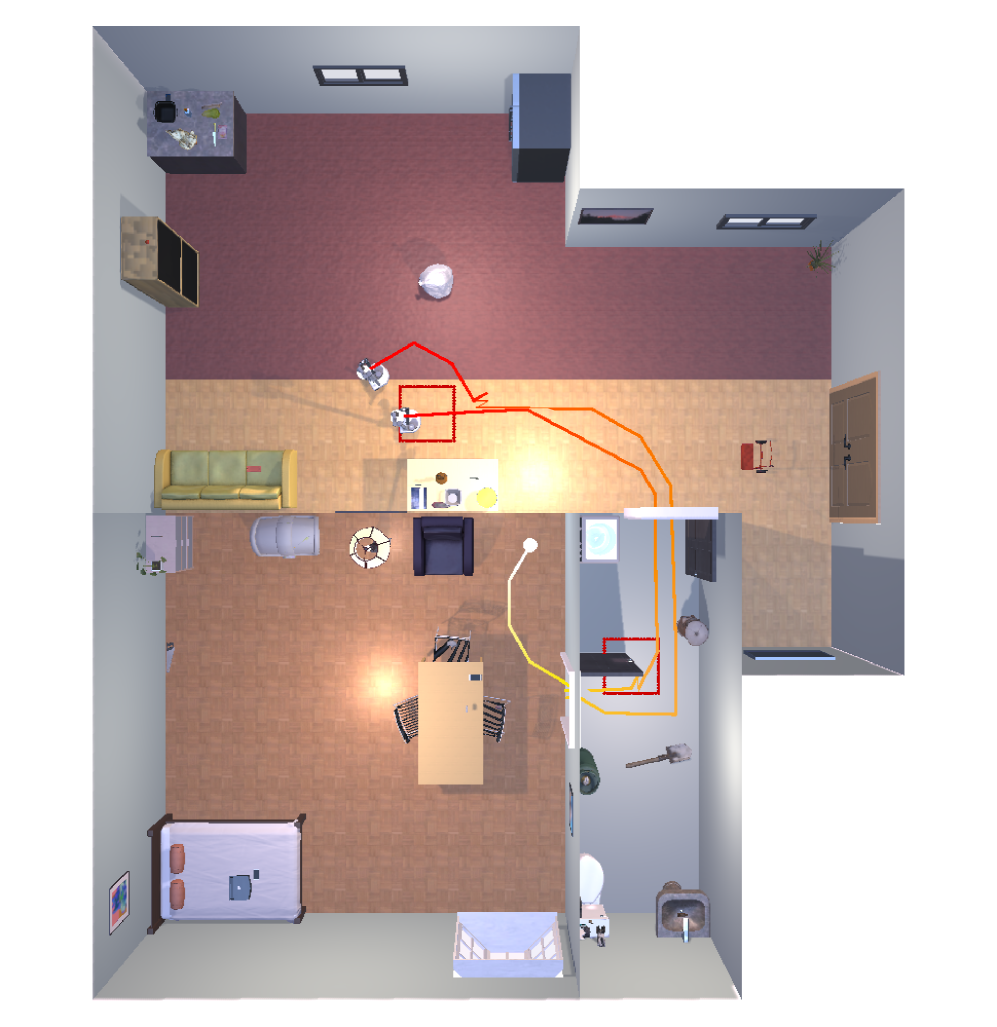

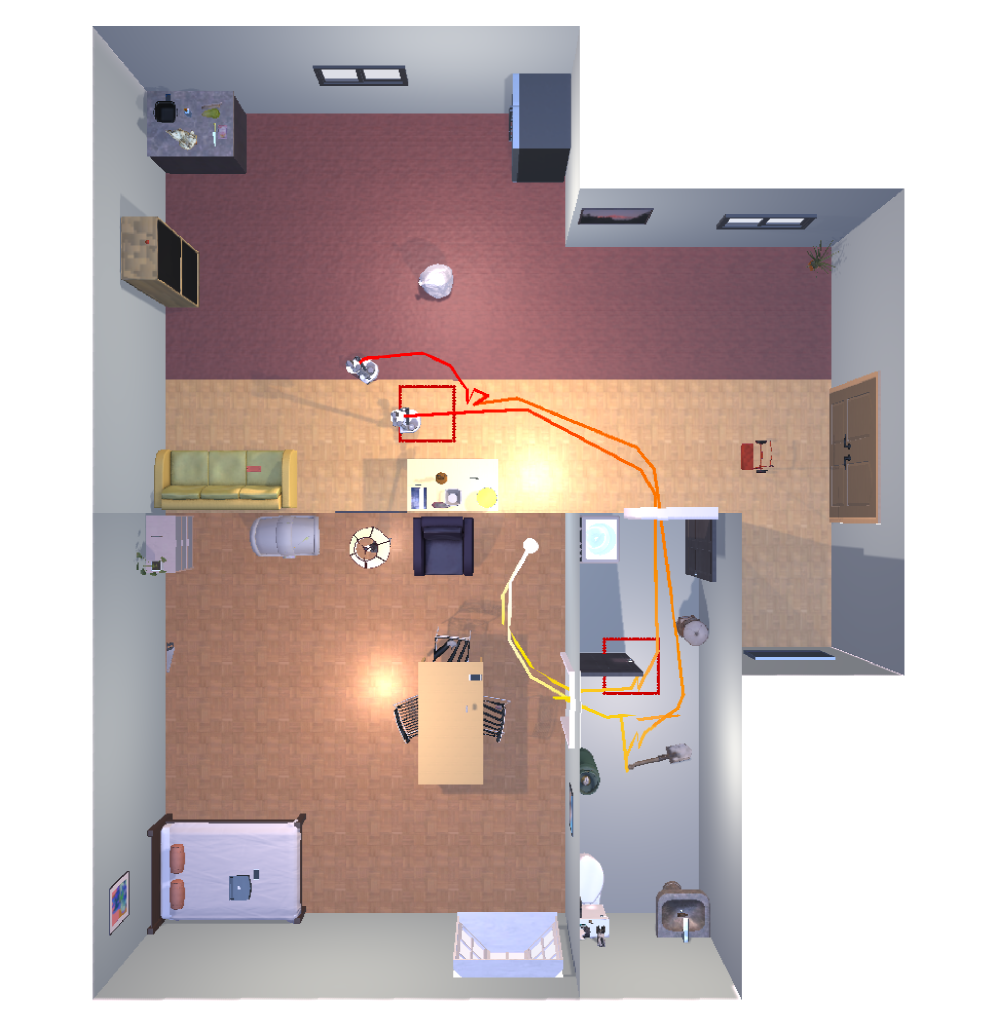

SafeDec在CHORES基准测试中,针对SPOC、Flare、PoliFormer等先进通用策略进行了评估。实验结果表明,SafeDec能够有效过滤不安全动作,并支持条件动作生成。通过引入SafeDec,这些策略在安全性方面得到了显著提升,同时保持了良好的任务完成性能。具体性能数据和提升幅度在论文中有详细展示。

🎯 应用场景

SafeDec可应用于各种需要安全保障的机器人应用场景,例如自动驾驶、工业机器人、医疗机器人等。通过在解码阶段引入安全约束,可以有效避免机器人执行不安全动作,降低事故风险,提高系统的可靠性和安全性。该研究对于推动机器人Foundation Model在实际场景中的应用具有重要意义。

📄 摘要(原文)

Recent advances in the development of robotic foundation models have led to promising end-to-end and general-purpose capabilities in robotic systems. Trained on vast datasets of simulated and real-world trajectories, these models map multimodal observations directly to action sequences for physical execution. Despite promising real-world capabilities, these models are still data-driven and, therefore, lack explicit notions of behavioral correctness. We address this gap by introducing SafeDec, a constrained decoding framework for autoregressive, robot foundation models that enforces invariant safety specifications on candidate action trajectories. Task-specific safety rules are expressed as Signal Temporal Logic (STL) formulas and are enforced at inference time with minimal overhead. Our method ensures that generated actions provably satisfy STL specifications under assumed dynamics at runtime without retraining , while remaining agnostic of the underlying policy. We evaluate SafeDec on tasks from the CHORES benchmark for state-of-the-art generalist policies (e.g., SPOC, Flare, PoliFormer) across hundreds of procedurally generated environments and show that our decoding-time interventions are useful not only for filtering unsafe actions but also for conditional action generation. Videos are available at constrained-robot-fms.github.io.