UltraTac: Integrated Ultrasound-Augmented Visuotactile Sensor for Enhanced Robotic Perception

作者: Junhao Gong, Kit-Wa Sou, Shoujie Li, Changqing Guo, Yan Huang, Chuqiao Lyu, Ziwu Song, Wenbo Ding

分类: cs.RO

发布日期: 2025-08-28 (更新: 2025-08-29)

备注: Accepted to IROS 2025

💡 一句话要点

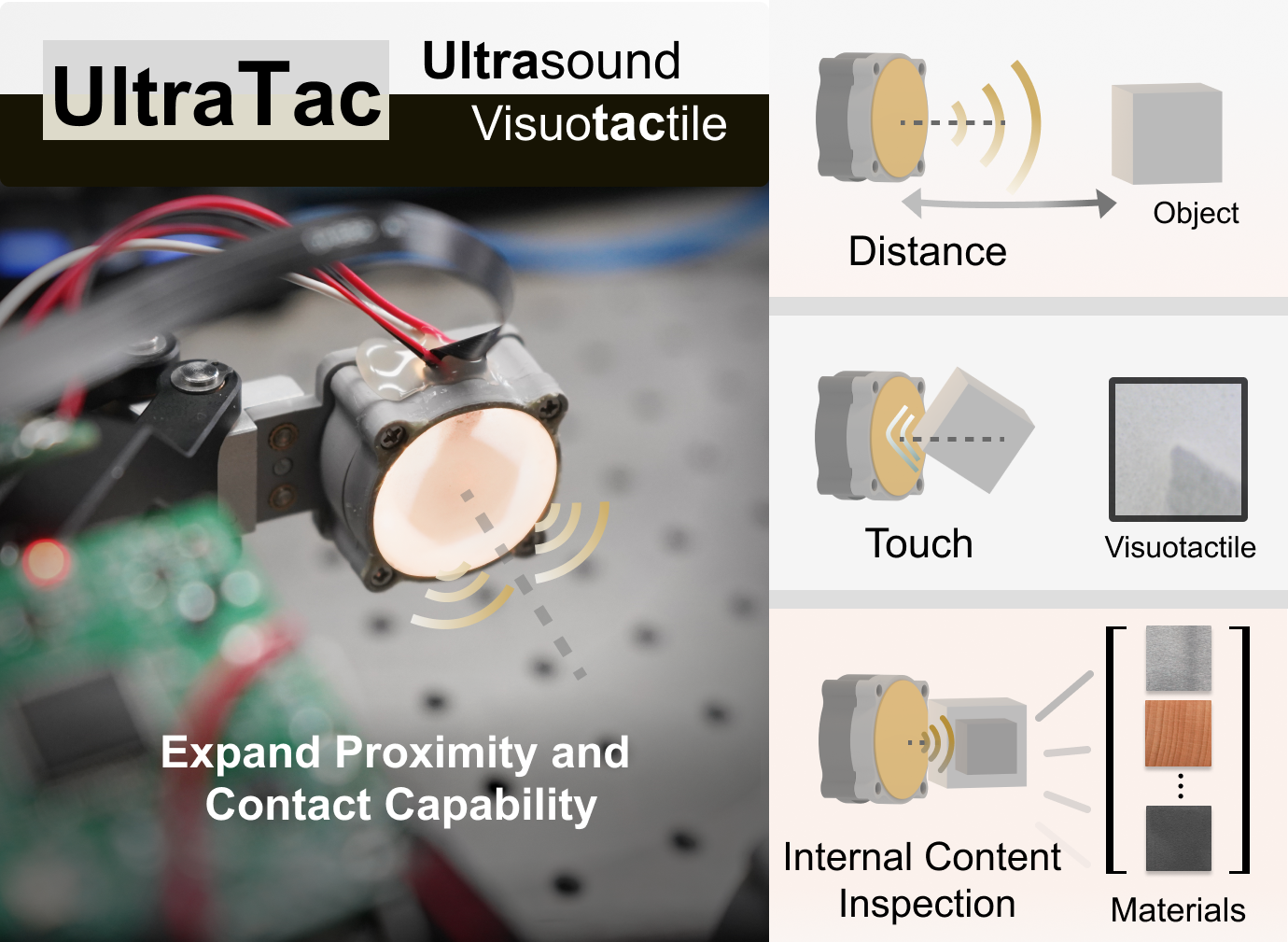

UltraTac:集成超声与视觉触觉的传感器,提升机器人感知能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 视觉触觉传感器 超声传感 机器人感知 多模态融合 物体识别

📋 核心要点

- 现有视觉触觉传感器虽能提供高分辨率触觉信息,但无法感知物体的材料特性,限制了其应用。

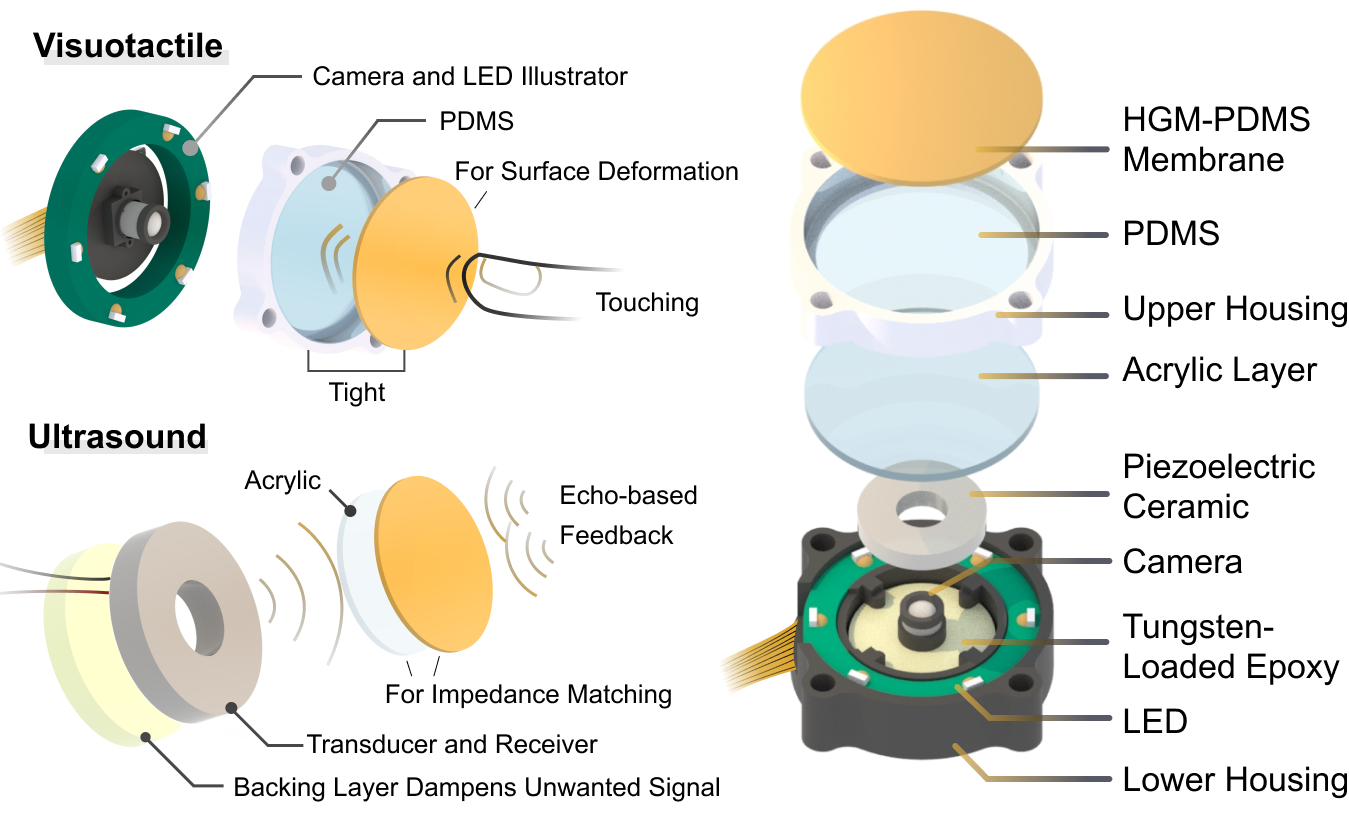

- UltraTac通过同轴光声结构集成视觉触觉成像与超声传感,共享结构组件并实现一致的传感区域。

- 实验表明,UltraTac在接近感应、材料分类和纹理-材料双模态物体识别方面表现出色,并成功应用于机器人操作。

📝 摘要(中文)

本文提出了一种名为UltraTac的集成传感器,它通过同轴光声结构将视觉触觉成像与超声传感相结合。该设计共享结构组件,并为两种模态实现了统一的传感区域。此外,我们将声学匹配集成到传统的视觉触觉传感器结构中,从而在不影响视觉触觉性能的前提下,实现了超声传感模态的集成。通过触觉反馈,我们动态调整超声模块的工作状态,以实现灵活的功能协调。系统实验证明了三个关键能力:3-8厘米范围内的接近感应(R^2=0.90),材料分类(平均准确率:99.20%),以及在15类任务上实现92.11%准确率的纹理-材料双模态物体识别。最后,我们将传感器集成到机器人操作系统中,以同时检测容器表面图案和内部内容,验证了其在高级人机交互和精确机器人操作中的潜力。

🔬 方法详解

问题定义:现有视觉触觉传感器主要依赖于光学成像来感知接触表面的形变,虽然能提供高分辨率的触觉信息,但无法直接感知物体的内部结构和材料属性。这限制了机器人在复杂操作任务中的应用,例如无法区分不同材质的物体,或者无法在不破坏包装的情况下检测内部物品。

核心思路:UltraTac的核心思路是将超声传感与视觉触觉传感集成到一个紧凑的传感器中,利用超声波穿透物体表面的能力来获取物体的材料属性和内部结构信息,同时利用视觉触觉传感器获取高分辨率的表面形变信息。通过融合两种模态的信息,可以实现更全面、更鲁棒的物体感知。

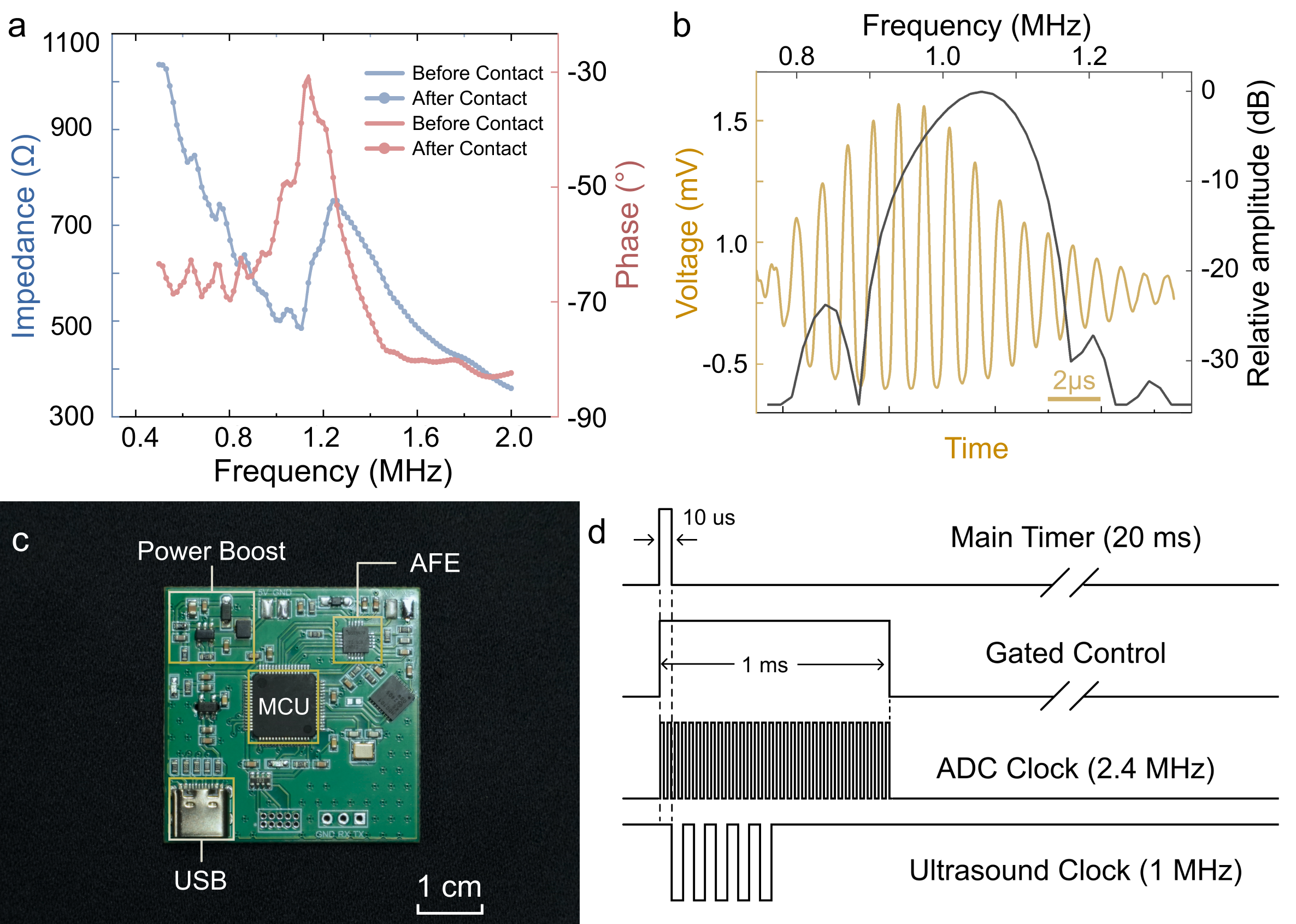

技术框架:UltraTac传感器采用同轴光声结构,视觉触觉成像模块和超声传感模块共享结构组件,保证了两种模态的传感区域一致。整体流程包括:1) 视觉触觉传感器获取表面形变信息;2) 超声传感器发射超声波并接收反射信号;3) 触觉反馈动态调整超声模块的工作状态;4) 融合视觉触觉信息和超声信息,进行物体识别和属性估计。

关键创新:UltraTac的关键创新在于将超声传感与视觉触觉传感集成到一个紧凑的传感器中,并实现了两种模态的协同工作。此外,该设计还引入了声学匹配技术,优化了超声波的传输效率,从而提高了超声传感的性能。与传统的视觉触觉传感器相比,UltraTac能够感知物体的材料属性和内部结构信息。

关键设计:UltraTac的关键设计包括:1) 同轴光声结构,保证两种模态的传感区域一致;2) 声学匹配层,优化超声波的传输效率;3) 触觉反馈机制,动态调整超声模块的工作状态。具体的参数设置和网络结构在论文中没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,UltraTac传感器在接近感应方面表现出色,R^2达到0.90。在材料分类任务中,平均准确率高达99.20%。在15类纹理-材料双模态物体识别任务中,准确率达到92.11%。此外,该传感器还成功应用于机器人操作系统中,能够同时检测容器表面图案和内部内容,验证了其在实际应用中的潜力。

🎯 应用场景

UltraTac传感器在机器人操作、人机交互、医疗诊断等领域具有广泛的应用前景。例如,可以应用于机器人抓取和操作,使机器人能够识别不同材质的物体并进行精细操作;可以应用于人机交互,使机器人能够感知用户的意图并做出相应的反应;可以应用于医疗诊断,例如通过触觉和超声结合的方式检测皮肤病变。

📄 摘要(原文)

Visuotactile sensors provide high-resolution tactile information but are incapable of perceiving the material features of objects. We present UltraTac, an integrated sensor that combines visuotactile imaging with ultrasound sensing through a coaxial optoacoustic architecture. The design shares structural components and achieves consistent sensing regions for both modalities. Additionally, we incorporate acoustic matching into the traditional visuotactile sensor structure, enabling integration of the ultrasound sensing modality without compromising visuotactile performance. Through tactile feedback, we dynamically adjust the operating state of the ultrasound module to achieve flexible functional coordination. Systematic experiments demonstrate three key capabilities: proximity sensing in the 3-8 cm range ($R^2=0.90$), material classification (average accuracy: 99.20%), and texture-material dual-mode object recognition achieving 92.11% accuracy on a 15-class task. Finally, we integrate the sensor into a robotic manipulation system to concurrently detect container surface patterns and internal content, which verifies its potential for advanced human-machine interaction and precise robotic manipulation.