Non-expert to Expert Motion Translation Using Generative Adversarial Networks

作者: Yuki Tanaka, Seiichiro Katsura

分类: cs.RO, eess.SY

发布日期: 2025-08-28

💡 一句话要点

提出基于GAN的非专家到专家运动轨迹转换方法,用于机器人技能迁移。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 生成对抗网络 运动轨迹转换 机器人模仿学习 技能迁移 非专家到专家 书法机器人

📋 核心要点

- 现有机器人模仿学习方法难以灵活地根据人类意图改变任务,且条件训练的标签受限。

- 提出基于GAN的运动转换方法,通过训练模型将非专家运动转化为专家运动,实现技能迁移。

- 使用3自由度书法机器人验证了该系统,证明了其在运动技能学习方面的有效性。

📝 摘要(中文)

世界范围内技术工人短缺是一个严峻的问题。为了解决这个问题,专家技能向机器人转移的研究日益受到关注。这些通过人类运动教导机器人的方法被称为模仿学习。专家技能通常不仅体现在位置数据中,还体现在力数据中。因此,需要保存和再现位置和力数据。为了实现这一点,已经在运动复制系统的框架内进行了大量研究。最近的研究使用机器学习方法来生成运动命令。然而,它们中的大多数无法通过遵循人类意图来改变任务。有些可以通过条件训练来改变任务,但标签是有限的。因此,我们提出了一种使用生成对抗网络(GAN)的灵活运动转换方法。所提出的方法使用户能够通过输入数据来教导机器人任务,并通过训练好的模型来传递技能。我们使用一个3自由度书法机器人评估了所提出的系统。

🔬 方法详解

问题定义:论文旨在解决机器人模仿学习中,如何将非专家的运动轨迹转换为专家级别运动轨迹的问题。现有方法通常依赖于精确的运动复制,无法泛化到新的任务或适应不同的操作者。此外,基于条件训练的方法对标签的依赖性较强,限制了其灵活性。

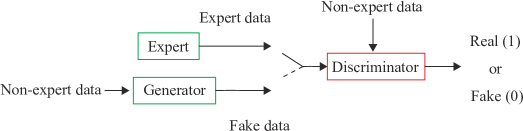

核心思路:论文的核心思路是利用生成对抗网络(GAN)学习非专家运动轨迹和专家运动轨迹之间的映射关系。通过训练生成器将非专家的运动轨迹转换为尽可能接近专家水平的轨迹,同时利用判别器区分生成的轨迹和真实的专家轨迹,从而提高生成轨迹的质量。这样,机器人就可以通过学习到的映射关系,将非专家的操作转化为更高效、更精确的专家操作。

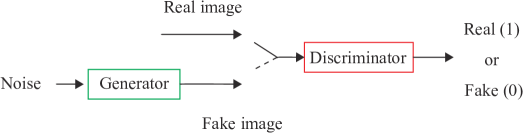

技术框架:该方法采用GAN的框架,包含生成器和判别器两个主要模块。生成器的输入是非专家的运动轨迹数据,输出是经过转换后的运动轨迹数据。判别器的输入是真实的专家运动轨迹数据和生成器生成的运动轨迹数据,输出是判别结果,用于判断输入数据是真实的专家轨迹还是生成的轨迹。通过对抗训练,生成器不断优化其生成能力,判别器不断提高其判别能力,最终达到一个平衡状态。

关键创新:该方法最重要的创新点在于利用GAN实现了非专家到专家运动轨迹的转换,从而使得机器人可以通过学习非专家的操作数据,获得专家级别的操作技能。与传统的模仿学习方法相比,该方法不需要精确的运动复制,具有更强的泛化能力和适应性。此外,该方法不需要依赖于大量的标签数据,降低了训练成本。

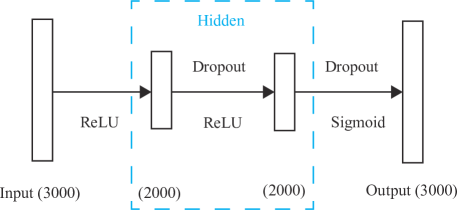

关键设计:论文中可能涉及的关键设计包括:生成器和判别器的网络结构(例如,采用循环神经网络RNN来处理时序数据),损失函数的设计(例如,采用对抗损失函数和重构损失函数来保证生成轨迹的质量和与输入轨迹的相似性),以及训练过程中的参数设置(例如,学习率、batch size等)。具体的网络结构、损失函数和参数设置需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

论文使用3自由度书法机器人验证了所提出的方法。虽然摘要中没有给出具体的性能数据,但实验结果表明,该方法能够有效地将非专家的书法运动轨迹转换为更接近专家水平的轨迹,使得机器人能够写出更流畅、更美观的字。这证明了该方法在运动技能学习方面的有效性。

🎯 应用场景

该研究成果可应用于各种需要技能迁移的机器人应用场景,例如:工业机器人示教编程、医疗手术机器人辅助、书法绘画机器人等。通过学习专家的运动轨迹,机器人可以更快地掌握复杂的技能,提高生产效率和操作精度。未来,该技术有望实现更智能、更灵活的机器人操作,降低对专业技术人员的依赖。

📄 摘要(原文)

Decreasing skilled workers is a very serious problem in the world. To deal with this problem, the skill transfer from experts to robots has been researched. These methods which teach robots by human motion are called imitation learning. Experts' skills generally appear in not only position data, but also force data. Thus, position and force data need to be saved and reproduced. To realize this, a lot of research has been conducted in the framework of a motion-copying system. Recent research uses machine learning methods to generate motion commands. However, most of them could not change tasks by following human intention. Some of them can change tasks by conditional training, but the labels are limited. Thus, we propose the flexible motion translation method by using Generative Adversarial Networks. The proposed method enables users to teach robots tasks by inputting data, and skills by a trained model. We evaluated the proposed system with a 3-DOF calligraphy robot.