Large Model Empowered Embodied AI: A Survey on Decision-Making and Embodied Learning

作者: Wenlong Liang, Rui Zhou, Yang Ma, Bing Zhang, Songlin Li, Yijia Liao, Ping Kuang

分类: cs.RO

发布日期: 2025-08-14

💡 一句话要点

综述:大模型赋能的具身智能,聚焦决策制定与具身学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 大型模型 决策制定 具身学习 世界模型 强化学习 模仿学习 自主导航

📋 核心要点

- 现有具身智能体难以在开放动态环境中实现通用任务的人类水平智能,面临感知、交互、规划和学习等多重挑战。

- 本文综述了大模型如何赋能具身智能,通过增强感知、交互、规划和学习能力,提升具身智能体的决策制定和学习能力。

- 论文首次将世界模型纳入具身智能的综述,并详细阐述了其在增强决策和学习中的设计方法和关键作用。

📝 摘要(中文)

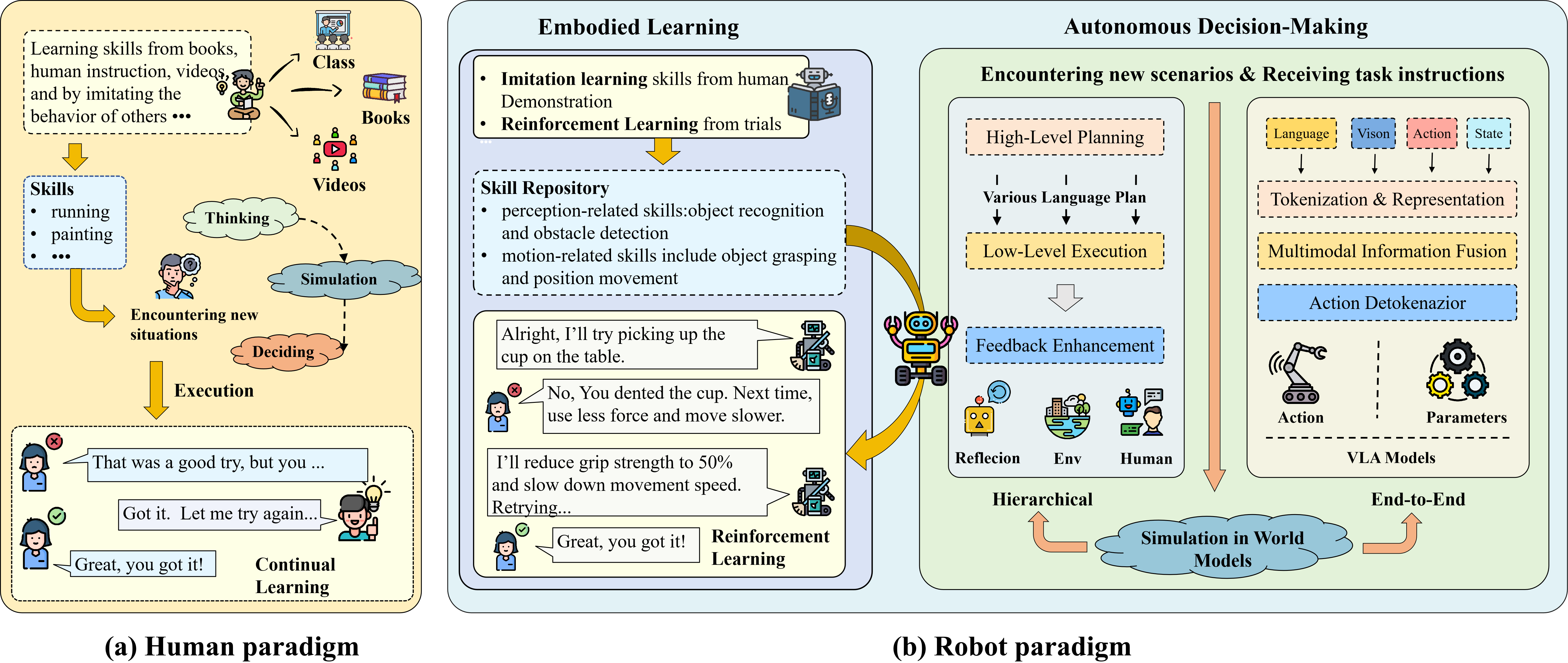

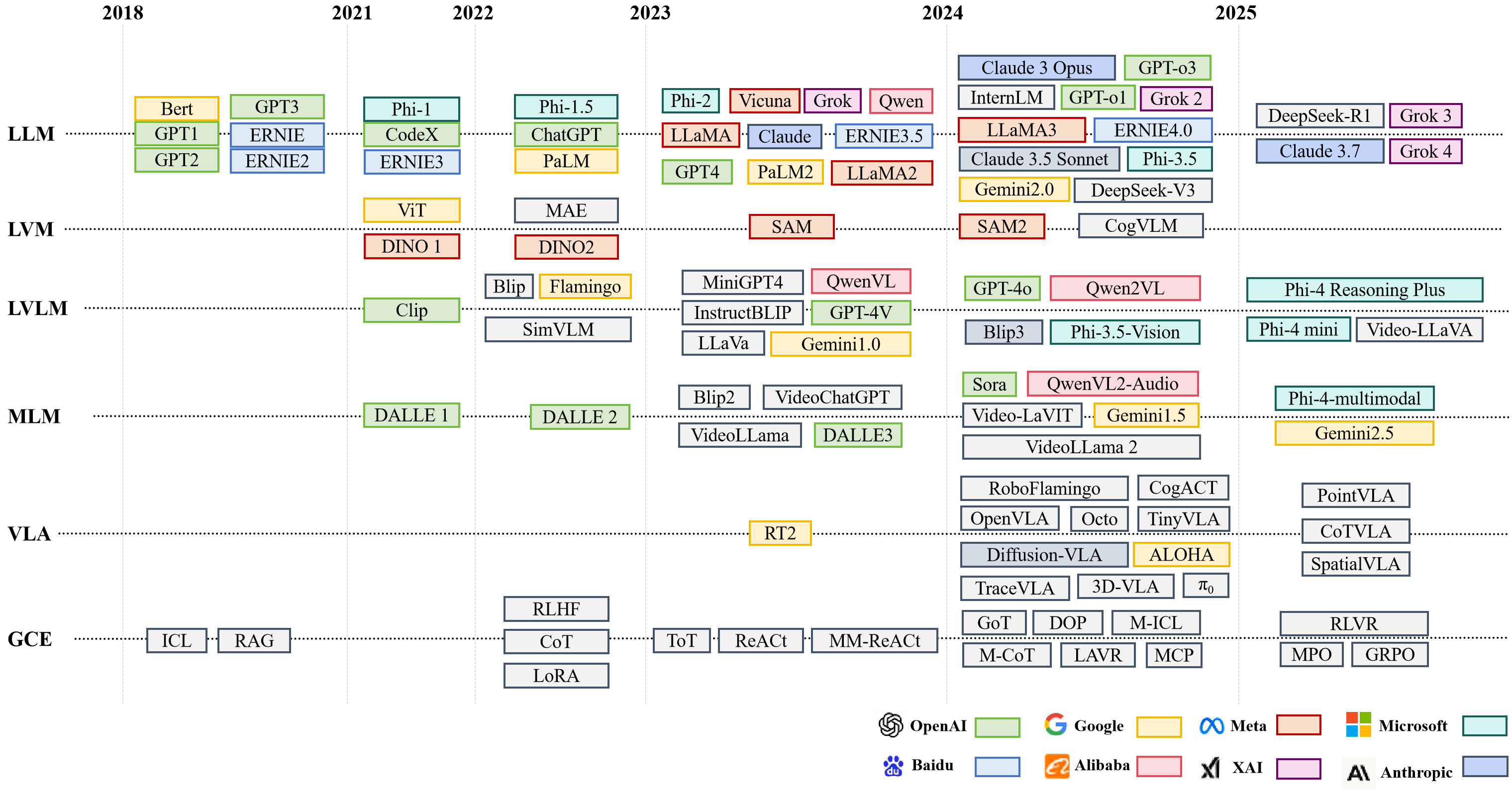

具身智能旨在开发具有物理形态的智能系统,使其能够在真实环境中感知、决策、行动和学习,为实现通用人工智能(AGI)提供了一种有前景的途径。尽管经过数十年的探索,具身智能体在开放动态环境中完成通用任务并达到人类水平的智能仍然具有挑战性。近年来,大型模型的突破性进展通过增强感知、交互、规划和学习,彻底改变了具身智能。本文对大模型赋能的具身智能进行了全面综述,重点关注自主决策和具身学习。我们研究了分层和端到端决策范式,详细介绍了大模型如何增强分层决策的高层规划、低层执行和反馈,以及大模型如何增强视觉-语言-动作(VLA)模型以实现端到端决策。对于具身学习,我们介绍了主流的学习方法,并深入阐述了大模型如何增强模仿学习和强化学习。我们首次将世界模型纳入具身智能的综述中,介绍了它们的设计方法以及在增强决策和学习中的关键作用。尽管已经取得了坚实的进展,但仍然存在挑战,本文在最后讨论了这些挑战,并将其作为未来的研究方向。

🔬 方法详解

问题定义:具身智能旨在使智能体在真实环境中进行感知、决策、行动和学习,但现有方法难以在复杂、动态的环境中实现通用任务的人类水平智能。痛点在于智能体难以有效地进行高层规划、低层执行以及从经验中学习,从而导致泛化能力不足。

核心思路:利用大型模型强大的表征学习和泛化能力,增强具身智能体的感知、交互、规划和学习能力。具体而言,通过大型模型提升高层规划的合理性、低层执行的精确性,并改进从环境反馈中学习的效率。同时,引入世界模型来帮助智能体进行预测和规划。

技术框架:论文考察了两种主要的决策范式:分层决策和端到端决策。分层决策框架通常包含高层规划器、低层执行器和反馈机制,大型模型可以增强这些模块的功能。端到端决策框架则依赖于视觉-语言-动作(VLA)模型,大型模型可以提升VLA模型的性能。此外,论文还讨论了模仿学习和强化学习等主流学习方法,以及世界模型在具身智能中的应用。

关键创新:该综述的关键创新在于系统性地总结了大模型在具身智能中的应用,并首次将世界模型纳入具身智能的综述中。与现有综述相比,本文更加关注大模型如何赋能具身智能体的决策制定和学习过程,并深入探讨了不同决策范式和学习方法的优缺点。

关键设计:论文没有提出新的算法或模型,而是在综述的框架下,分析了现有研究中使用的各种大型模型,例如Transformer、BERT、GPT等,以及它们在具身智能任务中的具体应用方式。论文还讨论了如何设计有效的奖励函数、探索策略以及如何利用世界模型进行预测和规划等关键技术细节。

🖼️ 关键图片

📊 实验亮点

该综述总结了大模型在具身智能领域中的最新进展,并指出了现有方法的局限性和未来研究方向。虽然没有提供具体的实验数据,但论文系统地分析了各种方法的优缺点,为研究人员提供了宝贵的参考。例如,论文讨论了如何利用大型语言模型进行高层规划,以及如何利用视觉模型进行环境感知。

🎯 应用场景

该研究对机器人、自动驾驶、智能家居、虚拟助手等领域具有广泛的应用前景。通过大模型赋能,具身智能体能够更好地理解环境、做出决策并执行任务,从而实现更智能、更自主的系统。未来的发展将推动通用人工智能的实现,并为人类生活带来更多便利。

📄 摘要(原文)

Embodied AI aims to develop intelligent systems with physical forms capable of perceiving, decision-making, acting, and learning in real-world environments, providing a promising way to Artificial General Intelligence (AGI). Despite decades of explorations, it remains challenging for embodied agents to achieve human-level intelligence for general-purpose tasks in open dynamic environments. Recent breakthroughs in large models have revolutionized embodied AI by enhancing perception, interaction, planning and learning. In this article, we provide a comprehensive survey on large model empowered embodied AI, focusing on autonomous decision-making and embodied learning. We investigate both hierarchical and end-to-end decision-making paradigms, detailing how large models enhance high-level planning, low-level execution, and feedback for hierarchical decision-making, and how large models enhance Vision-Language-Action (VLA) models for end-to-end decision making. For embodied learning, we introduce mainstream learning methodologies, elaborating on how large models enhance imitation learning and reinforcement learning in-depth. For the first time, we integrate world models into the survey of embodied AI, presenting their design methods and critical roles in enhancing decision-making and learning. Though solid advances have been achieved, challenges still exist, which are discussed at the end of this survey, potentially as the further research directions.