Examining the legibility of humanoid robot arm movements in a pointing task

作者: Andrej Lúčny, Matilde Antonj, Carlo Mazzola, Hana Hornáčková, Ana Farić, Kristína Malinovská, Michal Vavrecka, Igor Farkaš

分类: cs.RO

发布日期: 2025-08-07

备注: Published at ICSR 2025

💡 一句话要点

研究人机交互中人形机器人手臂动作的可读性,提升意图预测准确性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 机器人意图理解 动作可读性 多模态融合 视觉优先 人形机器人 意图预测

📋 核心要点

- 现有机器人动作可读性不足,人类难以准确预测机器人意图,影响人机交互的安全性和效率。

- 通过截断机器人手臂指向动作,并结合注视等线索,研究人类对机器人意图的预测能力。

- 实验结果验证了多模态信息融合的优势,以及视觉信息在机器人意图理解中的重要性。

📝 摘要(中文)

本研究探讨了人机交互中人形机器人手臂动作的可读性,旨在了解人类如何从截断的动作和身体线索中预测机器人的意图,从而提高人机交互的安全性。我们设计了一个实验,使用NICO人形机器人,让参与者观察其手臂指向触摸屏上目标的动作。机器人线索在不同条件下变化:注视、指向、以及具有一致或不一致注视的指向。手臂轨迹在完整长度的60%或80%处停止,参与者预测最终目标。实验结果支持了多模态优势和视觉优先假设。

🔬 方法详解

问题定义:论文旨在解决人机交互中,人类难以准确理解和预测人形机器人手臂动作意图的问题。现有方法通常缺乏对机器人动作可读性的系统研究,导致人机交互效率低下,甚至存在安全隐患。尤其是在动态环境中,快速准确地理解机器人的意图至关重要。

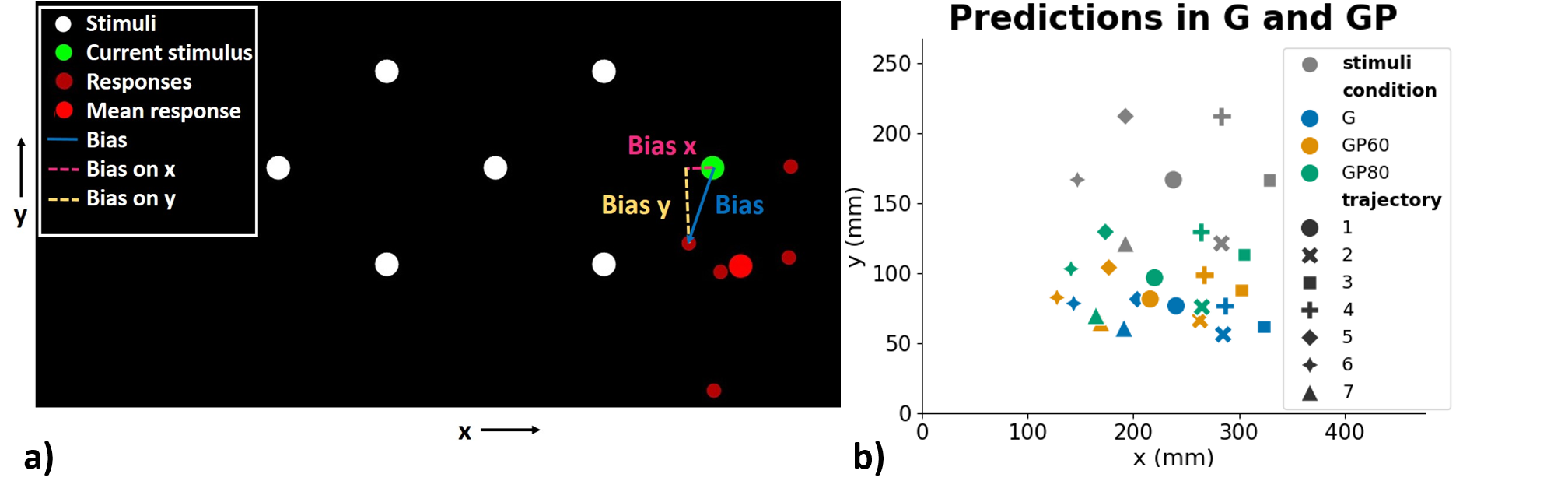

核心思路:论文的核心思路是通过控制机器人手臂动作的完整程度(截断比例)和提供的视觉线索(注视方向),来研究这些因素对人类预测机器人意图的影响。通过分析人类的预测准确率,可以评估不同线索组合下机器人动作的可读性。

技术框架:该研究采用实验方法。首先,使用NICO人形机器人执行指向触摸屏上目标的动作。然后,控制手臂轨迹的截断比例(60%或80%)。同时,操纵机器人的注视方向,使其与指向目标一致或不一致。最后,招募人类参与者观察这些动作,并预测机器人指向的目标。实验收集参与者的预测结果,并进行统计分析。

关键创新:该研究的关键创新在于系统地研究了手臂动作截断比例和注视方向对机器人意图可读性的影响。通过操纵这些变量,可以量化不同线索对人类意图预测的贡献。此外,该研究验证了多模态优势和视觉优先假设在人机交互中的适用性。

关键设计:实验设计中,关键参数包括手臂轨迹的截断比例(60%和80%),以及注视方向与指向目标的一致性。通过对比不同条件下的预测准确率,可以评估这些参数对意图可读性的影响。此外,实验还考虑了参与者的个体差异,例如对机器人的熟悉程度等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,当机器人提供更多线索(例如,指向和一致的注视)时,人类预测机器人意图的准确性更高,验证了多模态优势。此外,即使在手臂动作不完整的情况下,注视方向仍然是预测机器人意图的关键因素,支持了视觉优先假设。具体性能数据未知,但研究强调了线索组合对意图预测的重要性。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如工业机器人、服务机器人和医疗机器人。通过优化机器人动作的可读性,可以提高人机交互的效率和安全性,减少误解和意外事故的发生。未来,可以进一步研究更复杂的机器人动作和环境因素,以提升人机协作的智能化水平。

📄 摘要(原文)

Human--robot interaction requires robots whose actions are legible, allowing humans to interpret, predict, and feel safe around them. This study investigates the legibility of humanoid robot arm movements in a pointing task, aiming to understand how humans predict robot intentions from truncated movements and bodily cues. We designed an experiment using the NICO humanoid robot, where participants observed its arm movements towards targets on a touchscreen. Robot cues varied across conditions: gaze, pointing, and pointing with congruent or incongruent gaze. Arm trajectories were stopped at 60\% or 80\% of their full length, and participants predicted the final target. We tested the multimodal superiority and ocular primacy hypotheses, both of which were supported by the experiment.