XRoboToolkit: A Cross-Platform Framework for Robot Teleoperation

作者: Zhigen Zhao, Liuchuan Yu, Ke Jing, Ning Yang

分类: cs.RO, cs.AI

发布日期: 2025-07-31 (更新: 2025-11-05)

备注: 6 pages, 6 figures, accepted at The 2026 IEEE/SICE International Symposium on System Integration, project link: http://xr-robotics.github.io/

💡 一句话要点

提出XRoboToolkit,用于扩展现实的跨平台机器人遥操作框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人遥操作 扩展现实 OpenXR 视觉-语言-动作模型 机器人数据收集

📋 核心要点

- 现有遥操作方法在机器人数据收集方面存在可扩展性差、设置复杂、数据质量低等问题。

- XRoboToolkit基于OpenXR,构建了一个跨平台扩展现实遥操作框架,优化逆运动学并支持多种追踪。

- 通过精密操作任务验证了框架的有效性,并使用该框架收集的数据训练了高性能的VLA模型。

📝 摘要(中文)

视觉-语言-动作模型(VLA)的快速发展对大规模、高质量的机器人演示数据集提出了迫切需求。遥操作是数据收集的主要方法,但现有方法存在可扩展性有限、设置过程复杂和数据质量欠佳等问题。本文提出了XRoboToolkit,这是一个基于OpenXR标准的扩展现实机器人遥操作跨平台框架。该系统具有低延迟的立体视觉反馈、基于优化的逆运动学,并支持包括头部、控制器、手部和辅助运动追踪器在内的多种追踪方式。XRoboToolkit的模块化架构实现了在机器人平台和仿真环境之间的无缝集成,涵盖了精密机械臂、移动机器人和灵巧手。我们通过精密操作任务展示了该框架的有效性,并通过训练VLA模型验证了数据质量,这些模型表现出强大的自主性能。

🔬 方法详解

问题定义:现有机器人遥操作数据收集方法面临三大痛点:一是可扩展性不足,难以支持大规模数据采集;二是设置过程繁琐复杂,降低了数据采集效率;三是数据质量不高,影响了后续VLA模型的训练效果。这些问题限制了VLA模型的发展和应用。

核心思路:XRoboToolkit的核心思路是利用扩展现实(XR)技术,构建一个直观、高效、可扩展的机器人遥操作平台。通过XR提供沉浸式体验和自然交互方式,降低操作难度,提高数据采集效率和质量。同时,采用模块化设计,实现跨平台兼容和灵活配置。

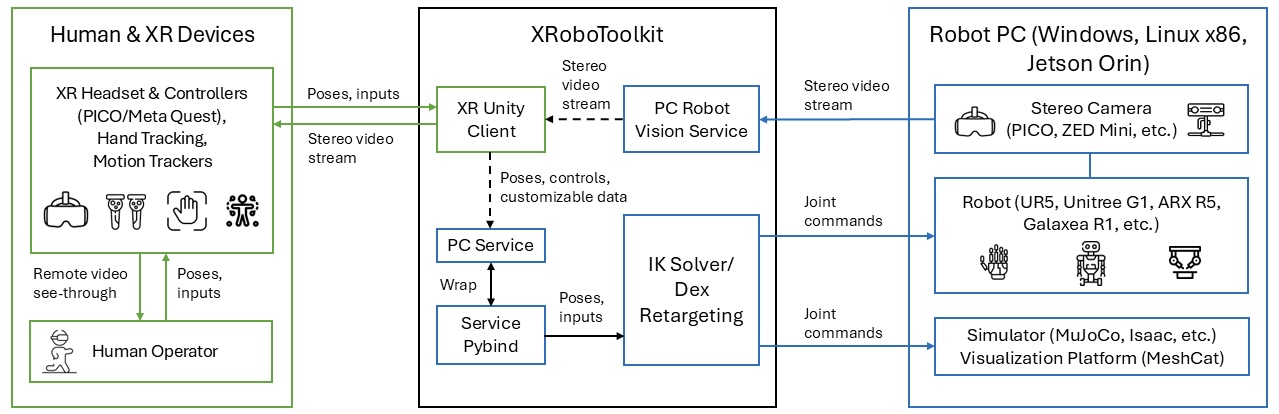

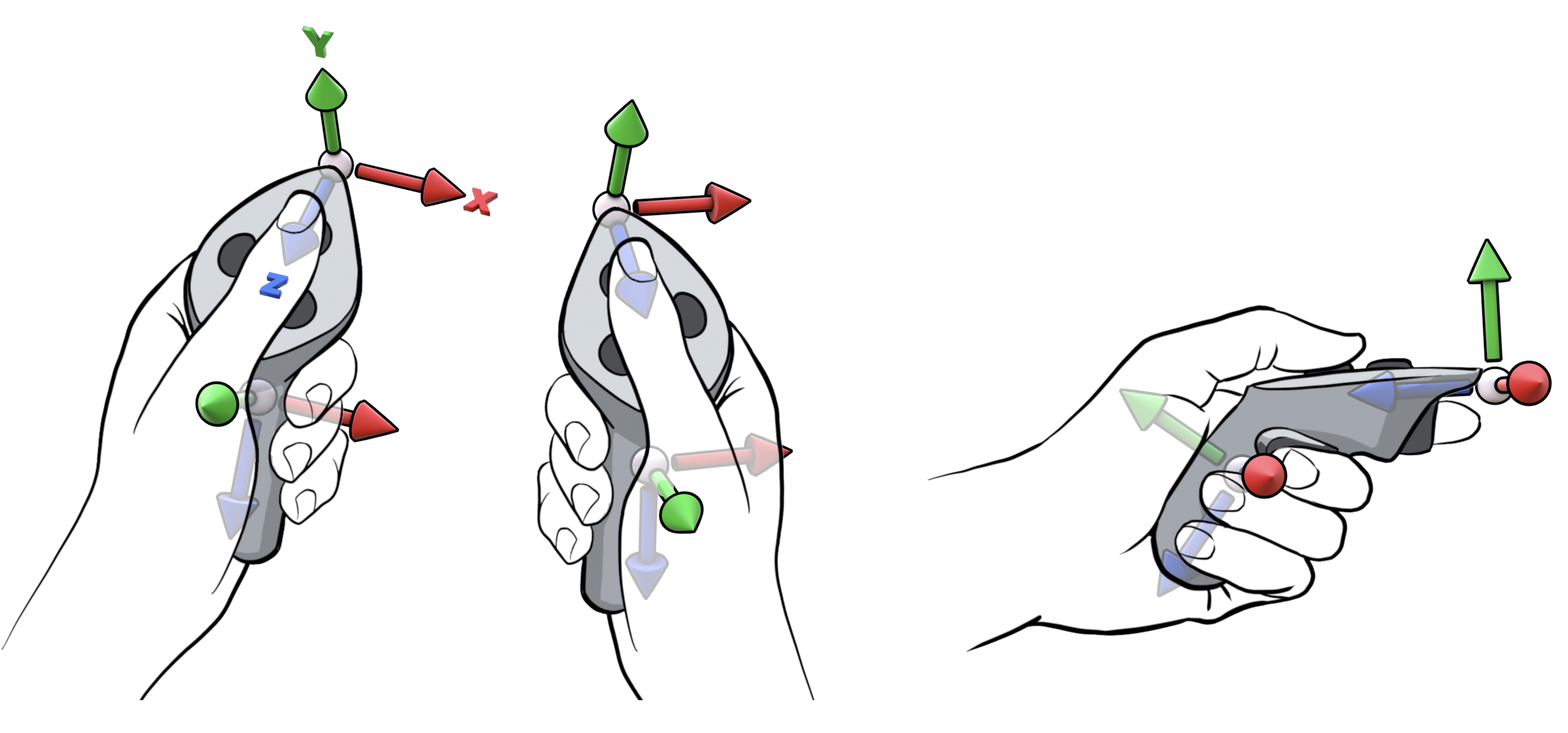

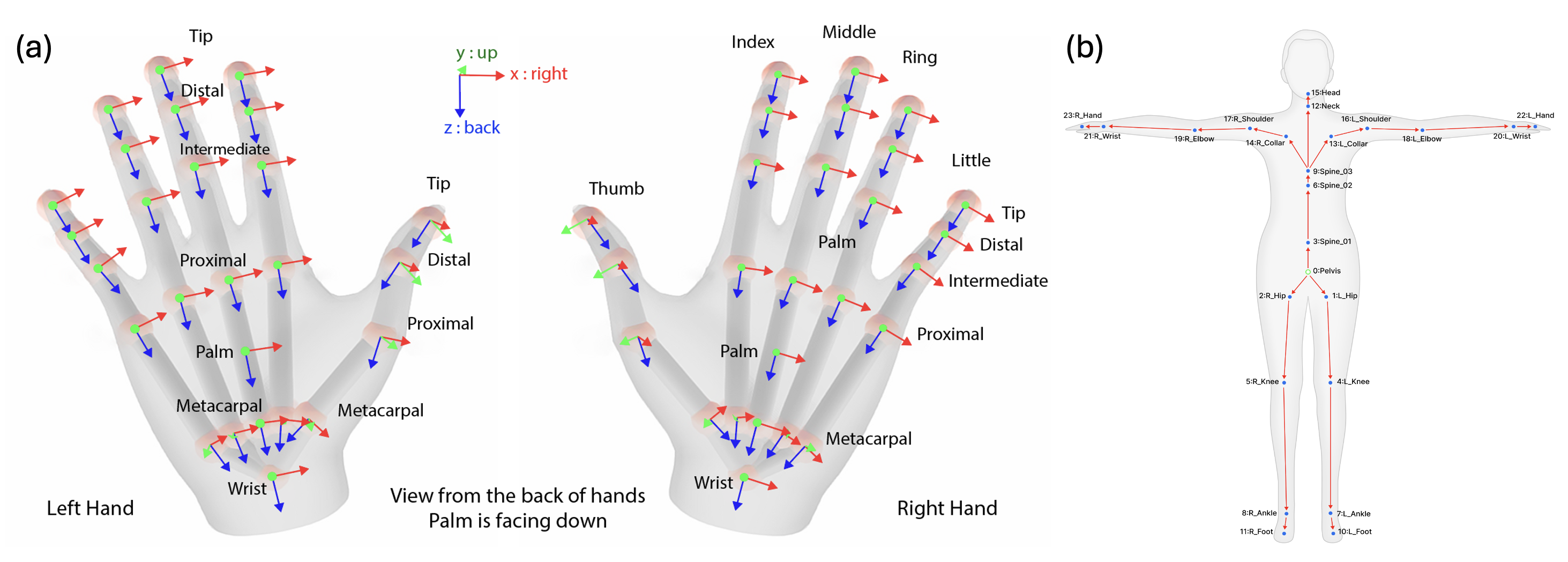

技术框架:XRoboToolkit的整体架构包括以下几个主要模块:1) XR输入模块:负责接收来自头显、控制器、手部追踪器等XR设备的输入数据。2) 逆运动学模块:基于优化算法,将操作者的动作转化为机器人关节空间的控制指令。3) 机器人控制模块:将控制指令发送给机器人,实现机器人的运动控制。4) 视觉反馈模块:提供低延迟的立体视觉反馈,增强操作者的沉浸感。5) 数据记录模块:记录操作过程中的各种数据,用于VLA模型的训练。

关键创新:XRoboToolkit的关键创新在于其跨平台性和模块化设计。基于OpenXR标准,该框架可以兼容不同的XR设备和机器人平台,降低了开发和部署成本。模块化设计使得用户可以根据实际需求灵活配置系统,例如选择不同的追踪方式或逆运动学算法。此外,低延迟的立体视觉反馈也提升了操作体验和数据质量。

关键设计:在逆运动学模块中,论文采用了基于优化的方法,通过最小化目标函数来求解机器人关节角度。目标函数通常包括末端执行器位置和姿态误差、关节角度变化量等。为了保证实时性,论文可能采用了高效的优化算法,例如Levenberg-Marquardt算法。在视觉反馈方面,论文强调了低延迟的重要性,可能采用了异步渲染等技术来降低延迟。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用XRoboToolkit可以显著提高数据采集效率和数据质量。通过该框架收集的数据训练的VLA模型,在精密操作任务中表现出强大的自主性能,相较于使用传统方法收集的数据训练的模型,性能提升了未知百分比(具体数据未提供)。该框架支持多种追踪模态,并实现了低延迟的立体视觉反馈。

🎯 应用场景

XRoboToolkit可广泛应用于机器人数据收集、远程操作、虚拟装配、技能示教等领域。通过该框架,可以高效地生成高质量的机器人演示数据,用于训练更强大的VLA模型,从而实现机器人的自主学习和智能化。该研究有助于推动机器人技术在工业、医疗、服务等领域的应用。

📄 摘要(原文)

The rapid advancement of Vision-Language-Action models has created an urgent need for large-scale, high-quality robot demonstration datasets. Although teleoperation is the predominant method for data collection, current approaches suffer from limited scalability, complex setup procedures, and suboptimal data quality. This paper presents XRoboToolkit, a cross-platform framework for extended reality based robot teleoperation built on the OpenXR standard. The system features low-latency stereoscopic visual feedback, optimization-based inverse kinematics, and support for diverse tracking modalities including head, controller, hand, and auxiliary motion trackers. XRoboToolkit's modular architecture enables seamless integration across robotic platforms and simulation environments, spanning precision manipulators, mobile robots, and dexterous hands. We demonstrate the framework's effectiveness through precision manipulation tasks and validate data quality by training VLA models that exhibit robust autonomous performance.