H-RDT: Human Manipulation Enhanced Bimanual Robotic Manipulation

作者: Hongzhe Bi, Lingxuan Wu, Tianwei Lin, Hengkai Tan, Zhizhong Su, Hang Su, Jun Zhu

分类: cs.RO, cs.CV, cs.LG

发布日期: 2025-07-31 (更新: 2025-08-01)

💡 一句话要点

H-RDT:利用人类操作数据增强双臂机器人操作能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 模仿学习 扩散模型 Transformer 人类数据 双臂机器人 Flow Matching

📋 核心要点

- 机器人模仿学习面临高质量、大规模演示数据稀缺的挑战,现有方法难以有效利用跨形态机器人数据。

- H-RDT利用大规模人类操作视频数据学习行为先验,通过预训练和跨形态微调,提升机器人操作策略。

- 实验表明,H-RDT在仿真和真实环境中均显著优于现有方法,验证了人类数据对机器人学习的有效性。

📝 摘要(中文)

针对机器人操作模仿学习中大规模高质量演示数据匮乏的挑战,本文提出了一种新方法H-RDT(Human to Robotics Diffusion Transformer),利用人类操作数据来增强机器人操作能力。核心思想是,大规模的以人为中心的操纵视频及其配对的3D手部姿态标注提供了丰富的行为先验,能够捕捉自然的操作策略,并有益于机器人策略学习。H-RDT采用两阶段训练范式:(1) 在大规模以人为中心的人类操作数据上进行预训练;(2) 在特定机器人数据上进行跨形态微调,使用模块化的动作编码器和解码器。H-RDT基于一个具有20亿参数的扩散Transformer架构,使用Flow Matching来建模复杂的动作分布。广泛的仿真和真实世界实验,包括单任务和多任务场景,以及少样本学习和鲁棒性评估,表明H-RDT优于从头开始训练和现有的最先进方法,包括Pi0和RDT,在仿真和真实世界实验中分别实现了13.9%和40.5%的显著改进。结果验证了人类操作数据可以作为学习双臂机器人操作策略的强大基础。

🔬 方法详解

问题定义:机器人操作的模仿学习需要大量高质量的演示数据,但获取这些数据成本高昂。现有的方法尝试利用跨形态的机器人数据集进行预训练,但由于不同机器人形态和动作空间的差异,统一训练面临挑战,导致性能提升有限。

核心思路:本文的核心思路是利用大规模的人类操作数据作为机器人策略学习的基础。人类操作视频包含丰富的操作策略和行为先验,可以有效地指导机器人学习。通过将人类操作数据作为预训练数据,可以使机器人模型学习到通用的操作技能,从而提高其在特定机器人任务上的性能。

技术框架:H-RDT采用两阶段训练框架。第一阶段,在大型以人为中心的人类操作数据集上预训练一个扩散Transformer模型,学习人类操作的通用行为模式。第二阶段,在特定机器人的数据集上进行微调,使用模块化的动作编码器和解码器来适应不同的机器人形态和动作空间。该框架利用Flow Matching来建模复杂的动作分布,从而提高模型的生成能力。

关键创新:H-RDT的关键创新在于利用人类操作数据作为机器人策略学习的强大先验知识。与以往主要依赖机器人数据的方法不同,H-RDT通过引入人类数据,显著提高了模型的泛化能力和学习效率。此外,模块化的动作编码器和解码器设计使得模型能够更好地适应不同的机器人形态。

关键设计:H-RDT使用一个具有20亿参数的扩散Transformer架构。在预训练阶段,模型学习从噪声分布生成人类操作动作序列。在微调阶段,模型使用机器人数据进行微调,并采用Flow Matching损失函数来优化动作分布的建模。模块化的动作编码器和解码器允许模型处理不同机器人的动作空间,并使用特定于机器人的参数进行微调。

🖼️ 关键图片

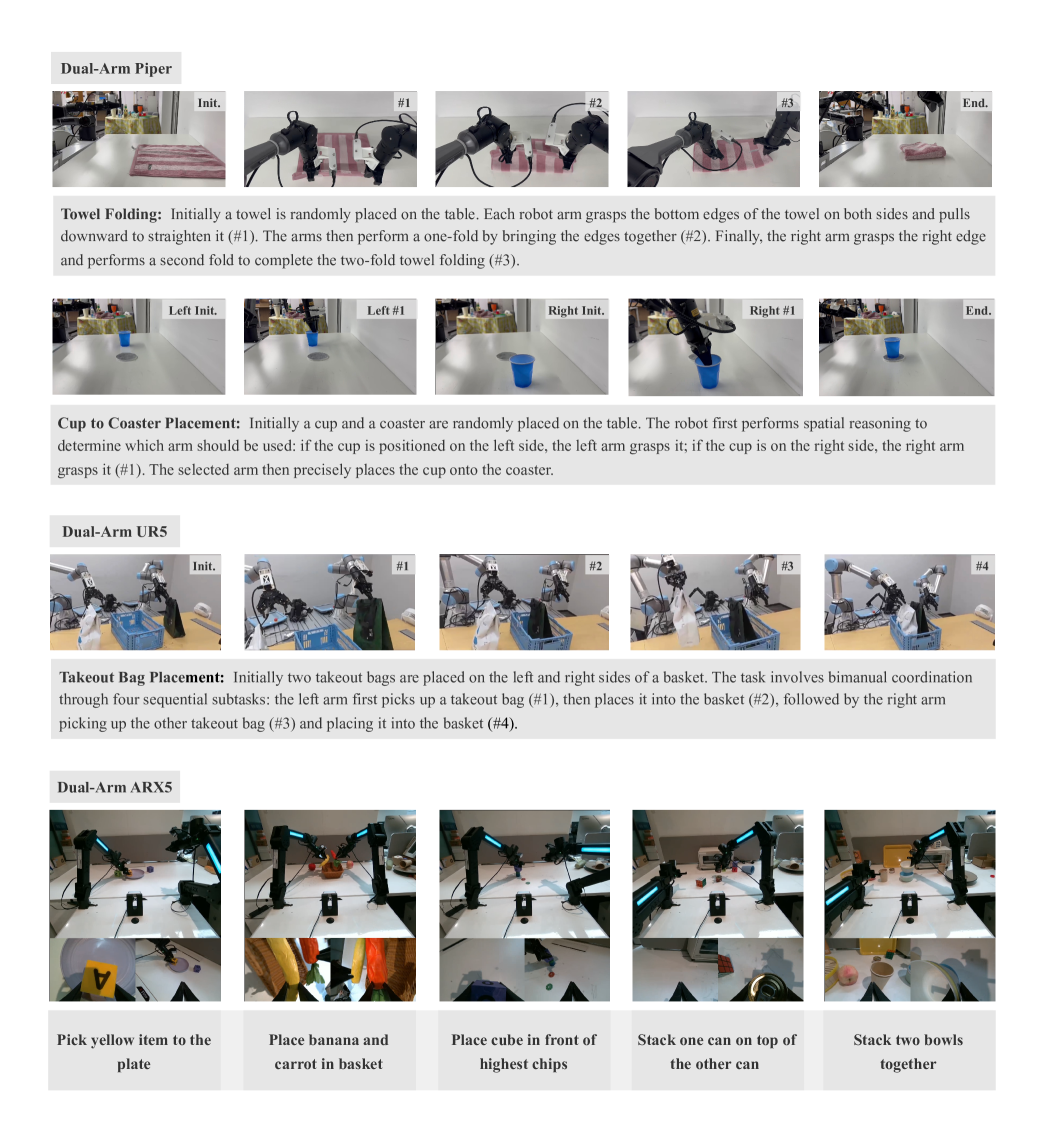

📊 实验亮点

H-RDT在仿真和真实世界的双臂操作任务中取得了显著的性能提升。在仿真实验中,H-RDT比从头开始训练的模型提高了13.9%。在真实世界实验中,H-RDT比从头开始训练的模型提高了40.5%,并且优于现有的最先进方法Pi0和RDT,验证了该方法的有效性。

🎯 应用场景

H-RDT具有广泛的应用前景,可用于提升各种机器人的操作能力,例如家庭服务机器人、工业机器人和医疗机器人。该方法能够降低机器人部署的成本,提高其在复杂环境中的适应性和鲁棒性,从而促进机器人技术的普及和应用。

📄 摘要(原文)

Imitation learning for robotic manipulation faces a fundamental challenge: the scarcity of large-scale, high-quality robot demonstration data. Recent robotic foundation models often pre-train on cross-embodiment robot datasets to increase data scale, while they face significant limitations as the diverse morphologies and action spaces across different robot embodiments make unified training challenging. In this paper, we present H-RDT (Human to Robotics Diffusion Transformer), a novel approach that leverages human manipulation data to enhance robot manipulation capabilities. Our key insight is that large-scale egocentric human manipulation videos with paired 3D hand pose annotations provide rich behavioral priors that capture natural manipulation strategies and can benefit robotic policy learning. We introduce a two-stage training paradigm: (1) pre-training on large-scale egocentric human manipulation data, and (2) cross-embodiment fine-tuning on robot-specific data with modular action encoders and decoders. Built on a diffusion transformer architecture with 2B parameters, H-RDT uses flow matching to model complex action distributions. Extensive evaluations encompassing both simulation and real-world experiments, single-task and multitask scenarios, as well as few-shot learning and robustness assessments, demonstrate that H-RDT outperforms training from scratch and existing state-of-the-art methods, including Pi0 and RDT, achieving significant improvements of 13.9% and 40.5% over training from scratch in simulation and real-world experiments, respectively. The results validate our core hypothesis that human manipulation data can serve as a powerful foundation for learning bimanual robotic manipulation policies.