Learning Physical Interaction Skills from Human Demonstrations

作者: Tianyu Li, Hengbo Ma, Sehoon Ha, Kwonjoon Lee

分类: cs.RO

发布日期: 2025-07-28 (更新: 2025-08-03)

💡 一句话要点

提出基于嵌入交互图(EIG)的BuddyImitation框架,解决形态各异的智能体学习人机交互技能问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人机交互 模仿学习 强化学习 跨形态学习 嵌入交互图 机器人控制 物理仿真

📋 核心要点

- 现有方法在学习人机交互技能时,依赖手工设计目标或要求智能体形态相似,泛化能力受限。

- BuddyImitation框架通过嵌入交互图(EIG)提取交互动力学,实现跨形态智能体的全身交互行为学习。

- 实验表明,该框架能使不同形态的智能体在多种交互场景中生成语义合理且物理可行的动作。

📝 摘要(中文)

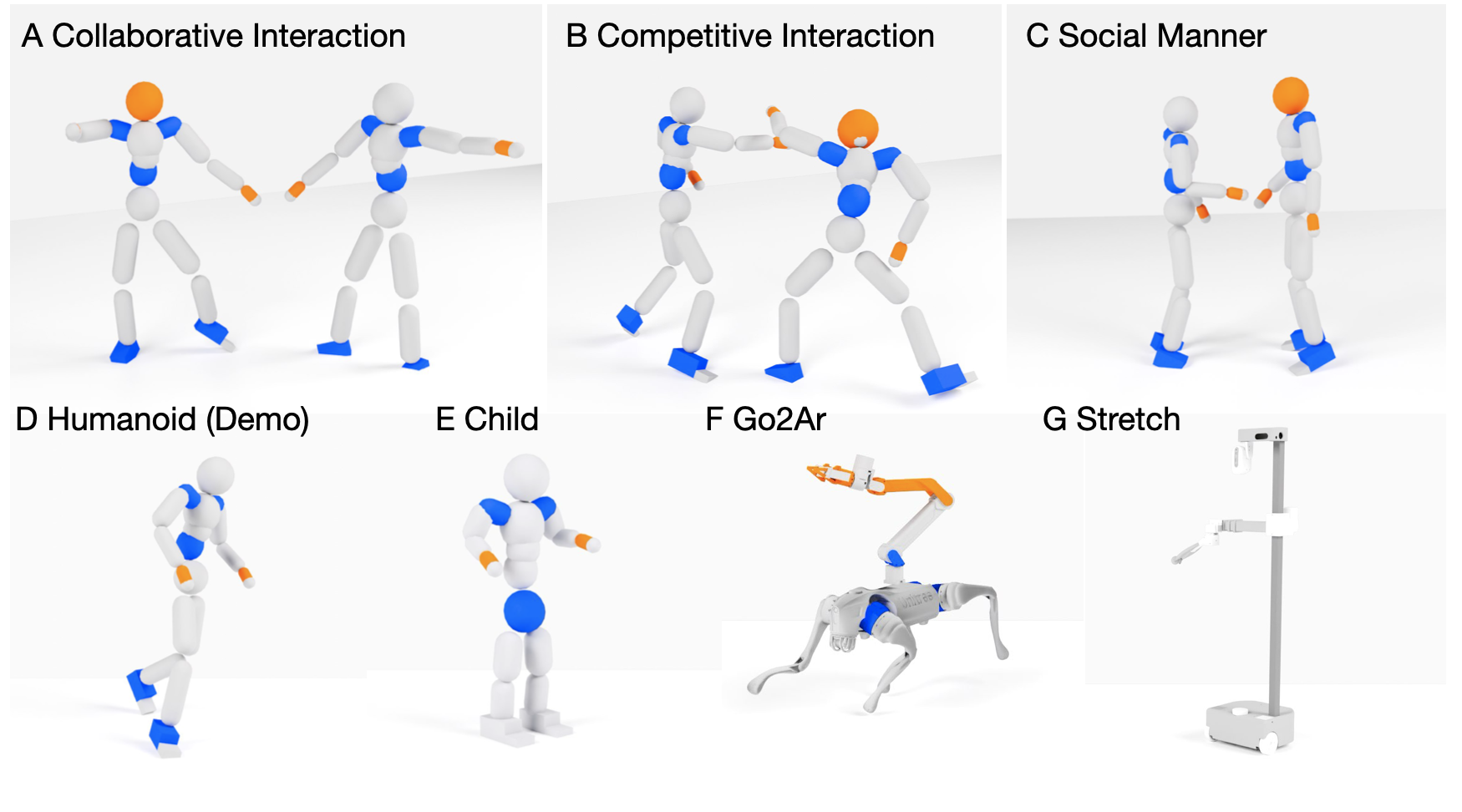

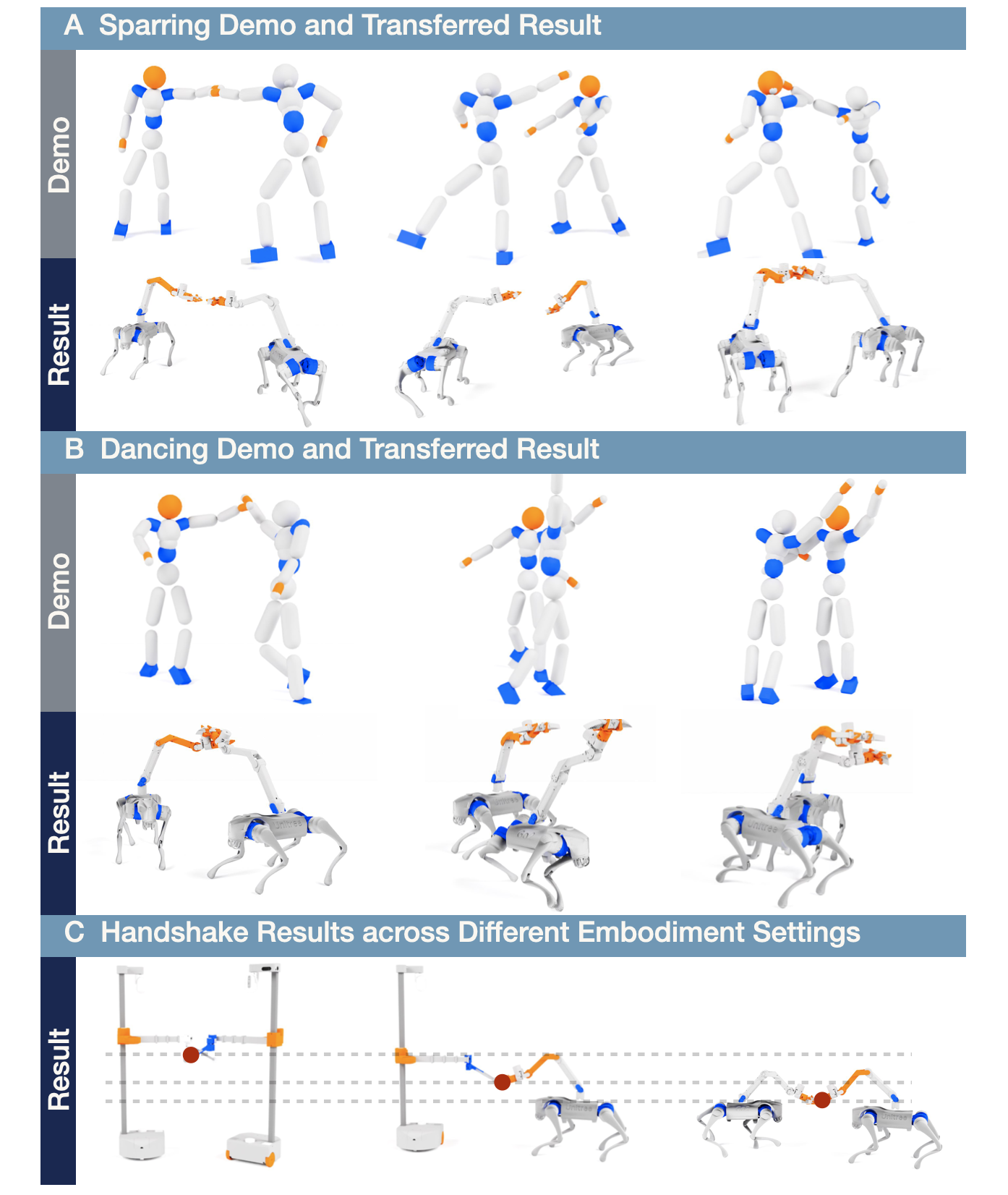

学习物理交互技能,如跳舞、握手或格斗,对于在人类环境中运行的智能体来说仍然是一个根本性的挑战,特别是当智能体的形态与演示者显著不同时。现有的方法通常依赖于手工设计的优化目标或形态相似性,限制了它们的泛化能力。本文介绍了一个框架,使具有不同形态的智能体能够直接从人类演示中学习全身交互行为。该框架提取了一种紧凑的、可转移的交互动力学表示,称为嵌入交互图(EIG),它捕捉了交互智能体之间关键的时空关系。然后,该图被用作模仿目标,以训练基于物理仿真的控制策略,使智能体能够生成在语义上有意义且在物理上可行的运动。我们在多个人物(如人类、带机械臂的四足机器人或移动机械臂)和各种交互场景(包括格斗、握手、石头剪刀布或跳舞)上演示了BuddyImitation。我们的结果展示了一条通过跨形态交互学习实现形态各异的角色之间协调行为的有希望的途径。

🔬 方法详解

问题定义:现有方法在学习人机交互技能时,面临着智能体形态各异和泛化能力不足的挑战。传统方法依赖于手工设计的奖励函数,难以捕捉复杂交互的本质。此外,对智能体形态的限制也阻碍了其在更广泛场景中的应用。

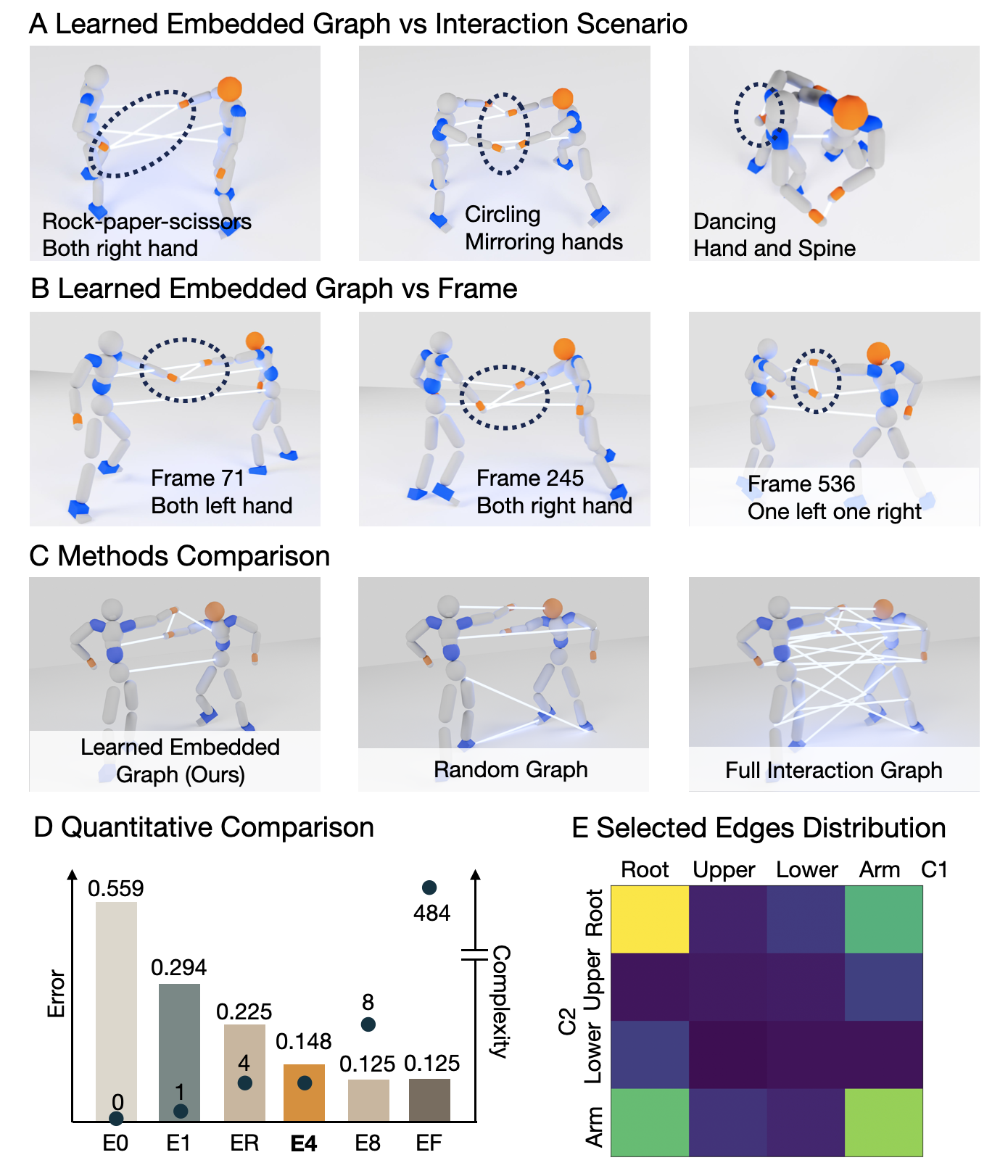

核心思路:本文的核心思路是通过学习一种通用的交互动力学表示,即嵌入交互图(EIG),来实现跨形态智能体的交互行为模仿。EIG能够捕捉交互智能体之间的时空关系,从而将人类的交互知识迁移到具有不同形态的智能体上。

技术框架:BuddyImitation框架主要包含两个阶段:1) 从人类演示中提取EIG;2) 使用EIG作为模仿目标,在物理仿真环境中训练智能体的控制策略。首先,利用运动捕捉数据构建人类交互的EIG。然后,将EIG作为奖励函数的一部分,训练智能体的强化学习策略,使其能够模仿人类的交互行为。

关键创新:该方法最重要的创新在于提出了嵌入交互图(EIG)这一概念,它能够以紧凑且可转移的方式表示交互动力学。与传统方法相比,EIG不依赖于智能体的具体形态,从而实现了跨形态的交互行为学习。

关键设计:EIG的构建涉及关键点的选择和时空关系的建模。关键点通常选择人体或机器人上的重要关节。时空关系则通过计算关键点之间的相对位置和速度来表示。在训练过程中,使用模仿损失函数来鼓励智能体的运动与EIG中的关系相匹配。此外,还使用了正则化项来保证运动的平滑性和物理可行性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BuddyImitation框架能够成功地使不同形态的智能体(包括四足机器人和移动机械臂)学习到多种人机交互技能,如格斗、握手、石头剪刀布和跳舞。与基线方法相比,该框架能够生成更自然、更协调的交互动作,并且具有更好的泛化能力。

🎯 应用场景

该研究成果可应用于机器人辅助康复、人机协作制造、虚拟现实互动游戏等领域。通过学习人类的交互技能,机器人能够更好地与人类进行协作,提高工作效率和安全性。此外,该技术还可以用于创建更逼真、更具沉浸感的虚拟现实体验。

📄 摘要(原文)

Learning physical interaction skills, such as dancing, handshaking, or sparring, remains a fundamental challenge for agents operating in human environments, particularly when the agent's morphology differs significantly from that of the demonstrator. Existing approaches often rely on handcrafted objectives or morphological similarity, limiting their capacity for generalization. Here, we introduce a framework that enables agents with diverse embodiments to learn wholebbody interaction behaviors directly from human demonstrations. The framework extracts a compact, transferable representation of interaction dynamics, called the Embedded Interaction Graph (EIG), which captures key spatiotemporal relationships between the interacting agents. This graph is then used as an imitation objective to train control policies in physics-based simulations, allowing the agent to generate motions that are both semantically meaningful and physically feasible. We demonstrate BuddyImitation on multiple agents, such as humans, quadrupedal robots with manipulators, or mobile manipulators and various interaction scenarios, including sparring, handshaking, rock-paper-scissors, or dancing. Our results demonstrate a promising path toward coordinated behaviors across morphologically distinct characters via cross embodiment interaction learning.