Humanoid Occupancy: Enabling A Generalized Multimodal Occupancy Perception System on Humanoid Robots

作者: Wei Cui, Haoyu Wang, Wenkang Qin, Yijie Guo, Gang Han, Wen Zhao, Jiahang Cao, Zhang Zhang, Jiaru Zhong, Jingkai Sun, Pihai Sun, Shuai Shi, Botuo Jiang, Jiahao Ma, Jiaxu Wang, Hao Cheng, Zhichao Liu, Yang Wang, Zheng Zhu, Guan Huang, Jian Tang, Qiang Zhang

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-07-27 (更新: 2025-07-29)

备注: Tech Report

💡 一句话要点

提出Humanoid Occupancy,为人形机器人构建通用多模态环境感知系统。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人形机器人 占据感知 多模态融合 环境理解 数据集

📋 核心要点

- 现有视觉感知模块异构且针对特定场景,缺乏通用性,难以满足人形机器人复杂环境理解的需求。

- Humanoid Occupancy通过多模态融合和占据表示,提供包含语义和3D几何信息的环境理解,支持下游任务。

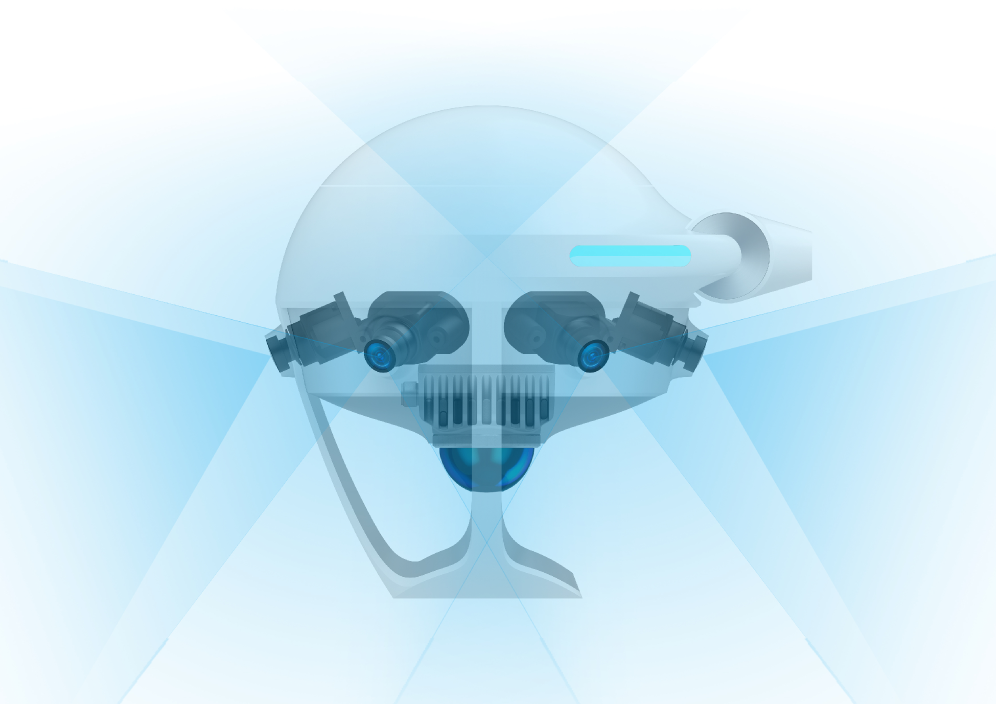

- 构建了首个专为人形机器人的全景占据数据集,并设计传感器布局策略,解决运动学干涉和遮挡问题。

📝 摘要(中文)

本文提出Humanoid Occupancy,一个通用多模态占据感知系统,专为人形机器人设计。该系统集成了硬件、软件、数据采集设备和专用标注流程。通过先进的多模态融合技术,系统生成基于网格的占据输出,编码占据状态和语义标签,从而实现对环境的全面理解,支持下游任务如任务规划和导航。针对人形机器人的独特挑战,如运动学干涉和遮挡,本文提出有效的传感器布局策略。此外,本文构建了首个专为人形机器人设计的全景占据数据集,为该领域的研究提供宝贵的基准和资源。网络架构融合了多模态特征和时间信息,确保感知的鲁棒性。Humanoid Occupancy为人形机器人提供有效的环境感知,并为标准化通用视觉模块奠定技术基础,为人形机器人在复杂现实场景中的广泛部署铺平道路。

🔬 方法详解

问题定义:现有的人形机器人视觉感知系统通常是为特定任务和场景定制的,缺乏通用性和可扩展性。不同制造商提供的视觉模块异构,难以集成和标准化。此外,人形机器人自身的结构特点,如运动学干涉和遮挡,也给环境感知带来了额外的挑战。因此,需要一个通用的、多模态的、鲁棒的感知系统,能够为人形机器人提供全面的环境理解。

核心思路:Humanoid Occupancy的核心思路是利用占据表示(Occupancy Representation)来统一表达环境信息。占据表示能够同时编码环境的几何信息(3D空间中的占据状态)和语义信息(物体的类别标签),从而为下游任务提供丰富的环境上下文。此外,通过多模态传感器融合,可以克服单一传感器的局限性,提高感知的鲁棒性和准确性。

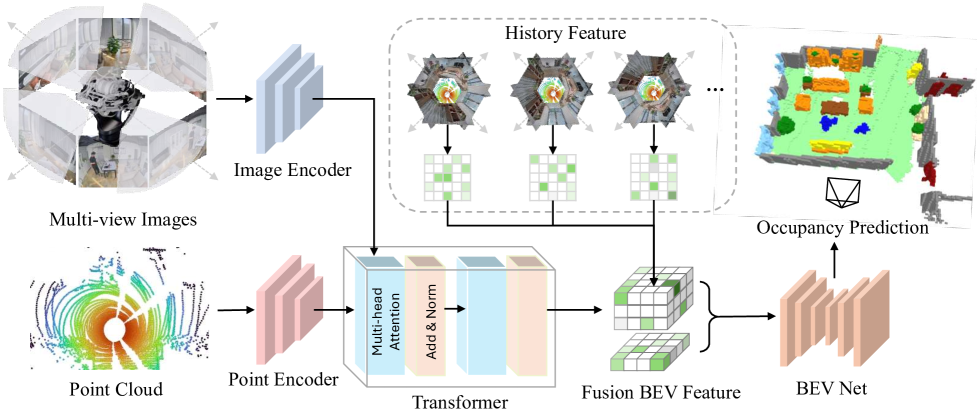

技术框架:Humanoid Occupancy系统包含以下几个主要模块:1) 数据采集模块:利用多种传感器(如RGB相机、深度相机、激光雷达等)采集环境数据。2) 数据预处理模块:对采集到的数据进行校准、滤波、去噪等预处理操作。3) 多模态特征提取模块:从不同模态的数据中提取特征,例如使用卷积神经网络从图像中提取视觉特征,使用点云处理算法从激光雷达数据中提取几何特征。4) 多模态特征融合模块:将不同模态的特征进行融合,例如使用注意力机制或Transformer结构来学习不同模态特征之间的关系。5) 占据预测模块:根据融合后的特征预测每个网格单元的占据状态和语义标签。6) 时间信息融合模块:利用循环神经网络或Transformer结构来整合时间序列上的信息,提高感知的稳定性。

关键创新:Humanoid Occupancy的关键创新点在于:1) 提出了一个通用的多模态占据感知系统,能够为人形机器人提供全面的环境理解。2) 构建了首个专为人形机器人设计的全景占据数据集,为该领域的研究提供了宝贵的资源。3) 设计了有效的传感器布局策略,解决了人形机器人的运动学干涉和遮挡问题。4) 采用了多模态特征融合和时间信息整合技术,提高了感知的鲁棒性和准确性。

关键设计:在多模态特征融合方面,可能采用了基于注意力机制的融合方法,允许网络学习不同模态特征的重要性。在占据预测模块,可能使用了3D卷积神经网络或体素化的方法来预测每个网格单元的占据状态和语义标签。损失函数可能包括二元交叉熵损失(用于占据预测)和交叉熵损失(用于语义标签预测)。时间信息融合可能使用了GRU或LSTM等循环神经网络结构。

🖼️ 关键图片

📊 实验亮点

论文构建了首个专为人形机器人的全景占据数据集,为该领域的研究提供了宝贵的基准和资源。实验结果表明,Humanoid Occupancy能够有效地感知环境,并为人形机器人提供准确的占据状态和语义标签。具体的性能数据(如占据预测的准确率、语义分割的mIoU等)和对比基线(如基于单模态数据的感知系统)的提升幅度需要在论文中查找。

🎯 应用场景

Humanoid Occupancy可广泛应用于人形机器人的各种应用场景,如家庭服务、医疗护理、工业制造、灾难救援等。该系统能够为人形机器人提供全面的环境理解,支持其进行任务规划、导航、物体识别、人机交互等任务。通过标准化通用视觉模块,可以降低人形机器人的开发成本,加速其在复杂现实场景中的部署。

📄 摘要(原文)

Humanoid robot technology is advancing rapidly, with manufacturers introducing diverse heterogeneous visual perception modules tailored to specific scenarios. Among various perception paradigms, occupancy-based representation has become widely recognized as particularly suitable for humanoid robots, as it provides both rich semantic and 3D geometric information essential for comprehensive environmental understanding. In this work, we present Humanoid Occupancy, a generalized multimodal occupancy perception system that integrates hardware and software components, data acquisition devices, and a dedicated annotation pipeline. Our framework employs advanced multi-modal fusion techniques to generate grid-based occupancy outputs encoding both occupancy status and semantic labels, thereby enabling holistic environmental understanding for downstream tasks such as task planning and navigation. To address the unique challenges of humanoid robots, we overcome issues such as kinematic interference and occlusion, and establish an effective sensor layout strategy. Furthermore, we have developed the first panoramic occupancy dataset specifically for humanoid robots, offering a valuable benchmark and resource for future research and development in this domain. The network architecture incorporates multi-modal feature fusion and temporal information integration to ensure robust perception. Overall, Humanoid Occupancy delivers effective environmental perception for humanoid robots and establishes a technical foundation for standardizing universal visual modules, paving the way for the widespread deployment of humanoid robots in complex real-world scenarios.