Foundation Model-Driven Grasping of Unknown Objects via Center of Gravity Estimation

作者: Kang Xiangli, Yage He, Xianwu Gong, Zehan Liu, Yuru Bai

分类: cs.RO

发布日期: 2025-07-25

💡 一句话要点

提出基于扩散模型的重心估计方法,实现对未知物体的稳健抓取

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人抓取 重心估计 扩散模型 未知物体 质量分布不均匀 视觉驱动 基础模型

📋 核心要点

- 现有基于关键点或可供性的抓取方法在处理重心偏移的物体时存在姿态不稳定的问题。

- 利用扩散模型估计物体重心,提出一种重心感知的抓取框架,提升抓取的稳定性和成功率。

- 实验表明,该方法在真实场景中优于传统方法,对未见过的物体具有良好的泛化能力。

📝 摘要(中文)

本研究提出了一种通过扩散模型定位未知物体重心(CoG)的抓取方法,用于解决质量分布不均匀物体的抓取问题。在机器人抓取中,重心偏差常导致姿态不稳定,而现有的基于关键点或基于可供性的方法存在局限性。我们构建了一个包含790张图像的数据集,该数据集包含质量分布不均匀的物体,并标注了用于重心定位的关键点。开发了一个基于基础模型的视觉驱动框架,以实现重心感知的抓取。在真实场景中的实验评估表明,与传统的基于关键点的方法相比,我们的方法成功率提高了49%,与最先进的基于可供性的方法相比,提高了11%。该系统在未见过的物体上表现出强大的泛化能力,重心定位精度达到76%,为精确和稳定的抓取任务提供了一种新的解决方案。

🔬 方法详解

问题定义:论文旨在解决机器人抓取质量分布不均匀的未知物体时,由于重心(CoG)偏移导致的姿态不稳定性问题。现有的基于关键点或可供性的抓取方法难以准确估计重心位置,导致抓取成功率较低,尤其是在处理形状不规则或质量分布不均的物体时表现不佳。

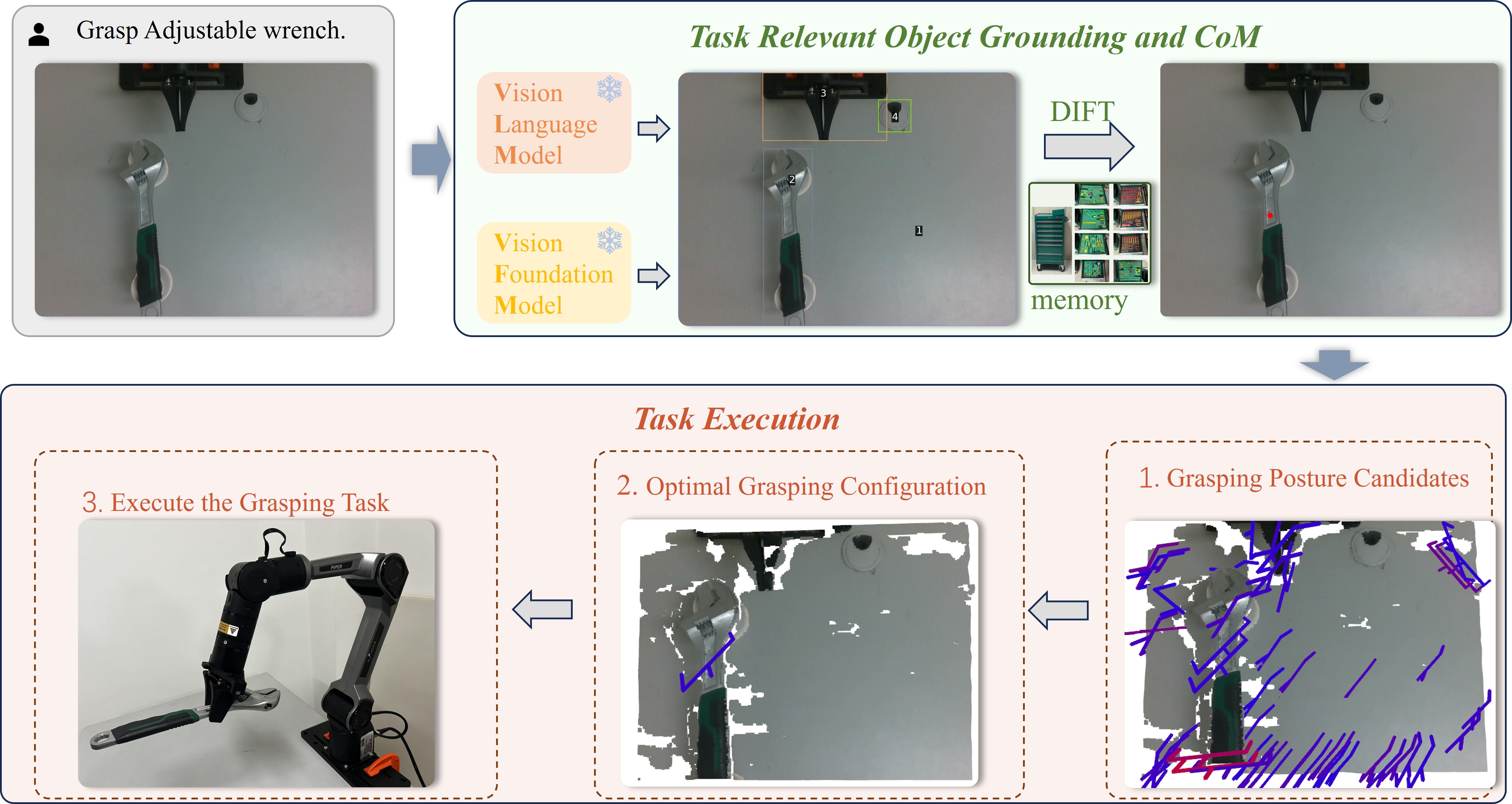

核心思路:论文的核心思路是利用扩散模型学习物体形状和质量分布的先验知识,从而准确估计未知物体的重心位置。通过将重心位置作为抓取的关键信息,引导机器人选择合适的抓取姿态,提高抓取的稳定性和成功率。这种方法避免了直接预测抓取姿态,而是通过中间表示(重心)来间接实现抓取。

技术框架:该方法的技术框架主要包含以下几个阶段:1) 数据集构建:构建包含质量分布不均匀物体的图像数据集,并标注重心位置;2) 扩散模型训练:使用数据集训练扩散模型,使其能够根据物体图像预测重心位置;3) 重心估计:利用训练好的扩散模型估计未知物体的重心位置;4) 抓取规划:根据估计的重心位置,规划合适的抓取姿态;5) 机器人执行:控制机器人执行抓取动作。

关键创新:该方法最重要的技术创新点在于利用扩散模型进行重心估计。与传统的关键点检测方法相比,扩散模型能够更好地捕捉物体形状和质量分布的全局信息,从而更准确地估计重心位置。此外,该方法将重心作为抓取的关键信息,实现了重心感知的抓取,提高了抓取的稳定性和成功率。

关键设计:论文的关键设计包括:1) 数据集的构建,包含多样化的质量分布不均匀的物体;2) 扩散模型的选择和训练,使其能够准确预测重心位置;3) 抓取规划算法的设计,使其能够根据估计的重心位置选择合适的抓取姿态。具体的网络结构和损失函数等技术细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

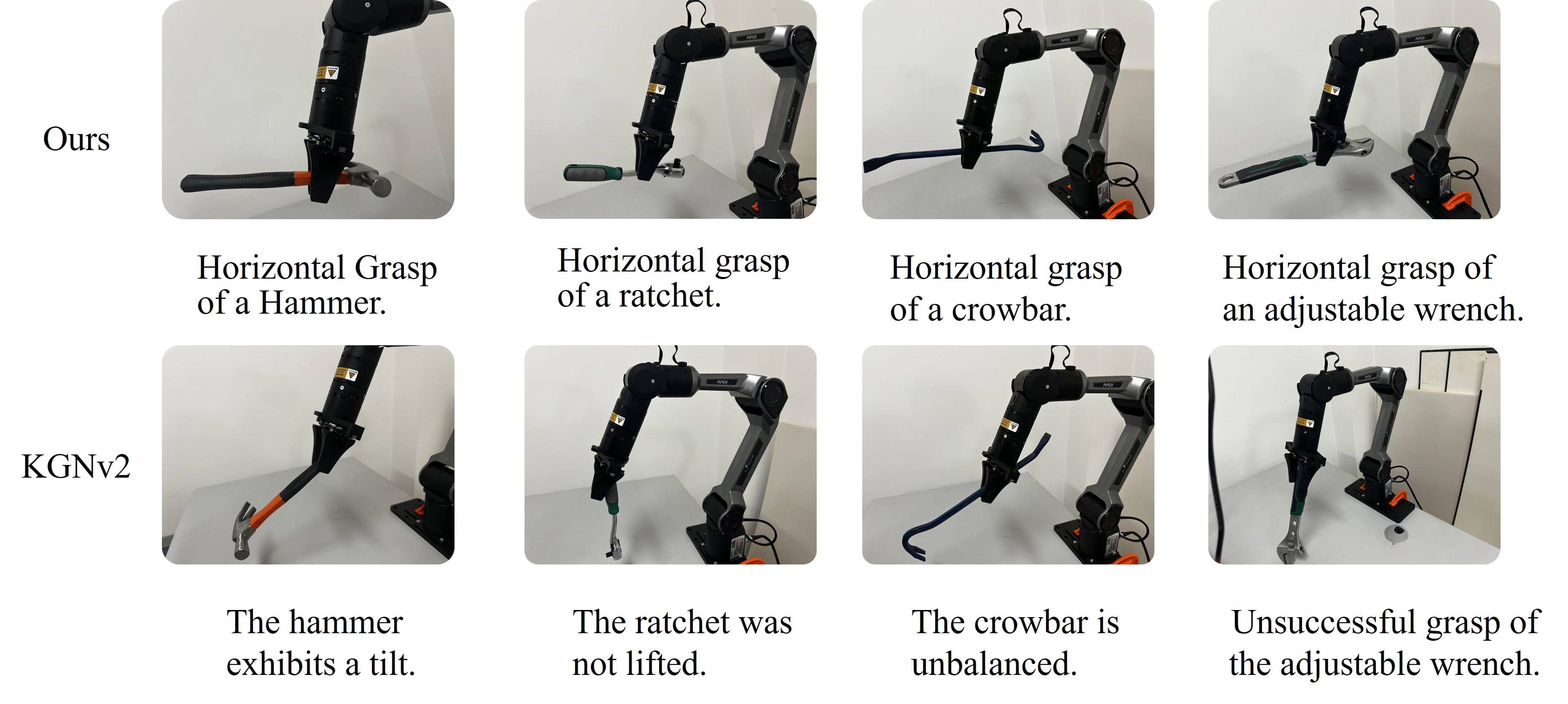

实验结果表明,该方法在真实场景中取得了显著的性能提升。与传统的基于关键点的方法相比,抓取成功率提高了49%,与最先进的基于可供性的方法相比,提高了11%。此外,该方法在未见过的物体上表现出强大的泛化能力,重心定位精度达到76%。这些结果表明,该方法是一种有效且通用的抓取解决方案。

🎯 应用场景

该研究成果可应用于各种需要抓取未知物体的机器人应用场景,例如:智能仓储、自动化生产线、家庭服务机器人等。通过提高抓取的稳定性和成功率,可以显著提升这些应用场景的效率和可靠性。未来,该方法还可以扩展到更复杂的抓取任务,例如:多物体抓取、动态抓取等。

📄 摘要(原文)

This study presents a grasping method for objects with uneven mass distribution by leveraging diffusion models to localize the center of gravity (CoG) on unknown objects. In robotic grasping, CoG deviation often leads to postural instability, where existing keypoint-based or affordance-driven methods exhibit limitations. We constructed a dataset of 790 images featuring unevenly distributed objects with keypoint annotations for CoG localization. A vision-driven framework based on foundation models was developed to achieve CoG-aware grasping. Experimental evaluations across real-world scenarios demonstrate that our method achieves a 49\% higher success rate compared to conventional keypoint-based approaches and an 11\% improvement over state-of-the-art affordance-driven methods. The system exhibits strong generalization with a 76\% CoG localization accuracy on unseen objects, providing a novel solution for precise and stable grasping tasks.