A Fast and Light-weight Non-Iterative Visual Odometry with RGB-D Cameras

作者: Zheng Yang, Kuan Xu, Shenghai Yuan, Lihua Xie

分类: cs.RO

发布日期: 2025-07-25

期刊: Unmanned Systems, 2025, 13(03): 957-969

DOI: 10.1142/S2301385025500591

💡 一句话要点

提出一种快速轻量级的非迭代RGB-D视觉里程计,利用平面重叠特性解耦位姿估计。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: RGB-D视觉里程计 位姿估计 平面特征 核互相关器 非迭代方法

📋 核心要点

- 传统RGB-D视觉里程计依赖迭代优化和特征提取匹配,计算量大,实时性差,难以满足机器人快速运动的需求。

- 该方法解耦旋转和平移估计,利用平面特征计算旋转,核互相关器计算平移,避免了迭代优化和特征处理。

- 实验表明,该方法在低端i5 CPU上达到71Hz,且在低纹理环境中优于现有方法,提升了鲁棒性。

📝 摘要(中文)

本文提出了一种新颖的方法,用于高效估计6自由度(DoF)机器人的位姿。该方法采用解耦的非迭代方式,充分利用场景中重叠的平面元素。传统的RGB-D视觉里程计(RGBD-VO)通常依赖于迭代优化求解器来估计位姿,并且涉及特征提取和匹配过程,导致显著的计算负担和时间延迟。为了解决这个问题,我们创新的RGBD-VO方法将旋转和平移的估计分离。首先,我们利用场景中重叠的平面特征来计算旋转矩阵。然后,我们使用核互相关器(KCC)来确定平移。通过避免资源密集型的迭代优化以及特征提取和对齐过程,我们的方法提供了更高的计算效率,在低端i5 CPU上实现了71Hz的性能。与最先进的方法相比,当RGBD-VO不依赖于特征点时,我们的技术在低纹理退化环境中表现出增强的性能。

🔬 方法详解

问题定义:现有RGB-D视觉里程计方法,特别是基于特征点的方法,通常需要进行特征提取、特征匹配以及迭代优化等步骤,计算复杂度高,难以满足实时性要求,尤其是在计算资源受限的机器人平台上。此外,在低纹理或退化环境中,特征点提取和匹配的准确性会显著下降,导致位姿估计精度降低。

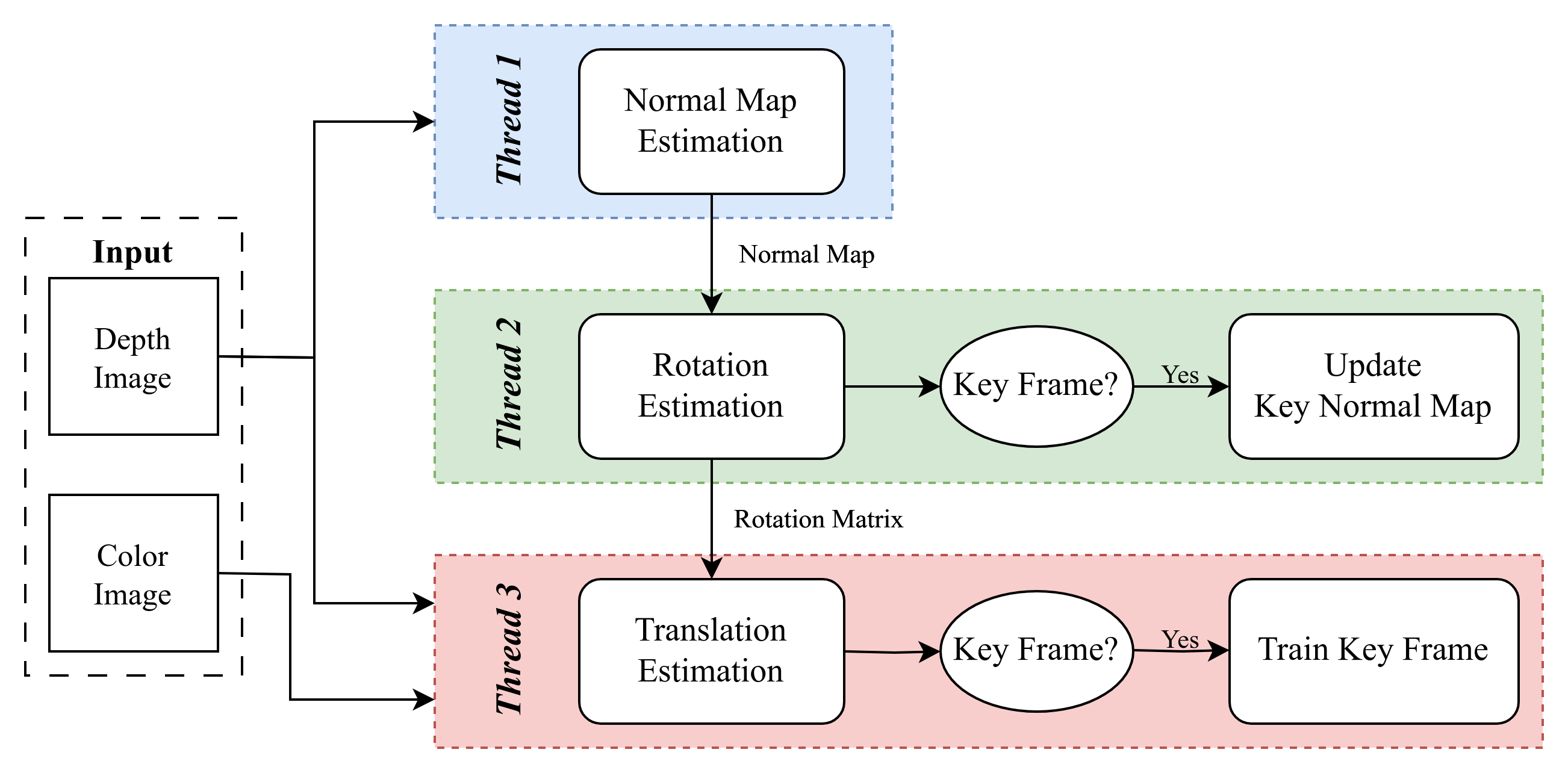

核心思路:本文的核心思路是将6自由度位姿估计问题解耦为旋转和平移两个子问题,分别进行求解。对于旋转估计,利用场景中普遍存在的平面特征,通过分析平面之间的关系来计算旋转矩阵。对于平移估计,采用核互相关器(KCC)直接在图像像素层面进行计算,避免了特征提取和匹配的步骤。

技术框架:该RGB-D视觉里程计方法主要包含以下几个阶段:1) 平面检测:从RGB-D图像中提取平面信息。2) 旋转估计:利用相邻帧之间的平面对应关系,计算旋转矩阵。3) 平移估计:使用核互相关器(KCC)在图像像素层面计算平移向量。4) 位姿更新:将旋转矩阵和平移向量组合成完整的6自由度位姿变换。

关键创新:该方法最重要的技术创新点在于:1) 位姿估计的解耦,将复杂的6自由度优化问题分解为两个相对简单的子问题,降低了计算复杂度。2) 利用平面特征进行旋转估计,避免了对特征点的依赖,提高了在低纹理环境中的鲁棒性。3) 采用核互相关器(KCC)直接计算平移,避免了特征提取和匹配,进一步提高了计算效率。

关键设计:在平面检测方面,可以使用RANSAC等方法从点云数据中提取平面。在旋转估计方面,可以通过最小化平面法向量之间的差异来计算旋转矩阵。在核互相关器(KCC)方面,可以选择合适的核函数(如高斯核)和核参数,以获得最佳的平移估计效果。此外,还可以采用一些优化策略,如关键帧选择和滑动窗口优化,来进一步提高系统的性能。

🖼️ 关键图片

📊 实验亮点

该方法在低端i5 CPU上实现了71Hz的运行速度,表明其具有很高的计算效率。与传统的基于特征点的RGB-D视觉里程计方法相比,该方法在低纹理退化环境中表现出更强的鲁棒性。实验结果表明,该方法能够在资源受限的平台上实现实时、准确的位姿估计。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、三维重建等领域。特别是在计算资源有限的移动机器人平台上,该方法能够提供快速、准确的位姿估计,从而实现自主导航和环境感知。此外,该方法在低纹理环境下的鲁棒性使其在室内场景和光照条件不佳的环境中具有广泛的应用前景。

📄 摘要(原文)

In this paper, we introduce a novel approach for efficiently estimating the 6-Degree-of-Freedom (DoF) robot pose with a decoupled, non-iterative method that capitalizes on overlapping planar elements. Conventional RGB-D visual odometry(RGBD-VO) often relies on iterative optimization solvers to estimate pose and involves a process of feature extraction and matching. This results in significant computational burden and time delays. To address this, our innovative method for RGBD-VO separates the estimation of rotation and translation. Initially, we exploit the overlaid planar characteristics within the scene to calculate the rotation matrix. Following this, we utilize a kernel cross-correlator (KCC) to ascertain the translation. By sidestepping the resource-intensive iterative optimization and feature extraction and alignment procedures, our methodology offers improved computational efficacy, achieving a performance of 71Hz on a lower-end i5 CPU. When the RGBD-VO does not rely on feature points, our technique exhibits enhanced performance in low-texture degenerative environments compared to state-of-the-art methods.