Shared Control of Holonomic Wheelchairs through Reinforcement Learning

作者: Jannis Bähler, Diego Paez-Granados, Jorge Peña-Queralta

分类: cs.RO, cs.LG

发布日期: 2025-07-22

💡 一句话要点

提出基于强化学习的全向轮椅共享控制方法,提升用户舒适度和安全性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 共享控制 全向轮椅 人机交互 机器人导航

📋 核心要点

- 现有全向轮椅共享控制方法存在用户体验不直观、未能充分利用全方位驾驶优势等问题。

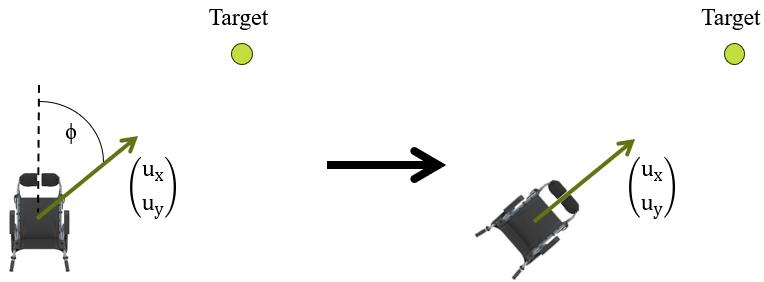

- 提出基于强化学习的共享控制方法,将用户2D输入转化为3D运动控制,降低认知负荷,提升用户舒适性。

- 在仿真和真实环境中验证了该方法的有效性,实现了无碰撞导航,并保证了运动的平滑性。

📝 摘要(中文)

本文提出了一种基于强化学习的全向轮椅共享控制方法,旨在通过辅助驾驶员操作来改善用户体验。现有技术在非完整轮式机器人导航的安全性方面展现了潜力,但对于全向系统,现有方法常导致用户体验不直观,且未能充分利用全方位驾驶的优势。该方法接收用户的2D输入,输出3D运动控制,确保用户舒适性并降低认知负荷。该方法在Isaac Gym中训练,并在Gazebo中进行仿真测试。通过比较不同强化学习智能体架构和基于认知负荷及用户舒适度指标的奖励函数,证明了该方法能够确保无碰撞导航,同时智能地调整轮椅方向,并展现出优于或可与先前非学习方法相媲美的平滑性。此外,还进行了从仿真到真实的迁移,并展示了基于强化学习的全向移动平台共享控制的首次真实世界实现。

🔬 方法详解

问题定义:现有全向轮椅的共享控制方法,在用户体验上存在不足,无法充分发挥全向移动的优势,导致用户操作不直观,认知负荷较高。因此,需要一种更智能的共享控制策略,能够在保证安全性的前提下,提升用户舒适度和操作效率。

核心思路:利用强化学习算法,学习一个最优策略,该策略能够根据用户的输入和环境状态,自动调整轮椅的运动,实现平滑、安全的导航。通过奖励函数的设计,引导智能体学习符合用户习惯和舒适度的运动方式,降低用户的认知负荷。

技术框架:该方法主要包含以下几个模块:1) 用户输入模块:接收用户的2D操控指令;2) 强化学习智能体:基于用户输入和环境信息,输出3D运动控制指令;3) 运动控制模块:将智能体的输出转化为轮椅的实际运动;4) 环境仿真模块:使用Isaac Gym和Gazebo进行训练和测试。整体流程为:用户输入 -> 智能体决策 -> 运动控制 -> 环境反馈 -> 智能体更新。

关键创新:该方法将强化学习应用于全向轮椅的共享控制,实现了端到端的学习,无需人工设计复杂的控制规则。通过精心设计的奖励函数,能够学习到符合用户习惯的运动方式,提升用户体验。此外,该方法还成功地进行了从仿真到真实的迁移,验证了其在实际应用中的可行性。

关键设计:奖励函数的设计是关键,需要综合考虑安全性、平滑性、用户舒适度等因素。例如,可以设置碰撞惩罚、速度平滑奖励、方向对齐奖励等。智能体架构方面,可以尝试不同的神经网络结构,如多层感知机、循环神经网络等。训练过程中,需要调整学习率、折扣因子等超参数,以获得最佳的训练效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在仿真环境中能够实现无碰撞导航,并展现出优于或可与先前非学习方法相媲美的平滑性。与传统方法相比,该方法能够更智能地调整轮椅方向,提升用户舒适度。此外,该研究还成功地进行了从仿真到真实的迁移,并在真实环境中验证了该方法的有效性,这是首次在全向移动平台上实现基于强化学习的共享控制。

🎯 应用场景

该研究成果可应用于智能轮椅、移动机器人等领域,为行动不便的人群提供更安全、舒适、便捷的出行体验。通过智能化的共享控制,可以降低用户的操作难度和认知负荷,提升生活质量。未来,该技术还可以扩展到其他类型的移动平台,如自动驾驶汽车、无人搬运车等。

📄 摘要(原文)

Smart electric wheelchairs can improve user experience by supporting the driver with shared control. State-of-the-art work showed the potential of shared control in improving safety in navigation for non-holonomic robots. However, for holonomic systems, current approaches often lead to unintuitive behavior for the user and fail to utilize the full potential of omnidirectional driving. Therefore, we propose a reinforcement learning-based method, which takes a 2D user input and outputs a 3D motion while ensuring user comfort and reducing cognitive load on the driver. Our approach is trained in Isaac Gym and tested in simulation in Gazebo. We compare different RL agent architectures and reward functions based on metrics considering cognitive load and user comfort. We show that our method ensures collision-free navigation while smartly orienting the wheelchair and showing better or competitive smoothness compared to a previous non-learning-based method. We further perform a sim-to-real transfer and demonstrate, to the best of our knowledge, the first real-world implementation of RL-based shared control for an omnidirectional mobility platform.