MPC-based Coarse-to-Fine Motion Planning for Robotic Object Transportation in Cluttered Environments

作者: Chen Cai, Ernesto Dickel Saraiva, Ya-jun Pan, Steven Liu

分类: cs.RO, eess.SY

发布日期: 2025-07-15

备注: 10 pages, 5 figures, submitted to IEEE Robotics and Automation Letters (RA-L)

💡 一句话要点

提出基于MPC的由粗到精运动规划,解决复杂环境下机器人物体搬运问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 运动规划 模型预测控制 机器人操作 视觉感知 由粗到精 碰撞检测 B样条 闭链运动学

📋 核心要点

- 现有方法在复杂、未建模环境中进行机器人操作时,难以兼顾规划效率和对环境不确定性的适应性。

- 该方法采用由粗到精的规划策略,利用双目视觉系统逐步融合环境信息,并使用MPC进行轨迹优化和动态调整。

- 实验表明,该方法在多臂机器人平台上具有良好的鲁棒性和适应性,能够有效地完成复杂环境下的物体搬运任务。

📝 摘要(中文)

本文提出了一种新颖的由粗到精的运动规划框架,用于在杂乱、未建模环境中进行机器人操作。该系统集成了双摄像头感知设置和基于B样条的模型预测控制(MPC)方案。最初,规划器从部分和不确定的观测中生成可行的全局轨迹。随着新的视觉数据被逐步融合,环境模型和运动规划都得到逐步细化。基于视觉的代价函数促进了目标驱动的探索,而改进的核感知器碰撞检测器能够有效地更新约束,以实现实时规划。该框架适应闭链运动学并支持动态重规划。在多臂平台上的实验验证了其在不确定性和杂乱环境下的鲁棒性和适应性。

🔬 方法详解

问题定义:论文旨在解决在杂乱、未建模环境中,机器人进行物体搬运时面临的运动规划问题。现有方法通常难以在规划效率和对环境不确定性的适应性之间取得平衡。一方面,全局规划方法计算复杂度高,难以实时响应环境变化;另一方面,局部规划方法容易陷入局部最优,无法保证全局目标达成。此外,闭链运动学和动态重规划也增加了问题的复杂性。

核心思路:论文的核心思路是采用由粗到精的运动规划策略。首先,利用有限的感知信息进行粗略的全局规划,生成一个可行的初始轨迹。然后,随着新的视觉数据不断融合,逐步细化环境模型和运动规划,从而提高规划的准确性和效率。这种方法能够有效地利用感知信息,并根据环境变化动态调整规划策略。

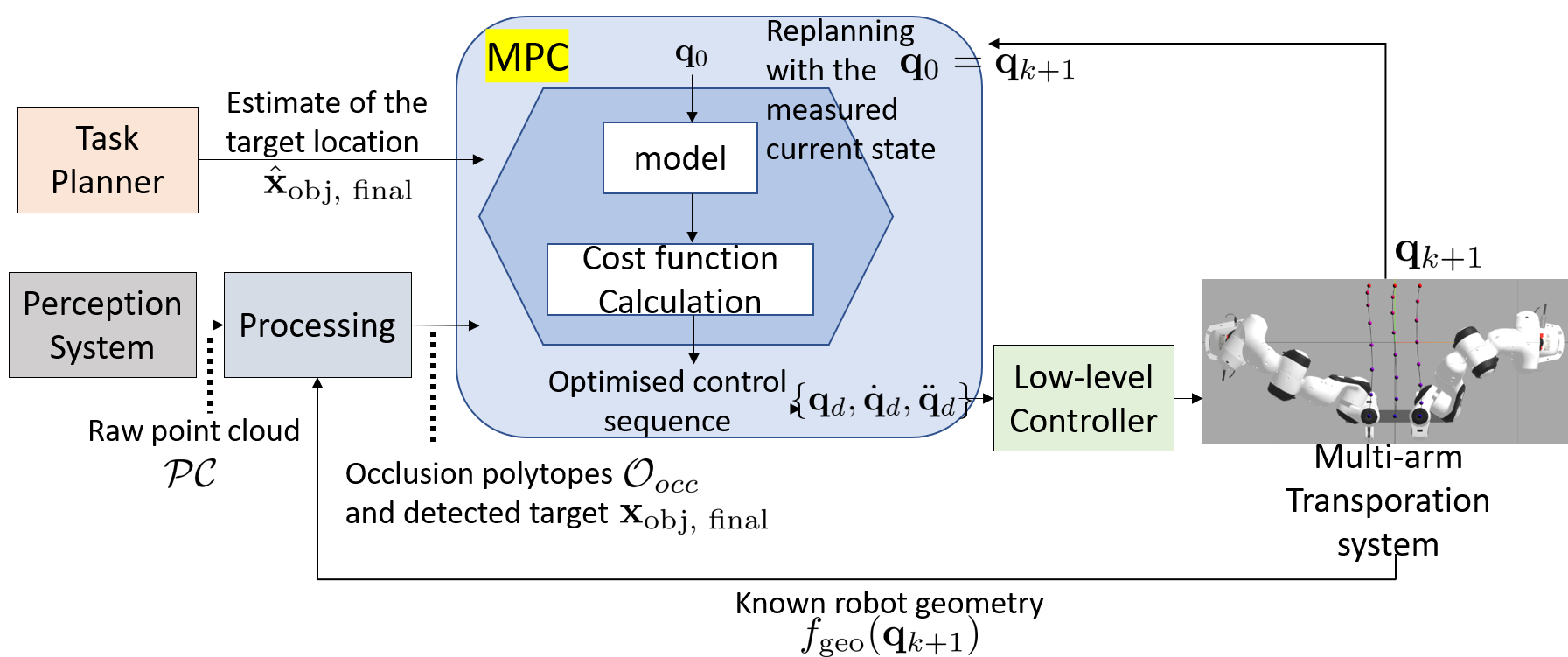

技术框架:该框架主要包含以下几个模块:1) 双摄像头感知系统:用于获取环境的视觉信息;2) 环境建模模块:利用视觉数据构建环境模型,并随着新数据的融合逐步细化;3) 基于B样条的MPC规划器:用于生成和优化机器人运动轨迹,并考虑闭链运动学约束;4) 核感知器碰撞检测器:用于实时检测机器人与环境之间的碰撞,并更新规划约束。整体流程是:首先,利用双摄像头获取环境信息,构建初始环境模型。然后,MPC规划器基于该模型生成初始轨迹。随着新的视觉数据不断融合,环境模型和轨迹都得到逐步细化,最终实现安全、高效的物体搬运。

关键创新:该方法最重要的技术创新点在于将由粗到精的规划策略与基于视觉的MPC相结合。传统的MPC方法通常需要精确的环境模型,而在未建模环境中难以应用。该方法通过逐步融合视觉信息,动态更新环境模型和规划约束,从而实现了在不确定环境下的鲁棒运动规划。此外,改进的核感知器碰撞检测器能够高效地进行碰撞检测,保证了规划的实时性。

关键设计:在环境建模方面,论文采用了一种增量式的建模方法,随着新数据的融合,逐步细化环境模型。在MPC规划器中,论文设计了一个基于视觉的代价函数,用于引导机器人探索目标区域。核感知器碰撞检测器采用了一种高效的核函数,能够快速计算机器人与环境之间的距离,并更新规划约束。B样条曲线用于表示机器人轨迹,保证了轨迹的光滑性和可执行性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多臂机器人平台上能够有效地完成复杂环境下的物体搬运任务。与传统的全局规划方法相比,该方法能够显著提高规划效率和鲁棒性。具体而言,该方法能够在不确定性和杂乱环境下实现安全、高效的运动规划,并能够动态调整规划策略以适应环境变化。实验验证了该方法在实际应用中的可行性和有效性。

🎯 应用场景

该研究成果可应用于各种需要在复杂、动态环境中进行操作的机器人系统,例如:仓储物流、家庭服务机器人、灾难救援机器人等。通过融合视觉感知和运动规划,机器人能够更好地理解和适应环境,从而完成更加复杂的任务。未来,该方法有望进一步扩展到多机器人协作、人机协作等领域,实现更加智能化的机器人操作。

📄 摘要(原文)

This letter presents a novel coarse-to-fine motion planning framework for robotic manipulation in cluttered, unmodeled environments. The system integrates a dual-camera perception setup with a B-spline-based model predictive control (MPC) scheme. Initially, the planner generates feasible global trajectories from partial and uncertain observations. As new visual data are incrementally fused, both the environment model and motion planning are progressively refined. A vision-based cost function promotes target-driven exploration, while a refined kernel-perceptron collision detector enables efficient constraint updates for real-time planning. The framework accommodates closed-chain kinematics and supports dynamic replanning. Experiments on a multi-arm platform validate its robustness and adaptability under uncertainties and clutter.