Where is the Boundary: Multimodal Sensor Fusion Test Bench for Tissue Boundary Delineation

作者: Zacharias Chen, Alexa Cristelle Cahilig, Sarah Dias, Prithu Kolar, Ravi Prakash, Patrick J. Codd

分类: eess.SP, cs.RO

发布日期: 2025-07-10

备注: 4 pages, 5 figures

💡 一句话要点

提出用于组织边界划分的多模态传感器融合测试平台,提升手术精准度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人辅助手术 多模态融合 组织边界划分 传感器融合 神经外科

📋 核心要点

- 现有机器人辅助手术缺乏外科医生天然的感官反馈,难以精确区分健康组织和肿瘤组织,尤其是在肿瘤边界划分上。

- 论文提出一种模块化的多模态传感器融合测试平台,结合视觉引导、接触式麦克风和力传感器,实现更精确的组织边界划分。

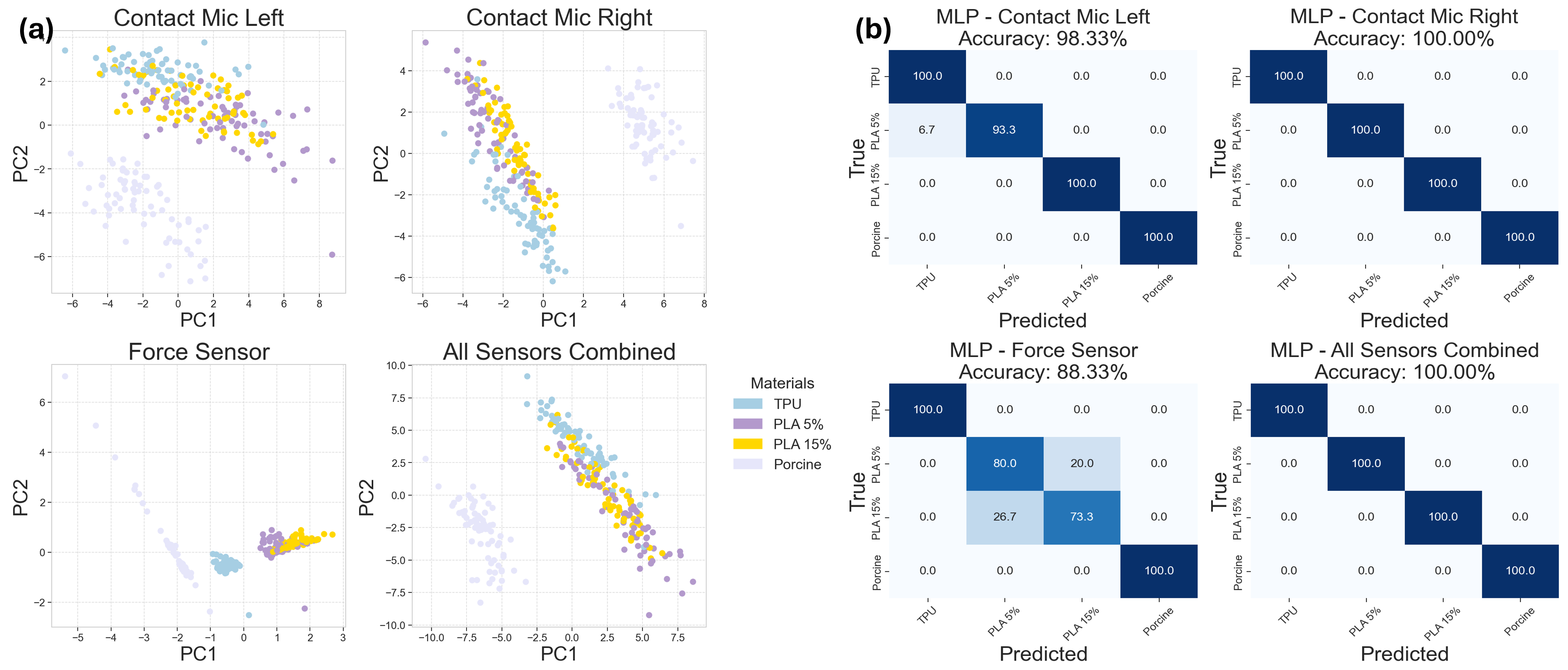

- 实验结果表明,该平台通过多模态融合显著提高了材料分类的准确性,验证了多模态方法在实时组织边界划分中的潜力。

📝 摘要(中文)

机器人辅助神经外科手术因其更高的灵活性、精确性和控制能力而备受关注,从而改善患者的治疗效果。然而,此类系统通常会限制外科医生天然的感官反馈,这对于识别组织至关重要,尤其是在肿瘤手术中,区分健康组织和肿瘤组织至关重要。虽然成像和力感应已经解决了感官反馈不足的问题,但对于精确的组织边界划分,多模态传感选项的研究有限。本文提出了一种用户友好、模块化的测试平台,旨在评估和集成互补的多模态传感器,用于组织识别。我们提出的系统首先使用基于视觉的引导来估计具有视觉线索的边界位置,然后使用接触式麦克风和力传感器获取的数据来细化这些边界。通过交互式图形界面支持实时数据采集和可视化。实验结果表明,多模态融合显著提高了材料分类的准确性。该平台为探索手术应用中的传感器融合提供了一种可扩展的软硬件解决方案,并展示了多模态方法在实时组织边界划分中的潜力。

🔬 方法详解

问题定义:机器人辅助手术中,外科医生缺乏触觉等感官反馈,难以准确区分肿瘤组织和健康组织,尤其是在肿瘤边界的精确划分上。现有方法主要依赖成像和力感应,但缺乏对多模态传感器融合的深入研究,限制了组织边界划分的精度。

核心思路:论文的核心思路是利用多模态传感器融合,结合视觉信息、声音信息和力觉信息,互补各自的优势,提高组织边界划分的准确性。视觉信息用于初步定位边界,接触式麦克风和力传感器用于细化边界,从而克服单一模态的局限性。

技术框架:该测试平台包含以下主要模块:1) 基于视觉的引导模块,利用视觉线索估计边界位置;2) 基于接触式麦克风的声学传感模块,采集组织接触时的声音信息;3) 基于力传感器的力觉传感模块,测量组织接触时的力信息;4) 数据融合模块,将多模态数据进行融合,提高分类准确性;5) 交互式图形界面,用于实时数据采集和可视化。

关键创新:该论文的关键创新在于提出了一个用户友好、模块化的多模态传感器融合测试平台,并将其应用于组织边界划分。该平台集成了视觉、声音和力觉三种模态的信息,通过数据融合提高了组织分类的准确性。此外,该平台具有可扩展性,可以方便地集成其他传感器。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但提到使用了视觉引导来估计边界位置,并使用接触式麦克风和力传感器获取的数据来细化这些边界。数据融合的具体方法未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多模态融合显著提高了材料分类的准确性。虽然论文中没有给出具体的性能数据和提升幅度,但强调了多模态融合的有效性。该平台为探索手术应用中的传感器融合提供了一种可扩展的软硬件解决方案,并展示了多模态方法在实时组织边界划分中的潜力。

🎯 应用场景

该研究成果可应用于机器人辅助神经外科手术,提高肿瘤切除的精准度,减少对健康组织的损伤。该平台也可用于其他需要精确组织识别的医疗场景,例如活检、血管介入等。未来,该研究有望推动多模态传感器融合技术在医疗领域的广泛应用,改善患者的治疗效果。

📄 摘要(原文)

Robot-assisted neurological surgery is receiving growing interest due to the improved dexterity, precision, and control of surgical tools, which results in better patient outcomes. However, such systems often limit surgeons' natural sensory feedback, which is crucial in identifying tissues -- particularly in oncological procedures where distinguishing between healthy and tumorous tissue is vital. While imaging and force sensing have addressed the lack of sensory feedback, limited research has explored multimodal sensing options for accurate tissue boundary delineation. We present a user-friendly, modular test bench designed to evaluate and integrate complementary multimodal sensors for tissue identification. Our proposed system first uses vision-based guidance to estimate boundary locations with visual cues, which are then refined using data acquired by contact microphones and a force sensor. Real-time data acquisition and visualization are supported via an interactive graphical interface. Experimental results demonstrate that multimodal fusion significantly improves material classification accuracy. The platform provides a scalable hardware-software solution for exploring sensor fusion in surgical applications and demonstrates the potential of multimodal approaches in real-time tissue boundary delineation.