DRO-EDL-MPC: Evidential Deep Learning-Based Distributionally Robust Model Predictive Control for Safe Autonomous Driving

作者: Hyeongchan Ham, Heejin Ahn

分类: cs.RO

发布日期: 2025-07-08 (更新: 2025-12-22)

备注: Accepted to IEEE Robotics and Automation Letters (RA-L)

💡 一句话要点

提出基于证据深度学习的分布鲁棒模型预测控制,用于安全自动驾驶

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 自动驾驶 模型预测控制 分布鲁棒优化 证据深度学习 不确定性量化

📋 核心要点

- 自动驾驶依赖神经网络感知,但其固有的不确定性给控制决策带来安全风险。

- 利用证据深度学习(EDL)量化认知和偶然不确定性,构建分布鲁棒优化(DRO)框架。

- CARLA仿真验证表明,该方法在保证安全性的同时,兼顾了高置信度下的效率。

📝 摘要(中文)

本文提出了一种分布鲁棒优化(DRO)框架,该框架利用证据深度学习(EDL)来考虑自动驾驶车辆运动规划中固有的认知和偶然不确定性,从而解决安全性这一关键问题。该方法引入了一种基于证据分布的新型模糊集公式,该公式根据感知置信度动态调整保守性。我们将这种考虑不确定性的约束集成到模型预测控制(MPC)中,提出了具有计算可处理性的DRO-EDL-MPC算法,适用于自动驾驶应用。在CARLA模拟器中的验证表明,我们的方法在高感知置信度下保持效率,而在低置信度下强制执行保守约束。

🔬 方法详解

问题定义:自动驾驶车辆的运动规划面临着感知不确定性带来的安全风险。现有的方法难以同时兼顾感知不确定性和控制效率,尤其是在感知置信度较低的情况下,容易做出不安全的决策。因此,需要一种能够有效处理感知不确定性,并根据置信度动态调整控制策略的方法。

核心思路:本文的核心思路是利用证据深度学习(EDL)来量化感知结果中的认知不确定性和偶然不确定性,并将其融入到分布鲁棒优化(DRO)框架中。通过构建基于证据分布的模糊集,可以根据感知置信度动态调整控制策略的保守性,从而在保证安全性的前提下,提高控制效率。

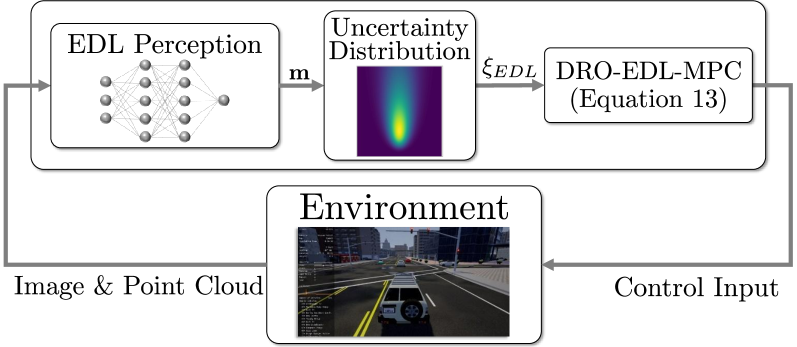

技术框架:DRO-EDL-MPC算法的整体框架包括以下几个主要模块:1) 基于神经网络的感知模块,用于获取环境信息;2) 基于证据深度学习(EDL)的不确定性量化模块,用于估计感知结果中的认知和偶然不确定性;3) 基于分布鲁棒优化(DRO)的模型预测控制(MPC)模块,用于生成安全且高效的控制指令。该框架将不确定性信息作为约束条件融入到MPC的优化问题中,从而实现对感知不确定性的鲁棒控制。

关键创新:本文最重要的技术创新点在于提出了一种基于证据分布的新型模糊集公式,该公式能够根据感知置信度动态调整控制策略的保守性。与传统的DRO方法相比,该方法能够更有效地利用感知信息,并在保证安全性的前提下,提高控制效率。此外,将EDL与DRO-MPC相结合,为解决自动驾驶中的感知不确定性问题提供了一种新的思路。

关键设计:在EDL模块中,使用了Dirichlet分布来建模感知结果的不确定性,并利用神经网络来预测Dirichlet分布的参数。在DRO-MPC模块中,将不确定性信息转化为约束条件,并使用求解器来求解优化问题。关键参数包括Dirichlet分布的参数、模糊集的置信水平以及MPC的控制时域等。损失函数的设计需要同时考虑控制性能和安全性,例如,可以使用惩罚函数来约束车辆的运动状态,避免碰撞等危险情况。

🖼️ 关键图片

📊 实验亮点

在CARLA仿真环境中,DRO-EDL-MPC算法在低感知置信度下表现出更强的保守性,能够有效避免碰撞风险。同时,在高感知置信度下,该算法能够保持较高的控制效率,与传统的MPC算法相比,在保证安全性的前提下,性能损失较小。实验结果表明,该方法能够有效地处理感知不确定性,提高自动驾驶系统的安全性。

🎯 应用场景

该研究成果可应用于各种自动驾驶场景,例如城市道路自动驾驶、高速公路自动驾驶和泊车辅助等。通过考虑感知不确定性,可以提高自动驾驶系统的安全性和可靠性,降低事故发生的概率。此外,该方法还可以应用于其他机器人领域,例如无人机、无人船等,提高其在复杂环境中的适应能力。

📄 摘要(原文)

Safety is a critical concern in motion planning for autonomous vehicles. Modern autonomous vehicles rely on neural network-based perception, but making control decisions based on these inference results poses significant safety risks due to inherent uncertainties. To address this challenge, we present a distributionally robust optimization (DRO) framework that accounts for both aleatoric and epistemic perception uncertainties using evidential deep learning (EDL). Our approach introduces a novel ambiguity set formulation based on evidential distributions that dynamically adjusts the conservativeness according to perception confidence levels. We integrate this uncertainty-aware constraint into model predictive control (MPC), proposing the DRO-EDL-MPC algorithm with computational tractability for autonomous driving applications. Validation in the CARLA simulator demonstrates that our approach maintains efficiency under high perception confidence while enforcing conservative constraints under low confidence.