Hybrid Diffusion Policies with Projective Geometric Algebra for Efficient Robot Manipulation Learning

作者: Xiatao Sun, Yuxuan Wang, Shuo Yang, Yinxing Chen, Daniel Rakita

分类: cs.RO

发布日期: 2025-07-08 (更新: 2025-09-17)

💡 一句话要点

提出基于射影几何代数的混合扩散策略,提升机器人操作学习效率

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 扩散策略 射影几何代数 几何归纳偏置 深度学习

📋 核心要点

- 现有扩散策略在机器人学习中效率低,需为每个任务重新学习空间概念。

- 提出hPGA-DP,利用射影几何代数PGA嵌入几何归纳偏置,提升空间推理能力。

- 实验表明,hPGA-DP显著提升任务性能和训练效率,收敛速度更快。

📝 摘要(中文)

扩散策略是机器人学习的强大范式,但其训练效率通常较低。一个关键原因是网络必须为每个新任务从头开始重新学习基本的空间概念,如平移和旋转。为了减轻这种冗余,我们提出使用射影几何代数(PGA)将几何归纳偏置直接嵌入到网络架构中。PGA为表示几何基元和变换提供了一个统一的代数框架,使神经网络能够更有效地推理空间结构。在本文中,我们介绍了一种新颖的混合扩散策略hPGA-DP,它利用了这些优势。我们的架构利用射影几何代数Transformer(P-GATr)作为状态编码器和动作解码器,同时采用已建立的基于U-Net或Transformer的模块进行核心去噪过程。通过在模拟和真实环境中的大量实验和消融研究,我们证明了hPGA-DP显著提高了任务性能和训练效率。值得注意的是,与标准扩散策略和仅依赖P-GATr的架构相比,我们的混合方法实现了更快的收敛。

🔬 方法详解

问题定义:现有基于扩散模型的机器人操作学习方法,需要从头学习平移、旋转等基本空间概念,导致训练效率低下,泛化能力受限。网络难以有效利用空间几何信息,造成了不必要的计算冗余。

核心思路:本论文的核心思路是将几何归纳偏置直接嵌入到扩散策略的网络架构中,利用射影几何代数(PGA)统一表示几何基元和变换,从而使网络能够更有效地推理空间结构,减少对空间概念的重复学习。

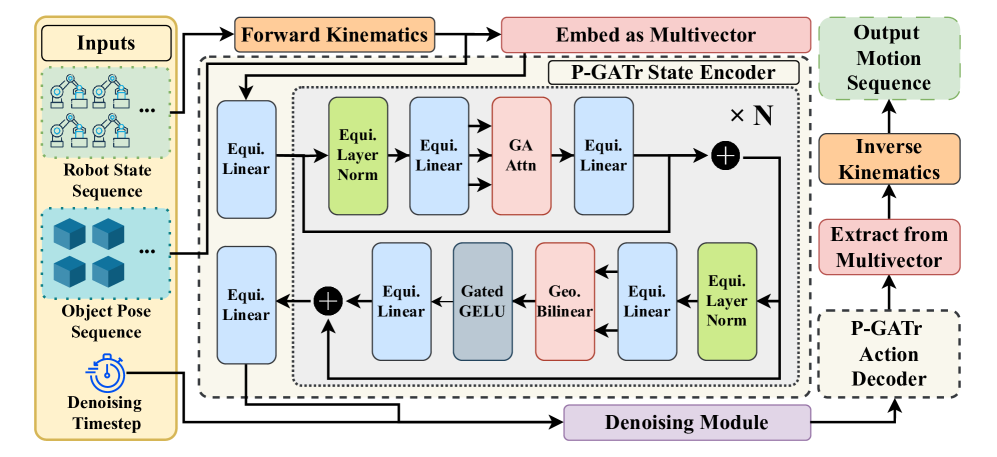

技术框架:hPGA-DP的整体架构是一个混合扩散策略。它使用Projective Geometric Algebra Transformer (P-GATr) 作为状态编码器和动作解码器,负责处理几何信息的输入和输出。核心的去噪过程则采用已有的U-Net或Transformer结构。这种混合结构旨在结合PGA的几何推理能力和现有扩散模型的强大表达能力。

关键创新:关键创新在于将PGA引入扩散策略,并设计了混合架构hPGA-DP。与完全依赖Transformer或U-Net的扩散策略相比,hPGA-DP能够更有效地利用几何信息,从而提高训练效率和任务性能。与完全依赖P-GATr的架构相比,混合架构能够更好地平衡几何推理能力和表达能力。

关键设计:P-GATr的设计是关键。它利用PGA的代数结构来表示和操作几何对象,例如点、线、面和变换。具体实现细节包括如何将状态信息编码为PGA元素,如何使用PGA操作进行几何推理,以及如何将PGA表示的动作解码为实际的机器人控制信号。损失函数方面,除了标准的扩散模型损失外,可能还引入了正则化项,以鼓励P-GATr学习更有效的几何表示。

🖼️ 关键图片

📊 实验亮点

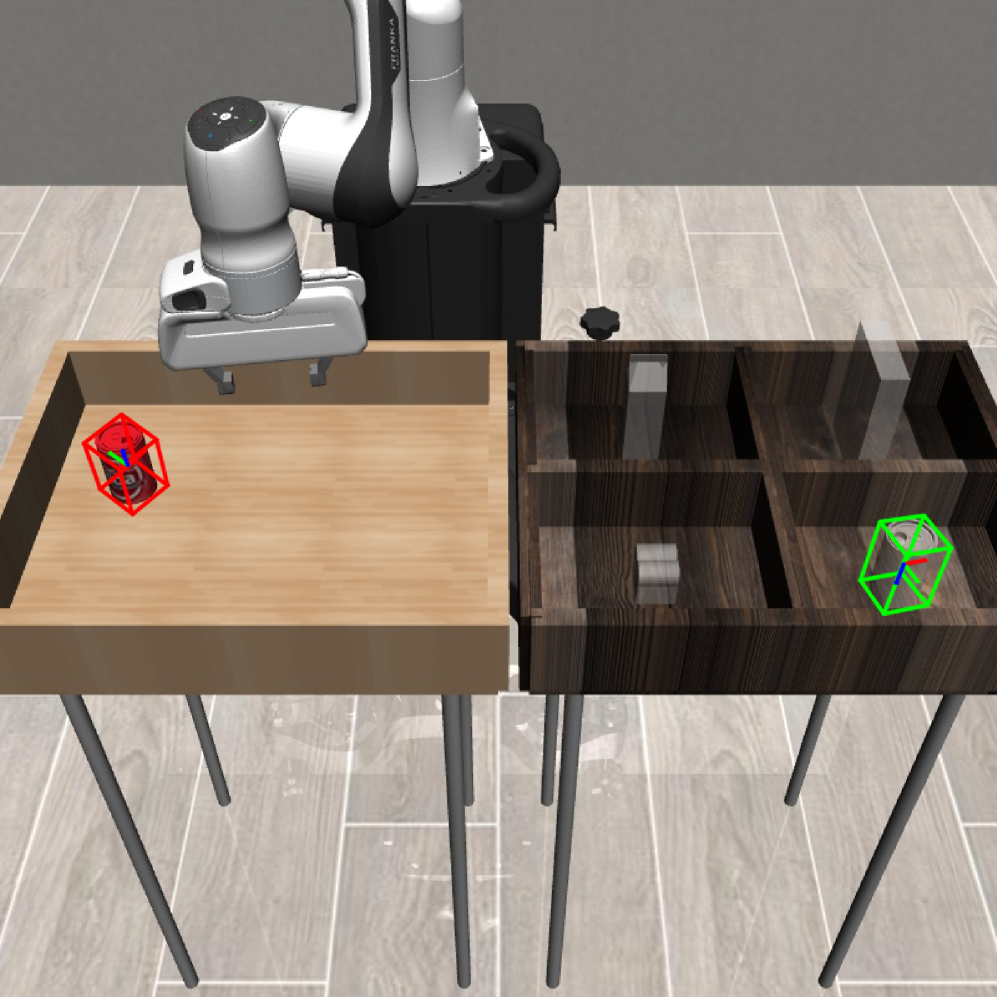

实验结果表明,hPGA-DP在多个机器人操作任务中显著提高了训练效率和任务性能。与标准扩散策略和仅依赖P-GATr的架构相比,hPGA-DP实现了更快的收敛速度。具体性能数据(例如成功率、训练时间)在论文中给出,证明了该混合方法的有效性。

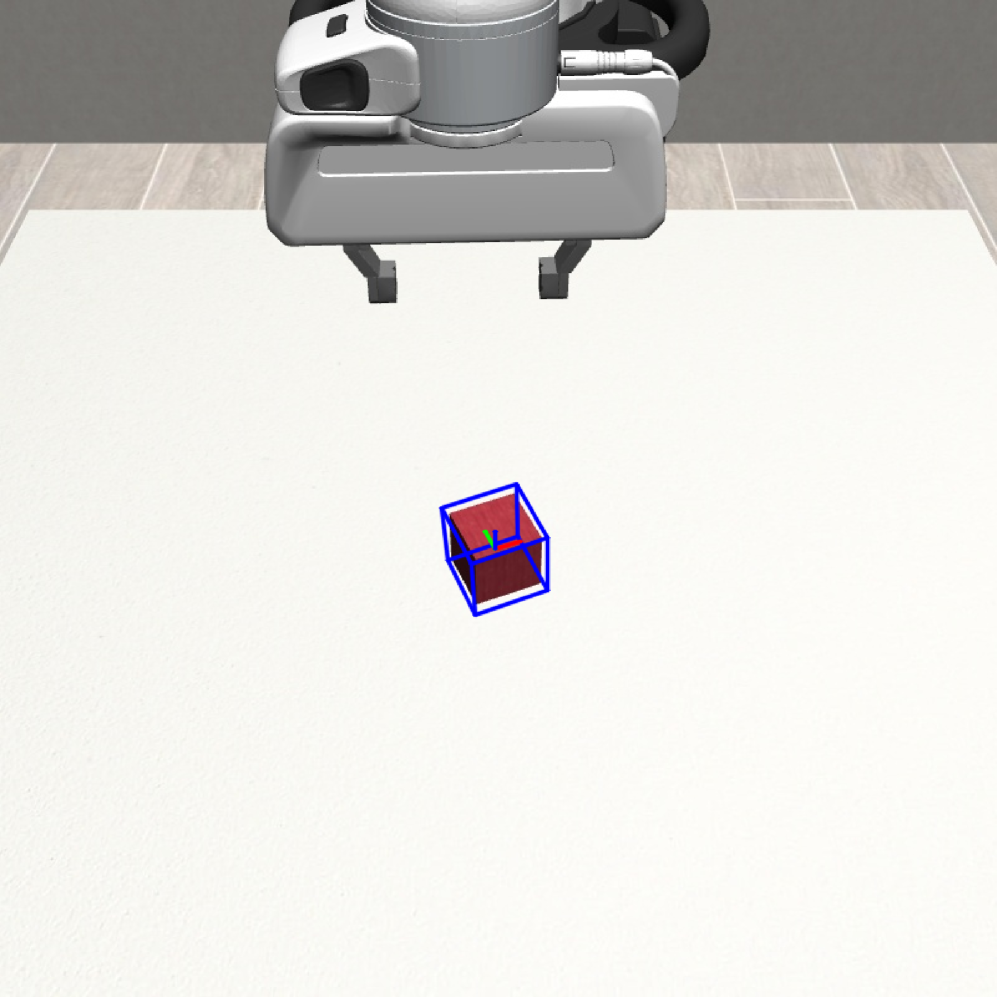

🎯 应用场景

该研究成果可广泛应用于机器人操作任务,例如抓取、装配、导航等。通过提升机器人学习效率和泛化能力,可以降低机器人部署成本,使其能够更好地适应复杂和动态的环境。未来,该方法有望应用于自动驾驶、增强现实等领域,实现更智能、更高效的人机交互。

📄 摘要(原文)

Diffusion policies are a powerful paradigm for robot learning, but their training is often inefficient. A key reason is that networks must relearn fundamental spatial concepts, such as translations and rotations, from scratch for every new task. To alleviate this redundancy, we propose embedding geometric inductive biases directly into the network architecture using Projective Geometric Algebra (PGA). PGA provides a unified algebraic framework for representing geometric primitives and transformations, allowing neural networks to reason about spatial structure more effectively. In this paper, we introduce hPGA-DP, a novel hybrid diffusion policy that capitalizes on these benefits. Our architecture leverages the Projective Geometric Algebra Transformer (P-GATr) as a state encoder and action decoder, while employing established U-Net or Transformer-based modules for the core denoising process. Through extensive experiments and ablation studies in both simulated and real-world environments, we demonstrate that hPGA-DP significantly improves task performance and training efficiency. Notably, our hybrid approach achieves substantially faster convergence compared to both standard diffusion policies and architectures that rely solely on P-GATr.