EmbodieDreamer: Advancing Real2Sim2Real Transfer for Policy Training via Embodied World Modeling

作者: Boyuan Wang, Xinpan Meng, Xiaofeng Wang, Zheng Zhu, Angen Ye, Yang Wang, Zhiqin Yang, Chaojun Ni, Guan Huang, Xingang Wang

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-07-07

备注: Project Page: https://embodiedreamer.github.io/

💡 一句话要点

EmbodieDreamer:通过具身世界建模提升策略训练的Real2Sim2Real迁移效果

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 Real2Sim2Real 物理对齐 视觉迁移 扩散模型 机器人策略 可微分物理引擎

📋 核心要点

- 真实世界数据的昂贵和低效阻碍了具身智能的发展,而仿真环境与真实环境的差距限制了策略的有效迁移。

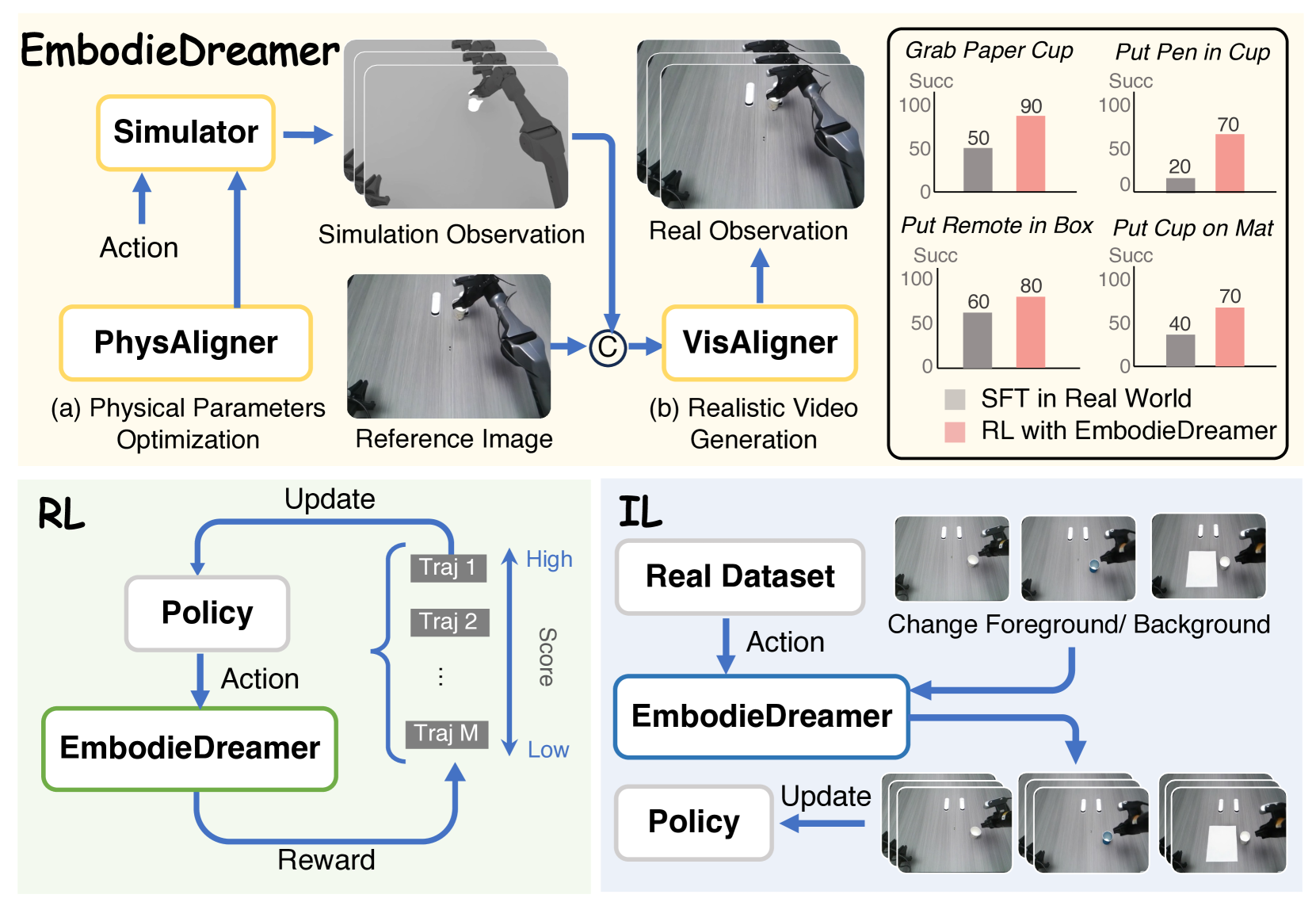

- EmbodieDreamer通过PhysAligner对齐物理动力学,并利用VisAligner的条件视频扩散模型实现逼真的视觉迁移,缩小Real2Sim2Real差距。

- 实验表明,PhysAligner降低了物理参数估计误差,提高了优化速度,并且在真实环境中训练的策略成功率显著提升。

📝 摘要(中文)

具身智能的快速发展对大规模、高质量的真实世界数据提出了更高的需求。然而,收集此类具身数据仍然成本高昂且效率低下。因此,仿真环境已成为训练机器人策略的关键替代方案。然而,显著的Real2Sim2Real差距仍然是一个关键瓶颈,特别是在物理动力学和视觉外观方面。为了应对这一挑战,我们提出了EmbodieDreamer,这是一个新颖的框架,从物理和外观两个角度缩小Real2Sim2Real的差距。具体来说,我们提出了PhysAligner,一个可微分的物理模块,旨在减小Real2Sim的物理差距。它联合优化机器人特定的参数,如控制增益和摩擦系数,以更好地将模拟动力学与真实世界的观察结果对齐。此外,我们引入了VisAligner,它结合了一个条件视频扩散模型,通过将低保真模拟渲染转换为以模拟状态为条件的照片级真实视频,从而弥合Sim2Real的外观差距,从而实现高保真视觉迁移。大量的实验验证了EmbodieDreamer的有效性。与模拟退火方法相比,所提出的PhysAligner将物理参数估计误差降低了3.74%,同时将优化速度提高了89.91%。此外,在生成的照片级真实环境中训练机器人策略后,在真实世界任务中的平均任务成功率提高了29.17%。代码、模型和数据将公开提供。

🔬 方法详解

问题定义:论文旨在解决机器人策略从仿真环境迁移到真实环境时,由于物理动力学和视觉外观差异导致的性能下降问题,即Real2Sim2Real差距。现有方法难以同时解决物理和视觉上的差异,导致策略在真实环境中表现不佳。

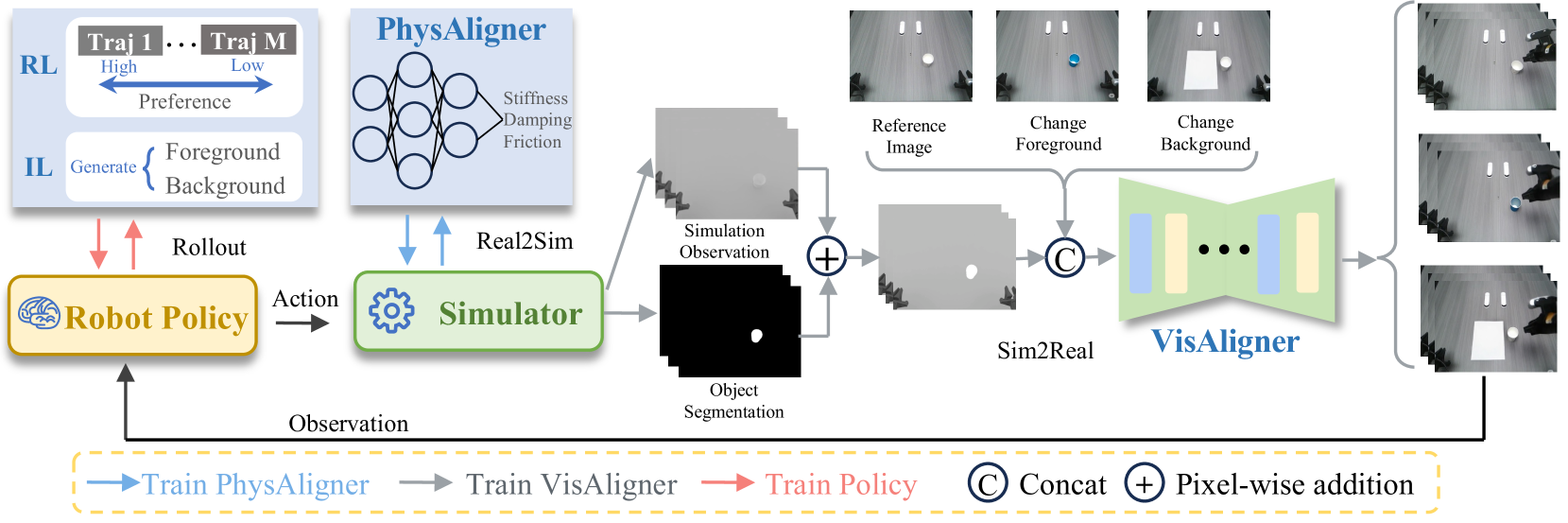

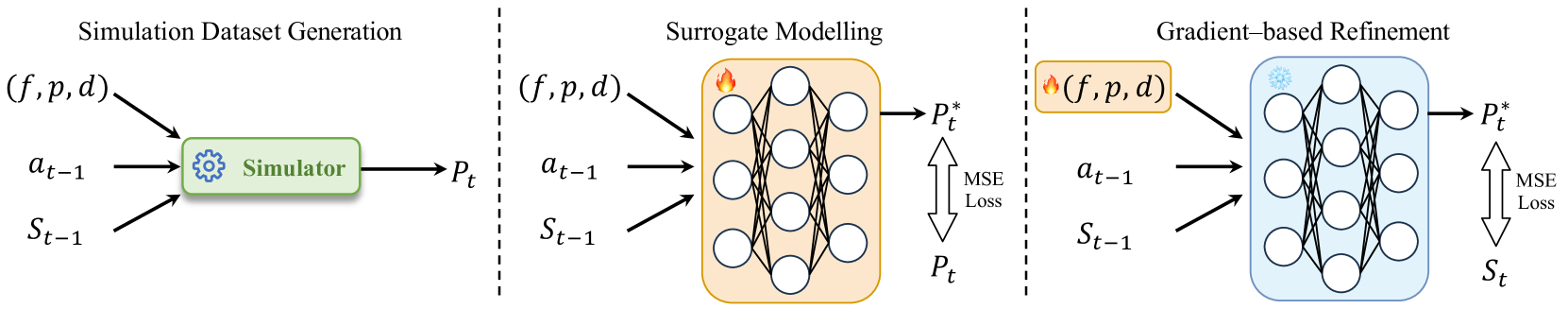

核心思路:论文的核心思路是通过两个模块分别解决物理和视觉上的差异。PhysAligner通过可微分的物理引擎优化仿真环境的物理参数,使其与真实环境的动力学特性对齐。VisAligner则利用条件视频扩散模型,将仿真环境的低保真渲染转化为逼真的视频,从而缩小视觉差距。

技术框架:EmbodieDreamer框架包含两个主要模块:PhysAligner和VisAligner。PhysAligner首先收集真实世界的数据,然后使用可微分的物理引擎模拟机器人行为,并通过优化物理参数(如摩擦系数、控制增益等)来最小化仿真和真实数据之间的差异。VisAligner则以仿真环境的状态作为条件,使用条件视频扩散模型生成逼真的视频,用于训练机器人策略。整个流程是先通过PhysAligner对齐物理,再通过VisAligner增强视觉真实性,最后在增强后的仿真环境中训练策略。

关键创新:论文的关键创新在于同时考虑了物理和视觉上的Real2Sim差距,并提出了相应的解决方案。PhysAligner利用可微分物理引擎进行参数优化,避免了传统方法中需要手动调整参数或使用黑盒优化算法的缺点。VisAligner则利用了近年来在图像生成领域取得突破的扩散模型,实现了高保真度的视觉迁移。

关键设计:PhysAligner使用可微分的物理引擎,例如MuJoCo,并定义了损失函数来衡量仿真和真实数据之间的差异,例如状态差异、力矩差异等。优化算法可以选择梯度下降等方法。VisAligner使用条件视频扩散模型,输入为仿真环境的状态,输出为逼真的视频帧。扩散模型的具体结构可以选择U-Net等常用的架构,并使用对抗训练等方法来提高生成视频的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PhysAligner在物理参数估计方面优于模拟退火方法,误差降低了3.74%,优化速度提高了89.91%。在生成的照片级真实环境中训练机器人策略后,在真实世界任务中的平均任务成功率提高了29.17%。这些结果验证了EmbodieDreamer在缩小Real2Sim2Real差距方面的有效性。

🎯 应用场景

EmbodieDreamer可应用于各种机器人任务,例如操作、导航和运动控制。通过缩小仿真和真实环境之间的差距,可以降低机器人策略开发的成本和时间,并提高机器人在真实世界中的性能。该研究对于推动机器人技术在工业自动化、家庭服务和医疗保健等领域的应用具有重要意义。

📄 摘要(原文)

The rapid advancement of Embodied AI has led to an increasing demand for large-scale, high-quality real-world data. However, collecting such embodied data remains costly and inefficient. As a result, simulation environments have become a crucial surrogate for training robot policies. Yet, the significant Real2Sim2Real gap remains a critical bottleneck, particularly in terms of physical dynamics and visual appearance. To address this challenge, we propose EmbodieDreamer, a novel framework that reduces the Real2Sim2Real gap from both the physics and appearance perspectives. Specifically, we propose PhysAligner, a differentiable physics module designed to reduce the Real2Sim physical gap. It jointly optimizes robot-specific parameters such as control gains and friction coefficients to better align simulated dynamics with real-world observations. In addition, we introduce VisAligner, which incorporates a conditional video diffusion model to bridge the Sim2Real appearance gap by translating low-fidelity simulated renderings into photorealistic videos conditioned on simulation states, enabling high-fidelity visual transfer. Extensive experiments validate the effectiveness of EmbodieDreamer. The proposed PhysAligner reduces physical parameter estimation error by 3.74% compared to simulated annealing methods while improving optimization speed by 89.91\%. Moreover, training robot policies in the generated photorealistic environment leads to a 29.17% improvement in the average task success rate across real-world tasks after reinforcement learning. Code, model and data will be publicly available.