HumanoidGen: Data Generation for Bimanual Dexterous Manipulation via LLM Reasoning

作者: Zhi Jing, Siyuan Yang, Jicong Ao, Ting Xiao, Yu-Gang Jiang, Chenjia Bai

分类: cs.RO, cs.AI

发布日期: 2025-07-01 (更新: 2025-11-16)

备注: Project Page: https://openhumanoidgen.github.io

💡 一句话要点

HumanoidGen:利用LLM推理生成双臂灵巧操作的人形机器人数据

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 人形机器人 双臂灵巧操作 数据生成 大型语言模型 蒙特卡洛树搜索 机器人学习 任务规划

📋 核心要点

- 现有机器人数据集主要面向机械臂,缺乏针对双臂灵巧操作人形机器人的高质量数据和模拟任务。

- HumanoidGen利用原子灵巧操作和LLM推理,自动生成任务和演示数据,解决了数据匮乏问题。

- 实验表明,通过HumanoidGen生成的数据集,可以有效提升2D和3D扩散策略在灵巧操作任务上的性能。

📝 摘要(中文)

本文提出HumanoidGen,一个自动化的任务创建和演示收集框架,旨在为配备双臂和灵巧手的人形机器人生成数据。现有机器人数据集和模拟基准主要针对机械臂平台,而双臂灵巧操作更复杂,需要协调的手臂运动和手部操作,自主数据收集具有挑战性。HumanoidGen利用原子灵巧操作和LLM推理来生成关系约束。具体来说,基于原子操作为资产和灵巧手提供空间注释,并执行LLM规划器,根据对象的可供性和场景生成一系列可操作的手臂运动空间约束。为了进一步提高规划能力,采用蒙特卡洛树搜索的变体来增强LLM对长时程任务和注释不足的推理。实验创建了一个新的增强场景基准,以评估收集数据的质量。结果表明,2D和3D扩散策略的性能可以随着生成的数据集而扩展。

🔬 方法详解

问题定义:现有机器人操作数据集和模拟环境主要针对机械臂,缺乏对双臂灵巧操作人形机器人的支持。双臂灵巧操作涉及复杂的协调运动,数据收集困难,阻碍了相关算法的发展。

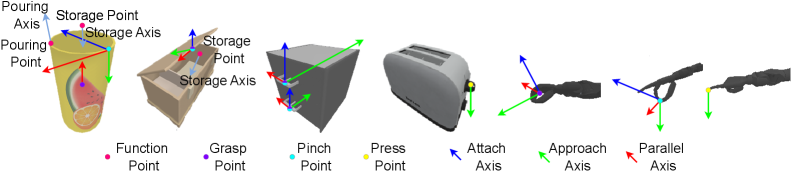

核心思路:利用大型语言模型(LLM)的推理能力,自动生成任务规划和操作序列。通过定义原子灵巧操作和空间约束,将复杂的双臂操作分解为一系列可执行的步骤,从而降低数据生成的难度。

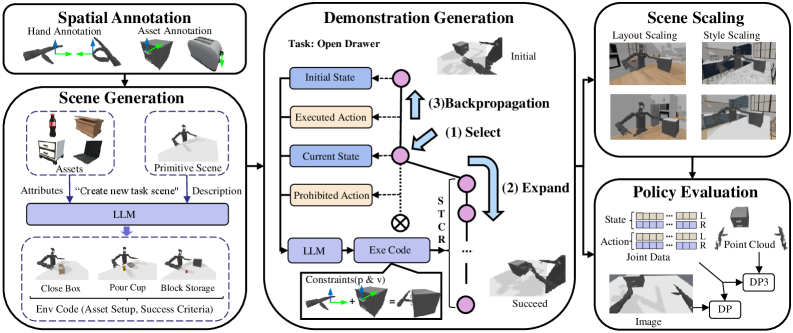

技术框架:HumanoidGen框架包含以下几个主要模块:1) 原子操作定义模块:定义了一系列基本的灵巧操作,如抓取、放置等。2) 空间注释模块:为物体和灵巧手提供空间位置和姿态的标注。3) LLM规划器:利用LLM根据物体可供性和场景信息,生成一系列手臂运动的空间约束。4) 蒙特卡洛树搜索(MCTS)增强模块:针对长时程任务和标注不足的情况,使用MCTS提升LLM的规划能力。

关键创新:核心创新在于将LLM的推理能力与原子操作相结合,实现了自动化的任务生成和演示数据收集。与传统的手动设计任务和人工示教相比,HumanoidGen能够高效地生成多样化的双臂灵巧操作数据。使用MCTS增强LLM规划能力,提升了长时程任务的规划效果。

关键设计:空间注释基于原子操作进行,确保了操作的可执行性。LLM规划器使用提示工程(Prompt Engineering)来引导LLM生成合理的任务规划。MCTS的变体用于探索更优的规划路径,提升了LLM在复杂任务中的表现。具体参数设置和损失函数细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用HumanoidGen生成的数据集可以有效提升2D和3D扩散策略在双臂灵巧操作任务上的性能。通过在增强场景基准上进行评估,验证了生成数据的质量和有效性。具体的性能提升数据和对比基线在论文中有所展示,但具体数值未在此处详细说明。

🎯 应用场景

该研究成果可应用于人形机器人的自主操作、智能制造、家庭服务等领域。通过生成大量高质量的训练数据,可以提升人形机器人在复杂环境中的操作能力,使其能够更好地完成各种任务,例如物品整理、工具使用等,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

For robotic manipulation, existing robotics datasets and simulation benchmarks predominantly cater to robot-arm platforms. However, for humanoid robots equipped with dual arms and dexterous hands, simulation tasks and high-quality demonstrations are notably lacking. Bimanual dexterous manipulation is inherently more complex, as it requires coordinated arm movements and hand operations, making autonomous data collection challenging. This paper presents HumanoidGen, an automated task creation and demonstration collection framework that leverages atomic dexterous operations and LLM reasoning to generate relational constraints. Specifically, we provide spatial annotations for both assets and dexterous hands based on the atomic operations, and perform an LLM planner to generate a chain of actionable spatial constraints for arm movements based on object affordances and scenes. To further improve planning ability, we employ a variant of Monte Carlo tree search to enhance LLM reasoning for long-horizon tasks and insufficient annotation. In experiments, we create a novel benchmark with augmented scenarios to evaluate the quality of the collected data. The results show that the performance of the 2D and 3D diffusion policies can scale with the generated dataset. Project page is https://openhumanoidgen.github.io.