Learning Steerable Imitation Controllers from Unstructured Animal Motions

作者: Dongho Kang, Jin Cheng, Fatemeh Zargarbashi, Taerim Yoon, Sungjoon Choi, Stelian Coros

分类: cs.RO

发布日期: 2025-07-01

备注: The supplementary video is available at https://youtu.be/DukyUGNYf5A

💡 一句话要点

提出一种从非结构化动物运动数据中学习可控模仿控制器的框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion)

关键词: 腿式机器人控制 运动模仿 变分自编码器 强化学习 动物运动数据

📋 核心要点

- 现有腿式机器人运动控制方法难以从真实动物运动中学习多样化和可控的运动模式。

- 该方法通过约束逆运动学和模型预测控制,将动物运动数据转化为机器人可用的数据库,并使用变分自编码器进行运动合成。

- 实验结果表明,该方法能够使四足机器人自适应切换步态,精确跟踪用户速度指令,并保持运动风格的一致性。

📝 摘要(中文)

本文提出了一种用于腿式机器人的控制框架,该框架利用非结构化的真实动物运动数据来生成类动物且用户可控的行为。我们的框架学习在重现原始数据集中多样步态模式的同时,跟踪速度指令。首先,使用约束逆运动学和模型预测控制将动物运动数据转换为机器人兼容的数据库,从而弥合动物和机器人之间的形态和物理差距。随后,基于变分自编码器的运动合成模块捕获运动数据库中的各种运动模式,并生成响应速度指令的平滑过渡。生成的运动学运动作为基于强化学习的反馈控制器的参考,该控制器部署在物理机器人上。我们表明,这种方法使四足机器人能够自适应地切换步态并准确地跟踪用户速度指令,同时保持运动数据的风格一致性。此外,我们还提供组件评估,以深入分析系统的行为,并证明我们的方法对于更准确和可靠的运动模仿的有效性。

🔬 方法详解

问题定义:现有腿式机器人控制方法难以直接利用真实动物的非结构化运动数据,因为动物和机器人在形态和物理特性上存在差异。此外,如何从这些数据中学习到多样化的步态模式,并实现用户对机器人运动的精确控制,也是一个挑战。现有方法通常依赖于手工设计的控制器或需要大量标记数据的监督学习,泛化性较差。

核心思路:本文的核心思路是将动物运动数据转化为机器人可用的运动数据库,然后利用变分自编码器学习运动模式,并使用强化学习训练反馈控制器。通过这种方式,机器人可以模仿动物的运动风格,同时响应用户的速度指令。这种方法的核心在于解耦了运动生成和控制,使得机器人既能学习到自然的运动模式,又能实现精确的控制。

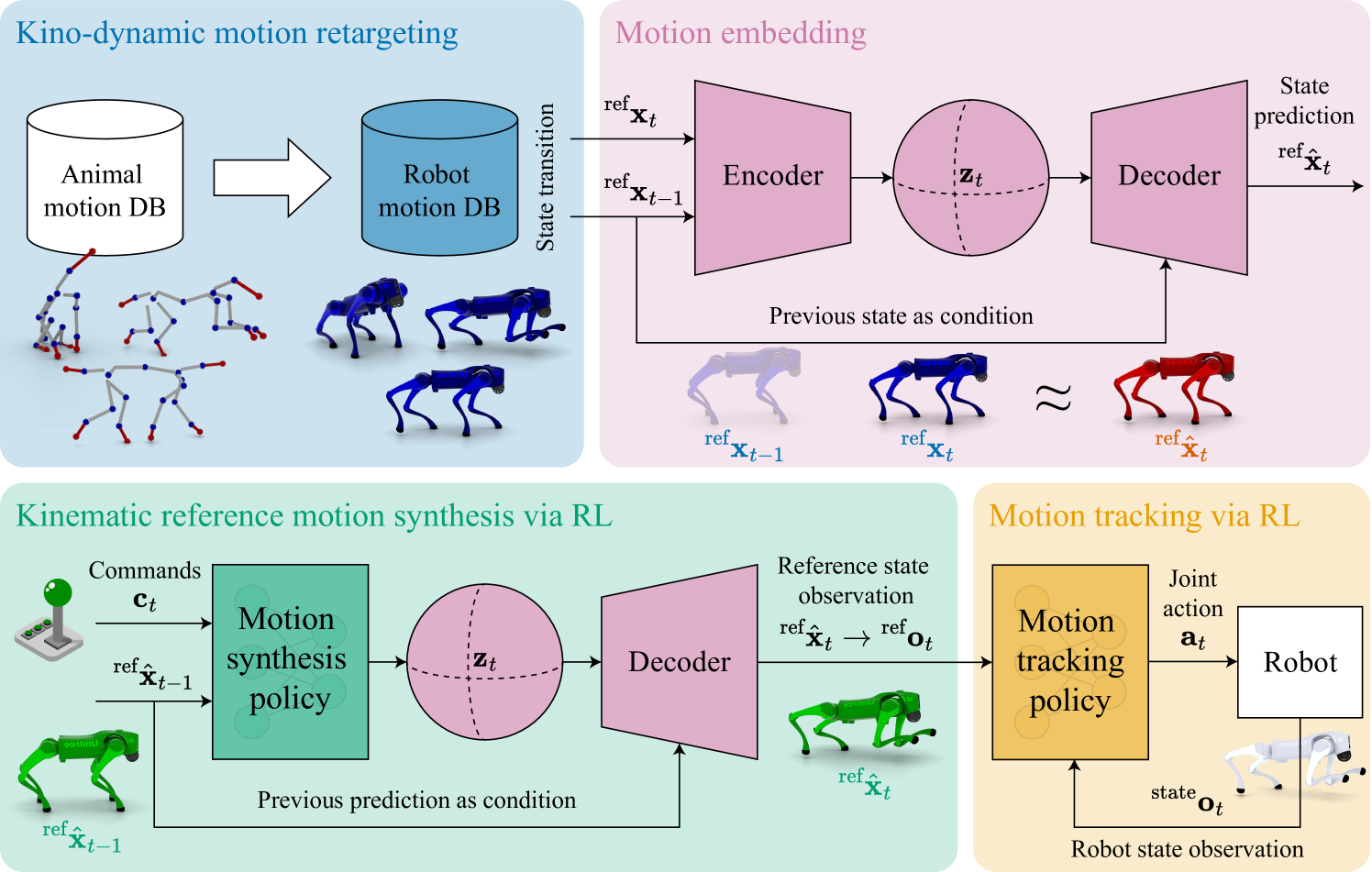

技术框架:该框架主要包含三个模块:1) 运动数据转换模块:使用约束逆运动学和模型预测控制将动物运动数据转换为机器人兼容的数据库。2) 运动合成模块:基于变分自编码器,学习运动数据库中的各种运动模式,并生成响应速度指令的平滑过渡。3) 反馈控制模块:使用强化学习训练反馈控制器,将运动合成模块生成的运动学运动作为参考,控制物理机器人。

关键创新:该方法最重要的创新点在于将非结构化的动物运动数据直接用于训练腿式机器人的控制器。通过约束逆运动学和模型预测控制,弥合了动物和机器人之间的形态和物理差距。此外,使用变分自编码器学习运动模式,并使用强化学习训练反馈控制器,实现了运动生成和控制的解耦。

关键设计:在运动数据转换模块中,需要仔细设计约束逆运动学的约束条件,以保证生成的运动是机器人可执行的。在运动合成模块中,变分自编码器的网络结构和损失函数的设计至关重要,需要保证生成的运动既具有多样性,又具有平滑性。在反馈控制模块中,需要选择合适的强化学习算法和奖励函数,以保证机器人能够精确地跟踪速度指令。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够使四足机器人自适应地切换步态,并准确地跟踪用户速度指令。与传统的控制方法相比,该方法能够生成更自然、更流畅的运动。此外,该方法还能够保持运动数据的风格一致性,使得机器人的运动看起来更像动物的运动。

🎯 应用场景

该研究成果可应用于搜救机器人、物流机器人、娱乐机器人等领域。通过模仿动物的运动方式,可以使机器人在复杂地形下更加灵活高效地移动。此外,该方法还可以用于开发更具表现力的机器人,例如用于舞蹈或表演的机器人。未来,该技术有望进一步推广到其他类型的机器人,例如人形机器人或水下机器人。

📄 摘要(原文)

This paper presents a control framework for legged robots that leverages unstructured real-world animal motion data to generate animal-like and user-steerable behaviors. Our framework learns to follow velocity commands while reproducing the diverse gait patterns in the original dataset. To begin with, animal motion data is transformed into a robot-compatible database using constrained inverse kinematics and model predictive control, bridging the morphological and physical gap between the animal and the robot. Subsequently, a variational autoencoder-based motion synthesis module captures the diverse locomotion patterns in the motion database and generates smooth transitions between them in response to velocity commands. The resulting kinematic motions serve as references for a reinforcement learning-based feedback controller deployed on physical robots. We show that this approach enables a quadruped robot to adaptively switch gaits and accurately track user velocity commands while maintaining the stylistic coherence of the motion data. Additionally, we provide component-wise evaluations to analyze the system's behavior in depth and demonstrate the efficacy of our method for more accurate and reliable motion imitation.