Hierarchical Vision-Language Planning for Multi-Step Humanoid Manipulation

作者: André Schakkal, Ben Zandonati, Zhutian Yang, Navid Azizan

分类: cs.RO

发布日期: 2025-06-28 (更新: 2025-07-10)

备注: Accepted at the RSS 2025 Workshop on Robot Planning in the Era of Foundation Models

💡 一句话要点

提出基于视觉-语言规划的分层控制框架,实现复杂人型机器人操作任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人型机器人 多步骤操作 视觉-语言模型 分层控制 强化学习 模仿学习 机器人规划

📋 核心要点

- 现有方法难以让人型机器人可靠地执行复杂的多步骤操作任务,限制了其在工业和家庭环境中的应用。

- 论文提出一种分层规划与控制框架,利用视觉-语言模型进行技能规划和监控,提高操作的可靠性。

- 在真实机器人实验中,该系统在非抓取拾取和放置任务中取得了73%的成功率,验证了方法的可行性。

📝 摘要(中文)

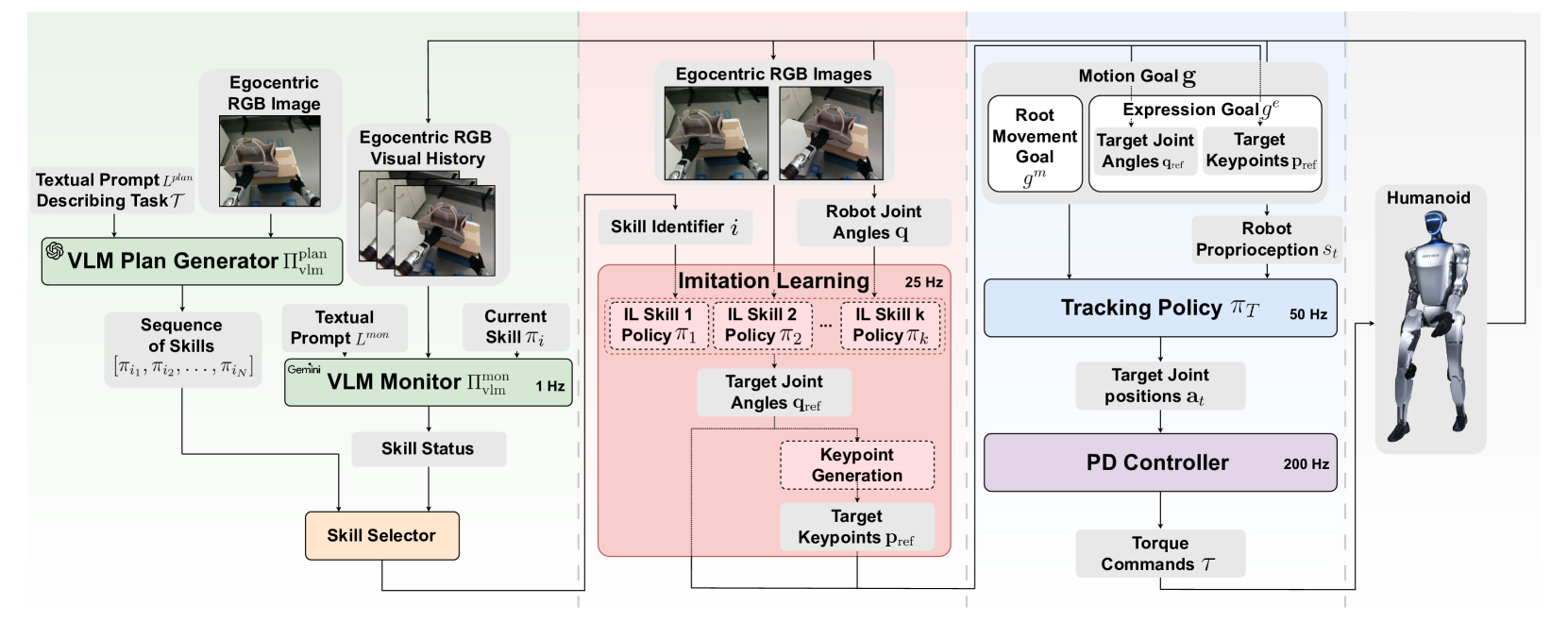

本文提出了一种分层规划与控制框架,旨在实现可靠的多步骤人型机器人操作。该系统包含三个层次:(1)一个基于强化学习的低层控制器,负责跟踪全身运动目标;(2)一组通过模仿学习训练的中层技能策略,为任务的不同步骤生成运动目标;(3)一个高层视觉-语言规划模块,利用预训练的视觉-语言模型(VLMs)确定应执行哪些技能,并实时监控其完成情况。在Unitree G1人型机器人上进行了一个非抓取拾取和放置任务的实验验证。在超过40次的真实世界试验中,该分层系统在完成完整操作序列时达到了73%的成功率。这些实验证实了所提出的分层系统的可行性,突出了基于VLM的技能规划和监控对于多步骤操作场景的益处。

🔬 方法详解

问题定义:论文旨在解决人型机器人执行复杂多步骤操作任务时的可靠性问题。现有方法在处理此类任务时,往往难以保证操作的稳定性和成功率,尤其是在需要感知环境并进行动态调整的情况下。这主要是因为缺乏有效的规划和监控机制,使得机器人难以根据实际情况选择合适的技能并及时纠正错误。

核心思路:论文的核心思路是将操作任务分解为多个步骤,并为每个步骤设计相应的技能策略。通过分层控制架构,将高层规划、中层技能执行和低层运动控制解耦,从而降低了问题的复杂性。同时,利用视觉-语言模型(VLM)进行技能规划和监控,使得机器人能够根据视觉信息选择合适的技能,并实时判断技能是否成功执行。

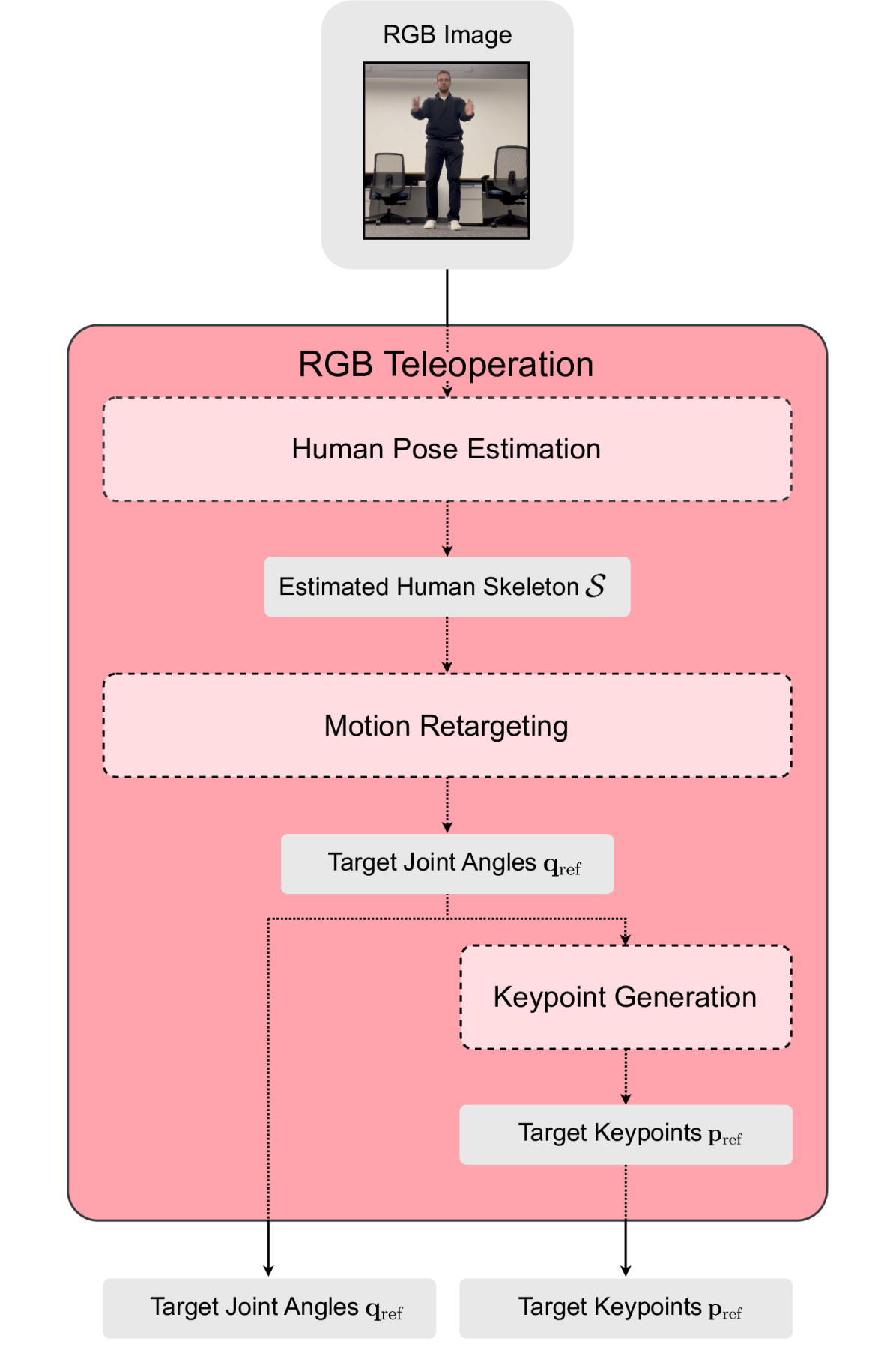

技术框架:该系统采用三层架构:(1)低层控制器:基于强化学习训练,负责跟踪全身运动目标,实现精确的运动控制。(2)中层技能策略:通过模仿学习训练,为任务的每个步骤生成运动目标。每个技能策略对应一个特定的操作动作,例如伸手、抓取、放置等。(3)高层视觉-语言规划模块:利用预训练的VLM,根据视觉输入和任务描述,选择合适的技能策略,并监控技能的执行情况。如果技能执行失败,则重新规划或调整策略。

关键创新:该论文的关键创新在于将视觉-语言模型(VLM)引入到人型机器人的操作规划和监控中。传统的机器人操作方法通常依赖于精确的环境建模和运动规划,但在复杂或动态环境中难以适用。通过利用VLM,机器人可以直接从视觉信息中理解环境和任务,并选择合适的技能策略。这种基于视觉的规划方法具有更强的鲁棒性和适应性。

关键设计:在技能策略的训练中,使用了模仿学习,通过学习人类专家的操作轨迹,快速获得有效的技能策略。VLM的选择和训练也至关重要,需要选择具有良好视觉理解和语言推理能力的模型,并针对特定的操作任务进行微调。此外,高层规划模块需要设计合理的奖励函数和状态表示,以便VLM能够有效地进行技能选择和监控。

🖼️ 关键图片

📊 实验亮点

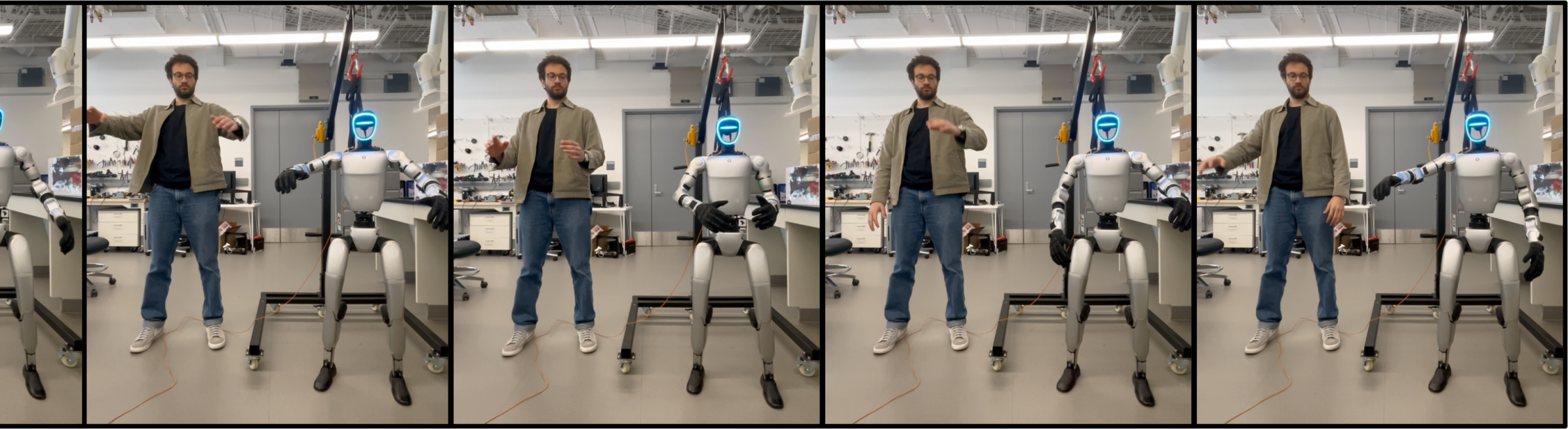

实验结果表明,该分层系统在Unitree G1人型机器人上成功完成了非抓取拾取和放置任务,在超过40次的真实世界试验中,达到了73%的成功率。这一结果验证了基于视觉-语言规划的分层控制框架的可行性,并表明VLM在人型机器人操作中具有重要的应用价值。与传统的基于模型的控制方法相比,该方法具有更强的鲁棒性和适应性。

🎯 应用场景

该研究成果可应用于工业自动化、家庭服务、医疗辅助等领域。例如,在工业环境中,人型机器人可以执行复杂的装配、搬运等任务;在家庭环境中,可以帮助老年人或残疾人完成日常活动;在医疗领域,可以辅助医生进行手术或康复治疗。该研究为实现通用型人型机器人操作奠定了基础。

📄 摘要(原文)

Enabling humanoid robots to reliably execute complex multi-step manipulation tasks is crucial for their effective deployment in industrial and household environments. This paper presents a hierarchical planning and control framework designed to achieve reliable multi-step humanoid manipulation. The proposed system comprises three layers: (1) a low-level RL-based controller responsible for tracking whole-body motion targets; (2) a mid-level set of skill policies trained via imitation learning that produce motion targets for different steps of a task; and (3) a high-level vision-language planning module that determines which skills should be executed and also monitors their completion in real-time using pretrained vision-language models (VLMs). Experimental validation is performed on a Unitree G1 humanoid robot executing a non-prehensile pick-and-place task. Over 40 real-world trials, the hierarchical system achieved a 73% success rate in completing the full manipulation sequence. These experiments confirm the feasibility of the proposed hierarchical system, highlighting the benefits of VLM-based skill planning and monitoring for multi-step manipulation scenarios. See https://vlp-humanoid.github.io/ for video demonstrations of the policy rollout.