Imitation Learning for Active Neck Motion Enabling Robot Manipulation beyond the Field of View

作者: Koki Nakagawa, Yoshiyuki Ohmura, Yasuo Kuniyoshi

分类: cs.RO

发布日期: 2025-06-21

备注: 6 pages

💡 一句话要点

提出主动颈部运动模仿学习方法,扩展机器人操作视野范围

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 机器人操作 主动颈部运动 视野扩展 深度学习

📋 核心要点

- 现有模仿学习方法依赖固定相机,视野受限,无法完成复杂操作。

- 提出教学系统和网络模型,使机器人学习主动颈部运动,扩展视野。

- 实验表明,该模型成功率高达90%,尤其擅长处理视野边缘物体。

📝 摘要(中文)

现有深度模仿学习研究主要依赖固定相机输入,限制了任务性能在预定义视野范围内。为了使机器人能够主动调整颈部,从而扩展模仿学习的应用范围,涵盖更广泛的任务和表达性动作(如颈部姿势),我们提出了一个教学系统,该系统系统地收集包含颈部运动的数据集,同时最大限度地减少远程操作过程中动态视点引起的不适。此外,我们还提出了一个新颖的网络模型,用于学习包含主动颈部运动的操作任务。实验结果表明,我们的模型可以达到约90%的高成功率,不受主动颈部运动引起的视点变化干扰。此外,所提出的模型在具有挑战性的场景中,例如当物体位于外围或超出标准视野范围时,尤其有效,而传统模型难以应对。该方法有助于提高数据集收集效率,并将模仿学习的应用扩展到更复杂和动态的场景。

🔬 方法详解

问题定义:现有基于模仿学习的机器人操作方法,通常采用固定视角的相机作为输入,这限制了机器人只能在预定义的视野范围内执行任务。当目标物体位于视野边缘或超出视野时,传统方法难以有效操作。因此,需要一种方法使机器人能够主动调整视角,从而扩展其操作范围。

核心思路:论文的核心思路是让机器人学习模仿人类的主动颈部运动,从而在执行操作任务的同时,能够动态调整视角,扩大视野范围。通过模仿学习,机器人可以学会何时以及如何移动颈部,以更好地观察和操作目标物体。

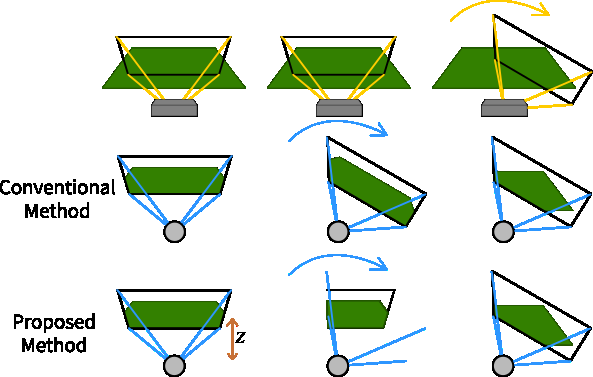

技术框架:该方法包含两个主要组成部分:1) 数据集收集系统:设计了一个教学系统,用于收集包含人类操作者颈部运动和操作动作的数据集。该系统旨在减少远程操作过程中的不适感。2) 网络模型:提出了一个新颖的神经网络模型,用于学习包含主动颈部运动的操作任务。该模型以图像作为输入,输出机器人的操作动作和颈部运动控制信号。

关键创新:该方法的主要创新在于将主动颈部运动引入到模仿学习框架中,使机器人能够动态调整视角,从而扩展了其操作范围。此外,提出的教学系统能够有效地收集包含颈部运动的数据集,并减少远程操作过程中的不适感。

关键设计:数据集收集系统通过优化远程操作界面和控制方式,减少了操作者因动态视点变化而产生的不适感。网络模型的设计考虑了颈部运动和操作动作之间的关系,可能采用了某种形式的注意力机制或时序建模方法,以更好地学习这种关系。具体的损失函数和网络结构细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的模型在包含主动颈部运动的操作任务中取得了约90%的成功率,即使在视点变化的情况下也能保持较高的性能。与传统模型相比,该模型在处理位于视野边缘或超出视野的物体时表现出显著的优势。这些结果表明,主动颈部运动可以有效地扩展机器人的操作范围,并提高其在复杂环境中的适应能力。

🎯 应用场景

该研究成果可应用于各种需要灵活视野的机器人操作任务,例如在狭窄空间或复杂环境中进行物体抓取、装配等。此外,该方法还可以扩展到其他需要主动感知的机器人应用,例如自主导航、目标搜索等。通过学习主动调整视角,机器人可以更好地感知环境,从而提高任务完成的效率和可靠性。

📄 摘要(原文)

Most prior research in deep imitation learning has predominantly utilized fixed cameras for image input, which constrains task performance to the predefined field of view. However, enabling a robot to actively maneuver its neck can significantly expand the scope of imitation learning to encompass a wider variety of tasks and expressive actions such as neck gestures. To facilitate imitation learning in robots capable of neck movement while simultaneously performing object manipulation, we propose a teaching system that systematically collects datasets incorporating neck movements while minimizing discomfort caused by dynamic viewpoints during teleoperation. In addition, we present a novel network model for learning manipulation tasks including active neck motion. Experimental results showed that our model can achieve a high success rate of around 90\%, regardless of the distraction from the viewpoint variations by active neck motion. Moreover, the proposed model proved particularly effective in challenging scenarios, such as when objects were situated at the periphery or beyond the standard field of view, where traditional models struggled. The proposed approach contributes to the efficiency of dataset collection and extends the applicability of imitation learning to more complex and dynamic scenarios.