WorldGym: World Model as An Environment for Policy Evaluation

作者: Julian Quevedo, Ansh Kumar Sharma, Yixiang Sun, Varad Suryavanshi, Percy Liang, Sherry Yang

分类: cs.RO, cs.AI

发布日期: 2025-05-31 (更新: 2025-09-30)

备注: https://world-model-eval.github.io

💡 一句话要点

WorldGym:基于世界模型的策略评估环境,降低机器人策略验证成本。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 世界模型 策略评估 机器人控制 视频生成 视觉-语言模型

📋 核心要点

- 真实机器人策略评估成本高昂,手工设计的模拟器在真实性和通用性方面难以提升,这是核心问题。

- WorldGym利用自回归视频生成模型模拟真实环境,结合视觉-语言模型提供奖励,实现高效策略评估。

- 实验表明,WorldGym中的策略成功率与真实世界高度相关,并能有效评估策略的泛化能力和鲁棒性。

📝 摘要(中文)

本文提出了一种基于世界模型的策略评估环境(WorldGym),它是一个自回归、动作条件视频生成模型,可以作为真实世界环境的代理。策略通过在世界模型中进行蒙特卡洛rollout来评估,并使用视觉-语言模型提供奖励。实验表明,仅使用来自真实机器人的初始帧,在世界模型中策略的成功率与真实世界中的成功率高度相关。此外,WorldGym能够保留不同策略版本、大小和训练检查点之间的相对策略排名。由于只需要单个起始帧作为输入,该世界模型还能够有效评估机器人策略在新任务和环境中的泛化能力。研究发现,现代基于VLA的机器人策略仍然难以区分物体形状,并且容易被物体的对抗性外观分散注意力。虽然生成高度逼真的物体交互仍然具有挑战性,但WorldGym忠实地模拟了机器人运动,并为部署前的安全和可重复的策略评估提供了一个实用的起点。

🔬 方法详解

问题定义:现有机器人控制策略的评估主要依赖于真实环境测试或手工设计的模拟器。真实环境测试成本高、耗时,且存在安全风险。手工设计的模拟器难以保证真实性,泛化能力有限,需要大量人工干预来提升其性能。因此,如何高效、低成本地评估机器人控制策略的性能是一个亟待解决的问题。

核心思路:本文的核心思路是利用世界模型(World Model)来模拟真实环境,从而实现策略的离线评估。具体而言,通过训练一个能够根据当前状态和动作预测未来状态的视频生成模型,可以构建一个虚拟的机器人交互环境。然后,可以在这个虚拟环境中运行机器人控制策略,并根据视觉-语言模型的奖励信号来评估策略的性能。这种方法避免了在真实环境中进行昂贵的实验,并提供了一个安全、可控的策略评估平台。

技术框架:WorldGym的整体框架包括以下几个主要模块:1) 世界模型:一个自回归、动作条件视频生成模型,用于模拟机器人与环境的交互过程。该模型以当前状态(图像)和动作作为输入,预测下一时刻的状态(图像)。2) 策略:待评估的机器人控制策略,它根据当前状态输出动作。3) 视觉-语言模型:用于提供奖励信号,评估策略在虚拟环境中的表现。该模型根据当前状态(图像)和任务描述(文本)输出奖励值。4) 蒙特卡洛Rollout:在世界模型中运行策略,并使用视觉-语言模型提供的奖励信号来评估策略的性能。

关键创新:该论文的关键创新在于将世界模型应用于机器人控制策略的评估。与传统的手工设计的模拟器相比,世界模型能够自动学习环境的动态特性,从而更好地模拟真实环境。此外,该方法只需要少量真实数据(初始帧)即可进行策略评估,大大降低了数据采集的成本。通过视觉-语言模型提供奖励,可以灵活地定义不同的任务,从而实现对策略泛化能力的评估。

关键设计:世界模型采用自回归的视频生成模型,例如Transformer或扩散模型,以学习环境的动态特性。动作信息通过条件输入的方式融入到视频生成过程中。视觉-语言模型可以使用预训练的CLIP模型,并根据具体任务进行微调。奖励函数的设计需要仔细考虑,以确保能够准确反映策略的性能。蒙特卡洛Rollout的长度需要根据具体任务进行调整,以平衡评估的准确性和计算成本。

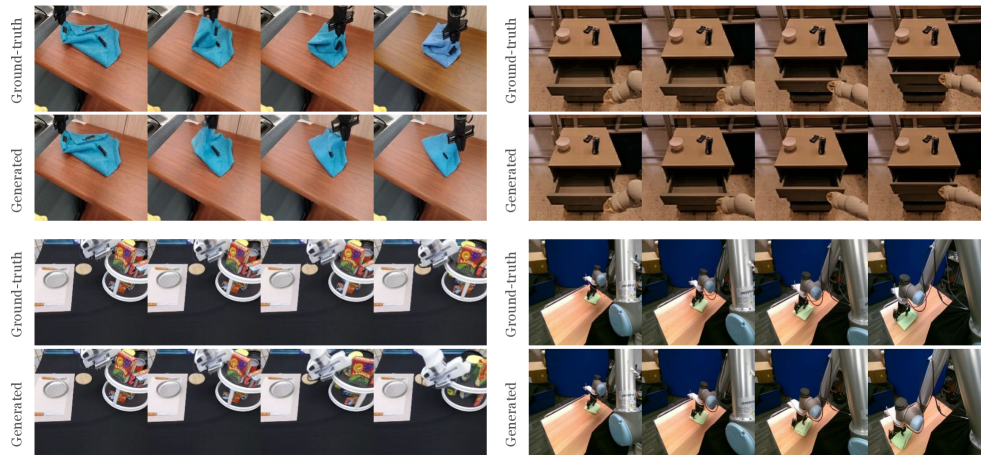

🖼️ 关键图片

📊 实验亮点

实验结果表明,WorldGym能够有效地评估机器人控制策略的性能,并且在世界模型中策略的成功率与真实世界中的成功率高度相关。此外,WorldGym能够保留不同策略版本、大小和训练检查点之间的相对策略排名。该研究还发现,现有的基于VLA的机器人策略在区分物体形状方面存在不足,容易受到对抗性外观的影响。

🎯 应用场景

WorldGym可应用于机器人控制策略的离线评估、强化学习算法的训练和验证、以及机器人泛化能力的测试。该研究成果有助于降低机器人研发成本,加速机器人技术在工业自动化、医疗健康、家庭服务等领域的应用。未来,可以进一步探索如何利用WorldGym进行策略优化和自动生成,从而实现更智能、更自主的机器人系统。

📄 摘要(原文)

Evaluating robot control policies is difficult: real-world testing is costly, and handcrafted simulators require manual effort to improve in realism and generality. We propose a world-model-based policy evaluation environment (WorldGym), an autoregressive, action-conditioned video generation model which serves as a proxy to real world environments. Policies are evaluated via Monte Carlo rollouts in the world model, with a vision-language model providing rewards. We evaluate a set of VLA-based real-robot policies in the world model using only initial frames from real robots, and show that policy success rates within the world model highly correlate with real-world success rates. Moreoever, we show that WorldGym is able to preserve relative policy rankings across different policy versions, sizes, and training checkpoints. Due to requiring only a single start frame as input, the world model further enables efficient evaluation of robot policies' generalization ability on novel tasks and environments. We find that modern VLA-based robot policies still struggle to distinguish object shapes and can become distracted by adversarial facades of objects. While generating highly realistic object interaction remains challenging, WorldGym faithfully emulates robot motions and offers a practical starting point for safe and reproducible policy evaluation before deployment.