Anomalies by Synthesis: Anomaly Detection using Generative Diffusion Models for Off-Road Navigation

作者: Siddharth Ancha, Sunshine Jiang, Travis Manderson, Laura Brandt, Yilun Du, Philip R. Osteen, Nicholas Roy

分类: cs.RO, cs.CV, cs.LG

发布日期: 2025-05-28

备注: Presented at ICRA 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于生成扩散模型的异常检测方法,用于越野导航中识别未知环境障碍物。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 异常检测 生成扩散模型 越野导航 分布外检测 视觉-语言模型

📋 核心要点

- 现有越野导航方法难以有效检测训练数据之外的异常情况,对未知环境的适应性不足。

- 利用生成扩散模型合成无异常图像,通过分析图像编辑区域来定位异常,无需预先假设异常类型。

- 提出引导扩散的新推理方法,并结合视觉-语言模型进行语义分析,提升了异常检测的准确性。

📝 摘要(中文)

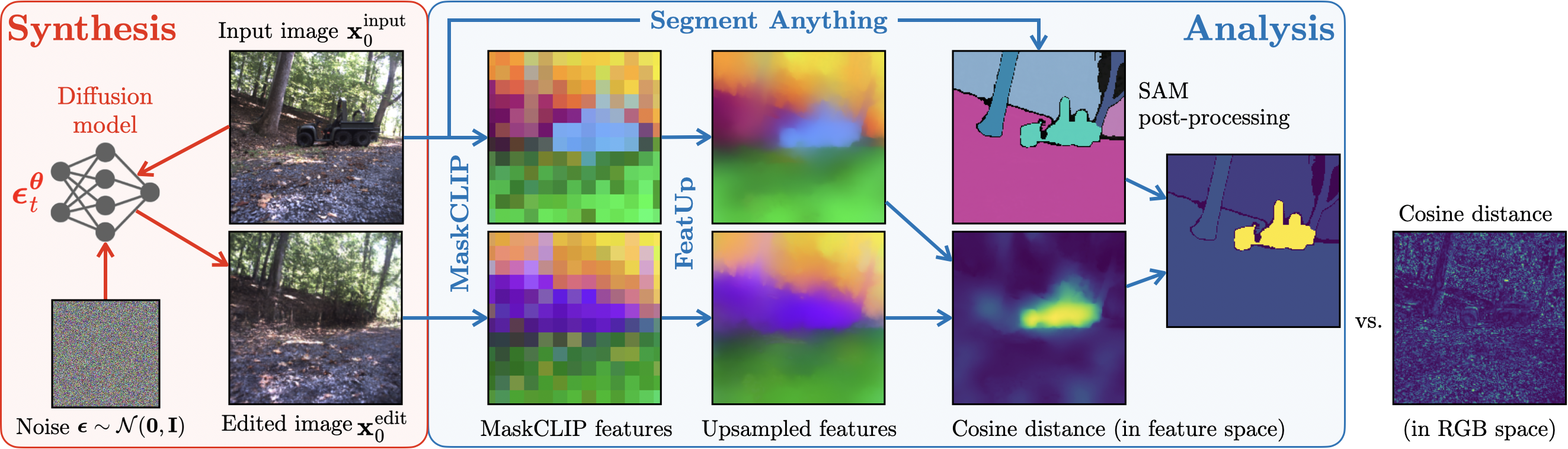

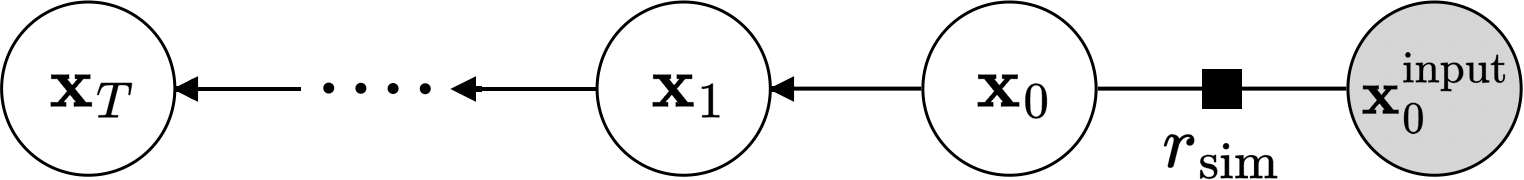

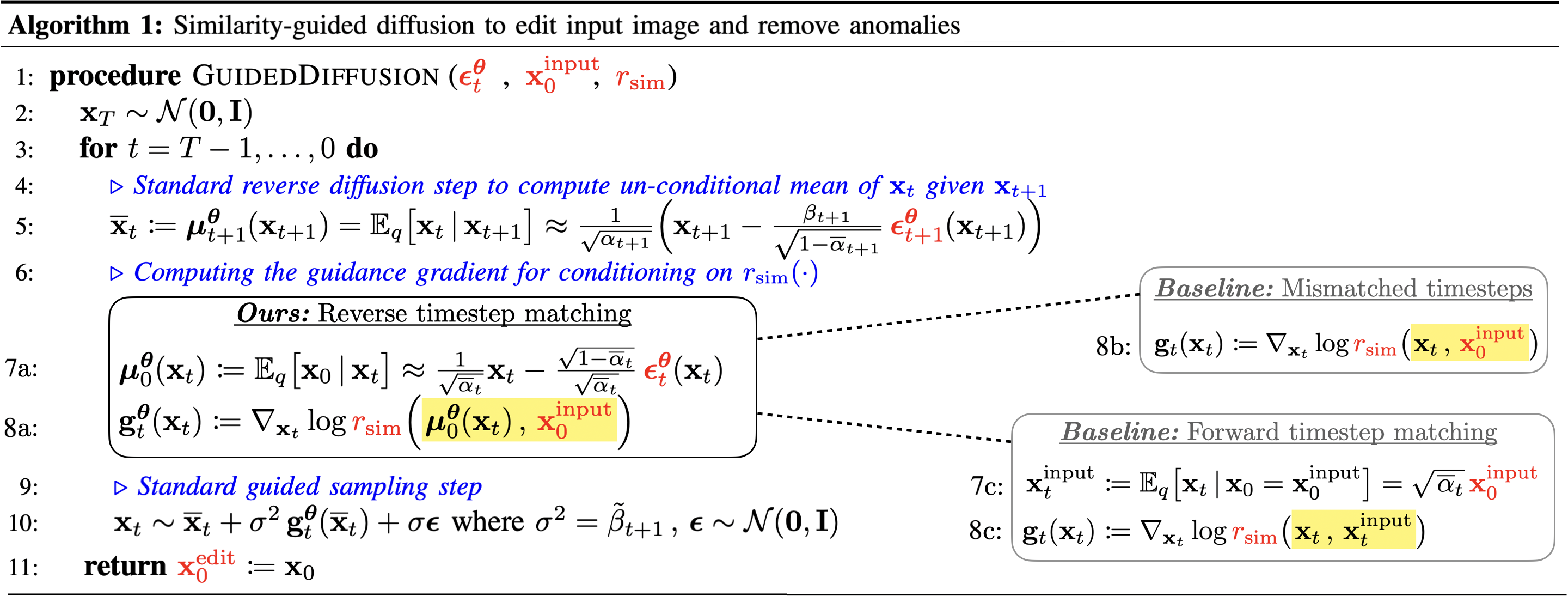

为了在越野和非结构化环境中安全可靠地导航,机器人必须检测相对于训练数据而言的分布外(OOD)异常。本文提出了一种分析-综合方法,用于像素级异常检测,且不对OOD数据的性质做任何假设。给定输入图像,我们使用生成扩散模型来合成编辑后的图像,该图像消除了异常,同时保持图像的其余部分不变。然后,我们将异常检测表述为分析哪些图像片段被扩散模型修改。我们提出了一种新颖的推理方法,通过分析理想的引导梯度并推导出引导扩散的原则性近似,引导扩散模型来预测引导梯度。我们的编辑技术纯粹是测试时技术,可以集成到现有工作流程中,而无需重新训练或微调。最后,我们使用视觉-语言基础模型的组合,在学习的特征空间中比较像素,并检测语义上有意义的编辑,从而为越野导航实现准确的异常检测。

🔬 方法详解

问题定义:越野导航中的异常检测问题,即识别不在训练数据分布中的障碍物或地形。现有方法通常依赖于对特定类型异常的假设,或者需要大量带标签的异常数据进行训练,泛化能力有限。该论文旨在解决在没有关于OOD数据先验知识的情况下,如何进行像素级别的异常检测问题。

核心思路:核心思想是“分析-综合”。首先,使用生成扩散模型对输入图像进行编辑,去除其中的异常部分,同时保持图像的其余部分不变。然后,通过比较原始图像和编辑后的图像,分析哪些区域被修改,从而定位异常。这种方法的关键在于,扩散模型能够学习到正常场景的分布,并能够生成合理的无异常图像。

技术框架:整体流程包括以下几个步骤:1. 输入图像:获取包含潜在异常的越野场景图像。2. 扩散模型编辑:使用训练好的生成扩散模型,以输入图像为条件,生成一个编辑后的图像,该图像尽可能地消除异常,同时保持背景不变。3. 异常区域分析:比较原始图像和编辑后的图像,计算像素级别的差异。差异较大的区域被认为是异常区域。4. 语义验证:使用视觉-语言模型,在学习的特征空间中比较像素,检测语义上有意义的编辑,进一步提高异常检测的准确性。

关键创新:主要创新点在于:1. 将生成扩散模型应用于异常检测,利用其强大的生成能力合成无异常图像。2. 提出了一种新颖的引导扩散推理方法,通过分析理想的引导梯度并推导出近似,引导扩散模型预测引导梯度,从而更有效地消除异常。3. 结合视觉-语言模型进行语义验证,提高了异常检测的准确性和鲁棒性。

关键设计:1. 扩散模型:使用预训练的扩散模型,并在越野导航数据集上进行微调。2. 引导梯度:设计了一种基于梯度的引导策略,引导扩散模型生成无异常图像。3. 视觉-语言模型:使用CLIP等视觉-语言模型,提取图像的语义特征,用于比较原始图像和编辑后图像的语义差异。4. 损失函数:使用像素级别的差异作为损失函数,用于训练扩散模型和评估异常区域。

🖼️ 关键图片

📊 实验亮点

该方法在越野导航数据集上取得了显著的异常检测效果。通过与现有方法的对比,表明该方法能够更准确地检测出各种类型的异常,包括植被、岩石、坑洼等。实验结果表明,该方法在像素级别的异常检测精度方面优于现有方法,并且具有更好的泛化能力。

🎯 应用场景

该研究成果可广泛应用于越野机器人的自主导航、自动驾驶、农业机器人等领域。通过准确检测未知环境中的异常情况,可以提高机器人的安全性和可靠性,使其能够在复杂和非结构化的环境中安全地执行任务。此外,该方法还可以应用于工业缺陷检测、医疗图像分析等领域。

📄 摘要(原文)

In order to navigate safely and reliably in off-road and unstructured environments, robots must detect anomalies that are out-of-distribution (OOD) with respect to the training data. We present an analysis-by-synthesis approach for pixel-wise anomaly detection without making any assumptions about the nature of OOD data. Given an input image, we use a generative diffusion model to synthesize an edited image that removes anomalies while keeping the remaining image unchanged. Then, we formulate anomaly detection as analyzing which image segments were modified by the diffusion model. We propose a novel inference approach for guided diffusion by analyzing the ideal guidance gradient and deriving a principled approximation that bootstraps the diffusion model to predict guidance gradients. Our editing technique is purely test-time that can be integrated into existing workflows without the need for retraining or fine-tuning. Finally, we use a combination of vision-language foundation models to compare pixels in a learned feature space and detect semantically meaningful edits, enabling accurate anomaly detection for off-road navigation. Project website: https://siddancha.github.io/anomalies-by-diffusion-synthesis/