DexUMI: Using Human Hand as the Universal Manipulation Interface for Dexterous Manipulation

作者: Mengda Xu, Han Zhang, Yifan Hou, Zhenjia Xu, Linxi Fan, Manuela Veloso, Shuran Song

分类: cs.RO

发布日期: 2025-05-28 (更新: 2025-10-02)

💡 一句话要点

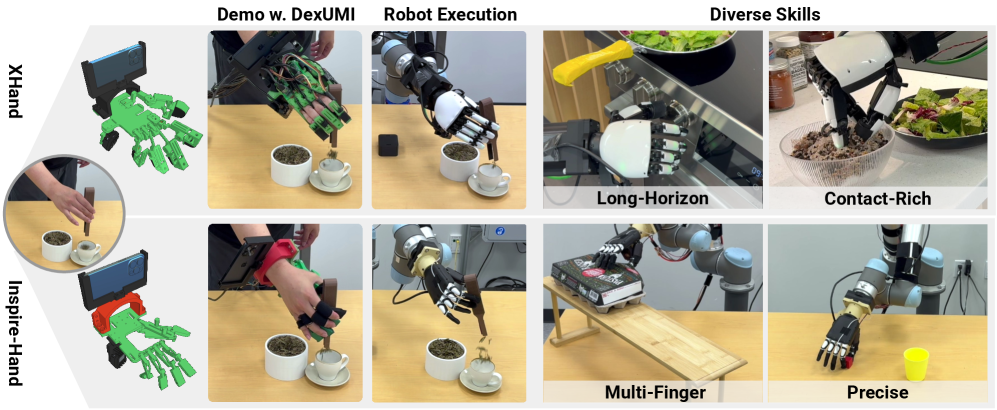

DexUMI:利用人手作为通用操控界面,实现灵巧操作技能迁移

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 灵巧操作 机器人手 技能迁移 人机交互 外骨骼 图像修复 模仿学习

📋 核心要点

- 现有灵巧操作技能迁移方法难以有效弥合人手与机器人手在运动学和视觉上的差距,限制了迁移效果。

- DexUMI框架通过硬件外骨骼和软件图像修复,分别弥合运动学和视觉差距,实现更自然的技能迁移。

- 在两种不同机器人手平台上进行的实验表明,DexUMI能够有效提升灵巧操作任务的成功率,平均达到86%。

📝 摘要(中文)

本文提出DexUMI,一个数据收集和策略学习框架,它使用人手作为自然界面,将灵巧操作技能迁移到各种机器人手上。DexUMI包括硬件和软件适配,以最小化人手和各种机器人手之间的具身差距。硬件适配使用可穿戴手部外骨骼来弥合运动学差距,允许在操作数据采集中进行直接触觉反馈,并将人类运动调整为可行的机器人手部运动。软件适配通过用高保真机器人手部图像修复来替换视频数据中的人手,从而弥合视觉差距。我们通过在两个不同的灵巧机器人手硬件平台上进行的全面真实世界实验,展示了DexUMI的能力,实现了平均86%的任务成功率。

🔬 方法详解

问题定义:论文旨在解决如何将人类的灵巧操作技能有效地迁移到不同的机器人手上。现有方法通常难以克服人手与机器人手在运动学结构和视觉感知上的差异,导致迁移效果不佳。例如,直接示教可能因为机器人手无法完全复现人类手的运动范围而失败,而基于视觉的模仿学习则可能受到人手外观与机器人手差异的影响。

核心思路:论文的核心思路是将人手作为机器人手的通用操控界面,通过硬件和软件的适配,缩小人手与机器人手之间的“具身差距”。具体来说,使用可穿戴外骨骼来约束人类手的运动,使其更接近机器人手的运动范围,并通过图像修复技术将视频中的人手替换为机器人手,从而消除视觉上的差异。

技术框架:DexUMI框架包含两个主要组成部分:硬件适配和软件适配。硬件适配部分使用可穿戴手部外骨骼,该外骨骼能够捕捉人类手的运动,并将其映射到机器人手的运动空间。同时,外骨骼还提供触觉反馈,帮助人类操作者更好地控制机器人手。软件适配部分则利用图像修复技术,将采集到的视频数据中的人手替换为高保真度的机器人手图像,从而生成更适合机器人学习的数据集。整个流程包括数据采集、运动映射、图像修复和策略学习等步骤。

关键创新:该论文的关键创新在于提出了一个完整的框架,同时考虑了运动学和视觉上的适配问题,并分别通过硬件和软件手段加以解决。这种综合性的方法能够更有效地弥合人手与机器人手之间的差距,从而实现更自然的技能迁移。此外,使用外骨骼进行触觉反馈也增强了人机交互的自然性。

关键设计:硬件方面,外骨骼的设计需要考虑到不同机器人手的运动范围和自由度,运动映射算法需要保证映射的准确性和实时性。软件方面,图像修复算法需要能够生成逼真的机器人手图像,并保持视频的连贯性。策略学习部分可以使用各种强化学习或模仿学习算法,损失函数的设计需要考虑到任务的特定需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DexUMI框架在两个不同的灵巧机器人手硬件平台上均取得了显著的成功,平均任务成功率达到86%。这表明该框架具有良好的泛化能力和实用价值。此外,与没有进行硬件和软件适配的基线方法相比,DexUMI框架能够显著提高任务成功率,证明了其有效性。

🎯 应用场景

DexUMI框架具有广泛的应用前景,例如在远程操作、医疗康复、工业自动化等领域。通过该框架,人类操作者可以利用自己的灵巧技能,远程控制机器人手执行各种复杂任务,例如精细装配、手术操作等。此外,该框架还可以用于训练机器人手,使其能够自主完成各种任务,从而提高生产效率和安全性。

📄 摘要(原文)

We present DexUMI - a data collection and policy learning framework that uses the human hand as the natural interface to transfer dexterous manipulation skills to various robot hands. DexUMI includes hardware and software adaptations to minimize the embodiment gap between the human hand and various robot hands. The hardware adaptation bridges the kinematics gap using a wearable hand exoskeleton. It allows direct haptic feedback in manipulation data collection and adapts human motion to feasible robot hand motion. The software adaptation bridges the visual gap by replacing the human hand in video data with high-fidelity robot hand inpainting. We demonstrate DexUMI's capabilities through comprehensive real-world experiments on two different dexterous robot hand hardware platforms, achieving an average task success rate of 86%.