CLAMP: Crowdsourcing a LArge-scale in-the-wild haptic dataset with an open-source device for Multimodal robot Perception

作者: Pranav N. Thakkar, Shubhangi Sinha, Karan Baijal, Yuhan, Bian, Leah Lackey, Ben Dodson, Heisen Kong, Jueun Kwon, Amber Li, Yifei Hu, Alexios Rekoutis, Tom Silver, Tapomayukh Bhattacharjee

分类: cs.RO

发布日期: 2025-05-27 (更新: 2026-01-12)

💡 一句话要点

CLAMP:众包大规模真实场景触觉数据集,用于多模态机器人感知

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 触觉感知 多模态融合 机器人操作 数据集构建 深度学习

📋 核心要点

- 现有机器人操作方法难以仅通过视觉信息准确感知物体材质和柔顺性等属性,限制了其在非结构化环境中的鲁棒性。

- 论文提出CLAMP设备,通过众包方式收集大规模真实场景多模态触觉数据,构建CLAMP数据集,用于训练触觉编码器。

- 实验表明,基于CLAMP数据集训练的视觉-触觉感知模型在材料识别和机器人操作任务中表现出色,具有良好的泛化能力。

📝 摘要(中文)

为了提升机器人非结构化环境下的操作能力,需要理解物体超越几何形状的属性,例如材质或柔顺性,而这些属性仅靠视觉信息难以推断。多模态触觉感知为推断这些属性提供了一条有希望的途径,但缺乏大规模、多样化和真实的触觉数据集限制了进展。本文介绍了CLAMP设备,一种低成本(<200美元)的传感器化抓取器,旨在从日常环境中非专业用户处收集大规模、真实场景的多模态触觉数据。我们将16个CLAMP设备部署给41名参与者,产生了CLAMP数据集,这是迄今为止最大的开源多模态触觉数据集,包含来自5357个家用物品的1230万个数据点。利用该数据集,我们训练了一个触觉编码器,可以从多模态触觉数据中推断材质和柔顺性等物体属性。我们利用这个编码器创建了CLAMP模型,一个用于材料识别的视觉-触觉感知模型,可以推广到新物体和三种机器人形态,只需进行最小的微调。我们还在三个真实世界的机器人操作任务中展示了我们模型的有效性:对可回收和不可回收垃圾进行分类,从杂乱的袋子中检索物体,以及区分过熟和成熟的香蕉。结果表明,大规模、真实场景的触觉数据收集可以为通用机器人操作解锁新的能力。

🔬 方法详解

问题定义:现有机器人操作任务中,仅依赖视觉信息难以准确感知物体的材质、柔顺性等物理属性,导致机器人难以在复杂、非结构化的环境中进行可靠的操作。缺乏大规模、多样化的真实场景触觉数据集是制约相关研究进展的关键瓶颈。

核心思路:论文的核心思路是通过低成本的传感器化设备CLAMP,以众包的方式收集大规模的真实场景多模态触觉数据。通过构建足够大的数据集,训练深度学习模型,使机器人能够学习到触觉信息与物体属性之间的关联,从而提升其感知和操作能力。

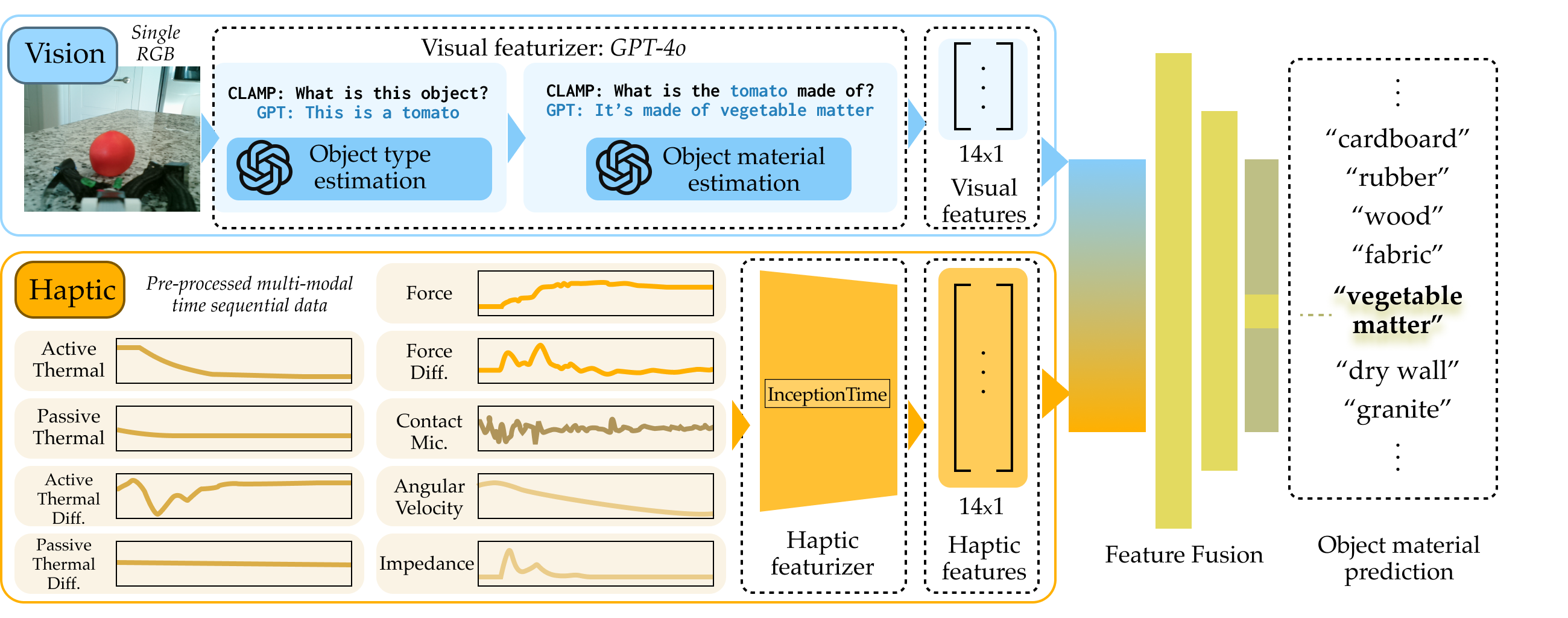

技术框架:整体框架包括三个主要部分:1) CLAMP设备的设计与部署,用于收集多模态触觉数据;2) CLAMP数据集的构建,包含来自大量家用物品的触觉数据;3) 基于CLAMP数据集训练的视觉-触觉感知模型(CLAMP模型),用于材料识别和机器人操作任务。CLAMP模型包含一个触觉编码器,用于从触觉数据中提取特征,并结合视觉信息进行物体属性的预测。

关键创新:论文的关键创新在于:1) 提出了低成本、易于部署的CLAMP设备,实现了大规模真实场景触觉数据的众包收集;2) 构建了迄今为止最大的开源多模态触觉数据集CLAMP,为相关研究提供了宝贵资源;3) 提出了基于视觉-触觉融合的CLAMP模型,在材料识别和机器人操作任务中表现出良好的泛化能力。

关键设计:CLAMP设备采用低成本的传感器,包括力传感器、电流传感器等,用于捕捉抓取过程中的力、扭矩、电流等信息。数据集包含来自5357个家用物品的1230万个数据点。CLAMP模型采用深度神经网络结构,包括触觉编码器和视觉编码器,通过对比学习等方法进行训练,学习触觉和视觉信息之间的关联。损失函数的设计旨在提高模型在材料识别和机器人操作任务中的准确性和鲁棒性。

🖼️ 关键图片

📊 实验亮点

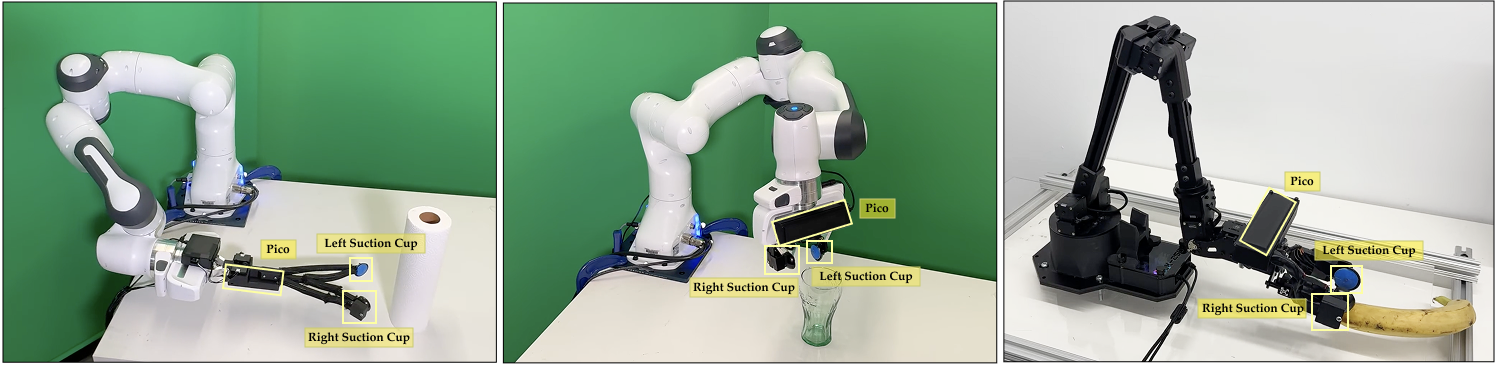

实验结果表明,基于CLAMP数据集训练的CLAMP模型在材料识别任务中取得了显著的性能提升,能够推广到新物体和三种不同的机器人形态,只需进行最小的微调。在三个真实世界的机器人操作任务中,包括垃圾分类、物体检索和香蕉成熟度判断,CLAMP模型均表现出良好的性能,验证了大规模真实场景触觉数据收集的有效性。

🎯 应用场景

该研究成果可广泛应用于机器人操作领域,例如智能家居、自动化仓库、废品回收等场景。通过提升机器人对物体属性的感知能力,可以实现更智能、更高效的物体抓取、分类和操作。未来,该技术有望应用于医疗、农业等领域,助力机器人完成更复杂、更精细的任务。

📄 摘要(原文)

Robust robot manipulation in unstructured environments often requires understanding object properties that extend beyond geometry, such as material or compliance-properties that can be challenging to infer using vision alone. Multimodal haptic sensing provides a promising avenue for inferring such properties, yet progress has been constrained by the lack of large, diverse, and realistic haptic datasets. In this work, we introduce the CLAMP device, a low-cost (<\$200) sensorized reacher-grabber designed to collect large-scale, in-the-wild multimodal haptic data from non-expert users in everyday settings. We deployed 16 CLAMP devices to 41 participants, resulting in the CLAMP dataset, the largest open-source multimodal haptic dataset to date, comprising 12.3 million datapoints across 5357 household objects. Using this dataset, we train a haptic encoder that can infer material and compliance object properties from multimodal haptic data. We leverage this encoder to create the CLAMP model, a visuo-haptic perception model for material recognition that generalizes to novel objects and three robot embodiments with minimal finetuning. We also demonstrate the effectiveness of our model in three real-world robot manipulation tasks: sorting recyclable and non-recyclable waste, retrieving objects from a cluttered bag, and distinguishing overripe from ripe bananas. Our results show that large-scale, in-the-wild haptic data collection can unlock new capabilities for generalizable robot manipulation. Website: https://emprise.cs.cornell.edu/clamp/