EgoWalk: A Multimodal Dataset for Robot Navigation in the Wild

作者: Timur Akhtyamov, Mohamad Al Mdfaa, Javier Antonio Ramirez, Sergey Bakulin, German Devchich, Denis Fatykhov, Alexander Mazurov, Kristina Zipa, Malik Mohrat, Pavel Kolesnik, Ivan Sosin, Gonzalo Ferrer

分类: cs.RO

发布日期: 2025-05-27

💡 一句话要点

EgoWalk:用于机器人野外导航的多模态数据集

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人导航 多模态数据集 模仿学习 自然语言处理 可通行性分割

📋 核心要点

- 数据驱动的导航算法严重依赖大规模、高质量的真实世界数据,以实现成功的训练和在不受控条件下的鲁棒性能。

- EgoWalk数据集通过记录人类在各种环境下的导航行为,为机器人导航算法提供更真实、多样化的训练数据。

- 该数据集不仅包含原始数据,还提供了自动生成自然语言目标标注和可通行性分割掩码的pipeline,方便研究人员进行多任务学习。

📝 摘要(中文)

为了提升导航领域真实世界数据集的规模和质量,本文提出了EgoWalk数据集,它包含50小时的人类导航数据,涵盖了室内/室外、不同季节和多种环境。除了原始数据和可用于模仿学习的数据外,本文还提供了多个pipeline,用于自动创建辅助数据集,以支持其他导航相关任务,例如自然语言目标标注和可通行性分割掩码。通过多样性研究、用例和基准测试,证明了该数据集的实际应用价值。所有数据处理pipeline和数据采集硬件平台的描述都将开源,以支持机器人导航系统未来的研究和开发。

🔬 方法详解

问题定义:现有的数据驱动导航算法在真实、不受控的环境中表现不佳,主要原因是缺乏大规模、高质量的真实世界训练数据。现有数据集在环境多样性、季节变化和数据量方面存在局限性,难以满足复杂导航任务的需求。

核心思路:EgoWalk数据集的核心思路是通过记录人类在各种真实环境下的第一人称视角导航行为,为机器人导航算法提供更具代表性的训练数据。通过模仿人类的导航策略,机器人可以更好地适应真实世界的复杂性和不确定性。

技术框架:EgoWalk数据集的构建流程主要包括数据采集、数据处理和数据集构建三个阶段。数据采集阶段使用配备多种传感器的硬件平台记录人类的导航过程。数据处理阶段对原始数据进行清洗、校准和同步。数据集构建阶段则基于处理后的数据,生成用于模仿学习、自然语言目标标注和可通行性分割掩码等任务的数据集。

关键创新:EgoWalk数据集的关键创新在于其数据规模、环境多样性和自动化数据生成pipeline。50小时的数据量远大于许多现有的导航数据集,涵盖了室内/室外、不同季节和多种环境。自动生成自然语言目标标注和可通行性分割掩码的pipeline大大降低了数据标注的成本,并为多任务学习提供了便利。

关键设计:数据采集平台配备了多种传感器,包括RGB相机、深度相机、IMU和GPS,以获取全面的环境信息。数据处理pipeline采用了卡尔曼滤波等算法,对传感器数据进行校准和融合。自然语言目标标注pipeline使用了预训练的语言模型,自动生成目标描述。可通行性分割掩码pipeline使用了深度学习模型,对图像进行像素级别的分割。

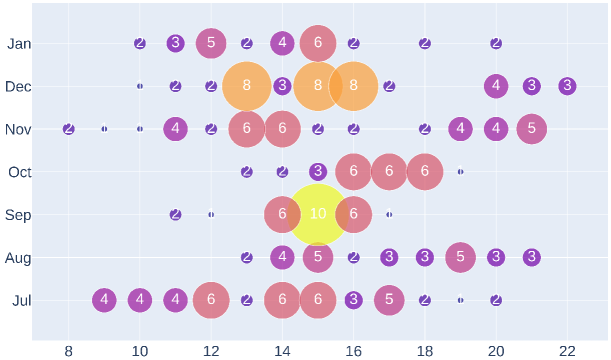

🖼️ 关键图片

📊 实验亮点

EgoWalk数据集包含50小时的真实世界导航数据,涵盖了多种环境和季节。通过在EgoWalk数据集上进行模仿学习,机器人导航算法的性能得到了显著提升。实验结果表明,使用EgoWalk数据集训练的机器人可以在未知的环境中实现更鲁棒的导航,并且能够更好地理解自然语言目标。

🎯 应用场景

EgoWalk数据集可广泛应用于机器人导航、自动驾驶、增强现实等领域。通过在该数据集上训练,机器人可以在复杂的室内外环境中实现自主导航,例如在家庭、办公室、商场等场所提供导览、清洁、配送等服务。该数据集也有助于提升自动驾驶系统在城市道路上的导航能力,并为增强现实应用提供更真实的环境感知。

📄 摘要(原文)

Data-driven navigation algorithms are critically dependent on large-scale, high-quality real-world data collection for successful training and robust performance in realistic and uncontrolled conditions. To enhance the growing family of navigation-related real-world datasets, we introduce EgoWalk - a dataset of 50 hours of human navigation in a diverse set of indoor/outdoor, varied seasons, and location environments. Along with the raw and Imitation Learning-ready data, we introduce several pipelines to automatically create subsidiary datasets for other navigation-related tasks, namely natural language goal annotations and traversability segmentation masks. Diversity studies, use cases, and benchmarks for the proposed dataset are provided to demonstrate its practical applicability. We openly release all data processing pipelines and the description of the hardware platform used for data collection to support future research and development in robot navigation systems.