Integrating emotional intelligence, memory architecture, and gestures to achieve empathetic humanoid robot interaction in an educational setting

作者: Fuze Sun, Lingyu Li, Shixiangyue Meng, Xiaoming Teng, Terry R. Payne, Paul Craig

分类: cs.RO

发布日期: 2025-05-26 (更新: 2025-08-19)

💡 一句话要点

集成情商、记忆架构和手势,实现教育场景中具身同理心人机交互

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 教育机器人 同理心 情感识别 大型语言模型 个性化学习 具身智能

📋 核心要点

- 现有HRI研究缺乏对情商、记忆和非语言交流等特征在教育框架中的同步整合。

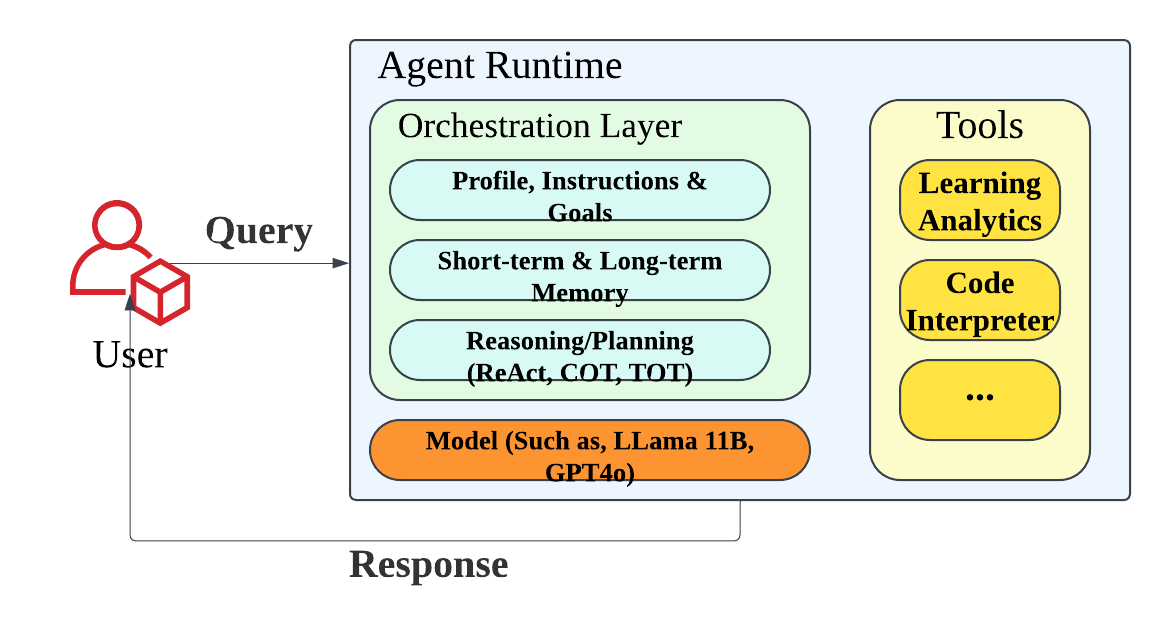

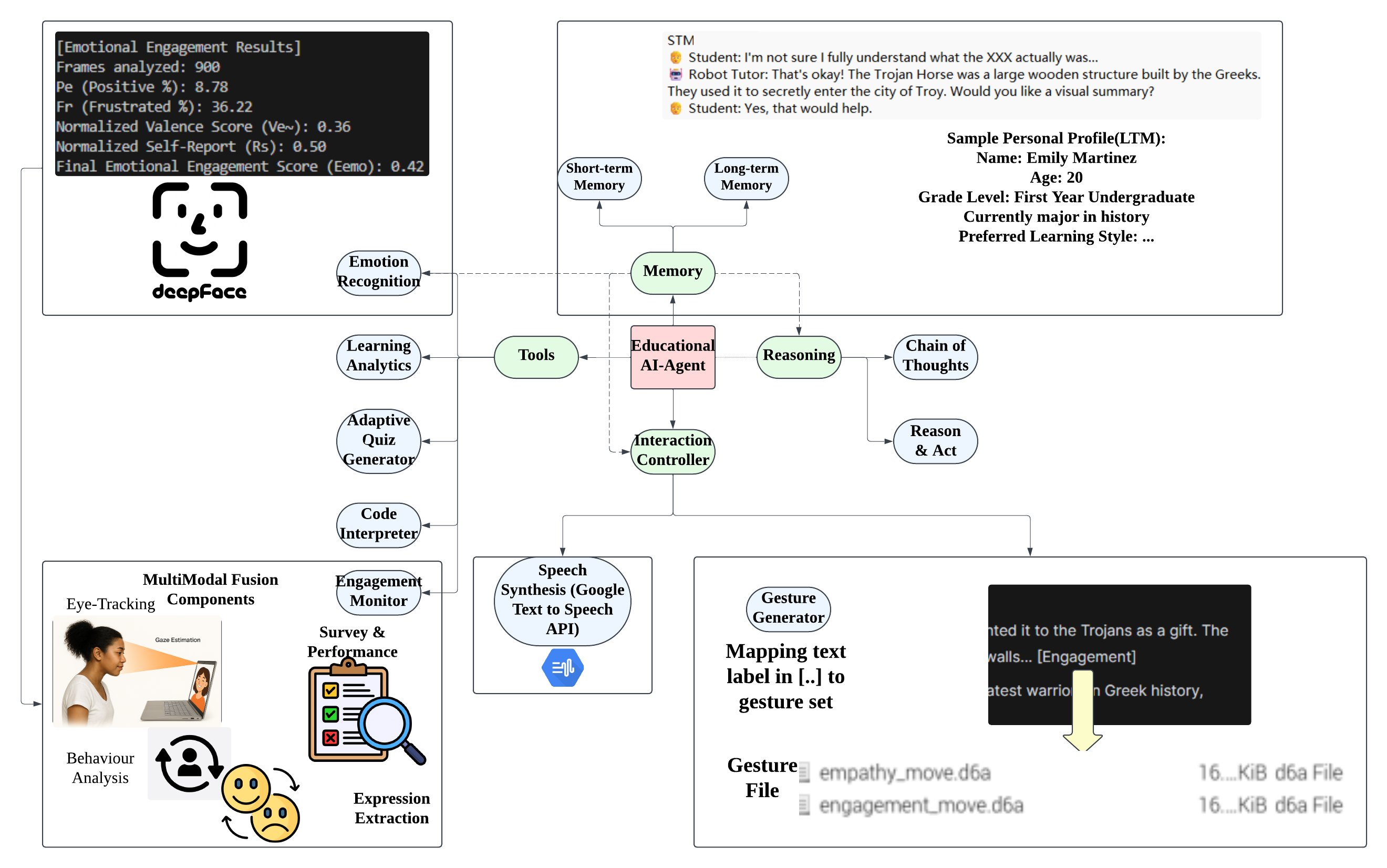

- 论文提出一种AI代理框架,通过定制LLaMa 3.2并集成情感、记忆和手势模块,赋予机器人同理心。

- 实验结果表明,该方法显著提高了学生的参与度和学习成果,验证了同理心机器人导师的有效性。

📝 摘要(中文)

本研究旨在探索将人类个体特征整合到具有同理心自适应的教育机器人导师系统中,以提高学生的参与度和学习成果,并通过相应的参与度向量测量进行评估。现有的人机交互(HRI)研究主要关注情商、记忆驱动的个性化和非语言交流等特征的独立整合,而忽略了它们在统一的、可操作的教育框架中的同步集成。为了弥补这一差距,我们定制了一个多模态大型语言模型(Meta的LLaMa 3.2),并部署了用于模拟人类特征(情感、记忆和手势)的模块,构建了一个AI代理框架。该框架构成了机器人的智能核心,模拟人类的情感系统、记忆架构和手势控制,使机器人能够更具同理心地行动,并适当识别和响应学生的情绪状态。它还可以回忆学生的过往学习记录,并相应地调整其互动方式。这使得机器人导师能够以更富同情心的方式对学生做出反应,提供个性化的口头反馈,并同步相关的肢体动作。我们的研究通过引入参与度向量模型来评估这种效果,该模型可以作为评估人机交互体验质量的标尺。定量和定性结果表明,与没有这些类人特征的基线人形机器人相比,这种具有同理心的响应式方法显著提高了学生的参与度和学习成果。这表明,具有同理心能力的机器人导师可以创造更具支持性和互动性的学习体验,最终为学生带来更好的结果。

🔬 方法详解

问题定义:现有的人机交互研究通常孤立地研究情商、记忆和非语言交流等特征,缺乏将这些特征整合到一个统一的、可操作的教育框架中。这导致机器人无法全面理解和响应学生的情感状态和学习需求,从而影响学习效果。

核心思路:论文的核心思路是将人类的情感系统、记忆架构和手势控制等特征融入到机器人中,使其能够像人类一样理解和回应学生的情感,并根据学生的学习历史进行个性化教学。通过这种方式,机器人可以提供更具同理心和支持性的学习体验。

技术框架:该研究的技术框架主要包括以下几个模块:1) 多模态大型语言模型(LLaMa 3.2):作为机器人的智能核心,负责生成文本回复和控制机器人的行为。2) 情感模块:用于识别和理解学生的情感状态。3) 记忆模块:用于存储和检索学生的学习历史和偏好。4) 手势控制模块:用于控制机器人的肢体动作,使其能够通过手势表达情感和提供指导。这些模块协同工作,使机器人能够以更自然和有效的方式与学生互动。

关键创新:该研究的关键创新在于将情商、记忆架构和手势控制等多种人类特征同步集成到一个机器人系统中,从而实现了更具同理心和个性化的人机交互。与以往的研究相比,该方法更加注重机器人对学生情感的理解和回应,以及根据学生学习历史进行个性化教学的能力。

关键设计:论文中没有详细描述关键的参数设置、损失函数、网络结构等技术细节。但是,可以推断,情感模块可能使用了情感识别模型,记忆模块可能使用了某种形式的知识图谱或数据库,手势控制模块可能使用了运动捕捉技术或预定义的动作库。这些模块的具体实现方式需要根据实际应用场景和数据进行调整和优化。

🖼️ 关键图片

📊 实验亮点

研究结果表明,与没有类人特征的基线机器人相比,集成了情商、记忆和手势的机器人导师显著提高了学生的参与度和学习成果。通过参与度向量模型进行评估,验证了该方法在提升人机交互体验方面的有效性。具体的性能数据和提升幅度在摘要中没有明确给出,需要在论文正文中查找。

🎯 应用场景

该研究成果可应用于教育机器人、虚拟助手、心理咨询等领域。通过赋予机器人同理心,可以提高人机交互的自然性和有效性,从而改善用户体验和学习效果。未来,该技术有望应用于更广泛的领域,例如医疗保健、客户服务等,为人们提供更智能、更人性化的服务。

📄 摘要(原文)

This study investigates the integration of individual human traits into an empathetically adaptive educational robot tutor system designed to improve student engagement and learning outcomes with corresponding Engagement Vector measurement. While prior research in the field of Human-Robot Interaction (HRI) has examined the integration of the traits, such as emotional intelligence, memory-driven personalization, and non-verbal communication, by themselves, they have thus-far neglected to consider their synchronized integration into a cohesive, operational education framework. To address this gap, we customize a Multi-Modal Large Language Model (LLaMa 3.2 from Meta) deployed with modules for human-like traits (emotion, memory and gestures) into an AI-Agent framework. This constitutes to the robot's intelligent core mimicing the human emotional system, memory architecture and gesture control to allow the robot to behave more empathetically while recognizing and responding appropriately to the student's emotional state. It can also recall the student's past learning record and adapt its style of interaction accordingly. This allows the robot tutor to react to the student in a more sympathetic manner by delivering personalized verbal feedback synchronized with relevant gestures. Our study investigates the extent of this effect through the introduction of Engagement Vector Model which can be a surveyor's pole for judging the quality of HRI experience. Quantitative and qualitative results demonstrate that such an empathetic responsive approach significantly improves student engagement and learning outcomes compared with a baseline humanoid robot without these human-like traits. This indicates that robot tutors with empathetic capabilities can create a more supportive, interactive learning experience that ultimately leads to better outcomes for the student.