Omni-Perception: Omnidirectional Collision Avoidance for Legged Locomotion in Dynamic Environments

作者: Zifan Wang, Teli Ma, Yufei Jia, Xun Yang, Jiaming Zhou, Wenlong Ouyang, Qiang Zhang, Junwei Liang

分类: cs.RO

发布日期: 2025-05-25 (更新: 2025-08-28)

💡 一句话要点

提出Omni-Perception,用于腿足机器人动态环境下的全向避障

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 腿足机器人 全向避障 LiDAR感知 端到端学习 动态环境 PD-RiskNet 强化学习

📋 核心要点

- 现有基于深度信息的感知方法在复杂环境中存在噪声敏感、光照依赖、计算开销大和难以处理非平面障碍物等问题。

- Omni-Perception直接从原始LiDAR点云学习运动策略,核心模块PD-RiskNet用于环境风险评估,实现3D空间感知和全向避障。

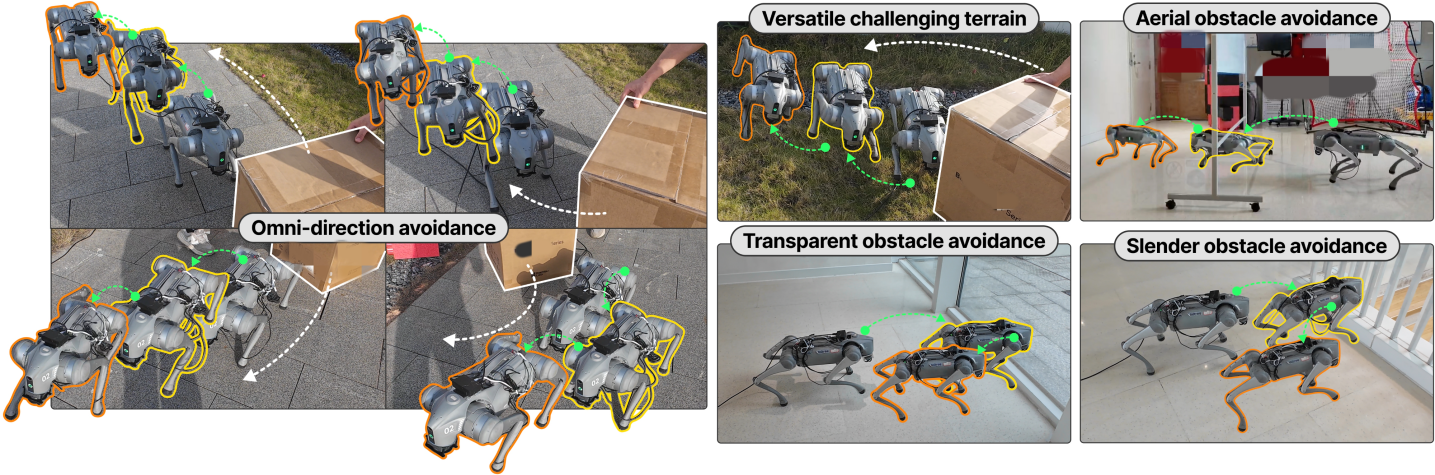

- 通过高保真LiDAR仿真工具包进行训练,并在真实世界和仿真环境中验证,展示了强大的全向避障能力和优越的运动性能。

📝 摘要(中文)

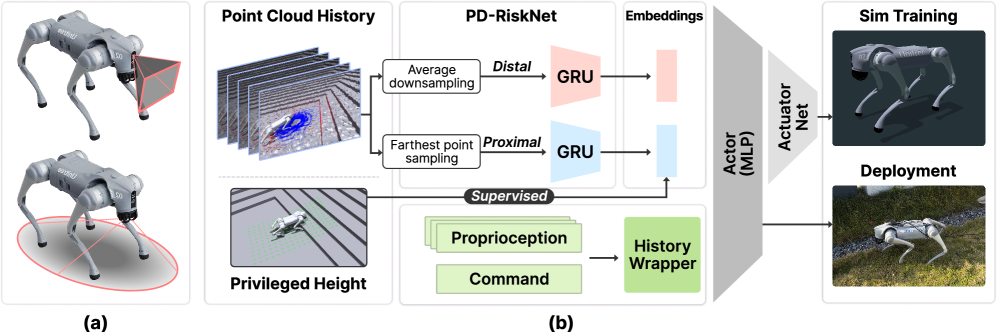

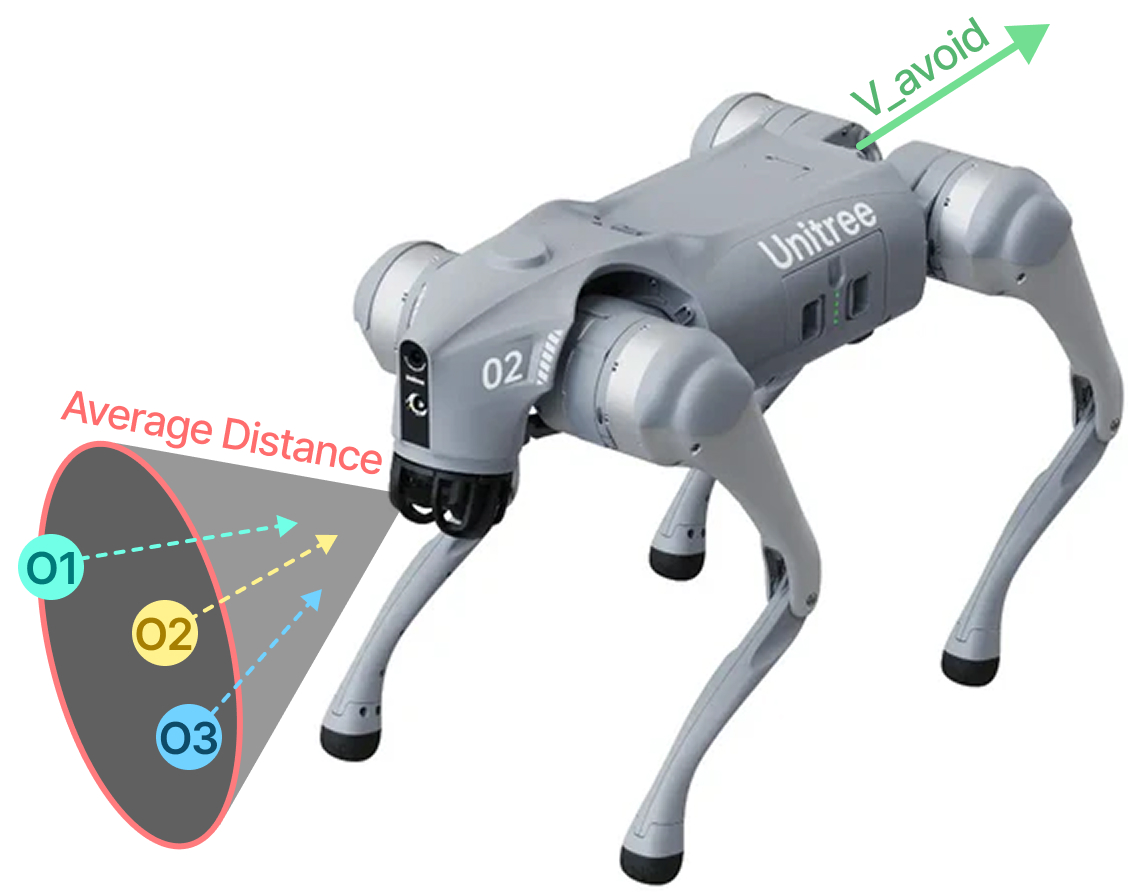

本文提出Omni-Perception,一种端到端腿足机器人运动策略,通过直接处理原始LiDAR点云实现3D空间感知和全向避障。核心是PD-RiskNet(近端-远端风险感知分层网络),一种用于解释时空LiDAR数据以进行环境风险评估的新型感知模块。为了促进高效的策略学习,我们开发了一个高保真LiDAR仿真工具包,具有逼真的噪声建模和快速光线投射,兼容Isaac Gym、Genesis和MuJoCo等平台,从而实现可扩展的训练和有效的sim-to-real迁移。直接从原始LiDAR数据学习反应式控制策略,使机器人能够比依赖中间地图或有限感知的方案更稳健地在具有静态和动态障碍物的复杂环境中导航。通过真实世界的实验和广泛的仿真验证了Omni-Perception,展示了强大的全向避障能力和在高度动态环境中卓越的运动性能。

🔬 方法详解

问题定义:腿足机器人在复杂3D环境中敏捷运动需要强大的空间感知能力,以安全地避开各种障碍物,如空中杂物、不平坦地形和动态智能体。现有方法依赖深度信息,易受传感器噪声、光照变化的影响,且中间表示(如高程图)计算开销大,难以处理非平面障碍物。直接将LiDAR传感集成到腿足机器人运动的端到端学习仍有待探索。

核心思路:Omni-Perception的核心在于直接从原始LiDAR点云中学习运动策略,避免了中间表示带来的信息损失和计算负担。通过设计PD-RiskNet,对LiDAR数据进行时空分析,评估环境风险,从而指导机器人进行避障运动。这种端到端的学习方式能够更好地适应复杂和动态的环境。

技术框架:Omni-Perception的整体框架包括LiDAR数据输入、PD-RiskNet感知模块和运动控制策略三个主要部分。首先,原始LiDAR点云作为输入。然后,PD-RiskNet对点云进行处理,输出环境风险评估结果。最后,运动控制策略根据风险评估结果,生成机器人的运动指令,实现避障。

关键创新:PD-RiskNet是该论文的关键创新点。它是一种新型的感知模块,能够有效地从时空LiDAR数据中提取环境风险信息。与传统的基于中间表示的方法相比,PD-RiskNet能够更直接地利用原始LiDAR数据,减少信息损失,提高感知精度。此外,该方法还提出了一个高保真LiDAR仿真工具包,用于策略训练。

关键设计:PD-RiskNet采用分层网络结构,分别处理近端和远端点云数据,从而实现更精确的风险评估。损失函数的设计考虑了避障的安全性和运动的效率。仿真工具包中,LiDAR噪声建模和快速光线投射是关键技术细节,保证了仿真结果的真实性和训练效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Omni-Perception在动态环境中表现出强大的全向避障能力,优于依赖中间地图或有限感知的方案。在真实世界的实验中,机器人能够成功避开移动的障碍物,并在复杂地形上稳定行走。仿真实验也验证了该方法在不同环境下的鲁棒性和泛化能力。具体性能数据未知。

🎯 应用场景

Omni-Perception在搜索救援、物流配送、巡检维护等领域具有广泛的应用前景。该技术能够使腿足机器人在复杂、动态和未知的环境中安全、高效地运动,完成各种任务。未来,该技术有望应用于更广泛的机器人平台,并与其他感知技术相结合,实现更智能的自主导航。

📄 摘要(原文)

Agile locomotion in complex 3D environments requires robust spatial awareness to safely avoid diverse obstacles such as aerial clutter, uneven terrain, and dynamic agents. Depth-based perception approaches often struggle with sensor noise, lighting variability, computational overhead from intermediate representations (e.g., elevation maps), and difficulties with non-planar obstacles, limiting performance in unstructured environments. In contrast, direct integration of LiDAR sensing into end-to-end learning for legged locomotion remains underexplored. We propose Omni-Perception, an end-to-end locomotion policy that achieves 3D spatial awareness and omnidirectional collision avoidance by directly processing raw LiDAR point clouds. At its core is PD-RiskNet (Proximal-Distal Risk-Aware Hierarchical Network), a novel perception module that interprets spatio-temporal LiDAR data for environmental risk assessment. To facilitate efficient policy learning, we develop a high-fidelity LiDAR simulation toolkit with realistic noise modeling and fast raycasting, compatible with platforms such as Isaac Gym, Genesis, and MuJoCo, enabling scalable training and effective sim-to-real transfer. Learning reactive control policies directly from raw LiDAR data enables the robot to navigate complex environments with static and dynamic obstacles more robustly than approaches relying on intermediate maps or limited sensing. We validate Omni-Perception through real-world experiments and extensive simulation, demonstrating strong omnidirectional avoidance capabilities and superior locomotion performance in highly dynamic environments.