Canonical Policy: Learning Canonical 3D Representation for SE(3)-Equivariant Policy

作者: Zhiyuan Zhang, Zhengtong Xu, Jai Nanda Lakamsani, Yu She

分类: cs.RO

发布日期: 2025-05-24 (更新: 2025-11-08)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Canonical Policy,通过学习规范3D表示提升机器人操作策略的泛化性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 机器人操作 3D点云 等变性 规范表示 策略学习 泛化能力

📋 核心要点

- 现有模仿学习方法在处理未见过的物体和场景时泛化性不足,缺乏对空间对称性的有效利用。

- Canonical Policy通过学习规范的3D表示,将不同视角和形状的点云统一到同一空间,实现等变策略学习。

- 实验结果表明,Canonical Policy在模拟和真实环境中均显著优于现有方法,泛化能力和样本效率更高。

📝 摘要(中文)

视觉模仿学习在机器人操作领域取得了显著进展,但对未见过的物体、场景布局和相机视点的泛化仍然是一个关键挑战。最近的研究通过使用3D点云(提供几何感知、外观不变的表示)以及将等变性融入策略架构(利用空间对称性)来解决这个问题。然而,现有的等变方法由于非结构化地集成等变组件,通常缺乏可解释性和严谨性。我们引入了canonical policy,这是一个原则性的3D等变模仿学习框架,通过将观察到的和新的点云分组到规范表示,统一了3D点云观测。我们首先建立了3D规范表示的理论,从而实现了等变的观察到动作的映射。然后,我们提出了一个灵活的策略学习流程,该流程利用了来自规范表示的几何对称性和现代生成模型的表达能力。我们在12个不同的模拟任务和4个真实世界的操作任务(跨越16种配置,涉及物体颜色、形状、相机视点和机器人平台的变化)上验证了canonical policy。与最先进的模仿学习策略相比,canonical policy在模拟中平均提高了18.0%,在真实世界实验中平均提高了39.7%,展示了卓越的泛化能力和样本效率。

🔬 方法详解

问题定义:现有基于视觉的模仿学习方法在机器人操作任务中,难以泛化到新的物体、场景布局和相机视角。现有的等变方法虽然尝试利用空间对称性,但往往缺乏理论基础和可解释性,导致性能提升有限。核心问题是如何设计一种既能利用3D几何信息,又能保证策略等变性的模仿学习框架。

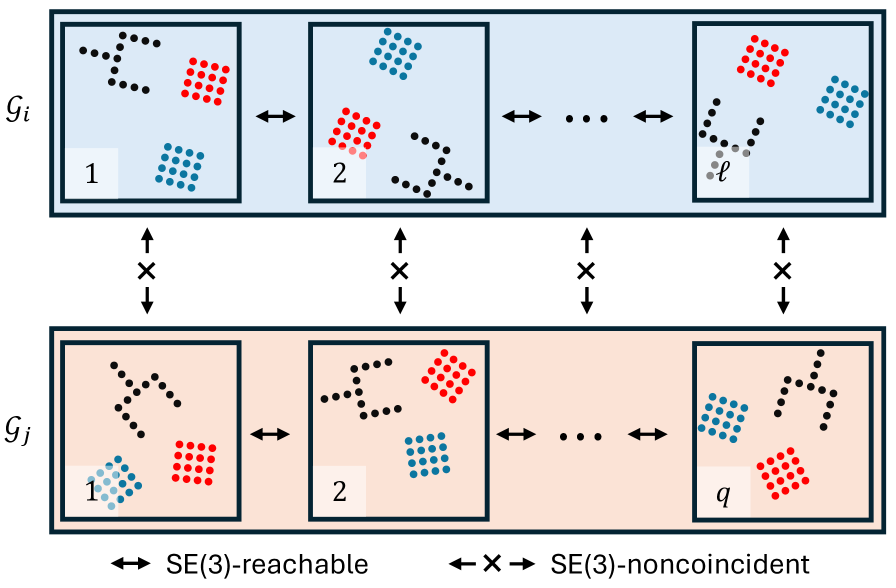

核心思路:论文的核心思路是将3D点云观测映射到一个规范的3D表示空间。通过将不同视角、不同形状的物体都转换到这个规范空间中,策略学习可以更加关注物体的本质特征,从而提高泛化能力。同时,规范表示的使用也使得策略更容易利用几何对称性,实现等变性。

技术框架:Canonical Policy框架主要包含以下几个阶段:1) 点云编码:使用一个神经网络将输入的3D点云编码成一个特征向量。2) 规范表示生成:利用一个生成模型(例如变分自编码器VAE)将特征向量映射到一个规范的3D表示。这个规范表示应该对物体的姿态和形状变化具有鲁棒性。3) 策略学习:基于规范表示,学习一个策略网络,将规范表示映射到机器人的动作空间。

关键创新:论文的关键创新在于提出了一个基于规范表示的等变策略学习框架。与以往直接在原始点云上进行策略学习的方法不同,Canonical Policy通过学习一个规范表示,将不同的观测统一到一个共同的空间,从而提高了策略的泛化能力和等变性。此外,论文还提出了一个3D规范表示的理论,为等变策略学习提供了理论基础。

关键设计:在规范表示生成阶段,论文使用了变分自编码器(VAE)来学习规范表示。VAE的损失函数包括重构损失和KL散度损失,用于保证规范表示的质量和正则化。在策略学习阶段,可以使用各种不同的策略网络结构,例如多层感知机(MLP)或图神经网络(GNN)。论文中具体使用的网络结构和参数设置未知。

🖼️ 关键图片

📊 实验亮点

Canonical Policy在12个模拟任务和4个真实世界操作任务上进行了验证,实验结果表明,Canonical Policy显著优于现有的模仿学习方法。在模拟环境中,Canonical Policy的性能平均提高了18.0%,在真实环境中平均提高了39.7%。这些结果表明,Canonical Policy具有卓越的泛化能力和样本效率,能够有效地解决机器人操作任务中的泛化问题。

🎯 应用场景

Canonical Policy在机器人操作领域具有广泛的应用前景,例如工业自动化、家庭服务机器人、医疗机器人等。它可以用于解决各种复杂的操作任务,例如物体抓取、装配、放置等。通过提高机器人的泛化能力和样本效率,Canonical Policy可以降低机器人部署的成本,并提高机器人的智能化水平。该研究对于实现更智能、更灵活的机器人系统具有重要意义。

📄 摘要(原文)

Visual Imitation learning has achieved remarkable progress in robotic manipulation, yet generalization to unseen objects, scene layouts, and camera viewpoints remains a key challenge. Recent advances address this by using 3D point clouds, which provide geometry-aware, appearance-invariant representations, and by incorporating equivariance into policy architectures to exploit spatial symmetries. However, existing equivariant approaches often lack interpretability and rigor due to unstructured integration of equivariant components. We introduce canonical policy, a principled framework for 3D equivariant imitation learning that unifies 3D point cloud observations under a canonical representation. We first establish a theory of 3D canonical representations, enabling equivariant observation-to-action mappings by grouping both seen and novel point clouds to a canonical representation. We then propose a flexible policy learning pipeline that leverages geometric symmetries from canonical representation and the expressiveness of modern generative models. We validate canonical policy on 12 diverse simulated tasks and 4 real-world manipulation tasks across 16 configurations, involving variations in object color, shape, camera viewpoint, and robot platform. Compared to state-of-the-art imitation learning policies, canonical policy achieves an average improvement of 18.0% in simulation and 39.7% in real-world experiments, demonstrating superior generalization capability and sample efficiency. For more details, please refer to the project website: https://zhangzhiyuanzhang.github.io/cp-website/.