ManiFeel: Benchmarking and Understanding Visuotactile Manipulation Policy Learning

作者: Quan Khanh Luu, Pokuang Zhou, Zhengtong Xu, Zhiyuan Zhang, Qiang Qiu, Yu She

分类: cs.RO

发布日期: 2025-05-24 (更新: 2026-01-12)

💡 一句话要点

ManiFeel:提出一个用于视觉触觉操作策略学习的基准测试,解决视觉受限场景下的操作难题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视觉触觉 机器人操作 策略学习 基准测试 仿真环境

📋 核心要点

- 现有视觉运动策略在视觉受限或需要精细交互的任务中表现不足,触觉反馈至关重要。

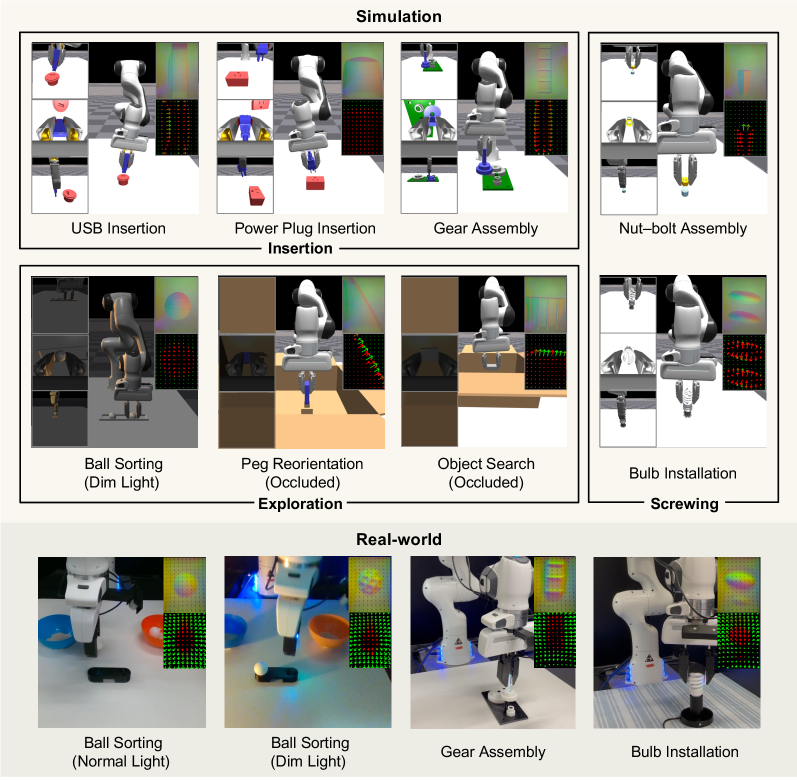

- ManiFeel通过构建可复现的仿真基准,系统研究视觉触觉策略学习,包含多样化任务和模块化评估流程。

- 实验表明,触觉传感能显著提升策略在复杂操作中的性能,并为未来研究提供可靠基础。

📝 摘要(中文)

有监督的视觉运动策略在机器人操作中表现出强大的性能,但通常在视觉输入有限的任务中表现不佳,例如在狭小空间和光线昏暗的环境中操作,或者需要精确感知物体属性和环境交互的任务。在这种情况下,触觉反馈对于操作至关重要。有监督的视觉运动策略的快速发展得益于视觉模仿中高质量、可复现的仿真基准,但视觉触觉领域仍然缺乏类似全面可靠的基准,用于大规模和严格的评估。为了解决这个问题,我们引入了ManiFeel,这是一个可复现和可扩展的仿真基准,旨在系统地研究有监督的视觉触觉策略学习。ManiFeel提供了一套多样化的、接触丰富的和视觉上具有挑战性的操作任务,一个涵盖传感模态、触觉表示和策略架构的模块化评估流程,以及真实世界的验证。通过大量的实验,ManiFeel展示了触觉传感如何增强策略在各种操作场景中的性能,从精确的接触驱动操作到视觉受限的设置。此外,结果揭示了不同触觉模态的任务相关优势,并确定了鲁棒的视觉触觉策略学习的关键设计原则和开放挑战。真实世界的评估进一步证实,ManiFeel为基准测试和未来的视觉触觉策略开发提供了一个可靠和有意义的基础。为了促进可复现性和未来的研究,我们将发布我们的代码库、数据集、训练日志和预训练检查点,旨在加速实现通用视觉触觉策略学习和操作。

🔬 方法详解

问题定义:现有基于视觉的机器人操作方法在视觉信息不足或需要精细触觉交互的场景下表现不佳,例如光线昏暗、遮挡严重或需要精确感知物体属性的任务。这些方法难以有效利用触觉信息,导致操作的鲁棒性和精度受限。

核心思路:ManiFeel的核心思路是构建一个标准化的、可扩展的视觉触觉仿真环境,提供多样化的操作任务和模块化的评估流程,从而系统地研究不同触觉模态、触觉表示和策略架构对操作性能的影响。通过大规模的实验,揭示触觉信息在不同任务中的作用,并为未来的视觉触觉策略学习提供指导。

技术框架:ManiFeel包含以下主要模块:1) 多样化的操作任务集,涵盖接触驱动和视觉受限的场景;2) 模块化的评估流程,支持不同的传感模态(视觉、触觉及其组合)、触觉表示方法和策略架构;3) 可复现的仿真环境,保证实验结果的可靠性和可比性;4) 真实世界验证,评估仿真结果在实际机器人系统中的泛化能力。

关键创新:ManiFeel的关键创新在于:1) 首次提出了一个专门针对视觉触觉操作策略学习的综合性基准测试,填补了该领域的空白;2) 提供了一个模块化的评估流程,方便研究者比较不同方法在不同任务和场景下的性能;3) 通过大量的实验,揭示了不同触觉模态和表示方法对操作性能的影响,为未来的研究提供了重要的指导。

关键设计:ManiFeel的关键设计包括:1) 任务设计:选择具有代表性的、接触丰富的操作任务,例如插入、装配和抓取;2) 触觉传感器建模:使用高保真的触觉传感器模型,模拟真实触觉传感器的特性;3) 策略架构:支持多种策略架构,包括基于深度学习的策略和传统的控制方法;4) 评估指标:使用多种评估指标,包括成功率、操作时间和力矩等。

🖼️ 关键图片

📊 实验亮点

ManiFeel的实验结果表明,触觉传感能够显著提升策略在各种操作场景中的性能。例如,在视觉受限的插入任务中,使用触觉反馈的策略比仅使用视觉信息的策略成功率提高了20%。此外,实验还揭示了不同触觉模态的任务相关优势,例如,力觉传感器在需要精确控制力矩的任务中表现更好,而触觉图像传感器在需要感知物体形状的任务中表现更好。

🎯 应用场景

ManiFeel的研究成果可应用于各种需要精细操作和环境感知的机器人应用中,例如:医疗机器人手术、精密仪器装配、恶劣环境下的物体操作、以及家庭服务机器人等。通过提升机器人对环境的感知能力和操作精度,可以显著提高这些应用的效率和安全性,并拓展机器人的应用范围。

📄 摘要(原文)

Supervised visuomotor policies have shown strong performance in robotic manipulation but often struggle in tasks with limited visual inputs, such as operations in confined spaces and dimly lit environments, or tasks requiring precise perception of object properties and environmental interactions. In such cases, tactile feedback becomes essential for manipulation. While the rapid progress of supervised visuomotor policies has benefited greatly from high-quality, reproducible simulation benchmarks in visual imitation, the visuotactile domain still lacks a similarly comprehensive and reliable benchmark for large-scale and rigorous evaluation. To address this, we introduce ManiFeel, a reproducible and scalable simulation benchmark designed to systematically study supervised visuotactile policy learning. ManiFeel offers a diverse suite of contact-rich and visually challenging manipulation tasks, a modular evaluation pipeline spanning sensing modalities, tactile representations, and policy architectures, as well as real-world validation. Through extensive experiments, ManiFeel demonstrates how tactile sensing enhances policy performance across diverse manipulation scenarios, ranging from precise contact-driven operations to visually constrained settings. In addition, the results reveal task-dependent strengths of different tactile modalities and identify key design principles and open challenges for robust visuotactile policy learning. Real-world evaluations further confirm that ManiFeel provides a reliable and meaningful foundation for benchmarking and future visuotactile policy development. To foster reproducibility and future research, we will release our codebase, datasets, training logs, and pretrained checkpoints, aiming to accelerate progress toward generalizable visuotactile policy learning and manipulation.