Reference Free Platform Adaptive Locomotion for Quadrupedal Robots using a Dynamics Conditioned Policy

作者: David Rytz, Suyoung Choi, Wanming Yu, Wolfgang Merkt, Jemin Hwangbo, Ioannis Havoutis

分类: cs.RO

发布日期: 2025-05-21 (更新: 2025-07-10)

备注: 8 pages, 6 tables, 5 figures

💡 一句话要点

提出基于动力学条件策略的平台自适应四足机器人运动控制方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 四足机器人 强化学习 平台自适应 运动控制 动力学嵌入

📋 核心要点

- 现有四足机器人运动控制方法难以适应不同形态和动力学参数的机器人平台。

- 利用深度强化学习,训练一个通用的运动策略,并通过动力学嵌入来调节策略,实现平台自适应。

- 实验表明,该方法在多个未见过的模拟机器人上实现了零样本迁移,并提高了速度跟踪的准确性。

📝 摘要(中文)

本文提出了一种平台自适应运动控制(PAL)方法,用于控制具有不同形态和动力学的四足机器人。我们利用深度强化学习在程序化生成的机器人上训练单个运动策略。该策略将本体感受机器人状态信息和基座速度指令映射到期望的关节驱动目标,并使用时间局部系统动力学的潜在嵌入进行调节。我们探索了两种调节策略——一种使用基于GRU的动力学编码器,另一种使用基于形态的属性估计器——并表明,对于ANYmal C上的硬件测试,形态感知的调节在速度任务跟踪方面优于时间动力学编码。我们的结果表明,这两种方法都实现了跨多个未见过的模拟四足机器人的鲁棒零样本迁移。此外,我们证明了在训练期间仔细进行机器人参考建模的必要性:使策略暴露于各种机器人形态和动力学可以改善泛化,与基线方法相比,速度跟踪误差最多可减少30%。尽管PAL在所有情况下都没有超过性能最佳的无参考控制器,但我们的分析揭示了关键的设计选择,并为改进现有技术提供了信息。

🔬 方法详解

问题定义:现有四足机器人运动控制方法通常需要针对特定平台进行精细调整,难以泛化到具有不同形态和动力学参数的机器人。这限制了四足机器人在各种复杂环境中的应用。论文旨在解决四足机器人运动控制的平台适应性问题,即如何设计一个通用的控制器,使其能够适应不同类型的四足机器人。

核心思路:论文的核心思路是利用深度强化学习训练一个通用的运动策略,并通过动力学嵌入来调节该策略。具体来说,策略接收机器人的本体感受状态信息和基座速度指令作为输入,输出期望的关节驱动目标。为了实现平台自适应,策略使用一个动力学编码器或形态属性估计器来提取机器人的动力学信息,并将这些信息作为条件输入到策略中。这样,策略就可以根据不同机器人的动力学特性进行调整,从而实现平台自适应的运动控制。

技术框架:整体框架包括以下几个主要模块:1) 机器人环境模拟器:用于生成具有不同形态和动力学参数的四足机器人;2) 运动策略网络:一个深度神经网络,接收机器人状态和速度指令,输出关节驱动目标;3) 动力学编码器/形态属性估计器:用于提取机器人的动力学信息或形态属性;4) 强化学习训练框架:用于训练运动策略网络,使其能够适应不同平台。

关键创新:论文的关键创新在于提出了一种基于动力学条件策略的平台自适应运动控制方法。与传统的针对特定平台设计的控制器不同,该方法通过深度强化学习训练一个通用的策略,并通过动力学嵌入来实现平台自适应。此外,论文还比较了两种不同的动力学嵌入方法:基于GRU的动力学编码器和基于形态的属性估计器,并发现形态感知的调节在硬件测试中表现更好。

关键设计:论文的关键设计包括:1) 使用程序化生成的方法创建具有不同形态和动力学参数的机器人;2) 设计了两种不同的动力学嵌入方法,并进行了比较;3) 使用了合适的奖励函数来训练运动策略网络,使其能够实现期望的速度跟踪性能;4) 仔细进行了机器人参考建模,使策略暴露于各种机器人形态和动力学,从而提高了泛化能力。

🖼️ 关键图片

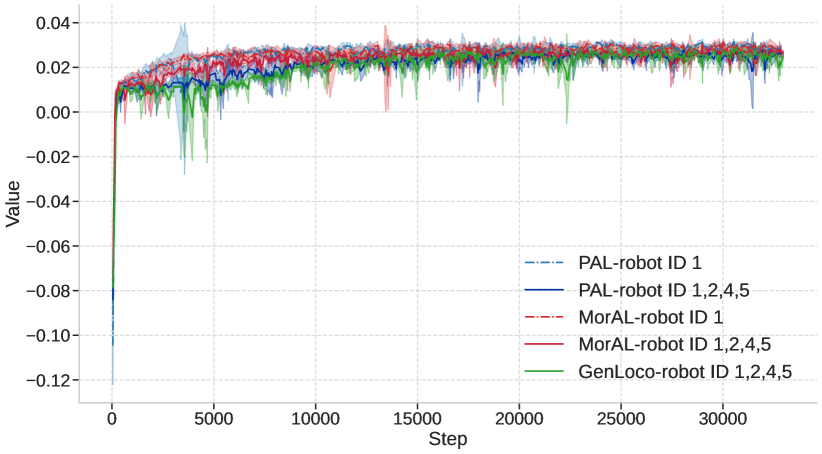

📊 实验亮点

实验结果表明,该方法在多个未见过的模拟四足机器人上实现了鲁棒的零样本迁移。在ANYmal C硬件测试中,形态感知的调节在速度任务跟踪方面优于时间动力学编码。此外,通过仔细进行机器人参考建模,速度跟踪误差最多可减少30%。

🎯 应用场景

该研究成果可应用于各种四足机器人平台,尤其是在需要快速部署和适应新环境的场景中,例如搜救、巡检、物流等。通过该方法,可以大大减少针对不同机器人平台进行控制策略调整的时间和成本,加速四足机器人在实际场景中的应用。

📄 摘要(原文)

This article presents Platform Adaptive Locomotion (PAL), a unified control method for quadrupedal robots with different morphologies and dynamics. We leverage deep reinforcement learning to train a single locomotion policy on procedurally generated robots. The policy maps proprioceptive robot state information and base velocity commands into desired joint actuation targets, which are conditioned using a latent embedding of the temporally local system dynamics. We explore two conditioning strategies - one using a GRU-based dynamics encoder and another using a morphology-based property estimator - and show that morphology-aware conditioning outperforms temporal dynamics encoding regarding velocity task tracking for our hardware test on ANYmal C. Our results demonstrate that both approaches achieve robust zero-shot transfer across multiple unseen simulated quadrupeds. Furthermore, we demonstrate the need for careful robot reference modelling during training: exposing the policy to a diverse set of robot morphologies and dynamics leads to improved generalization, reducing the velocity tracking error by up to 30% compared to the baseline method. Despite PAL not surpassing the best-performing reference-free controller in all cases, our analysis uncovers critical design choices and informs improvements to the state of the art.