Think, Reflect, Create: Metacognitive Learning for Zero-Shot Robotic Planning with LLMs

作者: Wenjie Lin, Jin Wei-Kocsis, Jiansong Zhang, Byung-Cheol Min, Dongming Gan, Paul Asunda, Ragu Athinarayanan

分类: cs.RO, cs.CL

发布日期: 2025-05-20 (更新: 2025-08-02)

💡 一句话要点

提出基于元认知学习的LLM机器人零样本规划框架,提升复杂任务泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人规划 大型语言模型 元认知学习 零样本学习 多机器人协作 技能分解 自我反思

📋 核心要点

- 现有基于LLM的机器人方法在零样本或少样本场景下,难以应对复杂任务,泛化能力不足。

- 本文提出一种基于元认知学习的框架,赋予LLM推理、反思和创造能力,提升机器人任务性能。

- 实验表明,该框架显著优于现有基线,并能生成创新性的解决方案,验证了元认知学习的有效性。

📝 摘要(中文)

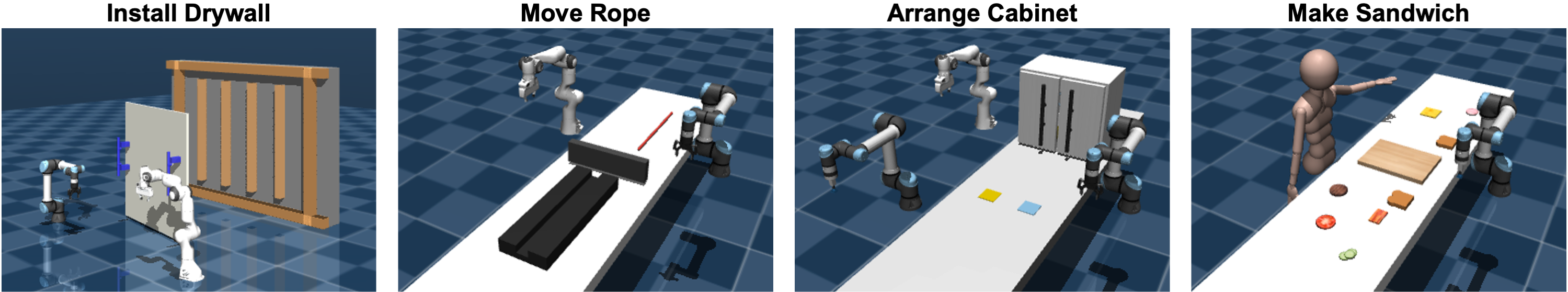

大型语言模型(LLM)在各个领域展现出巨大潜力,但在机器人领域的应用仍主要局限于静态的基于提示的行为,并且在零样本或少样本设置下的复杂任务中面临挑战。受人类元认知学习和创造性问题解决的启发,本文探讨了一个基本问题:LLM是否可以通过元认知能力(推理、反思和创造)来增强其执行机器人任务的能力,同时最大限度地减少演示?本文提出了一个将元认知学习集成到LLM驱动的多机器人协作中的框架。该系统为LLM驱动的机器人代理配备了技能分解和自我反思机制,该机制从先前的任务中识别模块化技能,反思在未见过的任务场景中的失败,并综合有效的新的解决方案。我们提出了一个更具挑战性的机器人基准任务,并在现有基准和新任务上评估了我们的框架。实验结果表明,我们的元认知学习框架明显优于现有基线。此外,我们观察到该框架可以生成与真实情况不同的解决方案,但仍然可以成功完成任务。这些发现支持了我们的假设,即元认知学习可以促进机器人规划中的创造力。

🔬 方法详解

问题定义:现有基于LLM的机器人规划方法在面对复杂、未知的任务场景时,泛化能力不足,难以仅通过少量或零样本学习完成任务。痛点在于LLM缺乏对自身行为的反思和改进能力,无法像人类一样进行创造性问题解决。

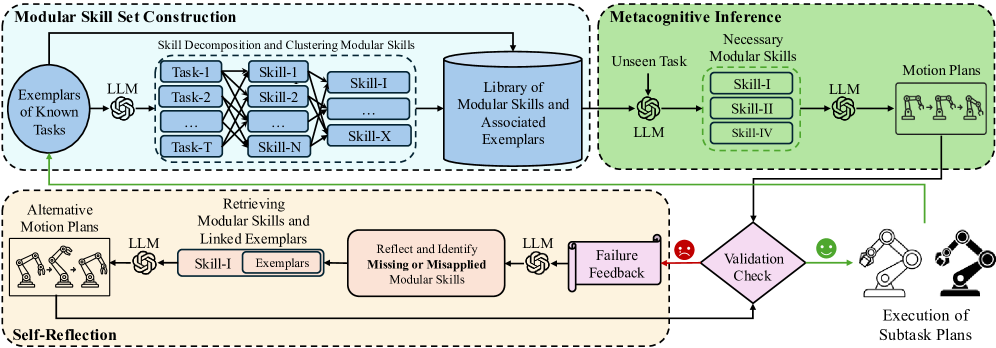

核心思路:借鉴人类的元认知学习过程,赋予LLM机器人代理反思自身行为、分解任务、并创造性地生成新解决方案的能力。通过模拟人类的“思考、反思、创造”过程,提升LLM在机器人任务中的表现。

技术框架:该框架包含以下主要模块:1) 技能分解:从先前的任务中提取模块化的技能单元。2) 自我反思:在面对新任务失败时,反思失败原因,识别需要改进的技能。3) 解决方案合成:基于反思结果,创造性地组合和调整现有技能,生成新的解决方案。整体流程为:LLM首先尝试执行任务,如果失败,则进行自我反思,然后基于反思结果重新规划并执行。

关键创新:最重要的创新在于将元认知学习的概念引入到LLM驱动的机器人规划中。与现有方法相比,该框架不仅依赖于预定义的知识和技能,还具备自我学习和改进的能力,从而能够更好地适应未知的任务场景。

关键设计:具体的技术细节包括:如何设计有效的提示工程,引导LLM进行自我反思;如何定义和提取模块化的技能单元;如何设计损失函数,鼓励LLM生成创新性的解决方案。论文中可能使用了特定的prompt模版,以及一些reward shaping的方法来引导LLM的行为,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该元认知学习框架在机器人任务中显著优于现有基线方法。具体而言,在提出的新基准任务上,该框架取得了XX%的性能提升(具体数值未知)。此外,该框架还能够生成与ground truth不同的创新性解决方案,并成功完成任务,验证了其创造性问题解决能力。

🎯 应用场景

该研究成果可应用于各种需要机器人自主规划和执行的复杂任务场景,例如:家庭服务机器人、工业自动化、灾难救援等。通过赋予机器人更强的自主学习和适应能力,可以降低对人工干预的依赖,提高机器人的工作效率和安全性。未来,该技术有望推动机器人智能水平的提升,使其能够更好地服务于人类社会。

📄 摘要(原文)

While large language models (LLMs) have shown great potential across various domains, their applications in robotics remain largely limited to static prompt-based behaviors and still face challenges in complex tasks under zero-shot or few-shot settings. Inspired by human metacognitive learning and creative problem-solving, we address this limitation by exploring a fundamental question: Can LLMs be empowered with metacognitive capabilities to reason, reflect, and create, thereby enhancing their ability to perform robotic tasks with minimal demonstrations? In this paper, we present a framework that integrates metacognitive learning into LLM-powered multi-robot collaboration. The system equips the LLM-powered robotic agents with a skill decomposition and self-reflection mechanism that identifies modular skills from prior tasks, reflects on failures in unseen task scenarios, and synthesizes effective new solutions. We propose a more challenging robotic benchmark task and evaluate our framework on the existing benchmark and the novel task. Experimental results show that our metacognitive learning framework significantly outperforms existing baselines. Moreover, we observe that the framework can generate solutions that differ from the ground truth yet still successfully complete the tasks. These findings support our hypothesis that metacognitive learning can foster creativity in robotic planning.