Audio-Visual Contact Classification for Tree Structures in Agriculture

作者: Ryan Spears, Moonyoung Lee, George Kantor, Oliver Kroemer

分类: cs.RO

发布日期: 2025-05-19

备注: 8 pages

💡 一句话要点

提出多模态分类框架以解决农业树结构接触识别问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 多模态融合 音频信号处理 视觉识别 农业机器人 接触分类

📋 核心要点

- 现有方法在农业环境中面临的挑战是视觉信息不足,无法有效识别接触材料类型。

- 论文提出的解决方案是通过融合音频和视觉输入,利用接触引起的振动信号进行多模态分类。

- 实验结果显示,该方法在零样本泛化中取得了0.82的F1分数,表明其在实际应用中的有效性。

📝 摘要(中文)

在农业中,接触丰富的操作任务如修剪和采摘需要机器人与树结构进行物理交互。识别机器人接触的是刚性材料还是软性材料对于确保操作安全至关重要,但由于环境的遮挡和视角限制,单靠视觉往往不足。为此,本文提出了一种融合振动触觉(音频)和视觉输入的多模态分类框架,以识别接触类别:叶子、树枝、树干或环境。我们的关键见解是,接触引起的振动携带特定材料的信号,使得音频在检测接触事件和区分材料类型方面有效,而视觉特征则提供了补充的语义线索,支持更细粒度的分类。我们使用手持传感器探头收集训练数据,并展示了对机器人安装探头的零样本泛化,达到了0.82的F1分数。这些结果强调了音频-视觉学习在非结构化、接触丰富环境中的操作潜力。

🔬 方法详解

问题定义:本文旨在解决农业中机器人与树结构接触时,如何准确识别接触材料类型的问题。现有方法主要依赖视觉信息,但在复杂环境中常常受到遮挡和视角限制的影响,导致识别准确性不足。

核心思路:论文的核心思路是通过结合音频和视觉信息,利用接触引起的振动信号来增强材料识别的准确性。音频信号能够有效捕捉材料特征,而视觉信息则提供了语义支持,从而实现更精细的分类。

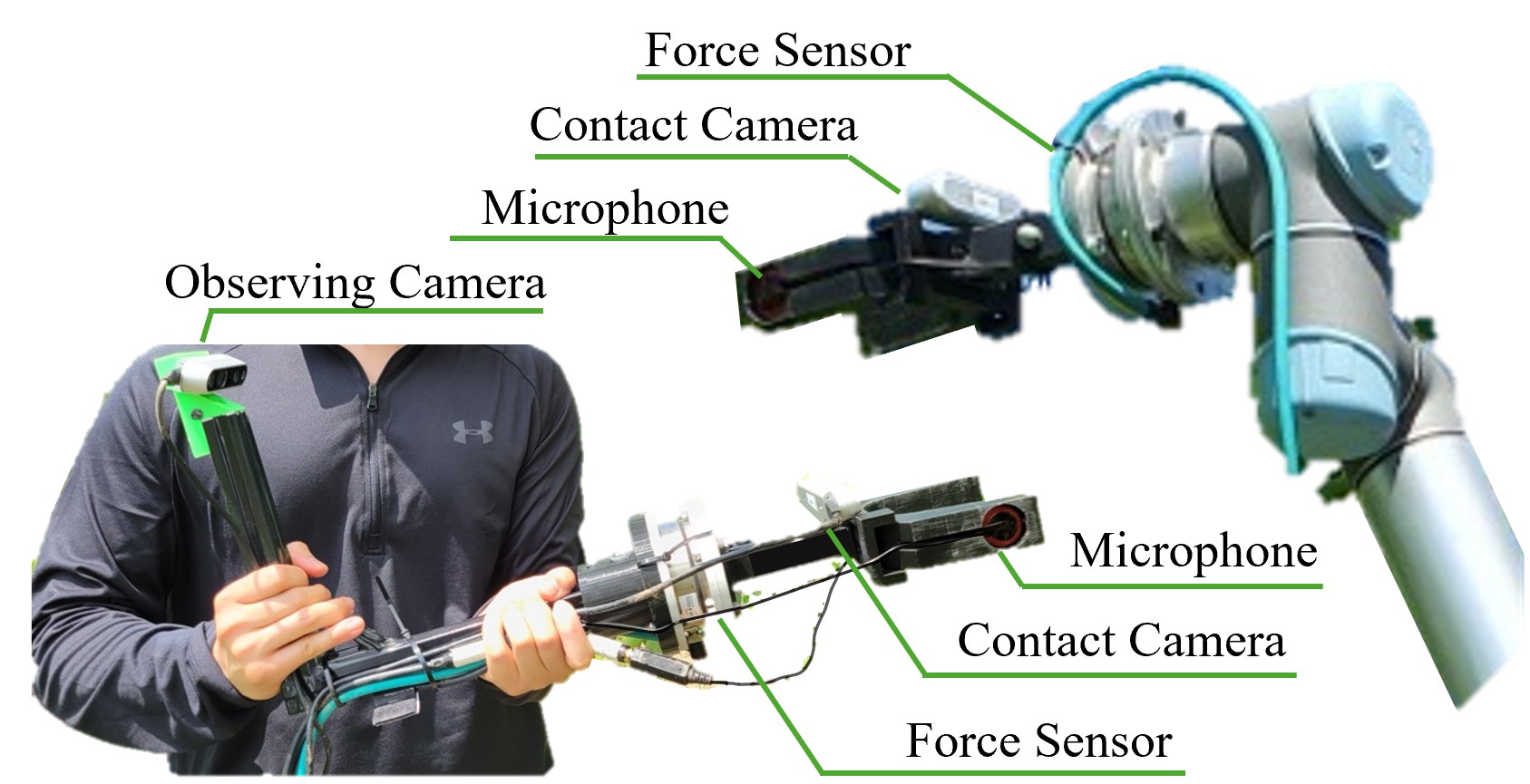

技术框架:整体架构包括数据采集、特征提取和分类三个主要模块。首先,使用手持传感器探头收集音频和视觉数据;然后,通过特征提取模块提取音频和视觉特征;最后,分类模块将融合的特征输入分类器进行接触类别的识别。

关键创新:最重要的技术创新在于提出了音频与视觉的多模态融合方法,利用音频信号的材料特异性和视觉信号的语义信息,显著提升了接触分类的准确性。这种方法与传统的单一模态方法相比,能够更好地应对复杂和动态的农业环境。

关键设计:在技术细节上,使用了特定的损失函数来优化多模态特征的融合效果,并设计了适应性强的网络结构,以便在不同的接触场景中进行有效学习。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的方法在零样本泛化中取得了0.82的F1分数,显示出较高的分类性能。与传统方法相比,音频-视觉融合框架在接触分类任务中显著提升了识别准确性,展示了其在非结构化环境中的应用潜力。

🎯 应用场景

该研究的潜在应用领域包括农业机器人在复杂环境中的自动化操作,如修剪、采摘等任务。通过提高机器人对接触材料的识别能力,可以显著提升操作的安全性和效率,推动农业自动化的发展。未来,该技术还可能扩展到其他需要物理交互的领域,如制造和服务机器人。

📄 摘要(原文)

Contact-rich manipulation tasks in agriculture, such as pruning and harvesting, require robots to physically interact with tree structures to maneuver through cluttered foliage. Identifying whether the robot is contacting rigid or soft materials is critical for the downstream manipulation policy to be safe, yet vision alone is often insufficient due to occlusion and limited viewpoints in this unstructured environment. To address this, we propose a multi-modal classification framework that fuses vibrotactile (audio) and visual inputs to identify the contact class: leaf, twig, trunk, or ambient. Our key insight is that contact-induced vibrations carry material-specific signals, making audio effective for detecting contact events and distinguishing material types, while visual features add complementary semantic cues that support more fine-grained classification. We collect training data using a hand-held sensor probe and demonstrate zero-shot generalization to a robot-mounted probe embodiment, achieving an F1 score of 0.82. These results underscore the potential of audio-visual learning for manipulation in unstructured, contact-rich environments.