Integrating Model-based Control and RL for Sim2Real Transfer of Tight Insertion Policies

作者: Isidoros Marougkas, Dhruv Metha Ramesh, Joe H. Doerr, Edgar Granados, Aravind Sivaramakrishnan, Abdeslam Boularias, Kostas E. Bekris

分类: cs.RO

发布日期: 2025-05-17

💡 一句话要点

提出一种融合模型控制与强化学习的策略,实现高精度插件插入的Sim2Real迁移。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人 强化学习 模型预测控制 Sim2Real 物体插入 自动化装配 课程学习

📋 核心要点

- 高精度物体插入是重要的装配任务,但现有强化学习方法依赖于精心设计的密集奖励函数,泛化性差。

- 提出融合模型控制和残差强化学习的混合策略,利用模型控制提供先验知识,强化学习进行微调,实现精确控制。

- 实验表明,该方法在仿真和真实环境中均优于现有强化学习方法,且无需真实环境的训练或微调。

📝 摘要(中文)

本文提出了一种有效的策略,用于解决公差要求严格(<1mm)的物体插入这一具有挑战性的装配任务。该策略融合了传统的基于模型的控制和强化学习,以提高插入精度。该策略完全在仿真环境中训练,并零样本迁移到真实系统。它采用基于势场的控制器来获得一个基于模型的策略,用于在仿真环境中完全可观测的情况下将插头插入插座。然后,该策略与残差强化学习相结合,残差强化学习仅在稀疏的目标到达奖励下在仿真环境中进行训练。在观察噪声和动作幅度上使用课程学习方案来训练残差强化学习策略。策略的两个组成部分都使用插头和插座的SE(3)位姿作为输入,并返回插头的SE(3)位姿变换,该变换由机器人手臂使用控制器执行。集成的策略在真实系统上部署,无需进一步的训练或微调,并使用视觉SE(3)物体跟踪器。所提出的解决方案和替代方案在仿真和现实中的各种物体和条件下进行了评估。所提出的方法优于该领域最近的基于强化学习的方法和先前的混合策略,消融实验突出了该方法每个组成部分的影响。

🔬 方法详解

问题定义:论文旨在解决高精度(<1mm公差)的物体插入问题,这是一个重要的工业装配任务。现有的强化学习方法通常需要精心设计的密集奖励函数,这限制了它们的泛化能力和在复杂环境中的应用。此外,直接在真实机器人上训练强化学习策略成本高昂且耗时。

核心思路:论文的核心思路是将传统的基于模型的控制方法与强化学习相结合,利用模型控制提供初始的、粗略的插入策略,然后使用强化学习对该策略进行微调,以适应仿真和真实环境之间的差异。这种混合方法可以结合两者的优点,提高插入精度和泛化能力。

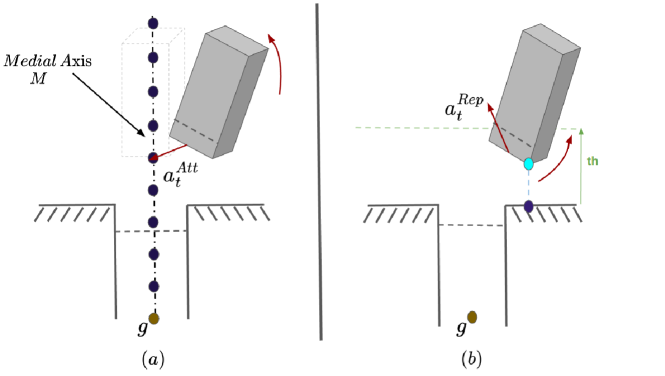

技术框架:整体框架包含两个主要模块:基于模型的控制器和残差强化学习策略。首先,使用基于势场的控制器在仿真环境中训练一个基于模型的策略,该策略在完全可观测的情况下将插头插入插座。然后,使用残差强化学习对该策略进行微调,该强化学习策略仅在稀疏的目标到达奖励下进行训练。两个策略都以插头和插座的SE(3)位姿作为输入,并输出插头的SE(3)位姿变换,该变换由机器人手臂执行。

关键创新:该论文的关键创新在于将模型控制和残差强化学习相结合,并使用课程学习方案来训练残差强化学习策略。这种混合方法可以有效地利用模型控制的先验知识和强化学习的自适应能力,从而实现高精度的物体插入。此外,该方法能够在仿真环境中训练策略,并零样本迁移到真实系统,降低了训练成本。

关键设计:课程学习方案是训练残差强化学习策略的关键。该方案通过逐渐增加观察噪声和动作幅度来提高策略的鲁棒性。损失函数使用稀疏的目标到达奖励,鼓励策略尽快到达目标位置。网络结构使用多层感知机(MLP)来表示策略,并使用Adam优化器进行训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在仿真和真实环境中均优于现有的基于强化学习的方法。在真实环境中,该方法能够成功插入各种形状和尺寸的插头,且插入精度达到亚毫米级别。与直接使用强化学习的方法相比,该方法能够更快地收敛,并具有更好的泛化能力。消融实验表明,模型控制和残差强化学习的结合能够显著提高插入性能。

🎯 应用场景

该研究成果可广泛应用于自动化装配领域,尤其是在需要高精度和高可靠性的场景中,例如电子元件组装、医疗器械制造等。通过结合模型控制和强化学习,可以降低对环境建模的依赖,提高系统的适应性和鲁棒性,从而实现更高效、更灵活的自动化生产线。未来,该方法有望扩展到更复杂的装配任务和更广泛的机器人应用领域。

📄 摘要(原文)

Object insertion under tight tolerances ($< \hspace{-.02in} 1mm$) is an important but challenging assembly task as even small errors can result in undesirable contacts. Recent efforts focused on Reinforcement Learning (RL), which often depends on careful definition of dense reward functions. This work proposes an effective strategy for such tasks that integrates traditional model-based control with RL to achieve improved insertion accuracy. The policy is trained exclusively in simulation and is zero-shot transferred to the real system. It employs a potential field-based controller to acquire a model-based policy for inserting a plug into a socket given full observability in simulation. This policy is then integrated with residual RL, which is trained in simulation given only a sparse, goal-reaching reward. A curriculum scheme over observation noise and action magnitude is used for training the residual RL policy. Both policy components use as input the SE(3) poses of both the plug and the socket and return the plug's SE(3) pose transform, which is executed by a robotic arm using a controller. The integrated policy is deployed on the real system without further training or fine-tuning, given a visual SE(3) object tracker. The proposed solution and alternatives are evaluated across a variety of objects and conditions in simulation and reality. The proposed approach outperforms recent RL-based methods in this domain and prior efforts with hybrid policies. Ablations highlight the impact of each component of the approach.