Grounded Task Axes: Zero-Shot Semantic Skill Generalization via Task-Axis Controllers and Visual Foundation Models

作者: M. Yunus Seker, Shobhit Aggarwal, Oliver Kroemer

分类: cs.RO

发布日期: 2025-05-16

💡 一句话要点

提出基于任务轴控制和视觉基础模型的零样本语义技能泛化方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 技能迁移 零样本学习 视觉基础模型 任务轴控制器

📋 核心要点

- 现有机器人技能迁移方法难以兼顾不同物体间的高层结构差异和相似的底层交互控制。

- 论文提出将技能分解为基于物体关键点和轴的任务轴控制器,通过语义相似性实现零样本迁移。

- 真实机器人实验表明,该方法在拧螺丝、倒水和刮铲刮擦等任务中实现了鲁棒且通用的控制器迁移。

📝 摘要(中文)

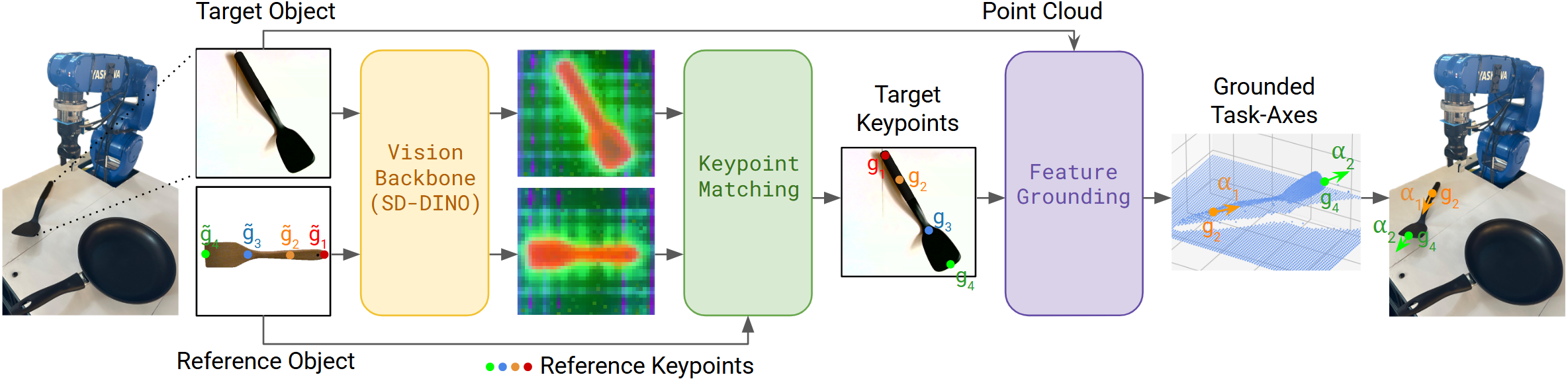

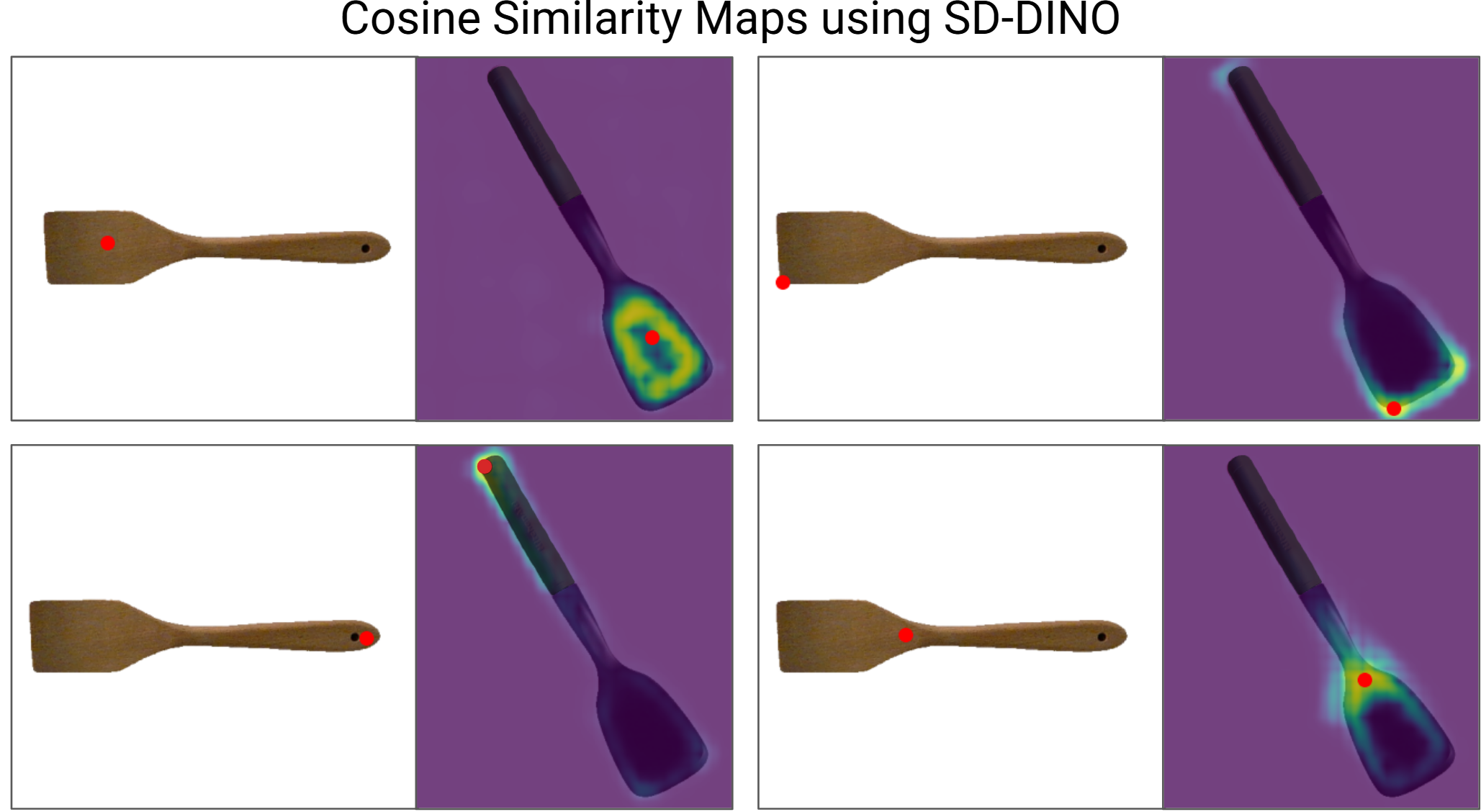

本文提出了一种基于示例的零样本技能迁移方法,旨在解决开放世界机器人操作中不同物体间技能迁移的挑战。该方法将技能分解为一组具有优先级的、基于物体的任务轴(Grounded Task-Axis, GTA)控制器。每个GTAC定义了一个可调整的控制器,例如沿轴的位置或力控制器。GTAC基于物体关键点和轴进行定位,例如螺钉头部的相对位置或其轴的轴线。通过寻找新目标物体上语义相似的定位特征,实现零样本迁移。利用SD-DINO等基础模型检测物体语义相似的关键点,实现技能的示例式定位。在包括拧螺丝、倒水和刮铲刮擦等真实机器人实验中,验证了该框架的鲁棒性和通用性。

🔬 方法详解

问题定义:现有机器人技能迁移方法在面对不同物体时,难以同时处理物体间的高层结构差异和保持相似的底层交互控制。例如,拧螺丝任务在不同螺丝钉上,螺丝钉的形状、大小、位置都可能不同,如何让机器人能够自适应地完成拧螺丝任务是一个挑战。现有的方法往往需要针对每个物体进行单独训练或调整,泛化能力较弱。

核心思路:论文的核心思路是将技能分解为一系列基于物体关键点和轴的任务轴控制器(GTAC)。每个GTAC负责控制机器人沿特定轴的运动或力,例如沿螺丝钉轴线的运动。通过找到新物体上语义相似的关键点和轴,可以将已有的GTAC迁移到新物体上,从而实现零样本技能迁移。这种分解方式使得技能可以灵活地适应不同物体的结构差异。

技术框架:整体框架包含以下几个主要模块:1) 技能分解:将技能分解为一组具有优先级的GTAC。2) 关键点检测:利用视觉基础模型(如SD-DINO)检测物体上的关键点和轴。3) GTAC定位:基于检测到的关键点和轴,定位GTAC在物体上的位置和方向。4) 控制器执行:根据GTAC的控制策略,控制机器人执行任务。整个流程是示例式的,即通过一个或多个示例演示技能,然后将技能迁移到新的物体上。

关键创新:最重要的创新点在于将技能分解为基于物体关键点和轴的GTAC,并利用视觉基础模型实现关键点的语义匹配。这种方法使得技能可以灵活地适应不同物体的结构差异,从而实现零样本技能迁移。与现有方法相比,该方法不需要针对每个物体进行单独训练或调整,具有更强的泛化能力。

关键设计:GTAC的设计是关键。每个GTAC包含一个控制器(如位置控制器或力控制器)和一个轴。轴可以是物体上的一个物理轴(如螺丝钉的轴线),也可以是两个关键点之间的连线。控制器的参数可以根据物体的特性进行调整。例如,拧螺丝任务的GTAC可能包含一个沿螺丝钉轴线的力控制器和一个绕轴的旋转控制器。损失函数的设计也至关重要,需要保证GTAC能够准确地定位在物体上,并能够有效地控制机器人执行任务。

🖼️ 关键图片

📊 实验亮点

论文在真实机器人平台上进行了拧螺丝、倒水和刮铲刮擦等任务的实验验证。实验结果表明,该方法能够有效地将技能迁移到新的物体上,实现鲁棒且通用的控制器迁移。具体的性能数据和对比基线在论文中给出,展示了该方法在零样本技能迁移方面的优势。

🎯 应用场景

该研究成果可广泛应用于自动化装配、家庭服务机器人、医疗机器人等领域。例如,在自动化装配线上,机器人可以利用该方法快速适应不同型号的零件,实现柔性化生产。在家庭服务领域,机器人可以利用该方法完成各种家务任务,如整理物品、清洁卫生等。在医疗领域,机器人可以利用该方法辅助医生进行手术操作,提高手术精度和效率。

📄 摘要(原文)

Transferring skills between different objects remains one of the core challenges of open-world robot manipulation. Generalization needs to take into account the high-level structural differences between distinct objects while still maintaining similar low-level interaction control. In this paper, we propose an example-based zero-shot approach to skill transfer. Rather than treating skills as atomic, we decompose skills into a prioritized list of grounded task-axis (GTA) controllers. Each GTAC defines an adaptable controller, such as a position or force controller, along an axis. Importantly, the GTACs are grounded in object key points and axes, e.g., the relative position of a screw head or the axis of its shaft. Zero-shot transfer is thus achieved by finding semantically-similar grounding features on novel target objects. We achieve this example-based grounding of the skills through the use of foundation models, such as SD-DINO, that can detect semantically similar keypoints of objects. We evaluate our framework on real-robot experiments, including screwing, pouring, and spatula scraping tasks, and demonstrate robust and versatile controller transfer for each.