Learning Multimodal AI Algorithms for Amplifying Limited User Input into High-dimensional Control Space

作者: Ali Rabiee, Sima Ghafoori, MH Farhadi, Robert Beyer, Xiangyu Bai, David J Lin, Sarah Ostadabbas, Reza Abiri

分类: cs.RO, cs.HC, cs.LG, eess.SY

发布日期: 2025-05-16

💡 一句话要点

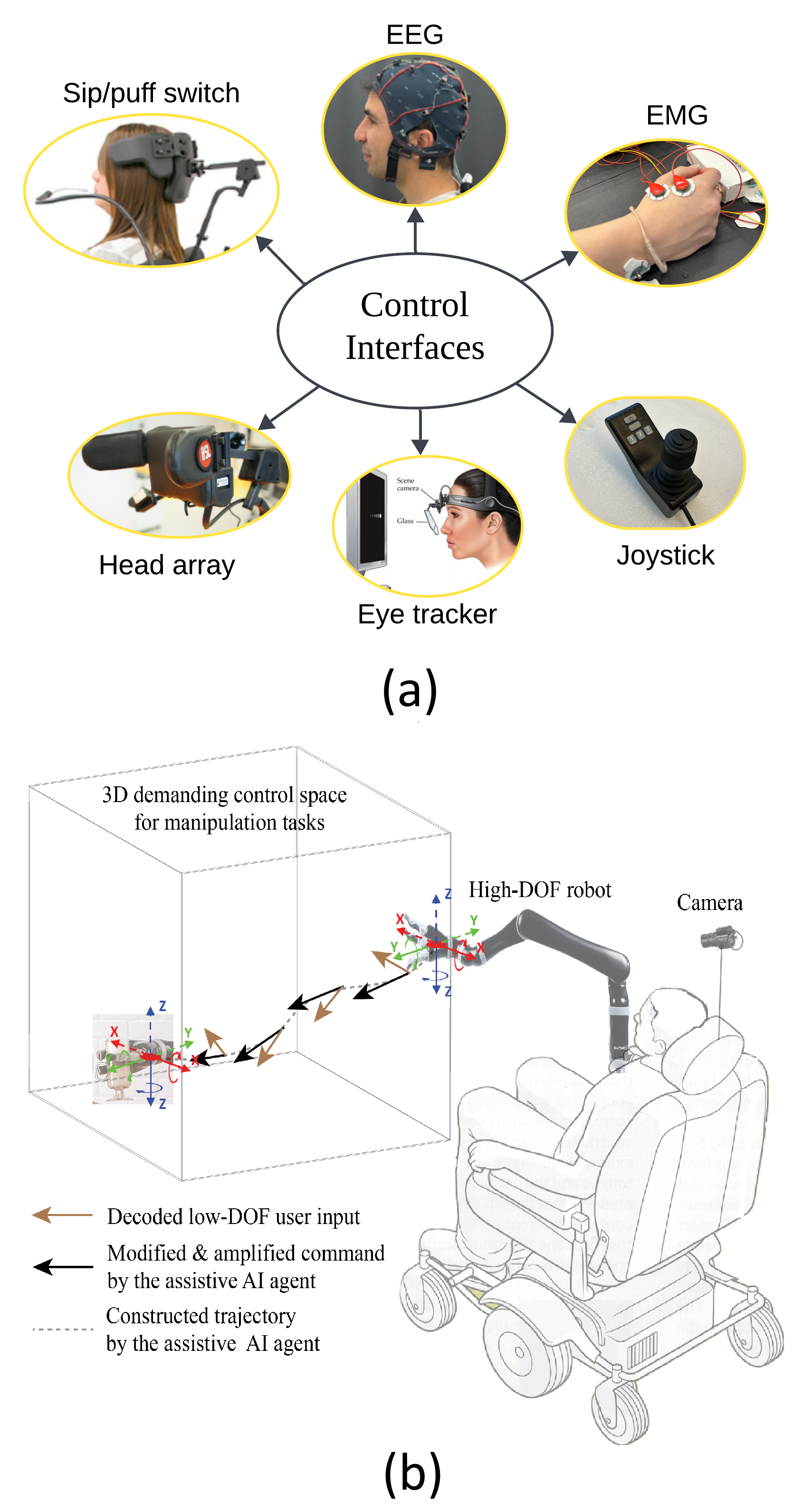

提出ARAS框架,利用多模态AI和强化学习,将有限用户输入转化为高维控制信号,辅助瘫痪患者。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态AI 强化学习 人机交互 辅助技术 机械臂控制

📋 核心要点

- 现有非侵入式辅助技术易受伪迹信号干扰,需要长时间用户训练,难以实现高维控制。

- 论文提出ARAS框架,融合深度强化学习和多模态信息,将有限用户输入转化为对机械臂的精准控制。

- ARAS在模拟和真实用户实验中均表现出色,任务成功率高,完成时间与侵入式技术相当。

📝 摘要(中文)

本研究提出了一种以人为中心的多模态AI方法,作为智能补偿机制,旨在帮助严重瘫痪患者使用有限的非侵入式输入控制高维辅助设备,如灵巧的机械臂。该方法通过集成深度强化学习算法,将有限的低维用户输入与实时环境感知融合,实现对人类意图的自适应、动态和智能的解释,从而完成复杂的灵巧操作任务,如抓取和放置。实验结果表明,经过50,000次计算机模拟训练的ARAS(用于增强共享自主中有限输入的自适应强化学习)在动态意图检测和流畅、稳定的3D轨迹控制方面表现出色,任务成功率高达92.88%,完成时间与最先进的侵入式辅助技术相当。ARAS在23名人类受试者上的零样本sim-to-real迁移评估也取得了高精度。

🔬 方法详解

问题定义:现有非侵入式辅助技术在控制高维度机械臂时面临诸多挑战,包括信号易受干扰、用户训练时间长、鲁棒性差等问题。这些问题限制了瘫痪患者使用非侵入式方法进行复杂操作的能力。

核心思路:论文的核心思路是利用多模态AI和强化学习,构建一个共享自主框架,将用户有限的低维输入与环境感知信息融合,通过强化学习算法学习人类意图,从而实现对高维度机械臂的精准控制。这种方法旨在弥补用户输入的不足,提供智能辅助,降低用户操作难度。

技术框架:ARAS框架包含以下主要模块:1) 用户输入模块,负责接收用户的低维输入信号;2) 环境感知模块,负责获取环境信息,例如物体的位置和姿态;3) 意图识别模块,利用深度学习算法,融合用户输入和环境信息,识别用户的意图;4) 强化学习控制模块,根据用户意图和环境信息,生成机械臂的控制指令;5) 机械臂控制模块,执行控制指令,完成操作任务。整个框架采用闭环控制,不断根据用户反馈和环境变化调整控制策略。

关键创新:最重要的技术创新点在于将多模态信息融合和强化学习相结合,实现对用户意图的自适应、动态和智能的解释。与现有方法相比,ARAS能够更好地理解用户的意图,并根据环境变化进行调整,从而提高控制的精度和鲁棒性。此外,ARAS实现了零样本sim-to-real迁移,降低了在真实环境中训练的成本。

关键设计:ARAS使用深度强化学习算法训练控制策略,奖励函数的设计至关重要,需要平衡任务完成的效率和机械臂运动的平滑性。网络结构方面,采用了卷积神经网络提取环境特征,循环神经网络处理时序信息,并使用注意力机制融合多模态信息。关键参数包括学习率、折扣因子、探索率等,需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

ARAS在模拟环境中经过50,000次训练后,成功实现了零样本sim-to-real迁移。在23名人类受试者上的实验结果表明,ARAS在动态意图检测和3D轨迹控制方面表现出色,任务成功率高达92.88%,完成时间与最先进的侵入式辅助技术相当。这些结果表明ARAS具有很高的实用价值。

🎯 应用场景

该研究成果可应用于辅助技术领域,帮助严重瘫痪患者使用非侵入式方法控制机械臂等辅助设备,提高生活质量。此外,该技术还可应用于人机协作机器人、远程操作等领域,实现更智能、更高效的人机交互。未来,该技术有望与脑机接口等技术结合,实现更精准、更自然的控制。

📄 摘要(原文)

Current invasive assistive technologies are designed to infer high-dimensional motor control signals from severely paralyzed patients. However, they face significant challenges, including public acceptance, limited longevity, and barriers to commercialization. Meanwhile, noninvasive alternatives often rely on artifact-prone signals, require lengthy user training, and struggle to deliver robust high-dimensional control for dexterous tasks. To address these issues, this study introduces a novel human-centered multimodal AI approach as intelligent compensatory mechanisms for lost motor functions that could potentially enable patients with severe paralysis to control high-dimensional assistive devices, such as dexterous robotic arms, using limited and noninvasive inputs. In contrast to the current state-of-the-art (SoTA) noninvasive approaches, our context-aware, multimodal shared-autonomy framework integrates deep reinforcement learning algorithms to blend limited low-dimensional user input with real-time environmental perception, enabling adaptive, dynamic, and intelligent interpretation of human intent for complex dexterous manipulation tasks, such as pick-and-place. The results from our ARAS (Adaptive Reinforcement learning for Amplification of limited inputs in Shared autonomy) trained with synthetic users over 50,000 computer simulation episodes demonstrated the first successful implementation of the proposed closed-loop human-in-the-loop paradigm, outperforming the SoTA shared autonomy algorithms. Following a zero-shot sim-to-real transfer, ARAS was evaluated on 23 human subjects, demonstrating high accuracy in dynamic intent detection and smooth, stable 3D trajectory control for dexterous pick-and-place tasks. ARAS user study achieved a high task success rate of 92.88%, with short completion times comparable to those of SoTA invasive assistive technologies.