X2C: A Dataset Featuring Nuanced Facial Expressions for Realistic Humanoid Imitation

作者: Peizhen Li, Longbing Cao, Xiao-Ming Wu, Runze Yang, Xiaohan Yu

分类: cs.RO, cs.AI, cs.HC

发布日期: 2025-05-16 (更新: 2025-09-20)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

X2C:用于逼真人形模仿的细微面部表情数据集与模仿框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 人机交互 面部表情模仿 人形机器人 数据集 深度学习

📋 核心要点

- 现有人形机器人面部表情模仿缺乏包含多样化表情和精确标注的数据集。

- X2C数据集和X2CNet框架通过学习表情控制值,实现了逼真人形面部表情的模仿。

- 实验表明,X2CNet能够有效模仿人类面部表情,并在真实机器人上进行了验证。

📝 摘要(中文)

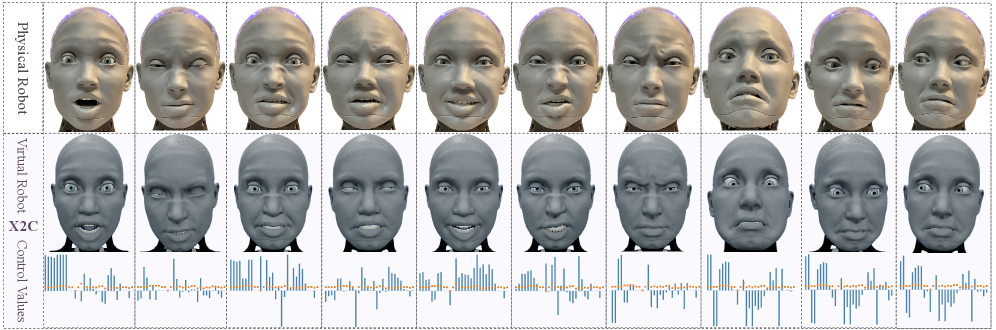

为了提升人机交互中人形机器人面部表情的真实感,本文提出了X2C数据集,旨在解决现有数据集缺乏多样化人形面部表情和精确标注的问题。X2C数据集包含100,000个(图像, 控制值)对,图像展示了人形机器人丰富的面部表情,并标注了30个控制值,代表真实的表情配置。此外,本文还提出了X2CNet,一种新颖的人到人形面部表情模仿框架,它从X2C数据集中学习细微的人形表情及其控制值之间的对应关系。X2CNet能够模仿不同人类表演者的面部表情,为模仿任务提供了一个基线,并展示了数据集的潜在价值。最后,通过在真实人形机器人上的演示,验证了该方法在逼真人形面部表情模仿方面的能力。

🔬 方法详解

问题定义:现有的人形机器人面部表情模仿研究受限于缺乏高质量、多样化的数据集,这些数据集需要包含丰富的人形面部表情以及对应的精确控制参数标注。现有的方法难以捕捉细微的面部表情变化,导致模仿效果不够真实自然。因此,如何构建一个包含大量多样化表情和精确控制值标注的数据集,并设计有效的模仿框架,是本文要解决的关键问题。

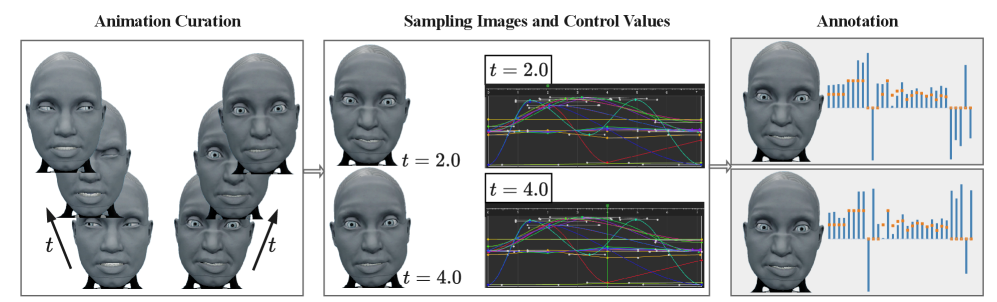

核心思路:本文的核心思路是通过构建一个大规模数据集X2C,该数据集包含大量多样化的人形机器人面部表情图像,并为每个图像标注了30个控制值,这些控制值代表了底层表情配置。然后,利用这个数据集训练一个名为X2CNet的神经网络,学习人类面部表情与人形机器人控制值之间的映射关系。这样,当输入人类的面部表情图像时,X2CNet能够预测出对应的人形机器人控制值,从而实现面部表情的模仿。

技术框架:X2CNet的整体框架包含两个主要部分:数据集构建和网络训练。首先,构建X2C数据集,包含大量人形机器人面部表情图像和对应的控制值标注。然后,使用X2C数据集训练X2CNet,该网络以人类面部表情图像作为输入,输出人形机器人的控制值。在推理阶段,将人类面部表情图像输入到训练好的X2CNet中,得到控制值,然后将这些控制值应用到人形机器人上,从而实现面部表情的模仿。

关键创新:本文的关键创新在于构建了X2C数据集,该数据集是目前为止最大、最全面的包含人形机器人面部表情和控制值标注的数据集。此外,X2CNet框架能够有效地学习人类面部表情与人形机器人控制值之间的映射关系,从而实现逼真的面部表情模仿。与现有方法相比,X2CNet能够更好地捕捉细微的面部表情变化,并能够泛化到不同的表演者。

关键设计:X2C数据集包含100,000个(图像, 控制值)对,其中控制值是30维的向量,代表了人形机器人面部表情的底层配置。X2CNet是一个深度神经网络,具体结构未知,但其目标是最小化预测控制值与真实控制值之间的差异。损失函数可能包括均方误差等。具体的网络结构和训练参数未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,X2CNet能够有效地学习人类面部表情与人形机器人控制值之间的映射关系,实现逼真的面部表情模仿。通过在真实人形机器人上的演示,验证了该方法在实际应用中的可行性。具体的性能数据和对比基线未知,但论文强调了X2C数据集的规模和多样性,以及X2CNet在捕捉细微表情变化方面的优势。

🎯 应用场景

该研究成果可广泛应用于人机交互领域,例如情感陪护机器人、虚拟助手等。通过逼真的面部表情模仿,可以提升机器人与人类的情感连接,增强交互的自然性和有效性。此外,该技术还可以应用于远程呈现、虚拟现实等领域,实现更具表现力和沉浸感的交流体验。未来,该研究有望推动人机交互技术的发展,促进机器人更好地融入人类社会。

📄 摘要(原文)

The ability to imitate realistic facial expressions is essential for humanoid robots engaged in affective human-robot communication. However, the lack of datasets containing diverse humanoid facial expressions with proper annotations hinders progress in realistic humanoid facial expression imitation. To address these challenges, we introduce X2C (Anything to Control), a dataset featuring nuanced facial expressions for realistic humanoid imitation. With X2C, we contribute: 1) a high-quality, high-diversity, large-scale dataset comprising 100,000 (image, control value) pairs. Each image depicts a humanoid robot displaying a diverse range of facial expressions, annotated with 30 control values representing the ground-truth expression configuration; 2) X2CNet, a novel human-to-humanoid facial expression imitation framework that learns the correspondence between nuanced humanoid expressions and their underlying control values from X2C. It enables facial expression imitation in the wild for different human performers, providing a baseline for the imitation task, showcasing the potential value of our dataset; 3) real-world demonstrations on a physical humanoid robot, highlighting its capability to advance realistic humanoid facial expression imitation. Code and Data: https://lipzh5.github.io/X2CNet/