Conditioning Matters: Training Diffusion Policies is Faster Than You Think

作者: Zibin Dong, Yicheng Liu, Yinchuan Li, Hang Zhao, Jianye Hao

分类: cs.RO, cs.AI

发布日期: 2025-05-16

备注: arXiv admin note: substantial text overlap with arXiv:2505.10105

💡 一句话要点

Cocos:通过条件依赖的扩散策略训练加速视觉-语言-动作模型的学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 扩散策略 条件生成 视觉-语言-动作模型 机器人控制 流匹配

📋 核心要点

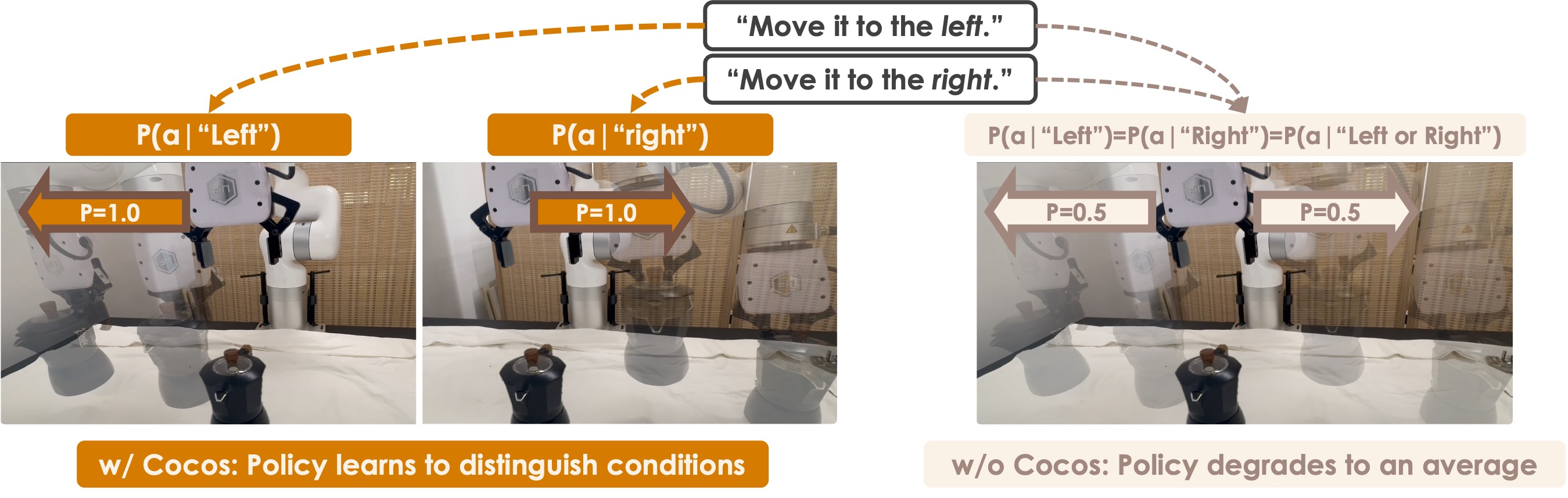

- 现有条件扩散策略训练在条件区分度低时易发生损失崩溃,导致训练效率低下。

- Cocos通过引入条件依赖的源分布,增强条件整合,有效防止损失崩溃。

- 实验表明,Cocos能显著加速扩散策略训练,并以更少的资源达到甚至超越现有VLA模型的性能。

📝 摘要(中文)

扩散策略已成为构建视觉-语言-动作(VLA)模型的主流范式。尽管它们展示了强大的机器人控制能力,但其训练效率仍然欠佳。本文指出了条件扩散策略训练中的一个根本挑战:当生成条件难以区分时,训练目标会退化为建模边缘动作分布,我们称之为损失崩溃。为了克服这个问题,我们提出了一种简单而通用的解决方案Cocos,它修改了条件流匹配中的源分布,使其具有条件依赖性。通过将源分布锚定在从条件输入中提取的语义周围,Cocos鼓励更强的条件整合,并防止损失崩溃。我们提供了理论证明和跨模拟和真实世界基准的广泛经验结果。我们的方法比现有方法实现了更快的收敛速度和更高的成功率,使用明显更少的梯度步数和参数,即可匹配大规模预训练VLA的性能。Cocos是轻量级的,易于实现,并且与各种策略架构兼容,为扩散策略训练提供了通用的改进。

🔬 方法详解

问题定义:论文旨在解决视觉-语言-动作(VLA)模型中,基于扩散策略的训练效率问题。现有方法在条件信息区分度不高时,容易出现“损失崩溃”现象,即模型退化为学习动作的边缘分布,而忽略了条件信息,导致训练缓慢且效果不佳。

核心思路:论文的核心思路是使扩散模型的源分布具有条件依赖性。具体来说,不是使用固定的源分布(例如标准高斯分布),而是根据输入条件(例如视觉或语言信息)动态调整源分布,使其围绕从条件中提取的语义信息进行锚定。这样可以强制模型更加关注条件信息,从而避免损失崩溃。

技术框架:Cocos方法的核心在于修改了条件流匹配(Conditional Flow Matching)的训练目标。标准的条件流匹配旨在学习一个时间相关的向量场,将一个简单的源分布(如高斯分布)转换为目标分布(动作分布),同时考虑条件信息。Cocos通过修改源分布,使其成为条件的函数,从而影响向量场的学习过程。整体训练流程与标准的条件扩散策略类似,包括前向扩散过程和反向生成过程。

关键创新:Cocos的关键创新在于提出了条件依赖的源分布的概念,并将其应用于条件扩散策略的训练中。与现有方法相比,Cocos不是简单地将条件信息作为扩散过程的输入,而是直接影响了扩散过程的起始状态,从而更有效地利用了条件信息。

关键设计:Cocos的关键设计在于如何根据条件信息来确定源分布。论文中,作者使用一个编码器(例如Transformer)从条件输入中提取语义特征,然后使用这些特征来确定源分布的均值和方差。具体来说,源分布被建模为一个以语义特征为中心的多元高斯分布。损失函数仍然是基于流匹配的损失函数,但由于源分布的变化,梯度更新的方向也会发生变化,从而鼓励模型更好地整合条件信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Cocos在多个模拟和真实世界的机器人控制任务中,均优于现有的扩散策略训练方法。例如,在某些任务中,Cocos能够以更少的梯度步数达到与大规模预训练VLA模型相当的性能,并且显著提高了成功率。与基线方法相比,Cocos在训练速度和最终性能上均有显著提升。

🎯 应用场景

Cocos方法可广泛应用于机器人控制、自动驾驶、游戏AI等领域,尤其是在需要根据视觉、语言等复杂条件生成动作的场景中。该方法能够提高模型的训练效率和性能,降低对大规模数据集的依赖,加速相关技术的落地和应用。未来,Cocos的思路可以扩展到其他生成模型和条件生成任务中。

📄 摘要(原文)

Diffusion policies have emerged as a mainstream paradigm for building vision-language-action (VLA) models. Although they demonstrate strong robot control capabilities, their training efficiency remains suboptimal. In this work, we identify a fundamental challenge in conditional diffusion policy training: when generative conditions are hard to distinguish, the training objective degenerates into modeling the marginal action distribution, a phenomenon we term loss collapse. To overcome this, we propose Cocos, a simple yet general solution that modifies the source distribution in the conditional flow matching to be condition-dependent. By anchoring the source distribution around semantics extracted from condition inputs, Cocos encourages stronger condition integration and prevents the loss collapse. We provide theoretical justification and extensive empirical results across simulation and real-world benchmarks. Our method achieves faster convergence and higher success rates than existing approaches, matching the performance of large-scale pre-trained VLAs using significantly fewer gradient steps and parameters. Cocos is lightweight, easy to implement, and compatible with diverse policy architectures, offering a general-purpose improvement to diffusion policy training.