Planar Velocity Estimation for Fast-Moving Mobile Robots Using Event-Based Optical Flow

作者: Liam Boyle, Jonas Kühne, Nicolas Baumann, Niklas Bastuck, Michele Magno

分类: cs.RO, cs.CV

发布日期: 2025-05-16

💡 一句话要点

提出基于事件相机的平面速度估计方法,提升快速移动机器人速度估计精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 光流 速度估计 平面运动学 移动机器人

📋 核心要点

- 传统移动机器人速度估计依赖车轮里程计和IMU融合,易受滑动和复杂车辆动力学模型影响,在复杂环境下精度下降。

- 利用事件相机捕获地面光流,结合平面运动学,无需车轮与地面牵引假设,实现更鲁棒的速度估计。

- 实验表明,该方法在精度上与Event-VIO相当,横向误差降低38.3%,并在高速环境下表现出潜力。

📝 摘要(中文)

本文提出了一种用于快速移动机器人速度估计的方法,尤其适用于驾驶辅助系统和自动驾驶。该方法利用事件相机捕获的光流信息,结合平面运动学原理,无需依赖车轮测距和IMU数据融合,从而避免了传统方法中对非滑动转向等强假设的依赖。事件相机具有微秒级延迟和高动态范围,对运动模糊具有很强的鲁棒性。通过在1:10比例的自动驾驶赛车平台上进行实验,并与精确的运动捕捉数据进行对比,结果表明该方法在性能上与最先进的Event-VIO方法相当,并且横向误差降低了38.3%。在高达32米/秒的高速公路速度下的定性实验进一步证实了该方法的有效性,表明其在实际部署中具有巨大的潜力。

🔬 方法详解

问题定义:现有移动机器人速度估计方法,如车轮里程计结合IMU,依赖于车辆运动学模型和车轮与地面的摩擦力假设。在复杂或易滑路面,这些假设不再成立,导致速度估计精度显著下降。因此,需要一种不依赖这些假设的速度估计方法。

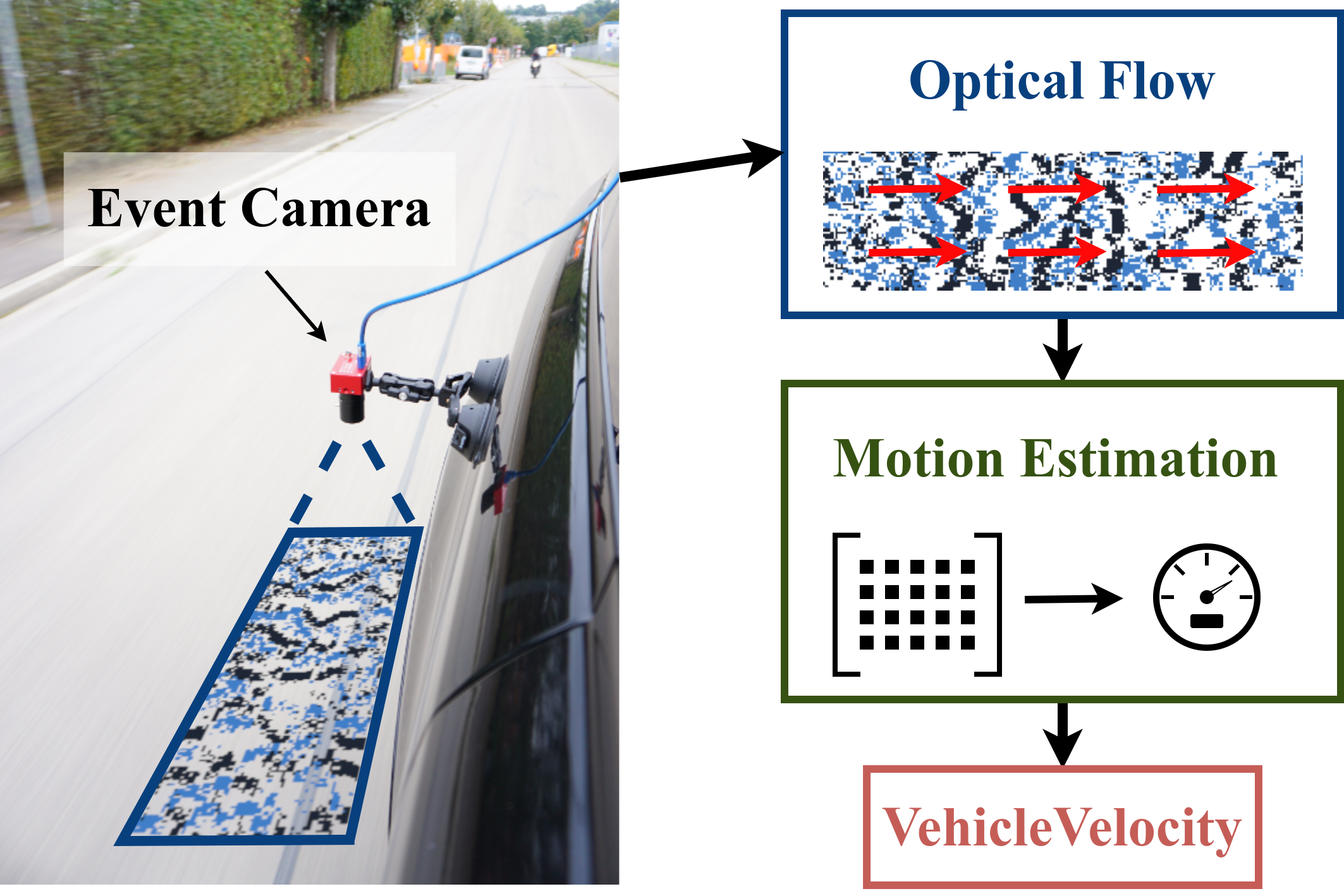

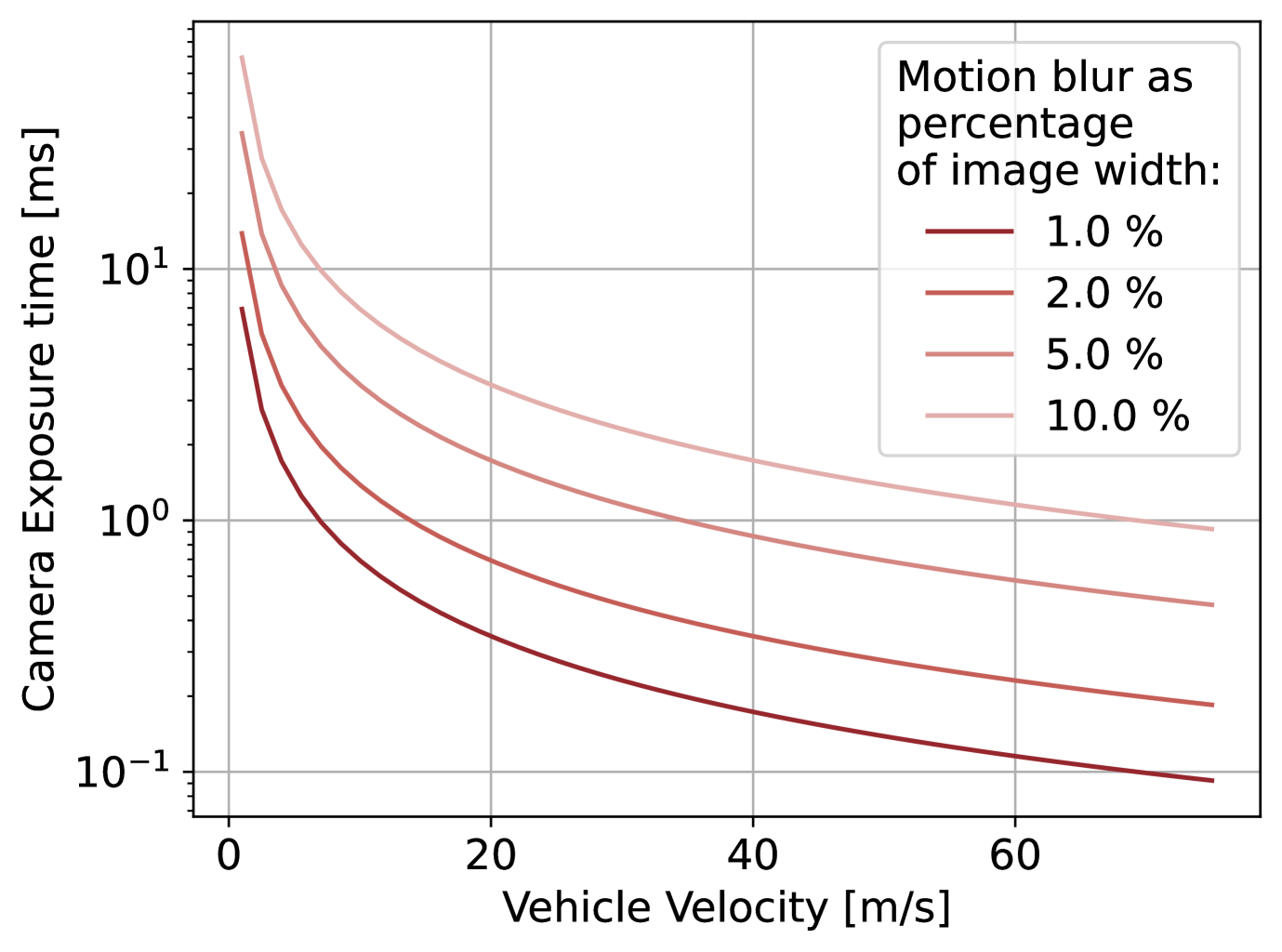

核心思路:本文的核心思路是利用事件相机捕获地面纹理的光流信息,并结合平面运动学约束,直接估计机器人的速度。事件相机具有高动态范围和低延迟的特点,能够有效克服运动模糊问题,从而提供更准确的光流信息。通过将光流信息与平面运动学模型相结合,可以推导出机器人的速度。

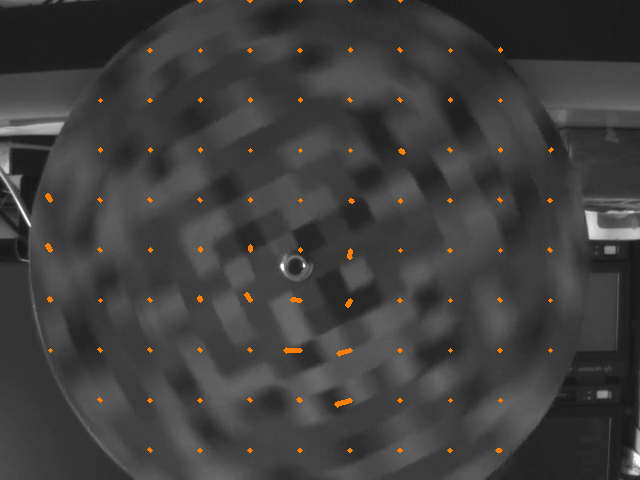

技术框架:该方法主要包含以下几个模块:1) 事件相机数据采集:使用事件相机垂直朝下拍摄地面纹理。2) 光流计算:从事件相机数据中提取光流信息。3) 平面运动学建模:建立机器人平面运动学模型,将光流信息与机器人速度关联起来。4) 速度估计:利用光流信息和平面运动学模型,估计机器人的速度。

关键创新:该方法最重要的创新点在于将事件相机和平面运动学相结合,用于速度估计。与传统方法相比,该方法不依赖于车轮里程计和IMU,从而避免了对车辆运动学模型和车轮与地面摩擦力假设的依赖。此外,事件相机的高动态范围和低延迟特性,使其能够有效克服运动模糊问题,从而提供更准确的光流信息。

关键设计:该方法的关键设计包括:1) 事件相机的安装角度:事件相机垂直朝下安装,以保证能够捕获到地面纹理的光流信息。2) 光流算法的选择:选择适合事件相机数据的光流算法,例如基于梯度或基于匹配的算法。3) 平面运动学模型的建立:建立准确的平面运动学模型,将光流信息与机器人速度关联起来。4) 速度估计的优化:采用合适的优化算法,例如最小二乘法,对速度进行估计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在1:10比例的自动驾驶赛车平台上,性能与最先进的Event-VIO方法相当,并且横向误差降低了38.3%。在高达32米/秒的高速公路速度下的定性实验进一步证实了该方法的有效性,表明其在实际部署中具有巨大的潜力。

🎯 应用场景

该研究成果可应用于自动驾驶、无人配送、机器人导航等领域。尤其在需要高精度速度估计的场景,如高速行驶、复杂路况等,该方法具有显著优势。未来可进一步扩展到三维运动估计,并与其他传感器融合,提升机器人感知能力。

📄 摘要(原文)

Accurate velocity estimation is critical in mobile robotics, particularly for driver assistance systems and autonomous driving. Wheel odometry fused with Inertial Measurement Unit (IMU) data is a widely used method for velocity estimation; however, it typically requires strong assumptions, such as non-slip steering, or complex vehicle dynamics models that do not hold under varying environmental conditions like slippery surfaces. We introduce an approach to velocity estimation that is decoupled from wheel-to-surface traction assumptions by leveraging planar kinematics in combination with optical flow from event cameras pointed perpendicularly at the ground. The asynchronous micro-second latency and high dynamic range of event cameras make them highly robust to motion blur, a common challenge in vision-based perception techniques for autonomous driving. The proposed method is evaluated through in-field experiments on a 1:10 scale autonomous racing platform and compared to precise motion capture data, demonstrating not only performance on par with the state-of-the-art Event-VIO method but also a 38.3 % improvement in lateral error. Qualitative experiments at highway speeds of up to 32 m/s further confirm the effectiveness of our approach, indicating significant potential for real-world deployment.