ManipBench: Benchmarking Vision-Language Models for Low-Level Robot Manipulation

作者: Enyu Zhao, Vedant Raval, Hejia Zhang, Jiageng Mao, Zeyu Shangguan, Stefanos Nikolaidis, Yue Wang, Daniel Seita

分类: cs.RO, cs.AI

发布日期: 2025-05-14 (更新: 2025-08-30)

备注: Conference on Robot Learning (CoRL) 2025. 50 pages and 30 figures. v2 is the camera-ready and includes a few more new experiments compared to v1

💡 一句话要点

提出ManipBench:用于评估视觉-语言模型在机器人底层操作任务中的性能

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 视觉-语言模型 机器人操作 底层推理 基准测试 物体交互

📋 核心要点

- 现有VLMs主要作为高层规划器,缺乏针对机器人底层操作推理能力的系统评估。

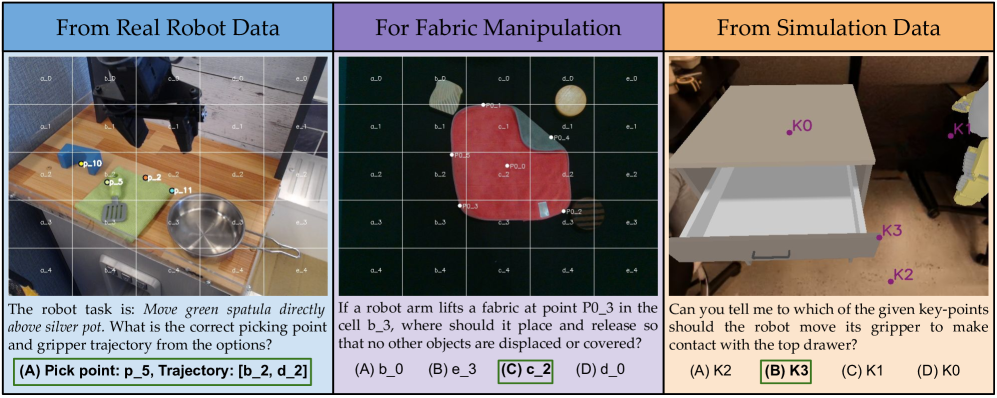

- 提出ManipBench基准,旨在全面评估VLMs在理解物体交互和可变形物体操作等方面的能力。

- 实验结果表明,VLMs在不同任务中表现差异大,与真实操作任务存在差距,有待进一步提升。

📝 摘要(中文)

视觉-语言模型(VLMs)凭借其常识推理能力,彻底改变了人工智能和机器人领域。在机器人操作中,VLMs主要用作高层规划器,但最近的研究也关注其底层推理能力,即对精确机器人运动做出决策的能力。然而,目前业界缺乏一个清晰且通用的基准,来评估VLMs在机器人底层推理方面的能力。因此,我们提出了一个新的基准测试ManipBench,用于评估VLMs在各种维度上的底层机器人操作推理能力,包括它们对物体间交互和可变形物体操作的理解程度。我们在该基准上广泛测试了33个具有代表性的VLMs,涵盖10个模型家族,包括不同模型大小的变体。我们的评估表明,VLMs的性能在不同任务中差异显著,并且这种性能与我们在真实世界操作任务中的趋势之间存在很强的相关性。它还表明,这些模型与人类水平的理解之间仍然存在显著差距。

🔬 方法详解

问题定义:现有视觉-语言模型(VLMs)在机器人操作领域主要应用于高层规划,缺乏针对底层操作推理能力的有效评估手段。这使得我们难以了解VLMs在处理精细运动控制、物体间交互以及可变形物体操作等任务中的真实性能,阻碍了相关技术的发展。现有方法缺乏统一的评估标准和多样化的测试场景,难以全面反映VLMs的优缺点。

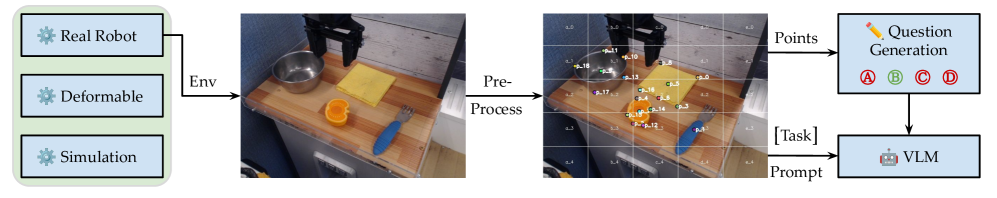

核心思路:ManipBench的核心思路是构建一个包含多种底层机器人操作任务的综合性基准测试平台。通过设计不同的任务场景,例如物体抓取、放置、组装以及可变形物体的操作等,来考察VLMs在理解物体属性、空间关系以及物理交互方面的能力。该基准旨在提供一个公平、客观的评估环境,促进VLMs在机器人操作领域的应用。

技术框架:ManipBench主要包含以下几个关键模块:1) 任务定义模块:定义了多种具有挑战性的底层机器人操作任务,涵盖了不同的物体类型和操作方式。2) 评估指标模块:设计了一系列定量和定性的评估指标,用于衡量VLMs在不同任务中的性能表现。3) 模型集成模块:提供了一个统一的接口,方便集成各种不同的VLMs进行测试。4) 数据可视化模块:将实验结果以图表等形式进行可视化展示,方便用户进行分析和比较。

关键创新:ManipBench的关键创新在于其专注于评估VLMs在机器人底层操作推理方面的能力。与以往侧重于高层规划的基准测试不同,ManipBench更加关注VLMs对物体属性、空间关系以及物理交互的理解。此外,ManipBench还引入了可变形物体操作等更具挑战性的任务,进一步提升了评估的全面性和深度。

关键设计:ManipBench的任务设计涵盖了多种类型的物体,包括刚性物体和可变形物体。评估指标包括操作成功率、操作时间、以及对物体属性和空间关系的理解程度。在模型集成方面,ManipBench提供了一个统一的API,方便用户集成不同的VLMs进行测试。此外,ManipBench还提供了详细的文档和示例代码,方便用户快速上手。

🖼️ 关键图片

📊 实验亮点

ManipBench基准测试在33个具有代表性的VLMs上进行了广泛测试,涵盖10个模型家族。实验结果表明,VLMs的性能在不同任务中差异显著,并且这种性能与真实世界操作任务中的趋势之间存在很强的相关性。该研究还揭示了现有VLMs与人类水平的理解之间仍然存在显著差距,为未来的研究方向提供了重要参考。

🎯 应用场景

该研究成果可应用于智能制造、家庭服务机器人、医疗机器人等领域。通过提升VLMs在底层操作推理方面的能力,可以使机器人更精确地执行复杂的操作任务,提高生产效率和服务质量。未来,该基准测试可以不断扩展,纳入更多具有挑战性的任务,推动机器人技术的进一步发展。

📄 摘要(原文)

Vision-Language Models (VLMs) have revolutionized artificial intelligence and robotics due to their commonsense reasoning capabilities. In robotic manipulation, VLMs are used primarily as high-level planners, but recent work has also studied their lower-level reasoning ability, which refers to making decisions about precise robot movements. However, the community currently lacks a clear and common benchmark that can evaluate how well VLMs can aid low-level reasoning in robotics. Consequently, we propose a novel benchmark, ManipBench, to evaluate the low-level robot manipulation reasoning capabilities of VLMs across various dimensions, including how well they understand object-object interactions and deformable object manipulation. We extensively test 33 representative VLMs across 10 model families on our benchmark, including variants to test different model sizes. Our evaluation shows that the performance of VLMs significantly varies across tasks, and there is a strong correlation between this performance and trends in our real-world manipulation tasks. It also shows that there remains a significant gap between these models and human-level understanding. See our website at: https://manipbench.github.io.