FoldNet: Learning Generalizable Closed-Loop Policy for Garment Folding via Keypoint-Driven Asset and Demonstration Synthesis

作者: Yuxing Chen, Bowen Xiao, He Wang

分类: cs.RO, cs.CV

发布日期: 2025-05-14 (更新: 2026-01-23)

💡 一句话要点

FoldNet:通过关键点驱动的资产和演示合成学习服装折叠的通用闭环策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人 服装折叠 模仿学习 合成数据 关键点检测

📋 核心要点

- 机器人服装操作任务面临数据获取难题,服装的易变形性使得高质量数据难以获取。

- 论文提出一种基于关键点驱动的资产和演示合成方法,生成合成服装数据集,用于训练折叠策略。

- 提出的KG-DAgger算法通过关键点引导的策略从失败中恢复,显著提升了真实世界中的折叠成功率。

📝 摘要(中文)

由于服装的易变形性,为机器人服装操作任务生成大量高质量数据极具挑战性。本文提出了一种合成服装数据集,可用于机器人服装折叠。首先,基于关键点构建几何服装模板,并应用生成模型生成逼真的纹理图案。利用这些关键点标注,在仿真中生成折叠演示,并通过闭环模仿学习训练折叠策略。为了提高鲁棒性,我们提出了KG-DAgger,它使用基于关键点的策略来生成演示数据,以从失败中恢复。KG-DAgger显著提高了模型性能,将真实世界的成功率提高了25%。经过15K轨迹(约200万图像-动作对)的训练后,该模型在真实世界中达到了75%的成功率。在仿真和真实环境中的实验验证了我们提出的框架的有效性。

🔬 方法详解

问题定义:机器人服装折叠任务面临数据稀缺问题,真实数据的采集成本高昂,且服装的易变形性使得仿真数据的真实性难以保证。现有方法难以生成足够数量和质量的数据来训练鲁棒的折叠策略。

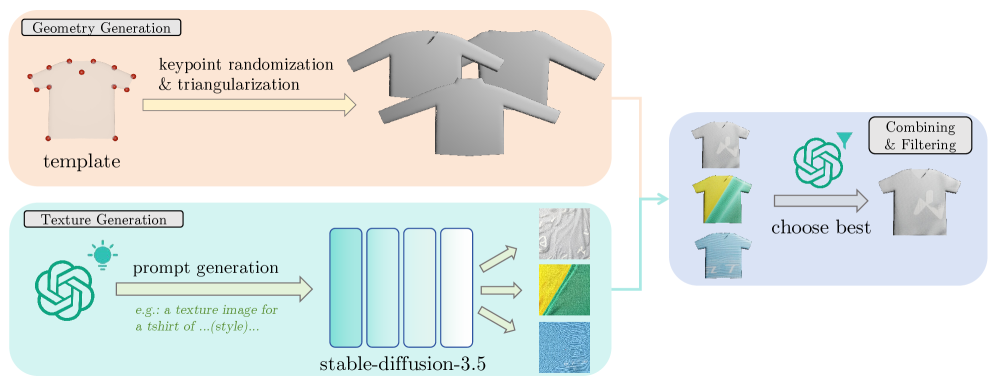

核心思路:论文的核心思路是通过合成数据来解决数据稀缺问题。具体而言,首先构建基于关键点的几何服装模板,然后利用生成模型生成逼真的纹理图案,从而合成高质量的服装图像。此外,利用关键点信息生成折叠演示,并通过模仿学习训练折叠策略。

技术框架:整体框架包含以下几个主要模块:1) 基于关键点的几何服装模板构建;2) 利用生成模型合成逼真纹理;3) 基于关键点生成折叠演示;4) 通过闭环模仿学习训练折叠策略;5) 使用KG-DAgger算法从失败中恢复,提高鲁棒性。KG-DAgger算法在训练过程中,根据关键点信息判断当前状态,并生成相应的演示数据,用于纠正策略的错误。

关键创新:论文的关键创新在于提出了一种基于关键点驱动的资产和演示合成方法,该方法能够有效地生成高质量的合成数据,用于训练机器人服装折叠策略。此外,提出的KG-DAgger算法能够利用关键点信息从失败中恢复,显著提高了策略的鲁棒性。

关键设计:KG-DAgger算法的关键设计在于使用关键点信息来指导演示数据的生成。具体而言,算法首先检测当前状态的关键点,然后根据关键点的位置和姿态,生成相应的演示动作,用于纠正策略的错误。损失函数包括模仿学习损失和KG-DAgger损失,用于训练折叠策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在真实世界中达到了75%的折叠成功率,相较于基线方法,成功率提高了25%。通过使用15K轨迹(约200万图像-动作对)进行训练,验证了该方法的有效性。KG-DAgger算法在提高模型鲁棒性方面发挥了关键作用。

🎯 应用场景

该研究成果可应用于服装制造、仓储物流、家政服务等领域。通过机器人自动完成服装折叠,可以提高生产效率,降低人工成本,并改善工作环境。未来,该技术有望扩展到其他柔性物体的操作任务中,例如毛巾、床单等。

📄 摘要(原文)

Due to the deformability of garments, generating a large amount of high-quality data for robotic garment manipulation tasks is highly challenging. In this paper, we present a synthetic garment dataset that can be used for robotic garment folding. We begin by constructing geometric garment templates based on keypoints and applying generative models to generate realistic texture patterns. Leveraging these keypoint annotations, we generate folding demonstrations in simulation and train folding policies via closed-loop imitation learning. To improve robustness, we propose KG-DAgger, which uses a keypoint-based strategy to generate demonstration data for recovering from failures. KG-DAgger significantly improves the model performance, boosting the real-world success rate by 25\%. After training with 15K trajectories (about 2M image-action pairs), the model achieves a 75\% success rate in the real world. Experiments in both simulation and real-world settings validate the effectiveness of our proposed framework.