Multi-step manipulation task and motion planning guided by video demonstration

作者: Kateryna Zorina, David Kovar, Mederic Fourmy, Florent Lamiraux, Nicolas Mansard, Justin Carpentier, Josef Sivic, Vladimir Petrik

分类: cs.RO, cs.CV, eess.SY

发布日期: 2025-05-13

💡 一句话要点

提出视频引导的多步操作任务与运动规划方法,解决复杂机器人操作任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 运动规划 视频引导 任务规划 快速探索随机树

📋 核心要点

- 现有方法在解决复杂多步机器人操作任务时,难以有效利用人类演示视频中的信息,导致规划效率低下。

- 该方法扩展了RRT规划器,利用视频中的抓取、释放状态和物体姿态信息,引导规划过程,从而解决具有顺序依赖性的任务。

- 通过在多个机器人平台上的实验,验证了该方法在复杂操作任务中的有效性,并展示了其在真实机器人上的可行性。

📝 摘要(中文)

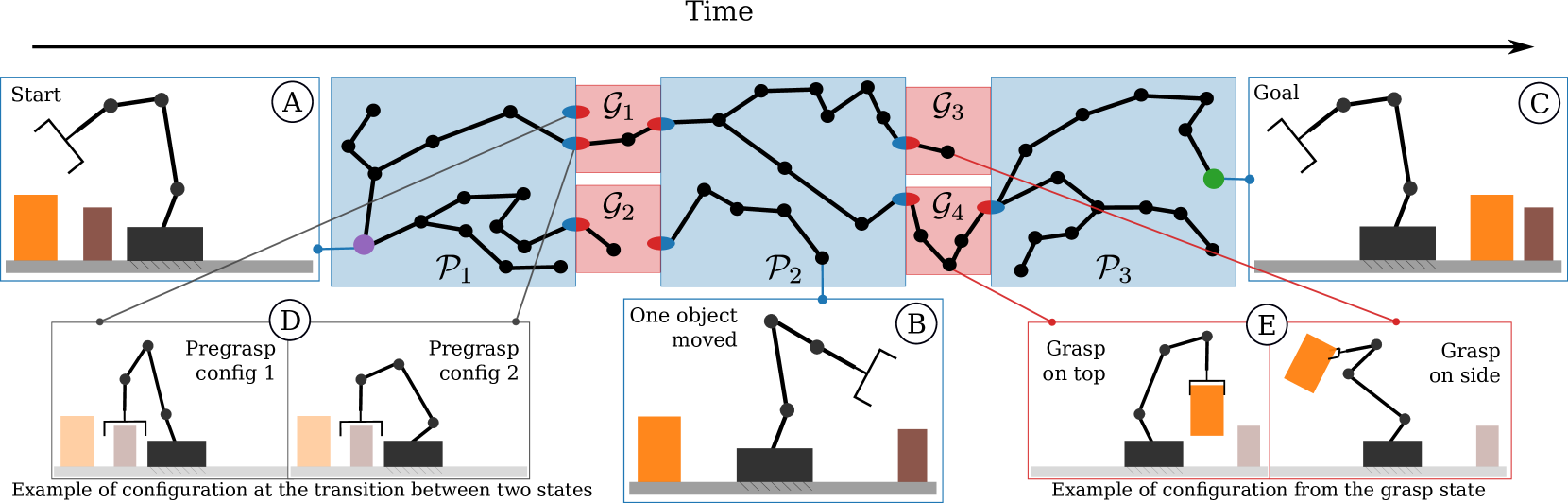

本研究旨在利用教学视频解决机器人中复杂的多步任务与运动规划问题。为此,我们提出了一种对成熟的快速探索随机树(RRT)规划器的扩展,该规划器同时围绕从引导视频中提取的抓取和释放状态生长多个树。我们的主要创新在于将从引导视频中提取的接触状态和3D对象姿势与传统的规划算法相结合,从而解决具有顺序依赖性的任务,例如,如果需要将对象放置在特定位置以便稍后抓取。我们还研究了我们的方法超越教学视频中描绘的场景的泛化能力。为了证明所提出的视频引导规划方法的优势,我们设计了一个新的基准,包含三个具有挑战性的任务:(I)在桌子和架子之间对多个对象进行3D重新排列,(ii)通过隧道多步转移对象,以及(iii)使用托盘转移对象,类似于服务员转移菜肴。我们展示了我们的规划算法在包括Franka Emika Panda和KUKA KMR iiwa在内的多个机器人上的有效性。为了将获得的计划无缝转移到真实机器人,我们开发了一种轨迹细化方法,该方法被公式化为最优控制问题(OCP)。

🔬 方法详解

问题定义:论文旨在解决复杂多步机器人操作任务的规划问题。现有方法通常难以有效地利用人类演示视频中的信息,或者无法处理具有顺序依赖性的任务,例如需要先放置物体才能抓取的情况。这导致规划效率低下,难以应用于实际场景。

核心思路:论文的核心思路是利用教学视频中的信息(包括抓取、释放状态和物体姿态)来引导运动规划过程。通过扩展传统的RRT规划器,使其能够同时围绕从视频中提取的关键状态生长多个树,从而加速规划过程并解决具有顺序依赖性的任务。

技术框架:整体框架包括以下几个主要步骤:1) 从教学视频中提取关键帧,并识别抓取和释放状态以及物体的3D姿态;2) 基于提取的信息,扩展RRT规划器,使其能够同时围绕多个目标状态生长树;3) 使用规划器生成机器人的运动轨迹;4) 通过最优控制问题(OCP)对轨迹进行细化,使其更适合真实机器人的执行。

关键创新:最重要的技术创新在于将视频中的信息与传统的运动规划算法相结合。传统的RRT算法通常需要手动指定目标状态,而该方法能够自动从视频中提取目标状态,并利用这些状态来引导规划过程。此外,该方法还能够处理具有顺序依赖性的任务,这是传统RRT算法难以做到的。

关键设计:关键设计包括:1) 如何从视频中准确提取抓取、释放状态和物体姿态;2) 如何扩展RRT规划器,使其能够同时围绕多个目标状态生长树;3) 如何定义最优控制问题(OCP),以对轨迹进行细化,使其更适合真实机器人的执行。具体的参数设置和损失函数等细节在论文中可能有所描述,但摘要中未提及。

🖼️ 关键图片

📊 实验亮点

论文设计了包含三个具有挑战性的任务的新基准,包括3D物体重排、隧道物体转移和托盘物体转移。实验结果表明,该方法在Franka Emika Panda和KUKA KMR iiwa等多个机器人平台上均有效,验证了其在复杂操作任务中的可行性。论文还开发了一种轨迹优化方法,能够将规划结果无缝转移到真实机器人上。

🎯 应用场景

该研究成果可应用于各种需要复杂操作的机器人应用场景,例如:自动化装配、物流分拣、家庭服务机器人等。通过学习人类的演示视频,机器人可以更快速、更有效地完成各种复杂任务,提高生产效率和服务质量,并降低人工成本。未来,该技术有望进一步发展,实现更智能、更灵活的机器人操作。

📄 摘要(原文)

This work aims to leverage instructional video to solve complex multi-step task-and-motion planning tasks in robotics. Towards this goal, we propose an extension of the well-established Rapidly-Exploring Random Tree (RRT) planner, which simultaneously grows multiple trees around grasp and release states extracted from the guiding video. Our key novelty lies in combining contact states and 3D object poses extracted from the guiding video with a traditional planning algorithm that allows us to solve tasks with sequential dependencies, for example, if an object needs to be placed at a specific location to be grasped later. We also investigate the generalization capabilities of our approach to go beyond the scene depicted in the instructional video. To demonstrate the benefits of the proposed video-guided planning approach, we design a new benchmark with three challenging tasks: (I) 3D re-arrangement of multiple objects between a table and a shelf, (ii) multi-step transfer of an object through a tunnel, and (iii) transferring objects using a tray similar to a waiter transfers dishes. We demonstrate the effectiveness of our planning algorithm on several robots, including the Franka Emika Panda and the KUKA KMR iiwa. For a seamless transfer of the obtained plans to the real robot, we develop a trajectory refinement approach formulated as an optimal control problem (OCP).