Continuous World Coverage Path Planning for Fixed-Wing UAVs using Deep Reinforcement Learning

作者: Mirco Theile, Andres R. Zapata Rodriguez, Marco Caccamo, Alberto L. Sangiovanni-Vincentelli

分类: cs.RO, cs.LG, eess.SY

发布日期: 2025-05-13

备注: Submitted to IROS 2025

💡 一句话要点

提出基于深度强化学习的固定翼无人机连续世界覆盖路径规划方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 无人机覆盖路径规划 深度强化学习 连续空间规划 Soft Actor-Critic 自适应课程学习

📋 核心要点

- 传统无人机覆盖路径规划依赖离散网格,忽略了实际应用中对节能连续运动规划的需求。

- 本文提出一种基于深度强化学习的连续空间覆盖路径规划方法,优化无人机功耗并保证覆盖完整性。

- 实验结果表明,该方法在程序生成和手工设计的场景中,能够有效学习节能的覆盖策略。

📝 摘要(中文)

本文提出了一种用于固定翼无人机(UAV)覆盖路径规划(CPP)的方法,该方法对于精准农业和搜索救援等应用至关重要。与依赖离散网格表示的传统方法不同,本文关注实际UAV操作中所需的节能连续运动规划。我们将UAV CPP问题定义在连续环境中,旨在最小化功耗并确保完全覆盖。我们使用可变大小的轴对齐矩形来建模环境,并使用曲率约束的Bézier曲线来描述UAV的运动。我们使用基于动作映射的Soft Actor-Critic(AM-SAC)算法训练强化学习智能体,并采用自适应课程学习。在程序生成和手工设计的场景中进行的实验表明,我们的方法在学习节能覆盖策略方面是有效的。

🔬 方法详解

问题定义:无人机覆盖路径规划(CPP)旨在找到一条路径,使无人机能够有效地覆盖目标区域。传统方法通常使用离散的网格表示环境,这导致路径规划结果不够平滑,并且忽略了无人机的运动学约束,从而导致能量效率低下。现有的基于离散网格的方法难以直接应用于实际的无人机操作,因为它们无法充分利用无人机的运动特性来优化能量消耗。

核心思路:本文的核心思路是将无人机CPP问题建模为一个连续优化问题,并使用强化学习来寻找最优的覆盖路径。通过在连续空间中直接规划路径,可以更好地利用无人机的运动学约束,从而实现更节能的覆盖。此外,使用强化学习可以使无人机智能体能够从与环境的交互中学习,从而适应不同的环境和任务需求。

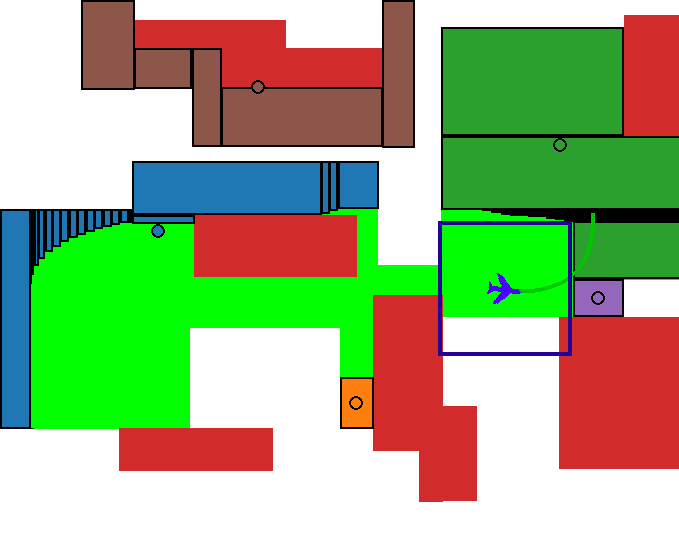

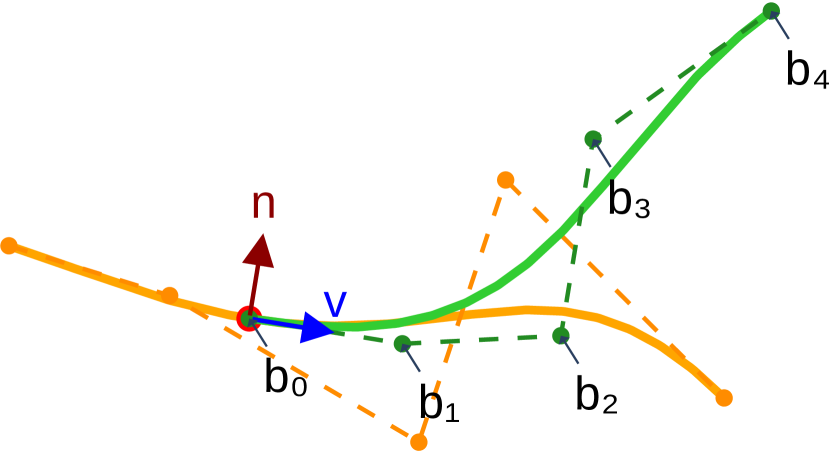

技术框架:该方法采用基于动作映射的Soft Actor-Critic(AM-SAC)算法。整体流程包括:1) 使用可变大小的轴对齐矩形来表示环境;2) 使用曲率约束的Bézier曲线来描述无人机的运动;3) 使用AM-SAC算法训练强化学习智能体,该智能体通过与环境交互来学习最优的覆盖策略;4) 采用自适应课程学习来加速智能体的训练过程。

关键创新:该方法的关键创新在于将无人机CPP问题建模为一个连续优化问题,并使用基于动作映射的Soft Actor-Critic(AM-SAC)算法来解决该问题。与传统的基于离散网格的方法相比,该方法能够更好地利用无人机的运动学约束,从而实现更节能的覆盖。此外,使用自适应课程学习可以加速智能体的训练过程,使其能够更快地适应不同的环境和任务需求。

关键设计:环境建模使用可变大小的轴对齐矩形,允许灵活地表示不同形状的区域。无人机运动使用曲率约束的Bézier曲线,保证路径的平滑性和可行性。AM-SAC算法使用深度神经网络来近似策略和价值函数。自适应课程学习根据智能体的学习进度动态调整训练难度,从而加速训练过程。损失函数的设计旨在最小化功耗并确保完全覆盖。

🖼️ 关键图片

📊 实验亮点

该研究在程序生成和手工设计的场景中进行了实验,结果表明该方法能够有效地学习节能的覆盖策略。具体性能数据未知,但摘要强调了该方法在学习节能覆盖策略方面的有效性,暗示了与传统方法相比,在能量效率方面有显著提升。自适应课程学习的使用也加速了智能体的训练过程。

🎯 应用场景

该研究成果可广泛应用于精准农业、搜索救援、环境监测等领域。在精准农业中,无人机可以用于农作物病虫害监测、农田灌溉管理等。在搜索救援中,无人机可以用于快速搜索失踪人员。在环境监测中,无人机可以用于空气质量监测、水质监测等。该研究有助于提升无人机作业效率,降低运营成本,并为相关行业带来智能化升级。

📄 摘要(原文)

Unmanned Aerial Vehicle (UAV) Coverage Path Planning (CPP) is critical for applications such as precision agriculture and search and rescue. While traditional methods rely on discrete grid-based representations, real-world UAV operations require power-efficient continuous motion planning. We formulate the UAV CPP problem in a continuous environment, minimizing power consumption while ensuring complete coverage. Our approach models the environment with variable-size axis-aligned rectangles and UAV motion with curvature-constrained Bézier curves. We train a reinforcement learning agent using an action-mapping-based Soft Actor-Critic (AM-SAC) algorithm employing a self-adaptive curriculum. Experiments on both procedurally generated and hand-crafted scenarios demonstrate the effectiveness of our method in learning energy-efficient coverage strategies.