Rethink Repeatable Measures of Robot Performance with Statistical Query

作者: Bowen Weng, Linda Capito, Guillermo A. Castillo, Dylan Khor

分类: cs.RO, eess.SY

发布日期: 2025-05-13 (更新: 2025-10-21)

💡 一句话要点

提出一种轻量级自适应统计查询算法,提升机器人性能评估的可重复性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人性能评估 可重复性 统计查询算法 蒙特卡洛采样 重要性采样

📋 核心要点

- 机器人性能评估的可重复性面临挑战,尤其是在算法层面,现有方法难以应对日益复杂的机器人系统。

- 提出一种轻量级、参数化和自适应的统计查询算法修改方法,旨在提升机器人性能评估的可重复性。

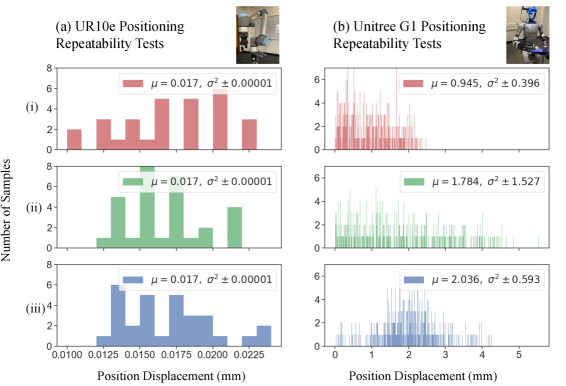

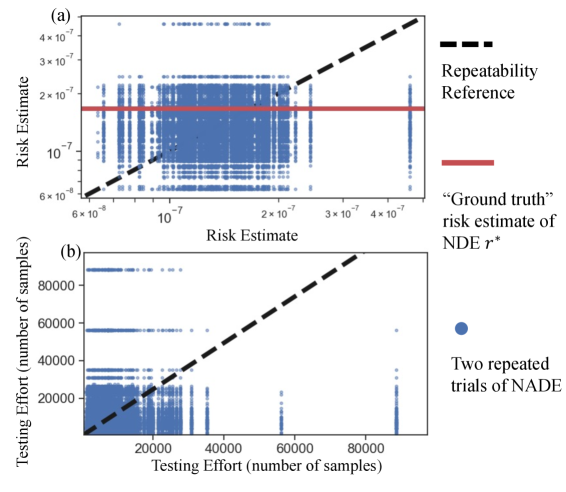

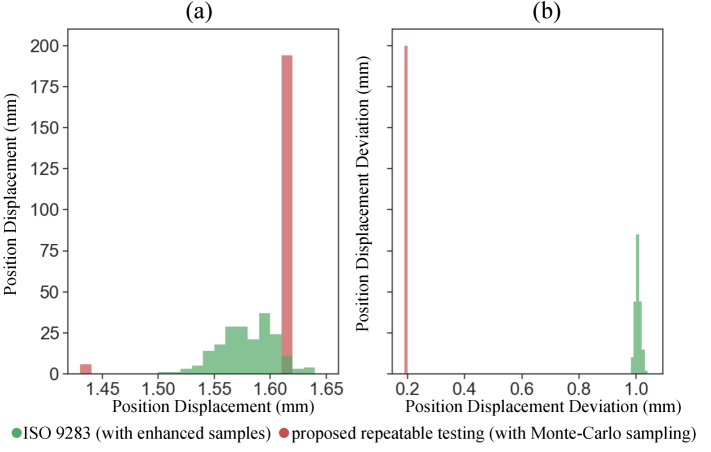

- 在机械臂、自动驾驶和人形机器人等场景的实验表明,该方法能有效提升评估的可重复性,并保证准确性和效率。

📝 摘要(中文)

本文针对机器人性能评估中可重复性日益严峻的挑战,尤其是在算法层面。现有方法难以应对复杂、智能、多样且随机的机器人组件。本文聚焦于标准评估中广泛应用的统计查询(SQ)算法,提出一种轻量级、参数化和自适应的修改方法,该方法适用于各种SQ例程(如蒙特卡洛采样、重要性采样和自适应重要性采样),并能保证算法的可重复性,同时提供准确性和效率的界限。通过三个代表性场景验证了该方法的有效性:机械臂的标准测试、自动驾驶车辆的风险评估以及人形机器人在运动任务中的命令跟踪性能评估。

🔬 方法详解

问题定义:论文旨在解决机器人性能评估中,由于算法的随机性导致的可重复性问题。现有的统计查询(SQ)算法在不同时间、地点或由不同人员执行时,可能产生不同的结果,这使得评估结果难以信赖。尤其是在机器人系统日益复杂和智能化的背景下,这一问题更加突出。

核心思路:论文的核心思路是通过对SQ算法进行轻量级的修改,使其在保证准确性和效率的前提下,具有可证明的可重复性。这种修改方法是参数化的和自适应的,可以根据具体的应用场景进行调整。

技术框架:该方法的核心在于对SQ算法的修改,使其具有可重复性。具体流程包括:1)选择合适的SQ算法(如蒙特卡洛采样、重要性采样等);2)应用论文提出的参数化和自适应修改方法;3)验证修改后的算法在不同条件下的可重复性;4)分析算法的准确性和效率。

关键创新:该方法最重要的创新点在于其通用性和可证明的可重复性。该方法不依赖于特定的SQ算法,可以应用于各种基于采样的评估方法。同时,论文提供了理论保证,证明修改后的算法在一定条件下具有可重复性。

关键设计:关键设计在于参数化和自适应的修改方法。具体的参数设置需要根据具体的应用场景进行调整。论文可能包含一些关于如何选择和调整这些参数的指导原则。此外,论文可能还涉及一些关于如何验证算法可重复性的技术细节,例如使用特定的统计测试方法。

🖼️ 关键图片

📊 实验亮点

论文在三个代表性场景中验证了该方法的有效性:机械臂的标准测试、自动驾驶车辆的风险评估以及人形机器人在运动任务中的命令跟踪性能评估。实验结果表明,该方法能够显著提高评估的可重复性,同时保证了评估的准确性和效率。具体的性能数据和提升幅度需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于机器人性能评估领域,例如工业机器人的质量控制、自动驾驶系统的安全性评估以及人形机器人的运动控制性能测试。通过提高评估的可重复性,可以更准确地比较不同机器人系统,并为机器人技术的研发提供更可靠的依据。该方法还有助于建立更完善的机器人测试标准。

📄 摘要(原文)

For a general standardized testing algorithm designed to evaluate a specific aspect of a robot's performance, several key expectations are commonly imposed. Beyond accuracy (i.e., closeness to a typically unknown ground-truth reference) and efficiency (i.e., feasibility within acceptable testing costs and equipment constraints), one particularly important attribute is repeatability. Repeatability refers to the ability to consistently obtain the same testing outcome when similar testing algorithms are executed on the same subject robot by different stakeholders, across different times or locations. However, achieving repeatable testing has become increasingly challenging as the components involved grow more complex, intelligent, diverse, and, most importantly, stochastic. While related efforts have addressed repeatability at ethical, hardware, and procedural levels, this study focuses specifically on repeatable testing at the algorithmic level. Specifically, we target the well-adopted class of testing algorithms in standardized evaluation: statistical query (SQ) algorithms (i.e., algorithms that estimate the expected value of a bounded function over a distribution using sampled data). We propose a lightweight, parameterized, and adaptive modification applicable to any SQ routine, whether based on Monte Carlo sampling, importance sampling, or adaptive importance sampling, that makes it provably repeatable, with guaranteed bounds on both accuracy and efficiency. We demonstrate the effectiveness of the proposed approach across three representative scenarios: (i) established and widely adopted standardized testing of manipulators, (ii) emerging intelligent testing algorithms for operational risk assessment in automated vehicles, and (iii) developing use cases involving command tracking performance evaluation of humanoid robots in locomotion tasks.