TPT-Bench: A Large-Scale, Long-Term and Robot-Egocentric Dataset for Benchmarking Target Person Tracking

作者: Hanjing Ye, Yu Zhan, Weixi Situ, Guangcheng Chen, Jingwen Yu, Ziqi Zhao, Kuanqi Cai, Arash Ajoudani, Hong Zhang

分类: cs.RO

发布日期: 2025-05-12 (更新: 2025-07-09)

备注: Under review. web: https://medlartea.github.io/tpt-bench/

💡 一句话要点

提出TPT-Bench:用于评估机器人视角下目标人物跟踪的大规模长期数据集

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 目标人物跟踪 机器人视角 大规模数据集 长期跟踪 人机交互

📋 核心要点

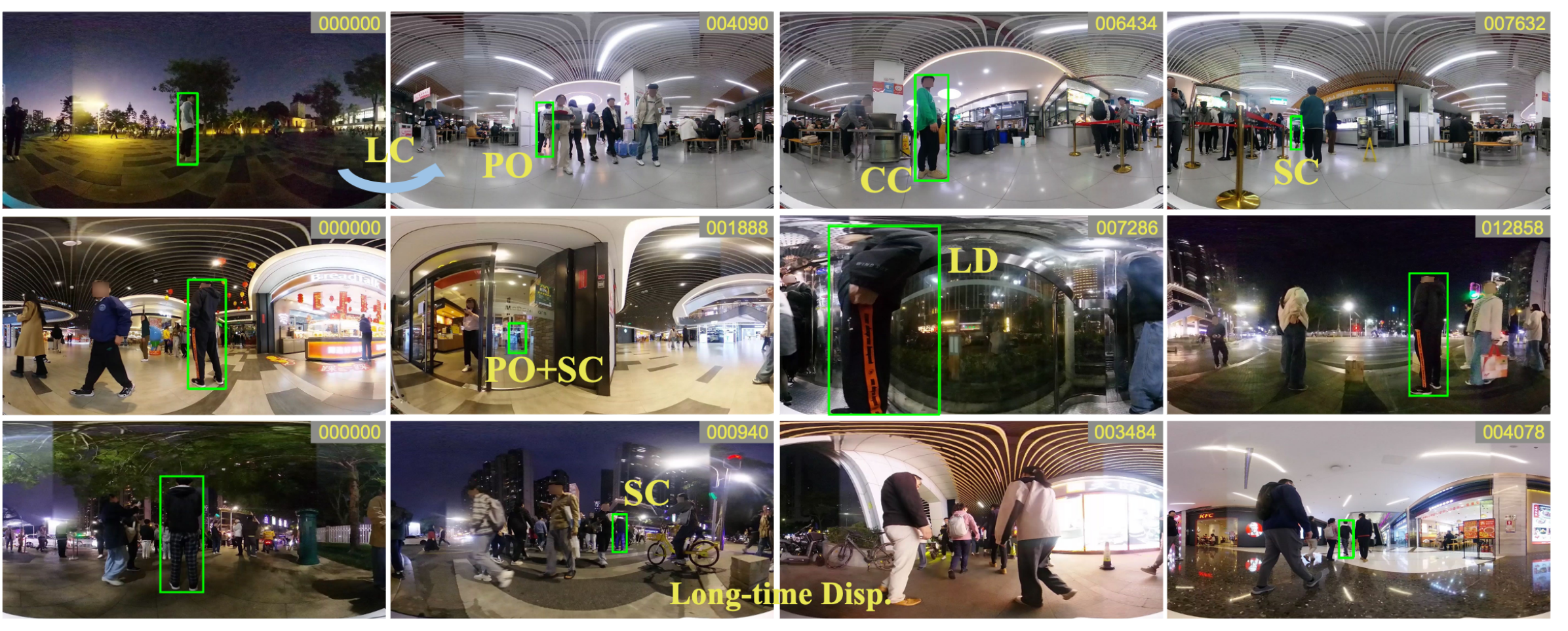

- 现有目标人物跟踪数据集主要局限于受控实验室环境,存在干扰少、背景干净、遮挡时间短等问题。

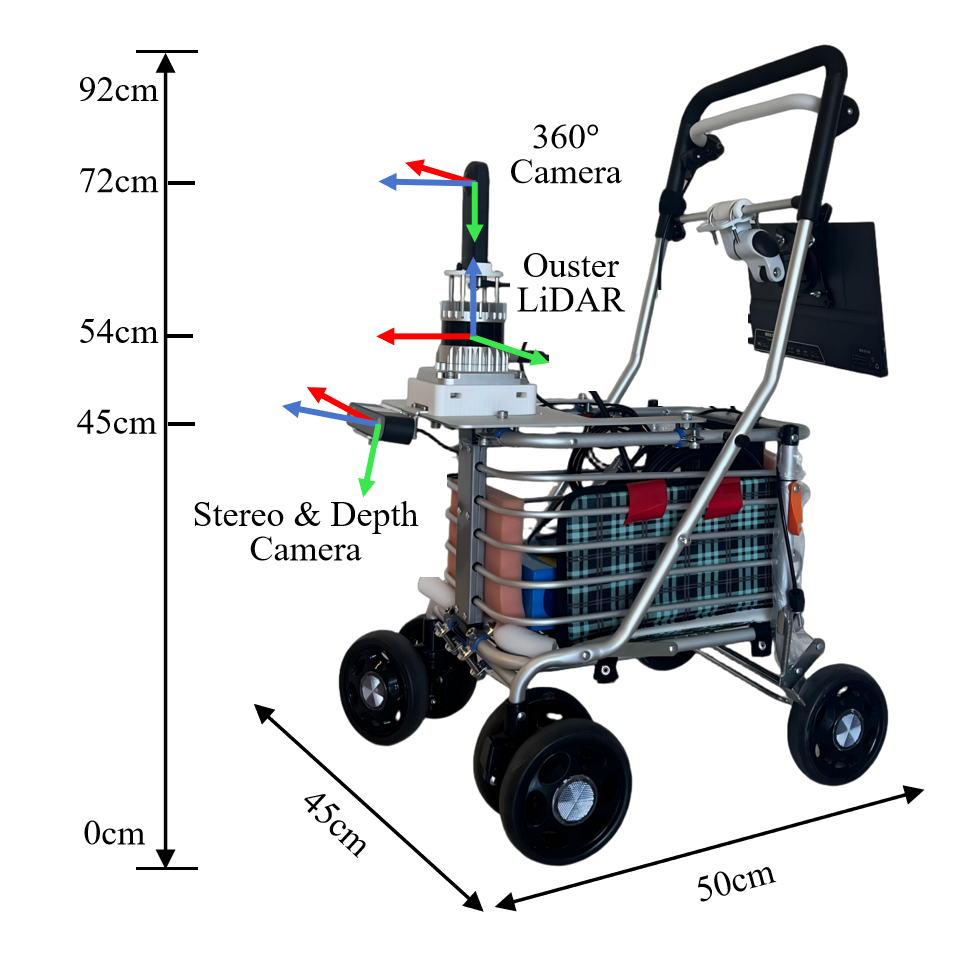

- 论文通过配备传感器的手推车模拟机器人视角,跟随目标人物,采集了包含复杂场景和长期遮挡的数据集。

- 该数据集包含多模态数据,并对目标人物进行了详尽的2D边界框标注,可用于评估和改进现有跟踪算法。

📝 摘要(中文)

本文介绍了一个大规模数据集,专为拥挤和非结构化环境中目标人物跟踪(TPT)而设计,并通过机器人跟随任务进行演示。该数据集由人推着配备传感器的手推车跟随目标人物收集,捕捉了类人跟随行为,并强调了长期跟踪的挑战,包括频繁的遮挡和从众多行人中重新识别的需求。它包括多模态数据流,包括里程计、3D激光雷达、IMU、全景图像和RGB-D图像,以及在48个室内和室外序列中详尽标注的目标人物的2D边界框。利用该数据集和视觉注释,我们使用现有的SOTA TPT方法进行了广泛的实验,对其局限性进行了全面分析,并提出了未来的研究方向。

🔬 方法详解

问题定义:论文旨在解决现有目标人物跟踪(TPT)数据集在复杂环境和长期跟踪方面的不足。现有数据集通常在受控环境中采集,难以反映真实场景中频繁遮挡、背景杂乱等挑战,限制了算法的泛化能力。因此,需要一个更具挑战性、更贴近实际应用的大规模数据集来评估和改进TPT算法。

核心思路:论文的核心思路是通过模拟机器人视角,在真实、复杂的环境中采集数据。具体而言,使用配备多种传感器的手推车跟随目标人物,模拟机器人在人机交互和具身智能应用中的跟随行为。这种方式能够捕捉到更真实的场景变化和跟踪挑战,例如频繁的遮挡和需要从大量行人中重新识别目标人物。

技术框架:TPT-Bench数据集的采集流程如下:首先,由一个人推着配备传感器的手推车,跟随目标人物在室内和室外环境中行走。手推车上安装了多种传感器,包括里程计、3D激光雷达、IMU、全景相机和RGB-D相机,用于获取多模态数据。然后,对采集到的数据进行处理和标注,包括对目标人物进行2D边界框标注。最终,数据集包含48个序列,涵盖了不同的场景和挑战。

关键创新:该数据集的关键创新在于其大规模、长期性和机器人视角的特性。与现有数据集相比,TPT-Bench数据集包含更多的序列、更长的跟踪时间和更复杂的场景。此外,通过模拟机器人视角,数据集能够更好地反映机器人在实际应用中面临的挑战。

关键设计:数据集的关键设计包括:1) 多模态传感器配置,提供丰富的环境信息;2) 详尽的2D边界框标注,方便算法评估;3) 涵盖室内和室外场景,增加数据集的多样性;4) 模拟机器人跟随行为,更贴近实际应用。

🖼️ 关键图片

📊 实验亮点

论文使用TPT-Bench数据集对现有的SOTA TPT方法进行了广泛的实验,结果表明,现有方法在处理长期遮挡和复杂背景时仍存在不足。实验结果为未来的研究方向提供了重要的参考,例如,可以探索更鲁棒的特征表示方法和更有效的重识别策略。

🎯 应用场景

该研究成果可广泛应用于人机交互、具身智能、自主机器人等领域。例如,可以用于开发能够在拥挤环境中稳定跟踪目标人物的机器人助手,为老年人或残疾人提供个性化服务。此外,该数据集还可以促进目标人物跟踪算法的研究和发展,推动相关技术的进步。

📄 摘要(原文)

Tracking a target person from robot-egocentric views is crucial for developing autonomous robots that provide continuous personalized assistance or collaboration in Human-Robot Interaction (HRI) and Embodied AI. However, most existing target person tracking (TPT) benchmarks are limited to controlled laboratory environments with few distractions, clean backgrounds, and short-term occlusions. In this paper, we introduce a large-scale dataset designed for TPT in crowded and unstructured environments, demonstrated through a robot-person following task. The dataset is collected by a human pushing a sensor-equipped cart while following a target person, capturing human-like following behavior and emphasizing long-term tracking challenges, including frequent occlusions and the need for re-identification from numerous pedestrians. It includes multi-modal data streams, including odometry, 3D LiDAR, IMU, panoramic images, and RGB-D images, along with exhaustively annotated 2D bounding boxes of the target person across 48 sequences, both indoors and outdoors. Using this dataset and visual annotations, we perform extensive experiments with existing SOTA TPT methods, offering a thorough analysis of their limitations and suggesting future research directions.