A Framework for Joint Grasp and Motion Planning in Confined Spaces

作者: Martin Rudorfer, Jiří Hartvich, Vojtěch Vonásek

分类: cs.RO

发布日期: 2025-05-12

备注: 2024 13th International Workshop on Robot Motion and Control (RoMoCo)

期刊: 2024 13th International Workshop on Robot Motion and Control (RoMoCo), Poznan, Poland, 2024, pp. 1-7

DOI: 10.1109/RoMoCo60539.2024.10604306

💡 一句话要点

提出用于狭窄空间内联合抓取与运动规划的基准测试框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人抓取 运动规划 狭窄空间 基准测试 联合规划

📋 核心要点

- 现有机器人抓取研究主要集中于桌面环境,忽略了狭窄空间内抓取的运动规划挑战。

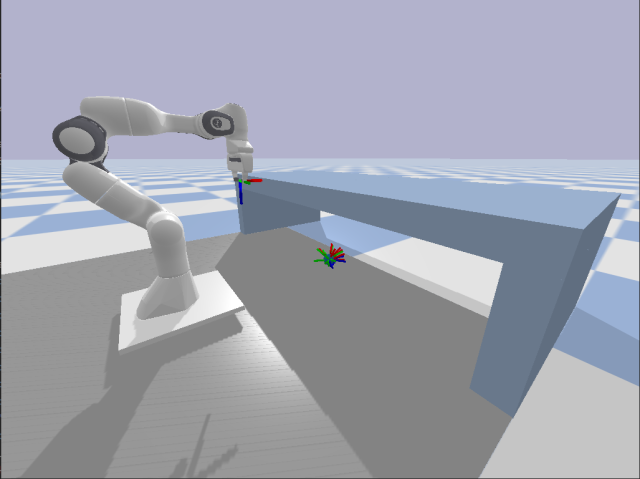

- 论文提出一个基准测试框架,包含多种难度递增的狭窄空间抓取场景,并提供预计算的抓取标注。

- 通过两个基线规划器在框架上的评估,验证了场景难度设计的合理性,并开源所有组件。

📝 摘要(中文)

机器人抓取是机器人应用领域的一项基本技能。目前有大量关于在桌面场景中抓取对象的研究,其中寻找合适的抓取姿势是主要挑战。本文关注的是物体位于狭窄空间因而难以触及的场景。如何规划机器人接近物体的路径成为挑战的主要部分,从而产生了联合抓取和运动规划方法。本文提出的框架提供了20个难度系统性递增的基准场景,带有预计算抓取标注的真实物体,以及创建和共享更多场景的工具。此外,我们提供了两个基线规划器并在这些场景中对其进行评估,证明了所提出的难度级别确实提供了有意义的进展。我们邀请研究界基于此框架进行构建,并将所有组件作为开源软件公开。

🔬 方法详解

问题定义:论文旨在解决机器人如何在狭窄空间内抓取物体的问题。现有方法主要关注桌面环境下的抓取姿态规划,忽略了在复杂、受限空间中,机器人运动到抓取位置的路径规划问题。这种忽略导致现有方法在狭窄空间内表现不佳,因为机器人可能无法安全或有效地到达目标抓取位置。

核心思路:论文的核心思路是将抓取姿态规划和运动规划联合考虑,即同时优化机器人的抓取姿态和到达该姿态的运动轨迹。通过这种联合优化,可以避免先规划抓取姿态再规划运动轨迹可能导致的局部最优解,从而提高抓取的成功率和效率。

技术框架:该框架主要包含以下几个模块:1) 一系列难度递增的基准测试场景,这些场景模拟了真实的狭窄空间环境;2) 带有预计算抓取标注的真实物体模型,这些标注提供了可行的抓取姿态;3) 两个基线规划器,用于评估框架的性能和验证场景的难度;4) 一套用于创建和共享更多场景的工具,方便研究人员扩展和定制框架。

关键创新:该论文的关键创新在于提供了一个系统化的、开源的基准测试框架,用于评估和比较不同的联合抓取和运动规划算法。该框架不仅提供了多种难度递增的场景,还提供了预计算的抓取标注和基线规划器,方便研究人员快速上手并进行实验。此外,该框架还提供了一套用于创建和共享场景的工具,促进了研究社区的合作和交流。

关键设计:场景设计上,通过调整障碍物的数量、形状和位置,以及物体的大小和位置,系统性地增加了抓取的难度。预计算的抓取标注是通过离线计算得到的,可以保证抓取姿态的可行性。基线规划器采用了两种不同的算法:一种是基于采样的运动规划算法,另一种是基于优化的运动规划算法。这些算法可以作为评估框架性能的参考。

🖼️ 关键图片

📊 实验亮点

论文提供了20个难度递增的基准测试场景,并使用两个基线规划器进行了评估。实验结果表明,随着场景难度的增加,基线规划器的性能逐渐下降,验证了场景难度设计的合理性。此外,开源的框架和工具能够方便研究人员进行算法开发和比较。

🎯 应用场景

该研究成果可应用于各种需要在狭窄或复杂环境中进行抓取的机器人应用,例如:仓库拣选、家庭服务机器人、医疗机器人、以及在灾难救援等场景中进行物体抓取的机器人。该基准测试框架能够促进相关算法的开发和评估,加速这些应用场景的落地。

📄 摘要(原文)

Robotic grasping is a fundamental skill across all domains of robot applications. There is a large body of research for grasping objects in table-top scenarios, where finding suitable grasps is the main challenge. In this work, we are interested in scenarios where the objects are in confined spaces and hence particularly difficult to reach. Planning how the robot approaches the object becomes a major part of the challenge, giving rise to methods for joint grasp and motion planning. The framework proposed in this paper provides 20 benchmark scenarios with systematically increasing difficulty, realistic objects with precomputed grasp annotations, and tools to create and share more scenarios. We further provide two baseline planners and evaluate them on the scenarios, demonstrating that the proposed difficulty levels indeed offer a meaningful progression. We invite the research community to build upon this framework by making all components publicly available as open source.