Towards Embodiment Scaling Laws in Robot Locomotion

作者: Bo Ai, Liu Dai, Nico Bohlinger, Dichen Li, Tongzhou Mu, Zhanxin Wu, K. Fay, Henrik I. Christensen, Jan Peters, Hao Su

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-05-09 (更新: 2025-08-29)

备注: Conference on Robot Learning (CoRL), 2025. Project website: https://embodiment-scaling-laws.github.io/

💡 一句话要点

基于大量机器人形态训练,实现机器人运动策略的跨形态泛化

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 具身智能 机器人运动 形态泛化 强化学习 形态缩放 零样本迁移 程序化生成

📋 核心要点

- 现有机器人控制方法难以在不同形态的机器人之间泛化,限制了通用具身智能的发展。

- 通过程序化生成大量不同形态的机器人,并利用这些形态进行训练,探索形态缩放定律。

- 实验表明,增加训练形态的数量能够显著提升策略在未见形态上的泛化能力,并在真实机器人上验证了有效性。

📝 摘要(中文)

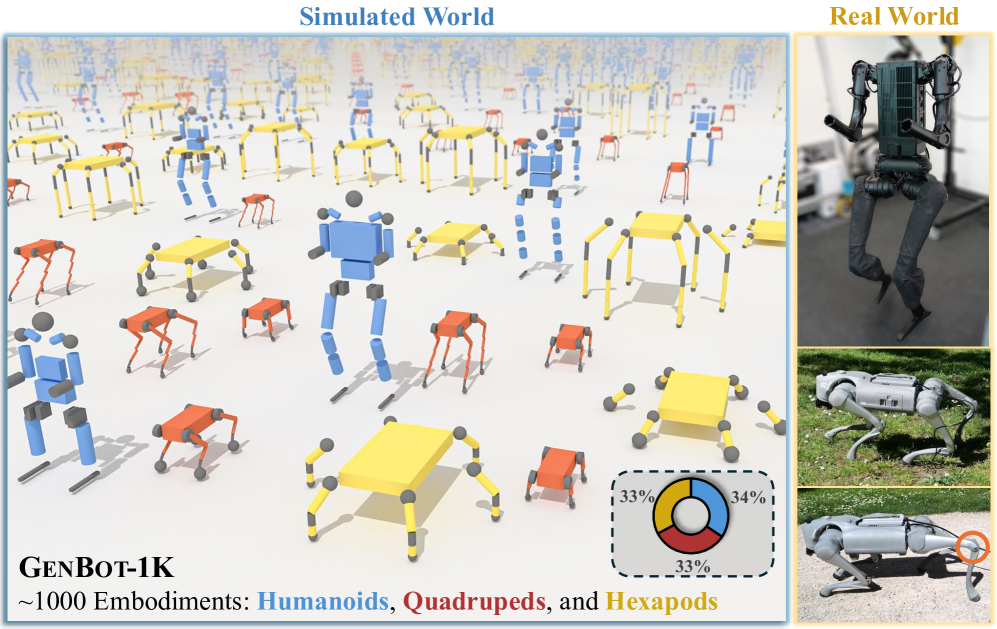

本文研究了具身智能中的形态泛化问题,即如何使智能体在不同机器人形态上通用。作者以机器人运动为实验平台,探讨了形态缩放定律,验证了增加训练所用的机器人形态数量能够提升对未见形态的泛化能力。通过程序化生成约1000种具有拓扑、几何和关节运动学变化的机器人形态,并在随机子集上训练策略,观察到支持该假设的积极缩放趋势。研究表明,形态缩放比固定形态上的数据缩放能够实现更广泛的泛化。最终,在完整数据集上训练的最佳策略能够零样本迁移到模拟和真实环境中的新形态机器人,包括Unitree Go2和H1。这些结果代表了迈向通用具身智能的一步,与可配置机器人的自适应控制、形态协同设计等领域相关。

🔬 方法详解

问题定义:现有机器人运动控制方法通常针对特定机器人形态设计,难以泛化到其他形态的机器人上。这限制了机器人应用的灵活性和通用性,尤其是在需要快速适应新形态或可配置机器人的场景下。现有方法主要依赖于在特定形态上进行大量数据训练,难以解决跨形态泛化问题。

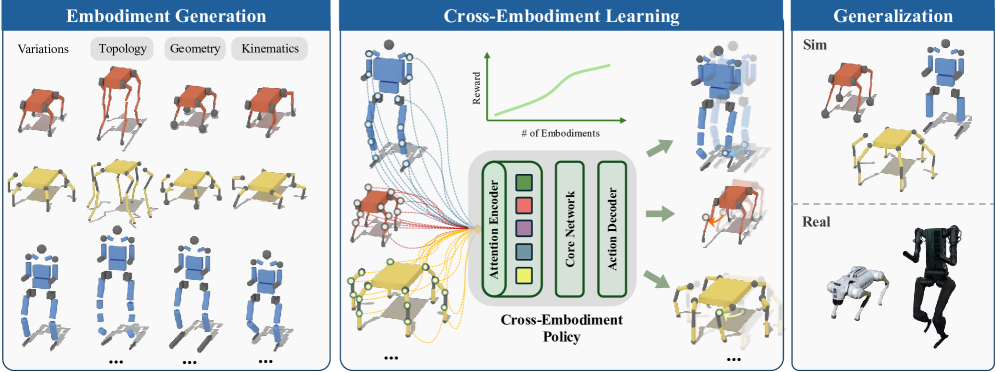

核心思路:本文的核心思路是利用形态缩放定律,即通过增加训练所用的机器人形态的多样性,来提升策略对未见形态的泛化能力。作者认为,通过在足够多的形态上进行训练,策略可以学习到与具体形态无关的通用运动规律,从而实现跨形态的零样本迁移。

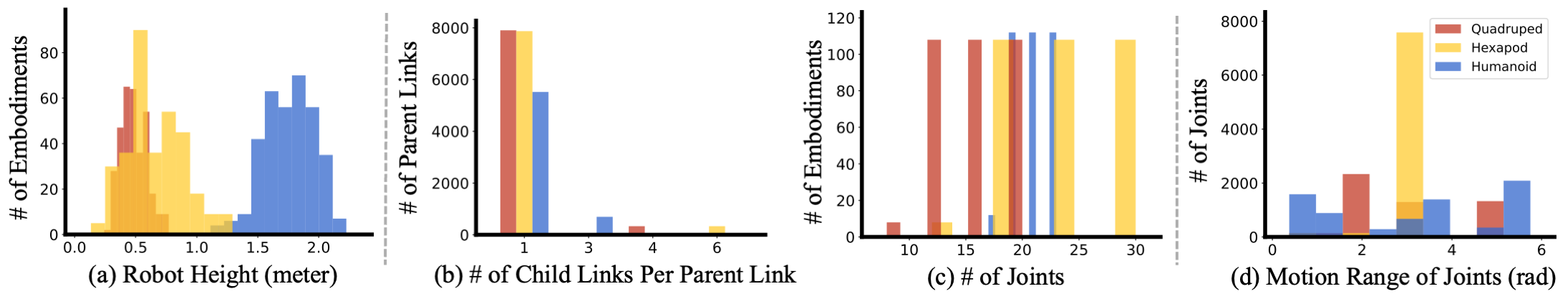

技术框架:整体框架包含三个主要步骤:1) 程序化生成大量具有不同拓扑、几何和关节运动学参数的机器人形态;2) 在这些形态的随机子集上训练运动控制策略;3) 在未见过的形态上评估策略的泛化能力。作者使用强化学习算法训练策略,目标是使机器人能够有效地进行运动。

关键创新:最重要的创新点在于验证了形态缩放定律在机器人运动控制中的有效性。与传统的数据缩放方法不同,本文强调了形态多样性的重要性,并证明了通过增加训练形态的数量可以显著提升泛化能力。此外,程序化生成大量机器人形态的方法也为研究跨形态泛化提供了新的途径。

关键设计:作者设计了一个程序化生成机器人形态的流程,可以控制拓扑结构(如腿的数量)、几何参数(如腿的长度)和关节运动学参数(如关节的运动范围)。在强化学习训练中,使用了常见的策略梯度算法,并针对不同的机器人形态进行了参数调整。损失函数主要关注机器人的运动速度和稳定性,并加入了正则化项以防止过拟合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在完整数据集上训练的策略能够零样本迁移到模拟和真实环境中的新形态机器人,包括Unitree Go2和H1。与在固定形态上进行数据缩放相比,形态缩放能够实现更广泛的泛化。具体而言,通过增加训练形态的数量,策略在未见形态上的运动性能得到了显著提升,验证了形态缩放定律的有效性。

🎯 应用场景

该研究成果可应用于可配置机器人、机器人形态协同设计、以及通用具身智能等领域。例如,可以利用该方法训练一个能够适应各种腿式机器人的通用运动控制器,从而简化机器人开发流程,降低开发成本。此外,该方法还可以用于辅助机器人形态设计,通过评估不同形态的泛化能力,选择更优的形态。

📄 摘要(原文)

Cross-embodiment generalization underpins the vision of building generalist embodied agents for any robot, yet its enabling factors remain poorly understood. We investigate embodiment scaling laws, the hypothesis that increasing the number of training embodiments improves generalization to unseen ones, using robot locomotion as a test bed. We procedurally generate ~1,000 embodiments with topological, geometric, and joint-level kinematic variations, and train policies on random subsets. We observe positive scaling trends supporting the hypothesis, and find that embodiment scaling enables substantially broader generalization than data scaling on fixed embodiments. Our best policy, trained on the full dataset, transfers zero-shot to novel embodiments in simulation and the real world, including the Unitree Go2 and H1. These results represent a step toward general embodied intelligence, with relevance to adaptive control for configurable robots, morphology co-design, and beyond.