Hierarchical Task Decomposition for Execution Monitoring and Error Recovery: Understanding the Rationale Behind Task Demonstrations

作者: Christoph Willibald, Dongheui Lee

分类: cs.RO

发布日期: 2025-05-07

备注: The paper has been accepted for publication by the International Journal of Robotics Research (IJRR), 26 pages

💡 一句话要点

提出一种分层任务分解方法,用于机器人执行监控和错误恢复

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人操作 任务分解 执行监控 异常检测 无监督学习 人机交互 力控制

📋 核心要点

- 多步操作任务中,机器人与环境交互并施加作用力,学习此类任务困难且易出错,现有方法难以有效监控和恢复。

- 该方法从用户演示中学习任务表示,结合无监督任务分割和异常检测,实现执行监控和错误恢复。

- 实验表明,该方法在基于力的任务中优于现有技术,降低了数据需求和计算复杂度,并有效学习了接触行为。

📝 摘要(中文)

本研究提出了一种学习方法,用于直接从真实系统的用户演示中推断低级和高级任务表示。该方法针对机器人与环境交互并根据感知情况施加作用力的多步操作任务,这类任务学习难度大且容易出错,精确模拟也十分困难。为此,开发了一种无监督任务分割算法,结合意图识别和特征聚类来推断任务技能。利用每个技能的特征,提出了一种新颖的无监督异常检测方法,以识别与预期任务执行的偏差。这些组件构成了一个综合框架,能够增量学习任务决策和新行为。与现有技术相比,该方法显著减少了所需的训练数据量和计算复杂度,同时有效地学习了复杂的接触行为和恢复策略。在两个不同的机器人系统上评估的基于力的任务中,所提出的任务分割和异常检测方法优于现有方法。

🔬 方法详解

问题定义:论文旨在解决机器人多步操作任务中,由于与环境交互复杂和需要施加精确作用力而导致的执行监控和错误恢复问题。现有方法通常需要大量的训练数据,计算复杂度高,并且难以有效地学习复杂的接触行为和恢复策略。尤其是在实际机器人系统中,精确模拟这些任务非常困难,使得基于仿真的学习方法效果不佳。

核心思路:论文的核心思路是从真实系统的用户演示中直接学习任务的低级和高级表示。通过无监督的任务分割算法,将复杂的任务分解为一系列技能,并利用这些技能的特征进行异常检测。这种方法避免了对任务进行精确建模的需求,并且能够增量学习新的行为和恢复策略。

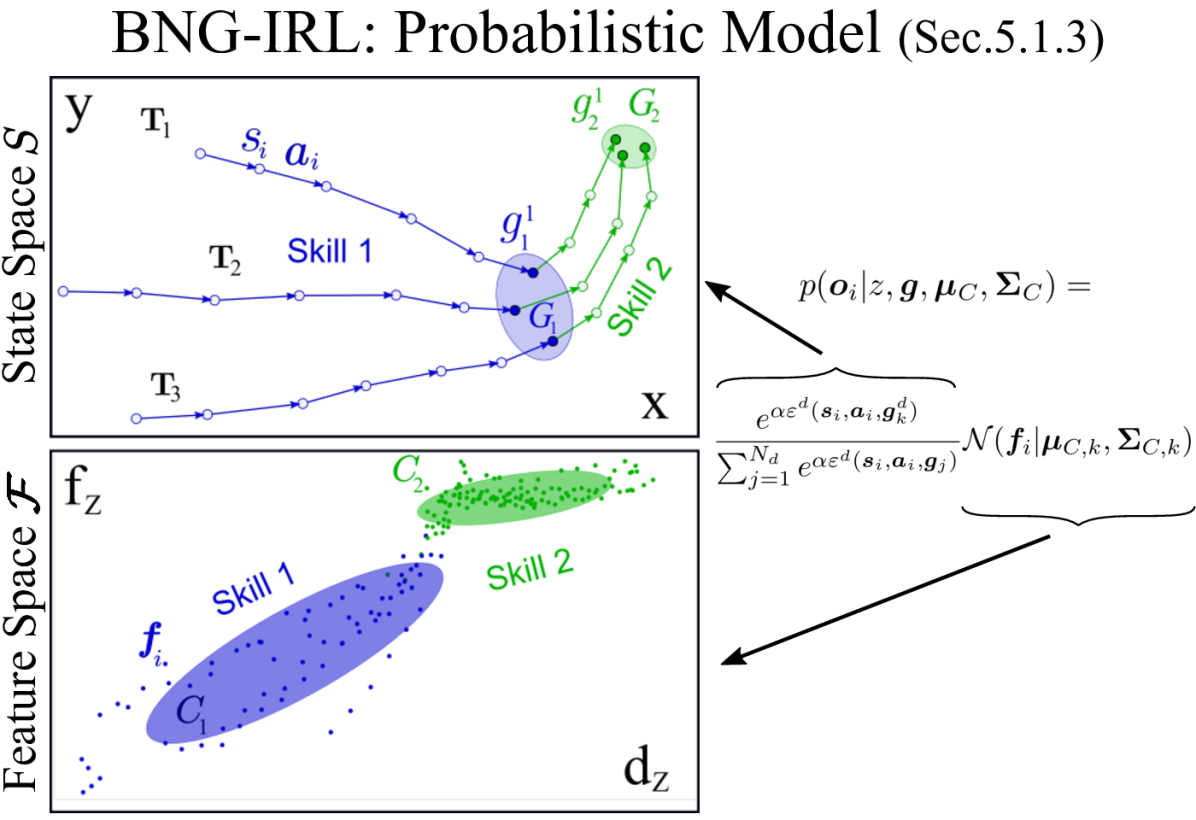

技术框架:该框架包含以下几个主要模块:1) 数据采集:从真实机器人系统的用户演示中收集数据,包括末端执行器的姿态和施加的力。2) 无监督任务分割:使用结合意图识别和特征聚类的算法,将任务分割成一系列技能。3) 特征提取:提取每个技能的特征,例如末端执行器的姿态和力的统计量。4) 无监督异常检测:使用提取的特征,检测与预期任务执行的偏差。5) 任务决策和行为学习:根据检测到的偏差,学习新的任务决策和恢复行为。

关键创新:该论文的关键创新在于提出了一种完全无监督的方法,能够从用户演示中学习任务表示,并进行执行监控和错误恢复。与现有方法相比,该方法不需要人工标注数据,并且能够有效地学习复杂的接触行为。此外,该方法还提出了一种新颖的无监督异常检测方法,能够准确地识别与预期任务执行的偏差。

关键设计:任务分割算法结合了意图识别和特征聚类。意图识别模块用于识别用户想要执行的技能,特征聚类模块用于将具有相似特征的数据点聚类到同一个技能中。异常检测模块使用高斯混合模型(GMM)对每个技能的特征进行建模,并使用GMM的似然度作为异常评分。具体的参数设置和损失函数在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文提出的任务分割和异常检测方法在两个不同的机器人系统上进行了评估,并在基于力的任务中优于现有技术。具体的性能数据和提升幅度在摘要中未给出,属于未知信息。但论文强调该方法显著减少了所需的训练数据量和计算复杂度,同时有效地学习了复杂的接触行为和恢复策略。

🎯 应用场景

该研究成果可应用于各种需要机器人与环境交互的多步操作任务,例如装配、打磨、抛光等。通过学习任务的表示和监控执行过程,可以提高机器人的鲁棒性和可靠性,减少人为干预,并降低生产成本。该方法还可用于训练机器人执行新的任务,并自动生成恢复策略,从而提高机器人的自主性。

📄 摘要(原文)

Multi-step manipulation tasks where robots interact with their environment and must apply process forces based on the perceived situation remain challenging to learn and prone to execution errors. Accurately simulating these tasks is also difficult. Hence, it is crucial for robust task performance to learn how to coordinate end-effector pose and applied force, monitor execution, and react to deviations. To address these challenges, we propose a learning approach that directly infers both low- and high-level task representations from user demonstrations on the real system. We developed an unsupervised task segmentation algorithm that combines intention recognition and feature clustering to infer the skills of a task. We leverage the inferred characteristic features of each skill in a novel unsupervised anomaly detection approach to identify deviations from the intended task execution. Together, these components form a comprehensive framework capable of incrementally learning task decisions and new behaviors as new situations arise. Compared to state-of-the-art learning techniques, our approach significantly reduces the required amount of training data and computational complexity while efficiently learning complex in-contact behaviors and recovery strategies. Our proposed task segmentation and anomaly detection approaches outperform state-of-the-art methods on force-based tasks evaluated on two different robotic systems.