Robust Understanding of Human-Robot Social Interactions through Multimodal Distillation

作者: Tongfei Bian, Mathieu Chollet, Tanaya Guha

分类: cs.RO, cs.HC

发布日期: 2025-05-06 (更新: 2025-10-25)

备注: Accepted by ACM Multimedia 2025, camera-ready version

💡 一句话要点

提出基于多模态知识蒸馏的社交机器人交互理解框架,提升鲁棒性和效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 社交机器人 知识蒸馏 多模态融合 行为理解 鲁棒性 轻量化模型

📋 核心要点

- 现有社交机器人交互模型计算量大,难以实时部署,且在信息不全时表现不佳。

- 利用多模态信息训练教师模型,再通过知识蒸馏,将知识迁移到轻量级的学生模型。

- 实验表明,该学生模型在鲁棒性和效率上均优于现有方法,准确率提升显著。

📝 摘要(中文)

本文提出了一种知识蒸馏框架,用于提升社交机器人对人机社交互动场景的理解能力。该框架利用多模态线索(身体、面部和手势、视线、原始图像)训练一个教师模型,然后将知识转移到仅依赖于身体姿态的学生模型。这种方法旨在提高模型在信息不完整和嘈杂情况下的鲁棒性,并降低计算复杂度。在两个公开的人机交互数据集上的大量实验表明,即使输入数据损坏高达51%,学生模型在多个下游社交理解任务上的平均准确率也比现有方法提高了14.75%。此外,学生模型的参数量小于教师模型的1%,延迟仅为教师模型的11.9%。

🔬 方法详解

问题定义:现有的人机社交互动理解模型通常依赖大量的计算资源,难以在实际的机器人平台上实时部署。此外,这些模型在面对真实场景中常见的不完整或噪声数据时,性能会显著下降。因此,需要一种既高效又鲁棒的社交互动理解方法。

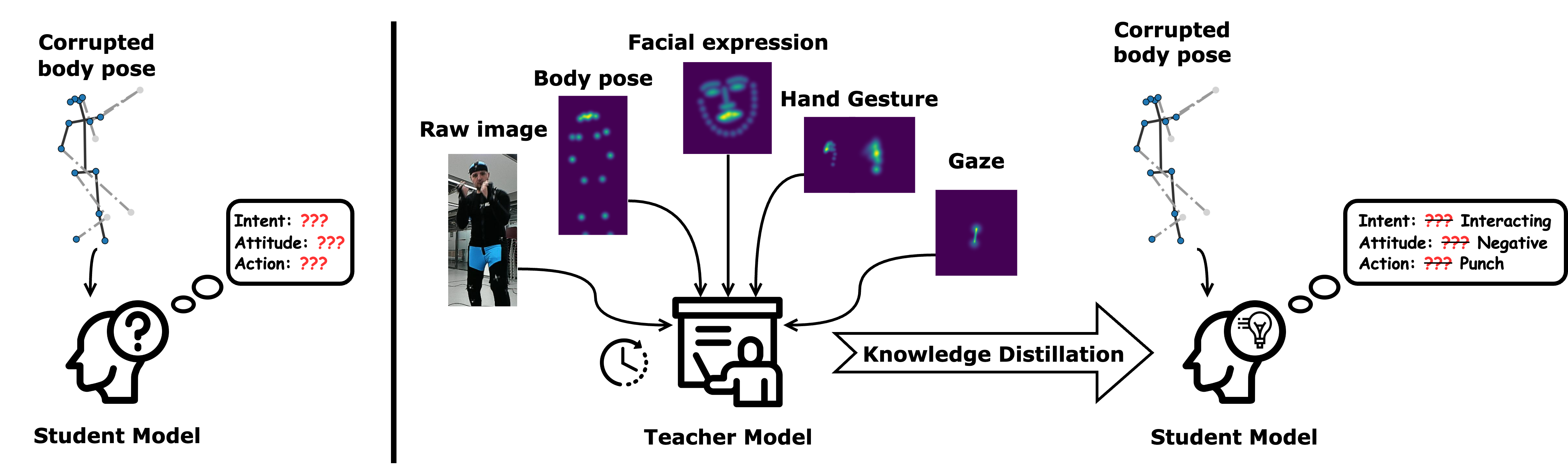

核心思路:本文的核心思路是利用知识蒸馏技术,将一个复杂的多模态教师模型的知识迁移到一个轻量级的、仅依赖于身体姿态的学生模型。通过这种方式,可以在保证模型性能的同时,显著降低计算复杂度,并提高模型在信息不完整情况下的鲁棒性。

技术框架:该框架包含两个主要部分:教师模型和学生模型。教师模型接收多模态输入(身体姿态、面部和手势、视线、原始图像),并学习对社交互动进行建模。学生模型仅接收身体姿态作为输入,并通过知识蒸馏的方式从教师模型学习。训练完成后,学生模型可以独立部署,用于实时社交互动理解。

关键创新:该方法最重要的创新点在于利用知识蒸馏技术,将多模态信息压缩到一个单模态(身体姿态)模型中,从而实现了高效且鲁棒的社交互动理解。与直接训练单模态模型相比,知识蒸馏能够更好地利用多模态信息,提高模型的泛化能力。

关键设计:教师模型可以使用各种现有的多模态融合方法进行训练。学生模型的训练目标是最小化其预测结果与教师模型预测结果之间的差异,可以使用KL散度等损失函数。为了提高学生模型的鲁棒性,可以在训练过程中对输入数据进行随机遮挡或添加噪声。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在两个公开的人机交互数据集上,即使输入数据损坏高达51%,学生模型在多个下游社交理解任务上的平均准确率也比现有方法提高了14.75%。同时,学生模型的参数量小于教师模型的1%,延迟仅为教师模型的11.9%,验证了该方法在效率和鲁棒性方面的优势。

🎯 应用场景

该研究成果可应用于各种需要人机社交互动的场景,例如:陪伴机器人、辅助机器人、智能家居系统等。通过提高机器人对人类社交行为的理解能力,可以使人机交互更加自然流畅,从而提升用户体验和工作效率。此外,该方法的高效性和鲁棒性使其更适合在资源受限的移动平台上部署。

📄 摘要(原文)

There is a growing need for social robots and intelligent agents that can effectively interact with and support users. For the interactions to be seamless, the agents need to analyse social scenes and behavioural cues from their (robot's) perspective. Works that model human-agent interactions in social situations are few; and even those existing ones are computationally too intensive to be deployed in real time or perform poorly in real-world scenarios when only limited information is available. We propose a knowledge distillation framework that models social interactions through various multimodal cues, and yet is robust against incomplete and noisy information during inference. We train a teacher model with multimodal input (body, face and hand gestures, gaze, raw images) that transfers knowledge to a student model which relies solely on body pose. Extensive experiments on two publicly available human-robot interaction datasets demonstrate that our student model achieves an average accuracy gain of 14.75% over competitive baselines on multiple downstream social understanding tasks, even with up to 51% of its input being corrupted. The student model is also highly efficient - less than 1% in size of the teacher model in terms of parameters and its latency is 11.9% of the teacher model. Our code and related data are available at github.com/biantongfei/SocialEgoMobile.