AquaticVision: Benchmarking Visual SLAM in Underwater Environment with Events and Frames

作者: Yifan Peng, Yuze Hong, Ziyang Hong, Apple Pui-Yi Chui, Junfeng Wu

分类: cs.RO

发布日期: 2025-05-06 (更新: 2025-06-05)

💡 一句话要点

AquaticVision:发布水下事件相机与帧数据视觉SLAM基准数据集

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 水下视觉SLAM 事件相机 数据集 地面真实轨迹 水下机器人

📋 核心要点

- 水下视觉SLAM在海洋机器人研究中备受关注,但现有数据集缺乏真值轨迹,难以客观评估算法性能。

- AquaticVision数据集提供水下环境的事件相机与帧数据,并包含运动捕捉系统获取的真值轨迹。

- 该数据集旨在促进更鲁棒的水下视觉SLAM算法开发,事件相机数据可应对水下低光和雾霾等挑战。

📝 摘要(中文)

本文介绍了一个新的水下数据集,用于水下环境中的视觉SLAM算法评估。该数据集包含使用运动捕捉系统获取的地面真实轨迹数据,这在现有的水下视觉SLAM数据集中通常是缺失的。此外,该数据集首次发布了包含事件相机和帧数据的视觉数据,旨在促进更鲁棒和先进的水下视觉SLAM算法的开发。事件相机的使用有助于缓解水下环境中的极端低光或雾霾条件带来的挑战。数据集的网页地址为https://sites.google.com/view/aquaticvision-lias。

🔬 方法详解

问题定义:现有的水下视觉SLAM数据集通常缺乏精确的地面真实轨迹数据,这使得客观地比较不同SLAM算法的性能变得困难。研究人员往往只能依赖于定性的结果或者COLMAP重建效果进行评估,缺乏量化的指标。此外,水下环境的光照条件差、存在雾霾等问题,也给视觉SLAM带来了挑战。

核心思路:本文的核心思路是构建一个包含地面真实轨迹数据以及事件相机和帧数据的综合性水下视觉SLAM数据集。通过提供精确的真值轨迹,可以对SLAM算法进行量化评估。同时,引入事件相机数据,可以利用其高动态范围和低延迟的特性,克服水下环境光照条件差和存在雾霾等问题。

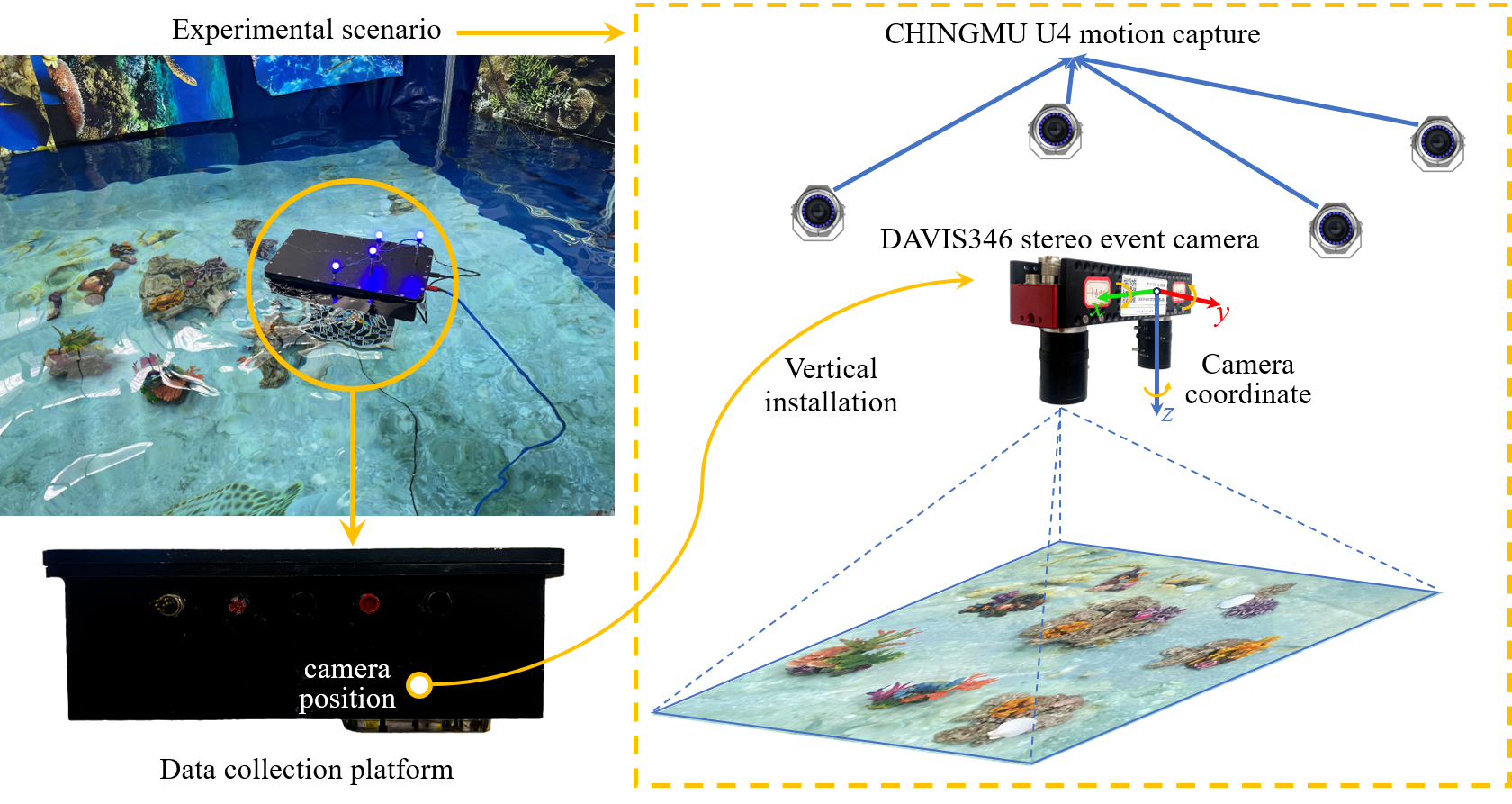

技术框架:该数据集的构建主要包括以下几个阶段:首先,使用运动捕捉系统获取水下机器人的精确轨迹作为地面真实数据。其次,同步采集水下环境的帧图像和事件相机数据。最后,对采集到的数据进行标定和校准,并将其整理成统一的格式。数据集包含多个不同场景和光照条件下的序列,以覆盖不同的水下应用场景。

关键创新:该数据集的关键创新在于:1)首次提供了包含地面真实轨迹数据的水下视觉SLAM数据集,这使得量化评估SLAM算法的性能成为可能。2)首次发布了包含事件相机和帧数据的视觉数据,为研究人员探索基于事件相机的水下视觉SLAM算法提供了基础。

关键设计:数据集的地面真实轨迹数据由高精度的运动捕捉系统获取,精度达到毫米级别。事件相机采用DVS(Dynamic Vision Sensor)技术,具有高动态范围和低延迟的特性。帧图像采用全局快门相机采集,避免了运动模糊。数据集提供了相机内外参数标定结果,方便研究人员使用。

🖼️ 关键图片

📊 实验亮点

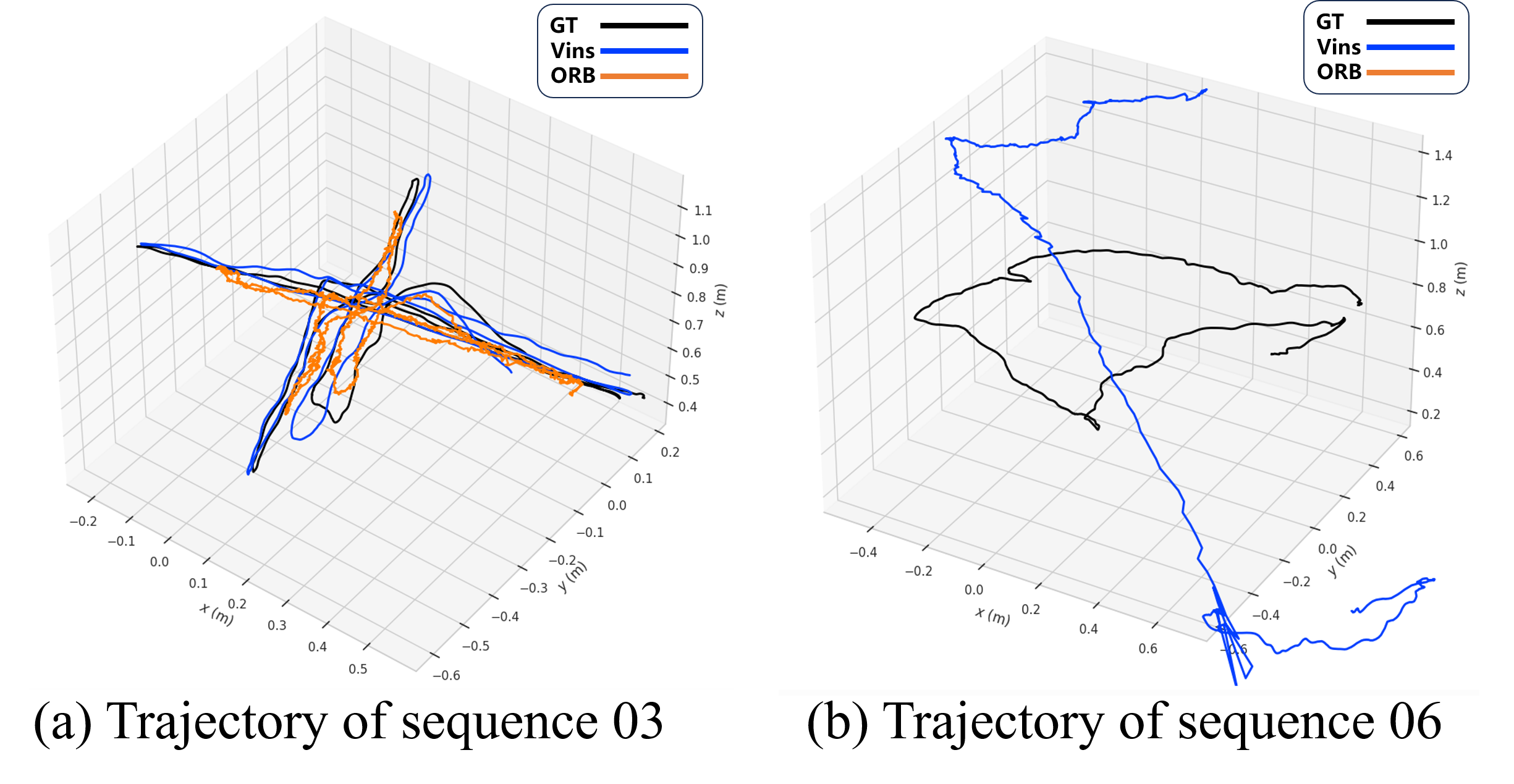

该数据集首次提供了包含地面真实轨迹数据的水下视觉SLAM数据集,并首次发布了包含事件相机和帧数据的视觉数据。通过使用该数据集,研究人员可以更客观地评估和比较不同的水下视觉SLAM算法,并探索基于事件相机的新型SLAM算法。该数据集为水下视觉SLAM领域的研究提供了重要的资源。

🎯 应用场景

该研究成果可广泛应用于水下机器人导航、水下结构检测、海洋环境监测等领域。精确的视觉SLAM技术能够帮助水下机器人实现自主导航和定位,提高其在复杂水下环境中的作业能力。此外,该数据集的发布将促进水下视觉SLAM算法的发展,为海洋工程和科学研究提供更可靠的技术支持。

📄 摘要(原文)

Many underwater applications, such as offshore asset inspections, rely on visual inspection and detailed 3D reconstruction. Recent advancements in underwater visual SLAM systems for aquatic environments have garnered significant attention in marine robotics research. However, existing underwater visual SLAM datasets often lack groundtruth trajectory data, making it difficult to objectively compare the performance of different SLAM algorithms based solely on qualitative results or COLMAP reconstruction. In this paper, we present a novel underwater dataset that includes ground truth trajectory data obtained using a motion capture system. Additionally, for the first time, we release visual data that includes both events and frames for benchmarking underwater visual positioning. By providing event camera data, we aim to facilitate the development of more robust and advanced underwater visual SLAM algorithms. The use of event cameras can help mitigate challenges posed by extremely low light or hazy underwater conditions. The webpage of our dataset is https://sites.google.com/view/aquaticvision-lias.